EHRWorld: A Patient-Centric Medical World Model for Long-Horizon Clinical Trajectories

作者: Linjie Mu, Zhongzhen Huang, Yannian Gu, Shengqian Qin, Shaoting Zhang, Xiaofan Zhang

分类: cs.AI, cs.LG

发布日期: 2026-02-03

💡 一句话要点

EHRWorld:面向长期临床轨迹的以患者为中心的医疗世界模型

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 医疗世界模型 长期临床轨迹 电子健康记录 因果序列建模 大型语言模型

📋 核心要点

- 现有LLM在长期临床模拟中,由于无法维持患者状态的一致性,导致误差累积,限制了其作为动态医学世界模型的应用。

- EHRWorld通过在因果序列范式下训练,学习患者状态的演变规律,从而实现更准确的长期临床轨迹预测。

- EHRWorld在长期模拟稳定性、临床敏感事件建模和推理效率方面均优于LLM基线,验证了其有效性。

📝 摘要(中文)

世界模型为模拟干预下的未来状态提供了一个原则性框架,但在医学等复杂、高风险领域实现此类模型仍然具有挑战性。最近的大型语言模型(LLM)在静态医学推理任务上取得了强大的性能,引发了它们是否可以作为动态医学世界模型,能够模拟疾病进展和治疗结果的问题。本文表明,仅包含医学知识的LLM难以在连续干预下维持一致的患者状态,导致长期临床模拟中的误差累积。为了解决这个限制,我们引入了EHRWorld,一个在因果序列范式下训练的以患者为中心的医疗世界模型,以及EHRWorld-110K,一个源自真实电子健康记录的大规模纵向临床数据集。广泛的评估表明,EHRWorld显著优于基于LLM的基线方法,实现了更稳定的长期模拟,改进了对临床敏感事件的建模,并提高了推理效率,突出了在因果关系明确的、时间演化的临床数据上进行训练对于可靠和鲁棒的医学世界建模的必要性。

🔬 方法详解

问题定义:论文旨在解决LLM在长期临床轨迹模拟中表现不佳的问题。现有方法,特别是直接使用LLM进行医学推理,无法很好地处理连续干预下的患者状态变化,导致误差随着时间推移而累积,最终影响模拟的准确性和可靠性。这种误差累积源于LLM缺乏对因果关系的明确建模以及对时间演化临床数据的有效利用。

核心思路:论文的核心思路是构建一个以患者为中心的医疗世界模型,该模型能够学习并模拟患者在连续干预下的状态演变。通过在因果序列范式下训练,模型可以更好地理解不同干预措施对患者状态的影响,从而实现更准确的长期临床轨迹预测。这种方法强调了对因果关系和时间演化数据的建模,以克服LLM在长期模拟中的局限性。

技术框架:EHRWorld的整体框架包括数据收集与预处理、模型训练和评估三个主要阶段。首先,从真实的电子健康记录中提取大规模纵向临床数据集EHRWorld-110K。然后,使用该数据集在因果序列范式下训练EHRWorld模型。模型训练的目标是学习患者状态在连续干预下的演变规律。最后,通过一系列实验评估EHRWorld在长期模拟稳定性、临床敏感事件建模和推理效率方面的性能。

关键创新:论文最重要的技术创新点在于提出了EHRWorld,一个专门为长期临床轨迹模拟而设计的医疗世界模型。与直接使用LLM进行医学推理不同,EHRWorld在因果序列范式下训练,能够更好地捕捉患者状态在连续干预下的变化。此外,EHRWorld-110K数据集的构建也为该领域的研究提供了宝贵的数据资源。

关键设计:EHRWorld的具体实现细节未知,但可以推测其可能采用循环神经网络(RNN)或Transformer等序列模型来建模患者状态的时间演化。损失函数可能包括预测患者状态的交叉熵损失、以及用于鼓励模型学习因果关系的正则化项。模型的输入可能包括患者的病史、诊断、治疗方案等信息,输出则是预测的未来患者状态。

🖼️ 关键图片

📊 实验亮点

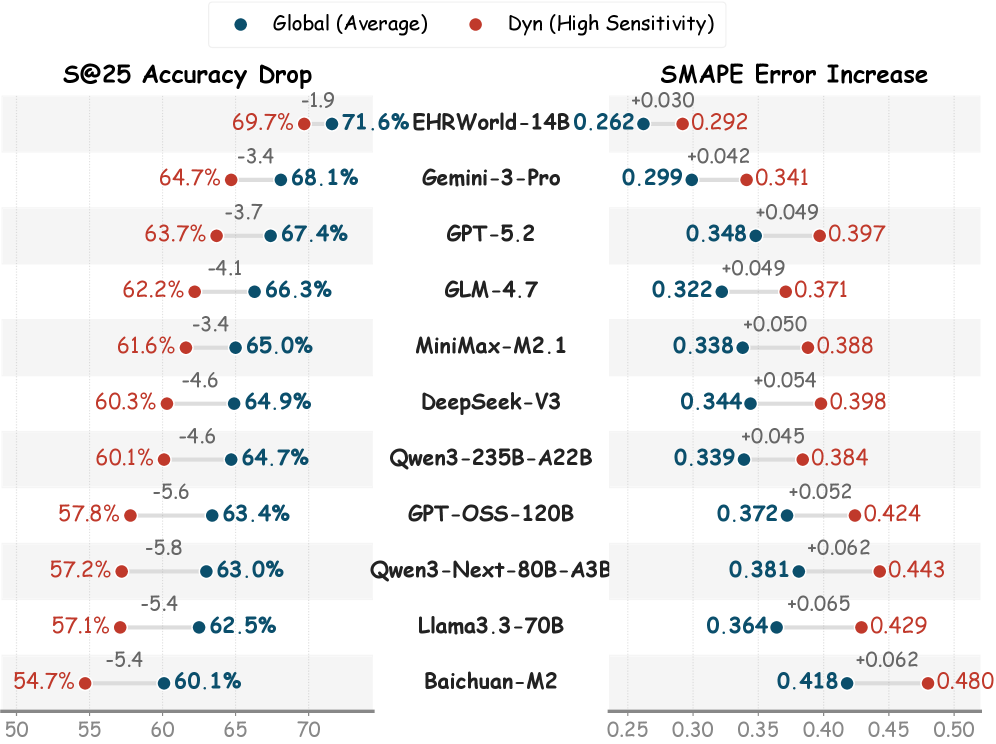

EHRWorld在实验中显著优于基于LLM的基线方法,在长期模拟稳定性、临床敏感事件建模和推理效率方面均取得了显著提升。具体性能数据未知,但论文强调EHRWorld能够实现更稳定的长期模拟,更好地建模临床敏感事件,并提高推理效率,表明其在长期临床轨迹模拟方面具有显著优势。

🎯 应用场景

EHRWorld具有广泛的应用前景,可用于辅助临床决策、评估治疗方案的有效性、预测疾病进展以及进行药物研发。通过模拟不同干预措施对患者状态的影响,EHRWorld可以帮助医生制定更个性化的治疗方案,提高治疗效果。此外,EHRWorld还可以用于评估新药的疗效和安全性,加速药物研发进程。该研究的未来影响在于推动医学人工智能的发展,为医疗领域带来更智能、更高效的解决方案。

📄 摘要(原文)

World models offer a principled framework for simulating future states under interventions, but realizing such models in complex, high-stakes domains like medicine remains challenging. Recent large language models (LLMs) have achieved strong performance on static medical reasoning tasks, raising the question of whether they can function as dynamic medical world models capable of simulating disease progression and treatment outcomes over time. In this work, we show that LLMs only incorporating medical knowledge struggle to maintain consistent patient states under sequential interventions, leading to error accumulation in long-horizon clinical simulation. To address this limitation, we introduce EHRWorld, a patient-centric medical world model trained under a causal sequential paradigm, together with EHRWorld-110K, a large-scale longitudinal clinical dataset derived from real-world electronic health records. Extensive evaluations demonstrate that EHRWorld significantly outperforms naive LLM-based baselines, achieving more stable long-horizon simulation, improved modeling of clinically sensitive events, and favorable reasoning efficiency, highlighting the necessity of training on causally grounded, temporally evolving clinical data for reliable and robust medical world modeling.