When Routing Collapses: On the Degenerate Convergence of LLM Routers

作者: Guannan Lai, Han-Jia Ye

分类: cs.AI

发布日期: 2026-02-03

🔗 代码/项目: GITHUB

💡 一句话要点

提出EquiRouter以解决LLM路由中的退化收敛问题,提升成本效益。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM路由 路由崩溃 决策感知 模型选择 成本效益

📋 核心要点

- 现有LLM路由器在成本预算增加时倾向于选择最强大的模型,导致小型模型利用不足和成本浪费,即“路由崩溃”现象。

- EquiRouter通过直接学习模型排名,而非预测标量性能,从而实现决策感知,避免因小误差导致的次优模型选择。

- 实验表明,EquiRouter在RouterBench上,在达到GPT-4级别性能的同时,相比现有最佳路由器,成本降低约17%。

📝 摘要(中文)

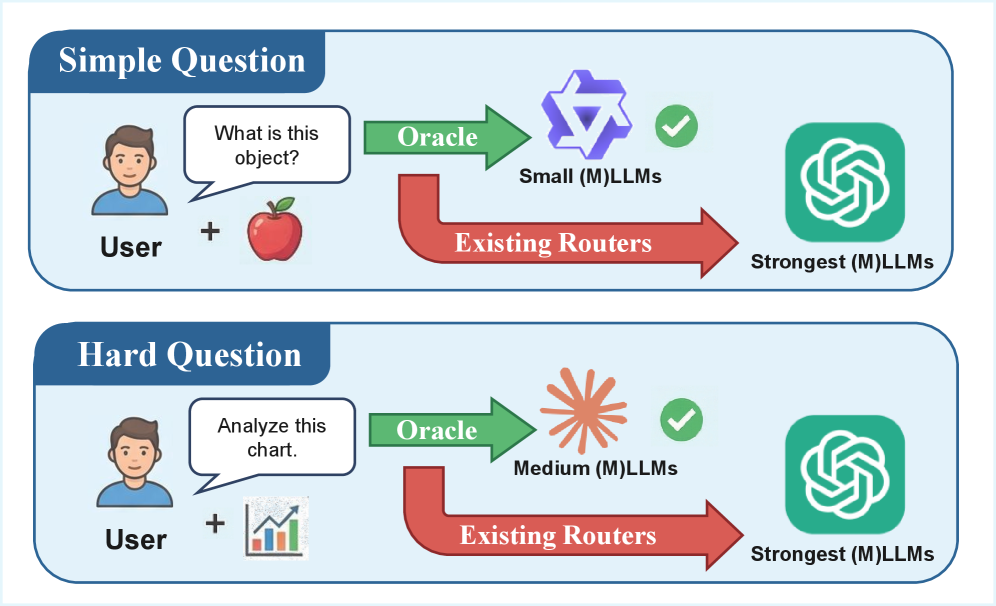

LLM路由旨在通过动态地将简单查询分配给较小模型,将困难查询分配给更强大的模型,从而实现质量与成本之间的良好权衡。然而,在单模态和多模态设置中,我们发现现有路由器中存在一种普遍但未被充分探索的失效模式:随着用户成本预算的增加,路由器系统性地默认选择最强大且最昂贵的模型,即使较便宜的模型已经足够。因此,当前的路由器未能充分利用小型模型,浪费了计算和金钱成本,并破坏了路由的核心承诺;我们称这种现象为路由崩溃。我们将路由崩溃归因于目标-决策不匹配:许多路由器被训练来预测标量性能得分,而路由决策最终取决于候选模型之间的离散比较。因此,小的预测误差会翻转相对排序并触发次优选择。为了弥合这一差距,我们提出了EquiRouter,一种决策感知的路由器,它直接学习模型排名,恢复小型模型的作用并减轻路由崩溃。在RouterBench上,与之前最强的路由器相比,EquiRouter在GPT-4级别的性能下降低了约17%的成本。

🔬 方法详解

问题定义:论文旨在解决LLM路由中出现的“路由崩溃”问题。现有路由器在成本预算增加时,倾向于选择能力最强的模型,即使较小的模型已经足够胜任任务。这种现象导致计算资源和金钱成本的浪费,未能实现LLM路由的初衷,即在质量和成本之间取得平衡。现有方法通常训练路由器预测标量性能得分,但最终的路由决策依赖于模型之间的离散比较,导致目标函数与决策过程不匹配。

核心思路:EquiRouter的核心思路是直接学习模型排名,而不是预测标量性能得分。通过直接学习模型之间的相对优劣关系,可以避免因小的预测误差而导致的次优模型选择。这种决策感知的训练方式能够更好地匹配路由决策的本质,从而更有效地利用小型模型,降低整体成本。

技术框架:EquiRouter的整体框架包括一个路由模型和一个模型池。路由模型接收输入查询,并输出模型池中各个模型的排名。然后,根据用户设定的成本预算,选择排名最高的模型来处理查询。训练过程中,路由模型通过最小化一个排序损失函数来学习模型排名。

关键创新:EquiRouter的关键创新在于其决策感知的训练方式。与传统的基于标量预测的路由器不同,EquiRouter直接学习模型排名,从而更好地匹配路由决策的本质。这种方法能够有效缓解路由崩溃问题,提高成本效益。

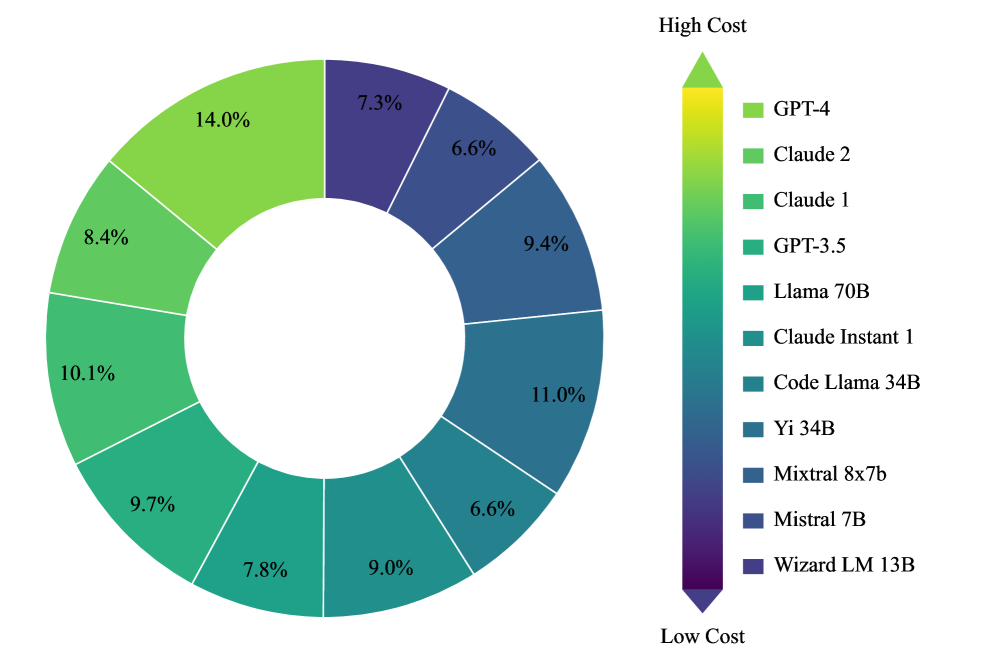

关键设计:EquiRouter使用一个Transformer网络作为路由模型。损失函数采用pairwise ranking loss,鼓励模型对更适合处理当前查询的模型给出更高的排名。在训练过程中,使用RouterBench数据集进行训练和评估。具体参数设置和网络结构细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

EquiRouter在RouterBench数据集上进行了评估,实验结果表明,与现有最强的路由器相比,EquiRouter在达到GPT-4级别性能的同时,成本降低了约17%。这表明EquiRouter能够更有效地利用小型模型,显著提高成本效益,有效缓解了路由崩溃问题。

🎯 应用场景

EquiRouter可应用于各种需要动态选择LLM的场景,例如智能客服、内容生成、代码生成等。通过降低计算成本,可以使LLM服务更经济高效,并促进其在资源受限环境中的部署。该研究对于提升LLM应用的可持续性和可扩展性具有重要意义。

📄 摘要(原文)

LLM routing aims to achieve a favorable quality--cost trade-off by dynamically assigning easy queries to smaller models and harder queries to stronger ones. However, across both unimodal and multimodal settings, we uncover a pervasive yet underexplored failure mode in existing routers: as the user's cost budget increases, routers systematically default to the most capable and most expensive model even when cheaper models already suffice. As a result, current routers under-utilize small models, wasting computation and monetary cost and undermining the core promise of routing; we term this phenomenon routing collapse. We attribute routing collapse to an objective--decision mismatch: many routers are trained to predict scalar performance scores, whereas routing decisions ultimately depend on discrete comparisons among candidate models. Consequently, small prediction errors can flip relative orderings and trigger suboptimal selections. To bridge this gap, we propose EquiRouter, a decision-aware router that directly learns model rankings, restoring the role of smaller models and mitigating routing collapse. On RouterBench, EquiRouter reduces cost by about 17\% at GPT-4-level performance compared to the strongest prior router. Our code is available at https://github.com/AIGNLAI/EquiRouter.