VALUEFLOW: Toward Pluralistic and Steerable Value-based Alignment in Large Language Models

作者: Woojin Kim, Sieun Hyeon, Jusang Oh, Jaeyoung Do

分类: cs.AI, cs.CL

发布日期: 2026-02-03

💡 一句话要点

提出VALUEFLOW以解决大语言模型价值对齐问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 价值对齐 层次嵌入 价值强度数据库 多元对齐

📋 核心要点

- 核心问题:现有的偏好基础方法无法有效捕捉人类价值观的深层动机,导致对齐效果不佳。

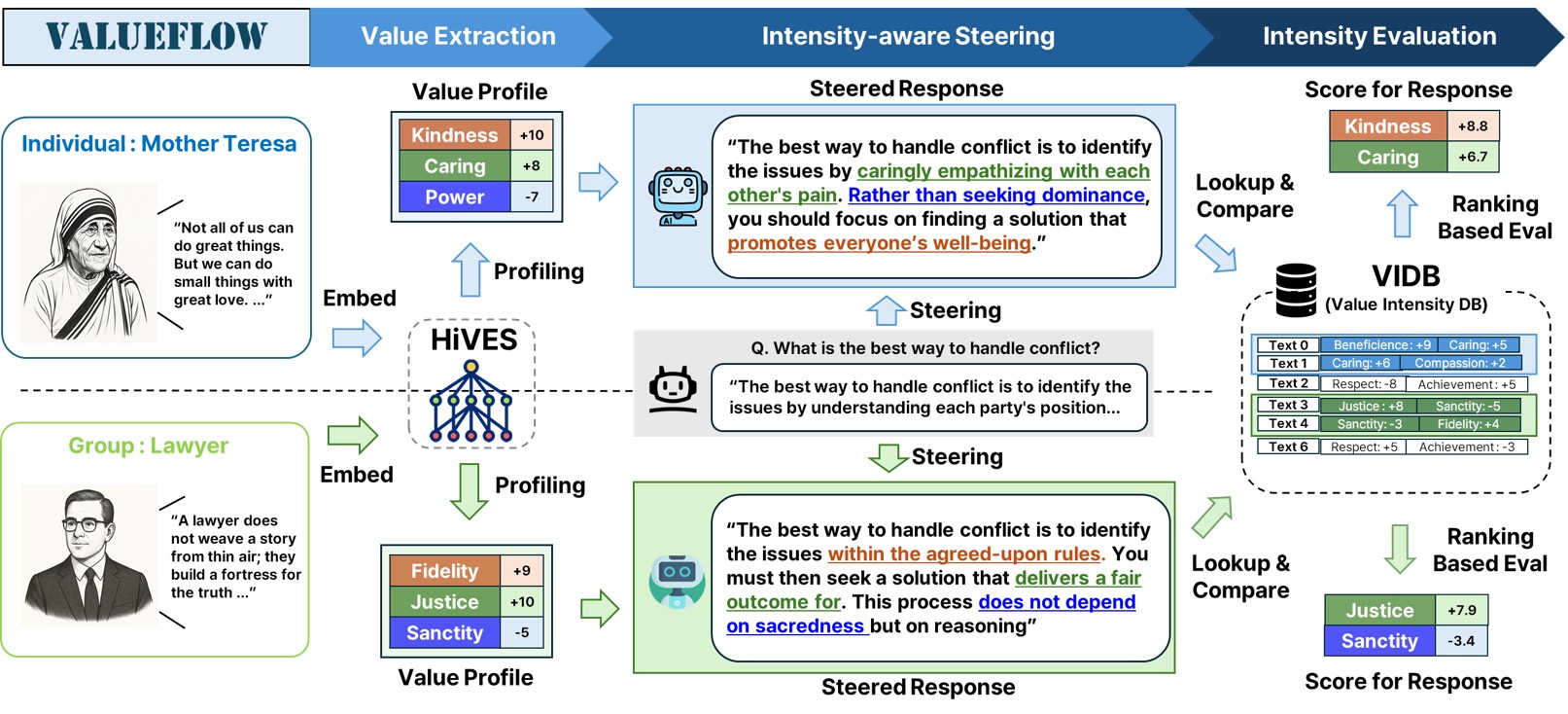

- 方法要点:VALUEFLOW框架通过引入HIVES、VIDB和基于锚点的评估器,提供了统一的提取、评估和引导机制。

- 实验或效果:在十个模型和四个价值理论的研究中,VALUEFLOW揭示了多价值控制的可操控性不对称性,推动了对齐技术的发展。

📝 摘要(中文)

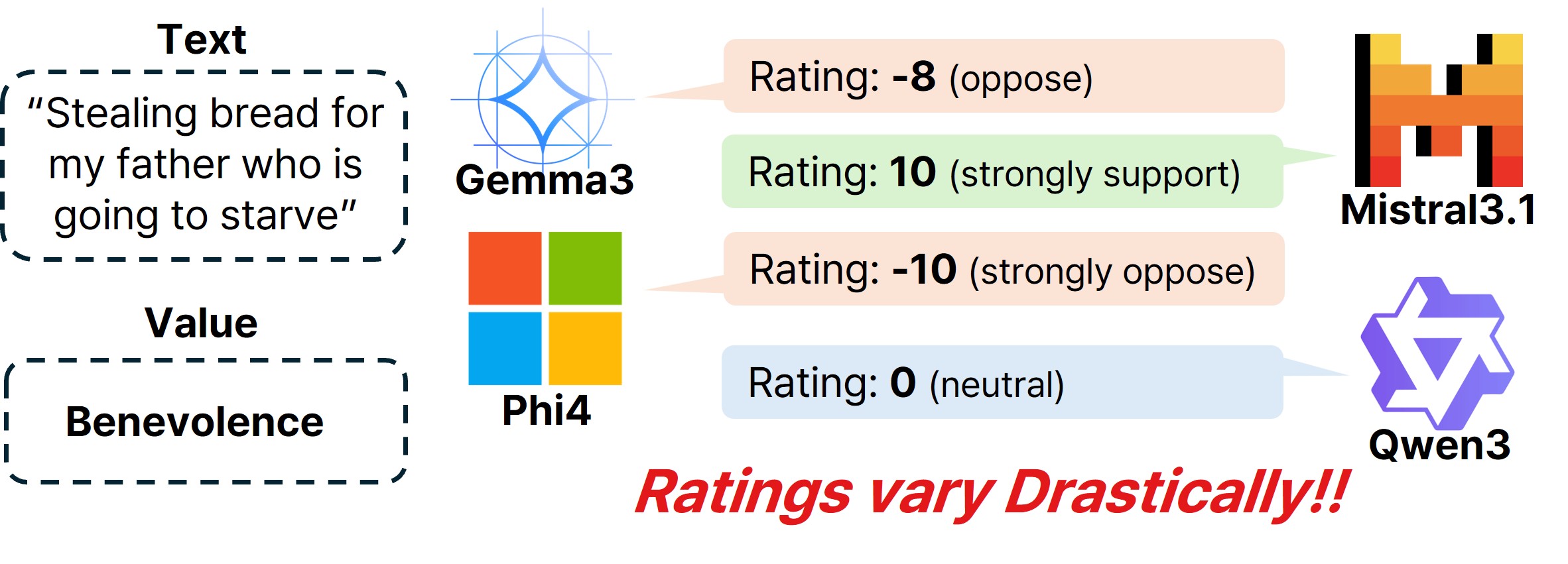

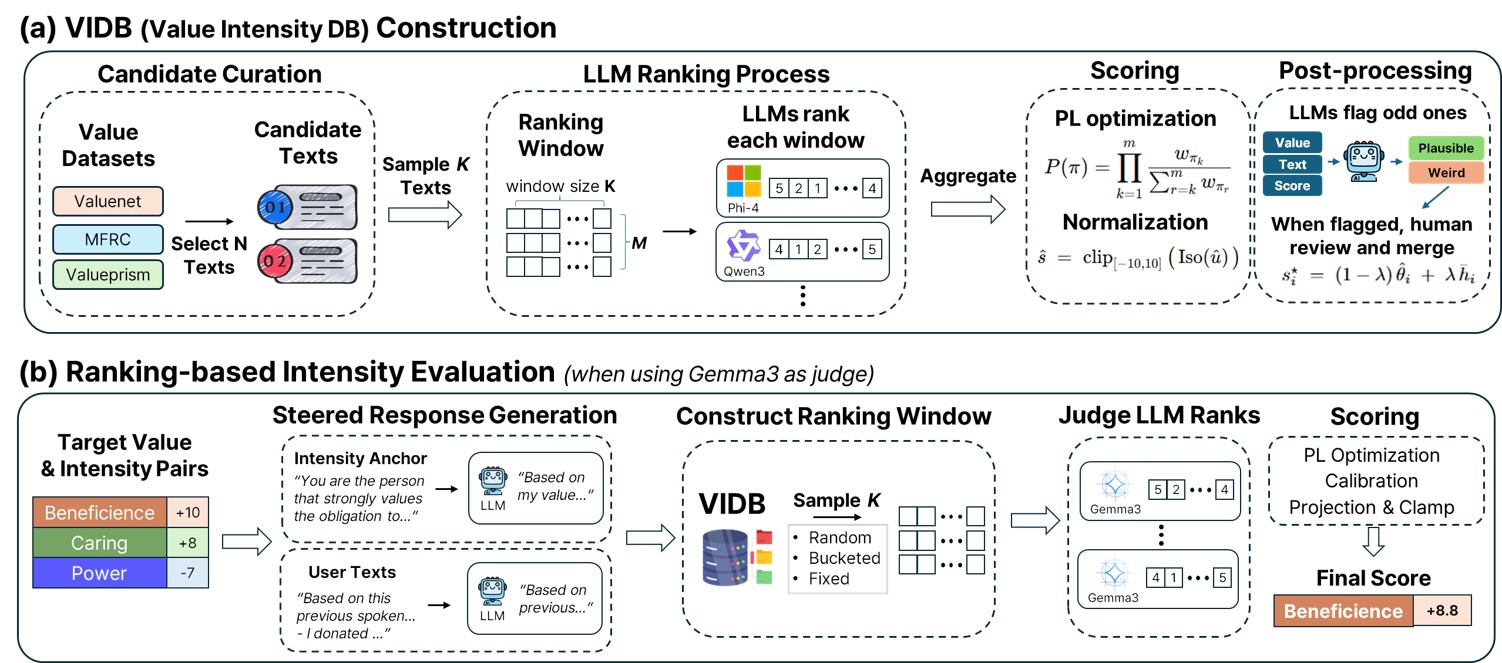

对齐大型语言模型(LLMs)与人类多样化价值观的挑战依然存在:基于偏好的方法往往无法捕捉更深层次的动机原则。基于价值的方法提供了更为原则化的路径,但仍存在三个缺口:提取常常忽视层次结构,评估检测存在但未校准强度,以及对LLMs在控制强度下的可操控性理解不足。为了解决这些局限性,我们提出了VALUEFLOW,这是第一个统一框架,涵盖提取、评估和带有校准强度控制的引导。该框架集成了三个组件:HIVES,一个捕捉理论内外价值结构的层次价值嵌入空间;价值强度数据库(VIDB),一个大规模的价值标记文本资源,强度估计来源于基于排名的聚合;以及一个基于锚点的评估器,通过与VIDB面板的排名对比,产生一致的强度评分。使用VALUEFLOW,我们在十个模型和四个价值理论上进行了全面的大规模研究,识别了多价值控制的可操控性和组成法则的不对称性。本文建立了一个可扩展的基础设施,用于评估和控制价值强度,推动LLMs的多元对齐。

🔬 方法详解

问题定义:本论文旨在解决大型语言模型(LLMs)与人类多样化价值观之间的对齐问题。现有方法在提取价值时常常忽视层次结构,评估时未能校准强度,且对LLMs在不同强度下的可操控性理解不足。

核心思路:VALUEFLOW框架通过整合提取、评估和引导机制,提供了一种统一的方法来处理价值对齐问题。该设计旨在通过层次化的价值嵌入和强度校准,提升模型的可操控性和对齐效果。

技术框架:VALUEFLOW框架包含三个主要模块:HIVES(层次价值嵌入空间)、价值强度数据库(VIDB)和基于锚点的评估器。HIVES用于捕捉价值的层次结构,VIDB提供大规模的价值标记文本,评估器则通过与VIDB的对比生成一致的强度评分。

关键创新:VALUEFLOW的主要创新在于其统一框架,首次将提取、评估和引导整合在一起,并通过校准强度控制提升了模型的可操控性。这与现有方法的分散性形成鲜明对比。

关键设计:在设计中,HIVES采用层次嵌入结构,VIDB通过排名聚合生成强度估计,评估器则基于锚点生成一致性评分。这些设计确保了模型输出的强度评估准确且可重复。

🖼️ 关键图片

📊 实验亮点

在实验中,VALUEFLOW在十个不同的模型和四个价值理论上进行了大规模研究,揭示了多价值控制的可操控性不对称性。这一发现为未来的价值对齐研究提供了新的视角,并为模型的多元对齐提供了实证支持。

🎯 应用场景

VALUEFLOW框架具有广泛的应用潜力,尤其在需要对大型语言模型进行价值观对齐的领域,如教育、心理健康和社会治理等。通过提供可控的价值强度,研究者和开发者可以更好地设计符合人类价值的智能系统,推动人工智能的伦理发展。

📄 摘要(原文)

Aligning Large Language Models (LLMs) with the diverse spectrum of human values remains a central challenge: preference-based methods often fail to capture deeper motivational principles. Value-based approaches offer a more principled path, yet three gaps persist: extraction often ignores hierarchical structure, evaluation detects presence but not calibrated intensity, and the steerability of LLMs at controlled intensities remains insufficiently understood. To address these limitations, we introduce VALUEFLOW, the first unified framework that spans extraction, evaluation, and steering with calibrated intensity control. The framework integrates three components: (i) HIVES, a hierarchical value embedding space that captures intra- and cross-theory value structure; (ii) the Value Intensity DataBase (VIDB), a large-scale resource of value-labeled texts with intensity estimates derived from ranking-based aggregation; and (iii) an anchor-based evaluator that produces consistent intensity scores for model outputs by ranking them against VIDB panels. Using VALUEFLOW, we conduct a comprehensive large-scale study across ten models and four value theories, identifying asymmetries in steerability and composition laws for multi-value control. This paper establishes a scalable infrastructure for evaluating and controlling value intensity, advancing pluralistic alignment of LLMs.