Live-Evo: Online Evolution of Agentic Memory from Continuous Feedback

作者: Yaolun Zhang, Yiran Wu, Yijiong Yu, Qingyun Wu, Huazheng Wang

分类: cs.AI, cs.LG

发布日期: 2026-02-02

备注: 13 pages

🔗 代码/项目: GITHUB

💡 一句话要点

提出Live-Evo以解决在线记忆演化问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 在线学习 自我演化 记忆管理 经验库 智能代理

📋 核心要点

- 现有的自我演化系统在动态环境中表现不佳,无法有效应对真实分布变化和持续反馈。

- Live-Evo通过经验库和元指导库解耦记忆的存储与使用,能够在线学习并适应新的数据流。

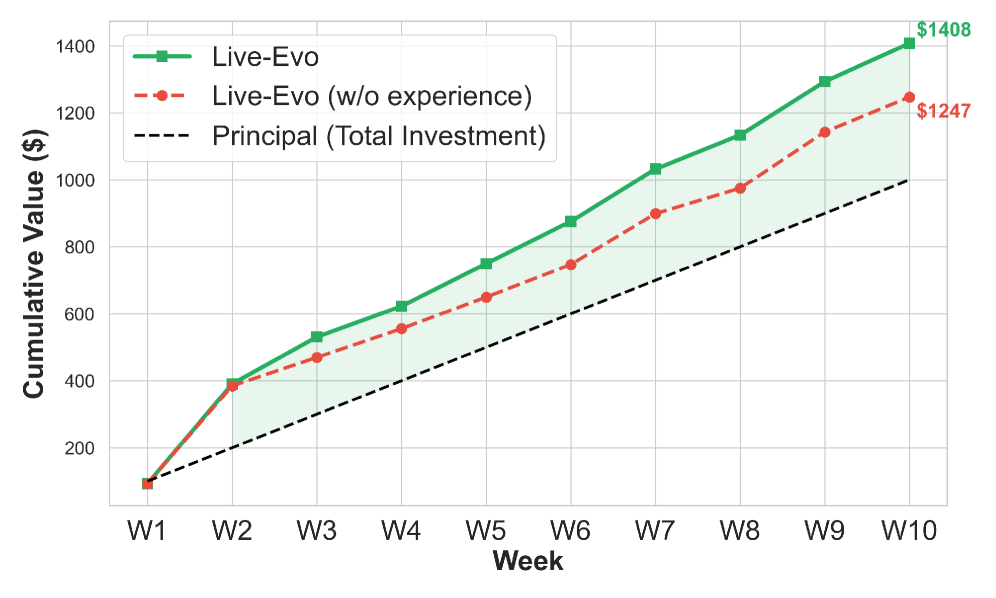

- 在Prophet Arena基准测试中,Live-Evo显著提高了Brier分数和市场回报,展示了其强大的实用性。

📝 摘要(中文)

大型语言模型(LLM)代理越来越多地配备记忆,这些记忆存储经验并提供可重用的指导,从而提高任务解决性能。近期的自我演化系统基于交互结果更新记忆,但大多数现有演化管道是为静态训练/测试分割开发的,仅通过折叠静态基准近似在线学习,导致在真实分布变化和持续反馈下表现脆弱。我们提出了Live-Evo,这是一种在线自我演化记忆系统,能够随着时间的推移从持续数据流中学习。Live-Evo通过经验库和元指导库将“发生了什么”与“如何使用”解耦,为每个任务编译任务自适应的指导。在在线管理记忆方面,Live-Evo维护经验权重并根据反馈进行更新:持续有效的经验被强化并更频繁地检索,而误导性或过时的经验则被降低权重并逐渐遗忘。实验结果表明,Live-Evo在10周的Prophet Arena基准测试中将Brier分数提高了20.8%,市场回报增加了12.9%。

🔬 方法详解

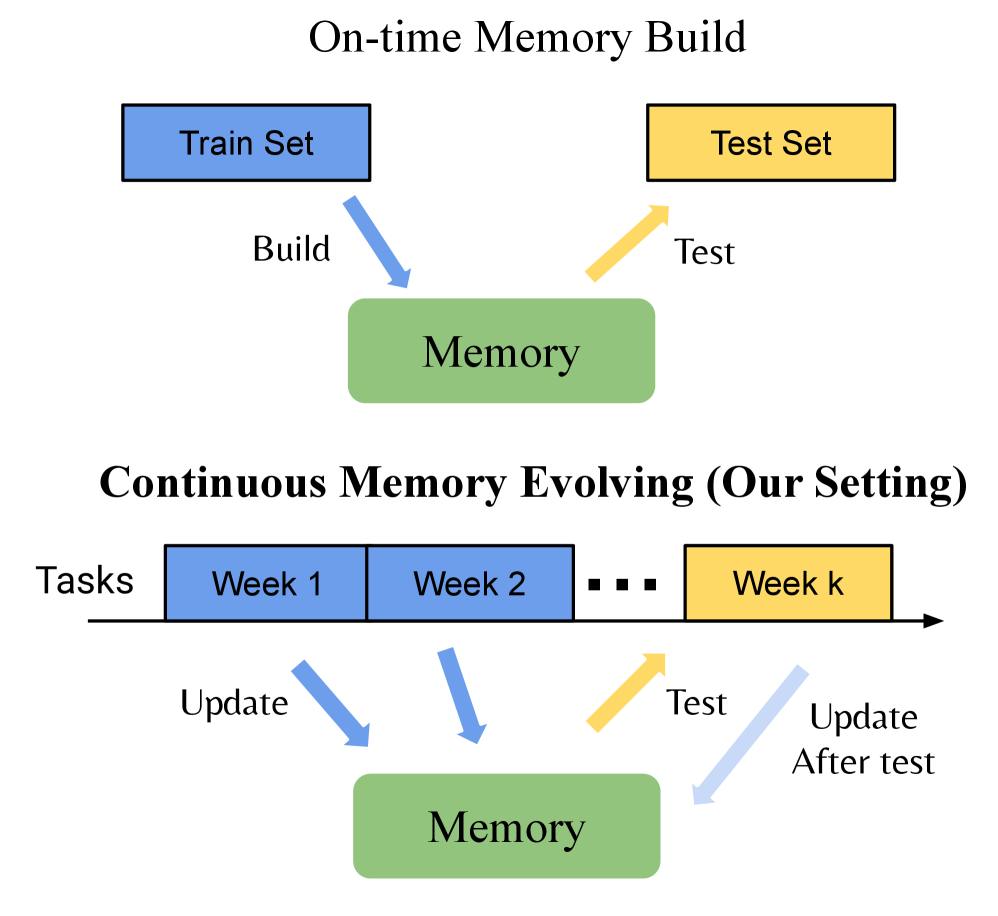

问题定义:本论文旨在解决现有自我演化系统在动态环境中无法有效更新记忆的问题。现有方法多为静态训练/测试分割,难以应对真实的分布变化和持续反馈。

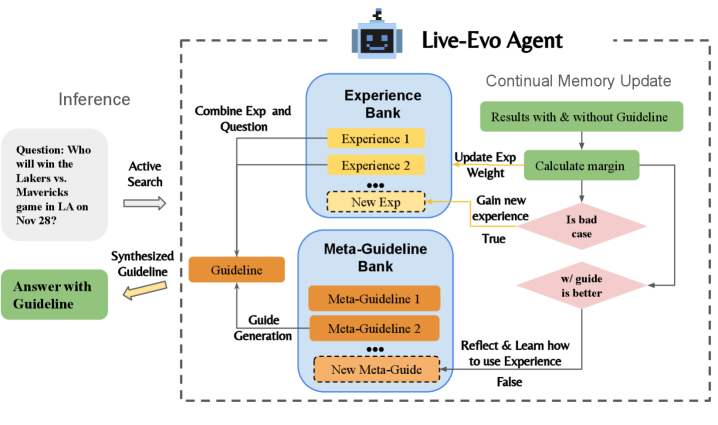

核心思路:论文提出的Live-Evo系统通过经验库和元指导库将“发生了什么”与“如何使用”进行解耦,允许系统从持续的数据流中学习并适应新的任务需求。

技术框架:Live-Evo的整体架构包括经验库和元指导库两个主要模块。经验库存储历史经验并根据反馈调整权重,元指导库则根据检索到的经验生成任务自适应的指导。

关键创新:Live-Evo的核心创新在于其在线记忆管理机制,通过动态调整经验权重来强化有效经验并逐渐遗忘无效经验,这种设计与传统静态记忆管理方法有本质区别。

关键设计:在技术细节上,Live-Evo使用了强化学习的思想来更新经验权重,设计了特定的损失函数以优化经验的选择和使用效率。

🖼️ 关键图片

📊 实验亮点

在10周的Prophet Arena基准测试中,Live-Evo将Brier分数提高了20.8%,市场回报增加了12.9%。此外,该系统在深度研究基准上也表现出一致的提升,超越了强基线,证明了其优越性和实用性。

🎯 应用场景

Live-Evo的研究成果在多个领域具有潜在应用价值,尤其是在需要实时适应和学习的智能代理系统中,如金融市场预测、在线客服和个性化推荐等。其在线演化能力将推动智能系统在动态环境中的表现,提升用户体验和决策效率。

📄 摘要(原文)

Large language model (LLM) agents are increasingly equipped with memory, which are stored experience and reusable guidance that can improve task-solving performance. Recent \emph{self-evolving} systems update memory based on interaction outcomes, but most existing evolution pipelines are developed for static train/test splits and only approximate online learning by folding static benchmarks, making them brittle under true distribution shift and continuous feedback. We introduce \textsc{Live-Evo}, an online self-evolving memory system that learns from a stream of incoming data over time. \textsc{Live-Evo} decouples \emph{what happened} from \emph{how to use it} via an Experience Bank and a Meta-Guideline Bank, compiling task-adaptive guidelines from retrieved experiences for each task. To manage memory online, \textsc{Live-Evo} maintains experience weights and updates them from feedback: experiences that consistently help are reinforced and retrieved more often, while misleading or stale experiences are down-weighted and gradually forgotten, analogous to reinforcement and decay in human memory. On the live \textit{Prophet Arena} benchmark over a 10-week horizon, \textsc{Live-Evo} improves Brier score by 20.8\% and increases market returns by 12.9\%, while also transferring to deep-research benchmarks with consistent gains over strong baselines. Our code is available at https://github.com/ag2ai/Live-Evo.