Constrained Process Maps for Multi-Agent Generative AI Workflows

作者: Ananya Joshi, Michael Rudow

分类: cs.AI

发布日期: 2026-02-02

💡 一句话要点

提出多代理生成AI工作流的约束过程图以解决不确定性问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多代理系统 马尔可夫决策过程 认知不确定性 合规审查 人工智能安全

📋 核心要点

- 现有的多代理系统在处理不确定性和协调方面存在局限,难以有效观察模型的决策过程。

- 本文提出了一种基于有限时域马尔可夫决策过程的多代理系统,能够更好地管理任务的升级和完成。

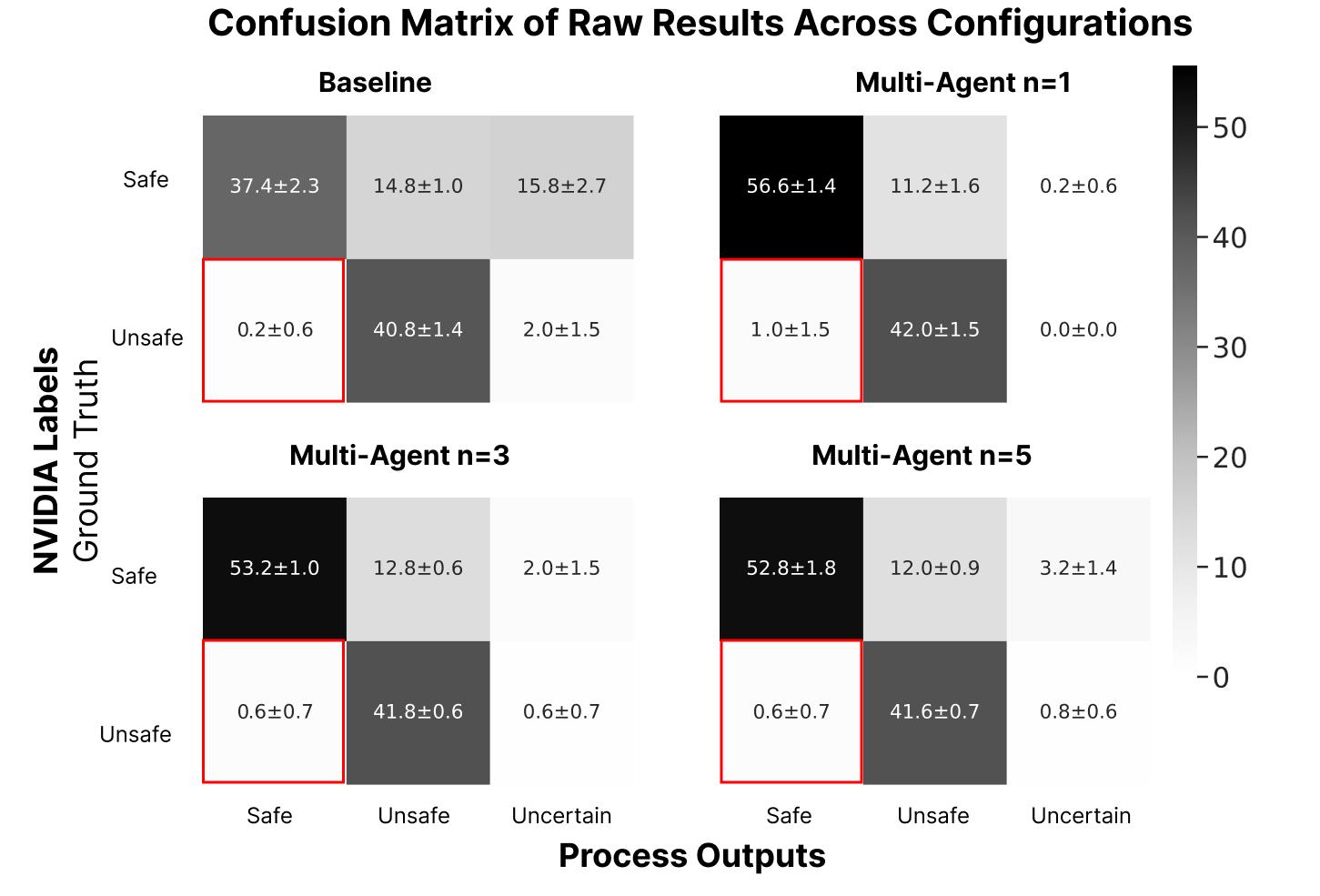

- 实验结果显示,该方法在准确性上提高了19%,人类审查需求减少了85倍,处理时间也有所缩短。

📝 摘要(中文)

基于大型语言模型(LLM)的代理在合规和尽职调查等受监管环境中被广泛应用于复杂的多步骤工作流。然而,现有的代理架构主要依赖于单一代理的提示工程,难以观察或比较模型在不确定性和协调方面的表现。本文提出了一种多代理系统,形式化为有限时域马尔可夫决策过程(MDP),每个代理对应特定角色或决策阶段,预定义的转移表示任务升级或完成。通过蒙特卡洛估计量化代理级别的认知不确定性,系统级别的不确定性则通过MDP的终止状态进行捕捉。通过自伤检测的AI安全评估案例研究,结果显示该方法在准确性上提高了19%,人类审查需求减少了85倍,并在某些配置中缩短了处理时间。

🔬 方法详解

问题定义:本文旨在解决现有多代理系统在不确定性和协调方面的不足,尤其是在复杂工作流中的决策过程观察问题。

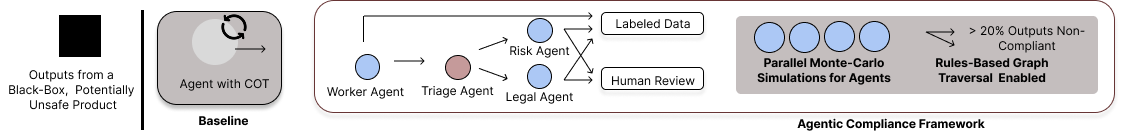

核心思路:提出的多代理系统通过有限时域马尔可夫决策过程(MDP)形式化,允许对每个代理的角色和决策阶段进行明确划分,从而提高系统的可观察性和协调性。

技术框架:整体架构包括多个代理,每个代理对应特定的决策阶段,系统通过预定义的转移来管理任务的升级和完成,使用蒙特卡洛方法量化不确定性。

关键创新:最重要的创新在于将多代理系统与MDP结合,能够在系统级别和代理级别同时捕捉不确定性,显著提升了决策过程的透明度和效率。

关键设计:在设计中,采用了蒙特卡洛估计来量化认知不确定性,并通过MDP的终止状态来捕捉系统级别的不确定性,确保了系统的高效性和准确性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的方法在准确性上提高了19%,人类审查需求减少了85倍,某些配置下处理时间也得到了显著缩短,显示出多代理系统在复杂工作流中的优势。

🎯 应用场景

该研究的潜在应用领域包括合规审查、法律评估和风险管理等多个受监管的工作流场景。通过提高决策过程的透明度和效率,该方法能够在实际应用中显著减少人力成本和时间消耗,具有重要的实际价值和未来影响。

📄 摘要(原文)

Large language model (LLM)-based agents are increasingly used to perform complex, multi-step workflows in regulated settings such as compliance and due diligence. However, many agentic architectures rely primarily on prompt engineering of a single agent, making it difficult to observe or compare how models handle uncertainty and coordination across interconnected decision stages and with human oversight. We introduce a multi-agent system formalized as a finite-horizon Markov Decision Process (MDP) with a directed acyclic structure. Each agent corresponds to a specific role or decision stage (e.g., content, business, or legal review in a compliance workflow), with predefined transitions representing task escalation or completion. Epistemic uncertainty is quantified at the agent level using Monte Carlo estimation, while system-level uncertainty is captured by the MDP's termination in either an automated labeled state or a human-review state. We illustrate the approach through a case study in AI safety evaluation for self-harm detection, implemented as a multi-agent compliance system. Results demonstrate improvements over a single-agent baseline, including up to a 19\% increase in accuracy, up to an 85x reduction in required human review, and, in some configurations, reduced processing time.