GRAB: An LLM-Inspired Sequence-First Click-Through Rate Prediction Modeling Paradigm

作者: Shaopeng Chen, Chuyue Xie, Huimin Ren, Shaozong Zhang, Han Zhang, Ruobing Cheng, Zhiqiang Cao, Zehao Ju, Gao Yu, Jie Ding, Xiaodong Chen, Xuewu Jiao, Shuanglong Li, Liu Lin

分类: cs.IR, cs.AI

发布日期: 2026-02-02

💡 一句话要点

GRAB:受LLM启发的序列优先点击率预测建模范式,提升广告收益和点击率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 点击率预测 推荐系统 长序列建模 生成式模型 注意力机制 因果推断 大型语言模型

📋 核心要点

- 传统DLRM模型在处理长序列用户行为数据时面临性能瓶颈和泛化能力不足的挑战。

- GRAB借鉴LLM的成功经验,提出一种端到端的生成式框架,用于点击率预测,提升模型性能。

- 在线实验表明,GRAB显著优于传统DLRM,在收入和点击率上均有提升,并展现出良好的扩展性。

📝 摘要(中文)

传统深度学习推荐模型(DLRMs)在性能和效率方面面临日益增长的瓶颈,常常难以泛化和处理长序列建模。受大型语言模型(LLMs)扩展成功的启发,我们提出了百度广告生成排序(GRAB),这是一种用于点击率(CTR)预测的端到端生成框架。GRAB集成了一种新颖的因果行为感知多通道注意力(CamA)机制,以有效地捕获用户行为序列中的时间动态和特定行为信号。全面的在线部署表明,GRAB显著优于已建立的DLRM,使收入增加了3.05%,点击率提高了3.49%。此外,该模型表现出令人满意的扩展行为:随着更长的交互序列被利用,其表达能力呈现单调且近似线性的改善。

🔬 方法详解

问题定义:论文旨在解决传统深度学习推荐模型(DLRMs)在点击率(CTR)预测任务中,处理长序列用户行为数据时遇到的性能瓶颈和泛化能力不足的问题。现有DLRMs在长序列建模方面表现不佳,难以有效捕捉用户行为序列中的时间动态和特定行为信号,导致推荐效果下降。

核心思路:论文的核心思路是借鉴大型语言模型(LLMs)的成功经验,将CTR预测任务视为一个序列生成问题。通过构建一个端到端的生成式框架,模型可以直接生成用户可能点击的广告,从而避免了传统DLRMs中复杂的特征工程和人工设计的交互模式。这种方法能够更好地捕捉用户行为序列中的上下文信息,并提高模型的泛化能力。

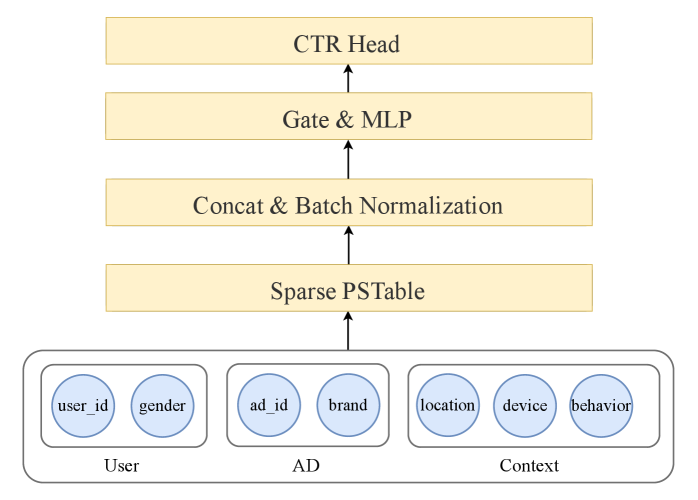

技术框架:GRAB的整体架构是一个端到端的生成式框架,主要包含以下几个模块:1) 输入层:接收用户行为序列和候选广告信息;2) CamA模块:利用因果行为感知多通道注意力机制,对用户行为序列进行编码,捕捉时间动态和特定行为信号;3) 生成层:基于编码后的用户行为序列和候选广告信息,生成用户可能点击的广告序列;4) 损失函数:采用交叉熵损失函数,优化模型参数,使得生成的广告序列与真实点击序列尽可能接近。

关键创新:论文最重要的技术创新点是提出了因果行为感知多通道注意力(CamA)机制。CamA机制能够有效地捕捉用户行为序列中的时间动态和特定行为信号。与传统的注意力机制不同,CamA机制考虑了用户行为之间的因果关系,并为不同的行为通道分配不同的权重,从而更好地捕捉用户行为的意图。

关键设计:CamA模块的关键设计包括:1) 因果掩码:用于屏蔽未来行为对当前行为的影响,保证模型的因果性;2) 多通道注意力:将用户行为序列划分为多个通道,例如点击、浏览、购买等,并为每个通道分配不同的注意力权重;3) 残差连接:用于缓解梯度消失问题,提高模型的训练效率。此外,论文还采用了Transformer结构作为生成层的基础架构,并对Transformer的参数进行了优化,以提高模型的生成能力。

🖼️ 关键图片

📊 实验亮点

GRAB模型在百度全流量在线部署中,相较于已有的DLRM模型,实现了3.05%的收入增长和3.49%的点击率提升。此外,实验结果表明,GRAB模型具有良好的扩展性,随着用户交互序列长度的增加,模型的表达能力呈现单调且近似线性的提升。

🎯 应用场景

GRAB模型可广泛应用于在线广告、推荐系统等领域,尤其适用于需要处理长序列用户行为数据的场景。通过提升点击率和广告收益,GRAB能够为互联网公司带来显著的商业价值。未来,该模型还可以扩展到其他序列生成任务,例如对话生成、文本摘要等。

📄 摘要(原文)

Traditional Deep Learning Recommendation Models (DLRMs) face increasing bottlenecks in performance and efficiency, often struggling with generalization and long-sequence modeling. Inspired by the scaling success of Large Language Models (LLMs), we propose Generative Ranking for Ads at Baidu (GRAB), an end-to-end generative framework for Click-Through Rate (CTR) prediction. GRAB integrates a novel Causal Action-aware Multi-channel Attention (CamA) mechanism to effectively capture temporal dynamics and specific action signals within user behavior sequences. Full-scale online deployment demonstrates that GRAB significantly outperforms established DLRMs, delivering a 3.05% increase in revenue and a 3.49% rise in CTR. Furthermore, the model demonstrates desirable scaling behavior: its expressive power shows a monotonic and approximately linear improvement as longer interaction sequences are utilized.