Beyond Dense States: Elevating Sparse Transcoders to Active Operators for Latent Reasoning

作者: Yadong Wang, Haodong Chen, Yu Tian, Chuanxing Geng, Dong Liang, Xiang Chen

分类: cs.AI, cs.LG

发布日期: 2026-02-02

💡 一句话要点

提出LSTR:提升稀疏转码器为主动算子,用于潜在空间推理

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 潜在空间推理 稀疏表示 转码器 可解释性 因果推理 思维链 语义特征

📋 核心要点

- 现有潜在空间推理方法依赖于密集潜在转换,缺乏可解释性和可控性,限制了其应用。

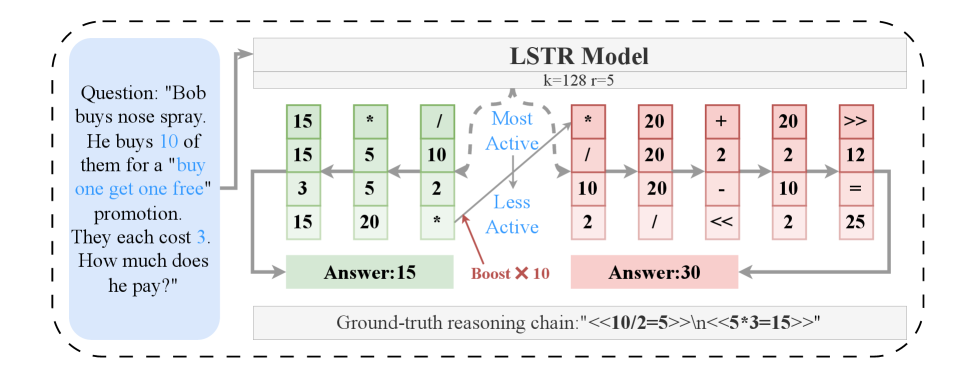

- LSTR框架将稀疏转码器提升为主动推理算子,通过稀疏语义转换执行多步计算,实现可控的语义分辨率。

- 实验表明,LSTR在保持推理性能的同时,显著提升了可解释性,并验证了稀疏特征的因果有效性。

📝 摘要(中文)

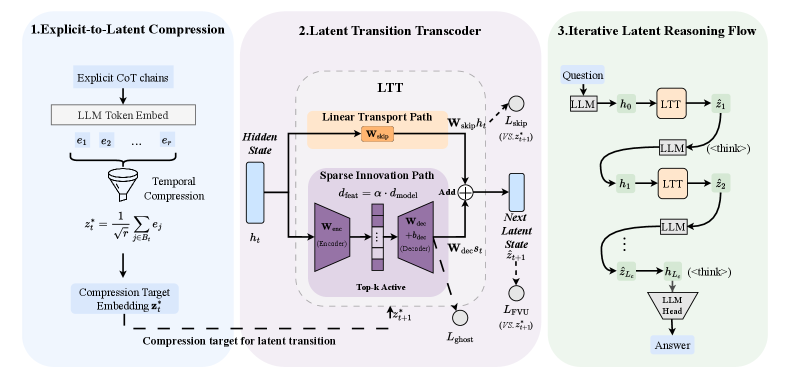

潜在空间推理将思维链(CoT)压缩到连续的隐藏状态中,但现有方法依赖于难以解释和控制的密集潜在转换。稀疏表示模型揭示了人类可解释的语义特征,但主要局限于后验分析。本文提出了LSTR(Latent Sparse Transcoder Reasoning),一个潜在推理框架,将功能性稀疏转码器提升为主动推理算子,通过稀疏语义转换执行多步计算。LSTR的核心是具有残差跳跃结构的潜在转换转码器(LTT),它将线性流形传输与稀疏语义更新解耦,通过显式稀疏约束实现可控的语义分辨率。大量实验表明,LSTR在保持推理精度和压缩效率的同时,显著提高了相对于密集潜在基线的可解释性。因果干预和轨迹分析进一步表明,这些稀疏特征在推理过程中充当可解释且因果有效的算子。

🔬 方法详解

问题定义:现有潜在空间推理方法,如基于思维链的压缩方法,虽然能够将推理过程压缩到连续的隐藏状态中,但其依赖的密集潜在转换难以解释和控制。这使得我们难以理解模型是如何进行推理的,也难以对推理过程进行干预和修正。此外,虽然稀疏表示模型能够提取人类可解释的语义特征,但它们主要用于后验分析,无法直接用于主动的推理过程。

核心思路:LSTR的核心思路是将稀疏转码器提升为主动推理算子。通过学习稀疏的语义表示,并利用这些稀疏表示进行多步计算,LSTR旨在实现可解释和可控的潜在空间推理。这种方法结合了密集潜在表示的压缩效率和稀疏表示的可解释性。

技术框架:LSTR框架主要包含一个潜在转换转码器(LTT)。LTT采用残差跳跃结构,将线性流形传输与稀疏语义更新解耦。具体来说,LTT首先通过线性变换将输入状态传输到下一个状态,然后通过稀疏编码器提取稀疏的语义特征,并利用这些特征更新状态。整个过程可以迭代多次,以执行多步推理。

关键创新:LSTR的关键创新在于将稀疏转码器提升为主动推理算子,并设计了具有残差跳跃结构的LTT。这种设计使得LSTR能够同时实现推理精度、压缩效率和可解释性。与现有方法相比,LSTR能够学习到更具语义意义的潜在表示,并利用这些表示进行可控的推理。

关键设计:LSTR的关键设计包括:1) 稀疏编码器的选择,需要选择能够有效提取稀疏特征的编码器,例如基于L1正则化的编码器;2) 稀疏约束的设置,需要设置合适的稀疏度,以平衡推理精度和可解释性;3) 残差跳跃连接的设计,残差连接有助于缓解梯度消失问题,并提高模型的训练效率;4) 损失函数的设计,需要设计合适的损失函数,以鼓励模型学习到具有语义意义的潜在表示。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LSTR在保持推理精度和压缩效率的同时,显著提高了可解释性。具体来说,LSTR在多个推理任务上取得了与密集潜在基线相当的性能,同时其稀疏的潜在表示更易于解释。因果干预实验表明,LSTR学习到的稀疏特征在推理过程中起着因果作用,这进一步验证了LSTR的可解释性。

🎯 应用场景

LSTR框架可应用于需要可解释性和可控性的潜在空间推理任务,例如智能问答、对话系统、决策支持等。通过理解和控制模型的推理过程,我们可以提高模型的可靠性和安全性,并更好地利用模型解决实际问题。此外,LSTR还可以用于发现新的知识和规律,例如通过分析稀疏的语义特征,我们可以了解模型是如何进行推理的,从而发现新的推理策略。

📄 摘要(原文)

Latent reasoning compresses the chain-of-thought (CoT) into continuous hidden states, yet existing methods rely on dense latent transitions that remain difficult to interpret and control. Meanwhile, sparse representation models uncover human-interpretable semantic features but remain largely confined to post-hoc analysis. We reconcile this tension by proposing LSTR (Latent Sparse Transcoder Reasoning), a latent reasoning framework that elevates functional sparse transcoders into active reasoning operators to perform multi-step computation through sparse semantic transitions. At its core, LSTR employs a Latent Transition Transcoder (LTT) with a residual skip architecture that decouples linear manifold transport from sparse semantic updates, enabling controllable semantic resolution via explicit sparsity constraints. Extensive experiments show that LSTR preserves reasoning accuracy and compression efficiency while substantially improving interpretability over dense latent baselines. Causal interventions and trajectory analyses further demonstrate that these sparse features act as both interpretable and causally effective operators in the reasoning process.