Make Anything Match Your Target: Universal Adversarial Perturbations against Closed-Source MLLMs via Multi-Crop Routed Meta Optimization

作者: Hui Lu, Yi Yu, Yiming Yang, Chenyu Yi, Xueyi Ke, Qixing Zhang, Bingquan Shen, Alex Kot, Xudong Jiang

分类: cs.AI

发布日期: 2026-01-30

💡 一句话要点

提出MCRMO-Attack,提升通用目标可迁移对抗攻击在闭源多模态大语言模型上的成功率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 对抗攻击 通用对抗扰动 可迁移性 黑盒攻击

📋 核心要点

- 现有针对闭源多模态大语言模型的目标对抗攻击方法缺乏跨输入的可重用性,通用性不足。

- MCRMO-Attack通过多裁剪聚合、Token路由和元学习扰动先验来解决通用目标可迁移对抗攻击中的监督不稳定、匹配不可靠和初始化敏感问题。

- 实验表明,MCRMO-Attack在GPT-4o和Gemini-2.0等商业MLLM上显著提升了未见图像的攻击成功率。

📝 摘要(中文)

本文研究了更严格的通用目标可迁移对抗攻击(UTTAA)设置,即单个扰动必须持续地将任意输入导向未知的商业多模态大语言模型(MLLM)中的特定目标。现有方法直接将样本相关的攻击适配到通用设置面临三个核心困难:目标监督因目标裁剪的随机性而具有高方差;token级别的匹配不可靠,因为通用性抑制了原本可以锚定对齐的图像特定线索;少样本的单目标适配对初始化高度敏感,这会降低可达到的性能。为此,我们提出了MCRMO-Attack,它通过多裁剪聚合与注意力引导裁剪来稳定监督,通过对齐性门控的Token路由来提高token级别的可靠性,并通过元学习一个跨目标的扰动先验来产生更强的单目标解决方案。在商业MLLM上,相比最强的通用基线,我们在GPT-4o上将未见图像的攻击成功率提高了+23.7%,在Gemini-2.0上提高了+19.9%。

🔬 方法详解

问题定义:论文旨在解决通用目标可迁移对抗攻击(UTTAA)问题,即生成一个通用的对抗扰动,能够使任意输入图像在不同的闭源多模态大语言模型(MLLM)中被错误分类为指定的目标。现有方法主要针对特定样本生成对抗样本,缺乏通用性和可迁移性,并且在应用于通用场景时,会面临目标监督高方差、token匹配不可靠和初始化敏感等问题。

核心思路:论文的核心思路是通过稳定监督、提高token级别可靠性和学习跨目标扰动先验来解决UTTAA问题。具体来说,通过多裁剪聚合来降低目标监督的方差,通过对齐性门控的Token路由来提高token匹配的可靠性,并通过元学习来获得一个更好的扰动初始化,从而提高攻击的成功率。

技术框架:MCRMO-Attack的整体框架包含三个主要模块:1) 多裁剪聚合与注意力引导裁剪:通过对输入图像进行多次裁剪,并利用注意力机制选择信息量最大的裁剪区域,从而稳定目标监督。2) 对齐性门控的Token路由:通过计算图像token和目标token之间的对齐程度,并根据对齐程度来选择重要的token进行路由,从而提高token匹配的可靠性。3) 元学习跨目标扰动先验:通过元学习的方式,学习一个跨目标的扰动先验,用于初始化对抗扰动,从而提高攻击的成功率。

关键创新:论文的关键创新在于提出了一个完整的框架来解决UTTAA问题,并针对该问题设计了三个关键模块:多裁剪聚合与注意力引导裁剪、对齐性门控的Token路由和元学习跨目标扰动先验。这些模块分别解决了目标监督高方差、token匹配不可靠和初始化敏感等问题,从而显著提高了攻击的成功率。与现有方法相比,MCRMO-Attack更关注通用性和可迁移性,并且能够更好地适应闭源MLLM的黑盒攻击场景。

关键设计:在多裁剪聚合中,使用了多个不同大小和位置的裁剪区域,并通过注意力机制来选择信息量最大的裁剪区域。在对齐性门控的Token路由中,使用了余弦相似度来计算图像token和目标token之间的对齐程度,并使用sigmoid函数来生成门控信号。在元学习跨目标扰动先验中,使用了多个不同的目标来训练元学习器,并使用Adam优化器来优化模型参数。

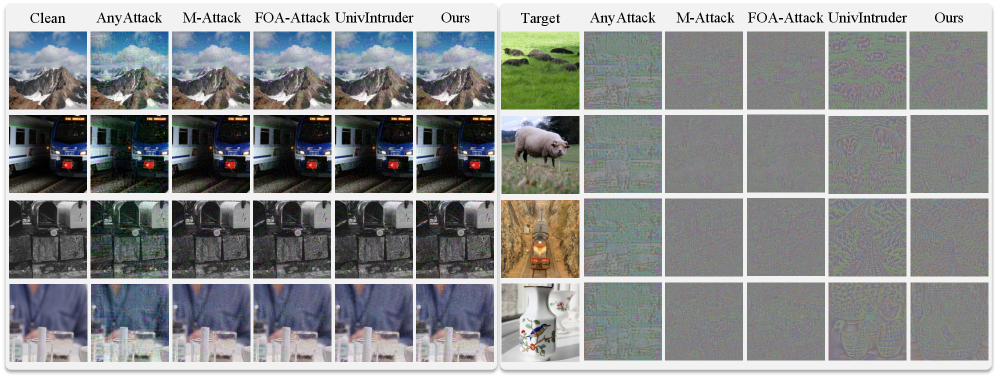

🖼️ 关键图片

📊 实验亮点

MCRMO-Attack在商业MLLM上取得了显著的性能提升。在GPT-4o上,未见图像的攻击成功率相比最强的通用基线提高了+23.7%。在Gemini-2.0上,攻击成功率提高了+19.9%。这些结果表明,MCRMO-Attack能够有效地生成通用的、可迁移的对抗扰动,并成功攻击闭源MLLM。

🎯 应用场景

该研究成果可应用于评估和提升多模态大语言模型的安全性,防御潜在的恶意攻击。通过理解和缓解通用对抗扰动的影响,可以提高MLLM在实际应用中的鲁棒性和可靠性,例如在图像识别、内容审核和智能对话等领域。

📄 摘要(原文)

Targeted adversarial attacks on closed-source multimodal large language models (MLLMs) have been increasingly explored under black-box transfer, yet prior methods are predominantly sample-specific and offer limited reusability across inputs. We instead study a more stringent setting, Universal Targeted Transferable Adversarial Attacks (UTTAA), where a single perturbation must consistently steer arbitrary inputs toward a specified target across unknown commercial MLLMs. Naively adapting existing sample-wise attacks to this universal setting faces three core difficulties: (i) target supervision becomes high-variance due to target-crop randomness, (ii) token-wise matching is unreliable because universality suppresses image-specific cues that would otherwise anchor alignment, and (iii) few-source per-target adaptation is highly initialization-sensitive, which can degrade the attainable performance. In this work, we propose MCRMO-Attack, which stabilizes supervision via Multi-Crop Aggregation with an Attention-Guided Crop, improves token-level reliability through alignability-gated Token Routing, and meta-learns a cross-target perturbation prior that yields stronger per-target solutions. Across commercial MLLMs, we boost unseen-image attack success rate by +23.7\% on GPT-4o and +19.9\% on Gemini-2.0 over the strongest universal baseline.