Test-Time Mixture of World Models for Embodied Agents in Dynamic Environments

作者: Jinwoo Jang, Minjong Yoo, Sihyung Yoon, Honguk Woo

分类: cs.AI

发布日期: 2026-01-30

备注: Accepted at ICLR 2026. 10 pages. Code available at https://github.com/doldam0/tmow

💡 一句话要点

提出测试时世界模型混合(TMoW)框架,提升具身智能体在动态环境中的适应性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 具身智能 世界模型 混合专家 动态环境 测试时适应 知识蒸馏 原型学习

📋 核心要点

- 现有基于语言模型的具身智能体在动态环境中适应性不足,难以构建准确灵活的世界模型。

- TMoW框架通过测试时更新世界模型的路由函数,使智能体能够重组现有模型并集成新模型,实现持续适应。

- 实验表明,TMoW在VirtualHome、ALFWorld和RLBench等基准测试中,零样本和少样本场景下均表现出强大的性能。

📝 摘要(中文)

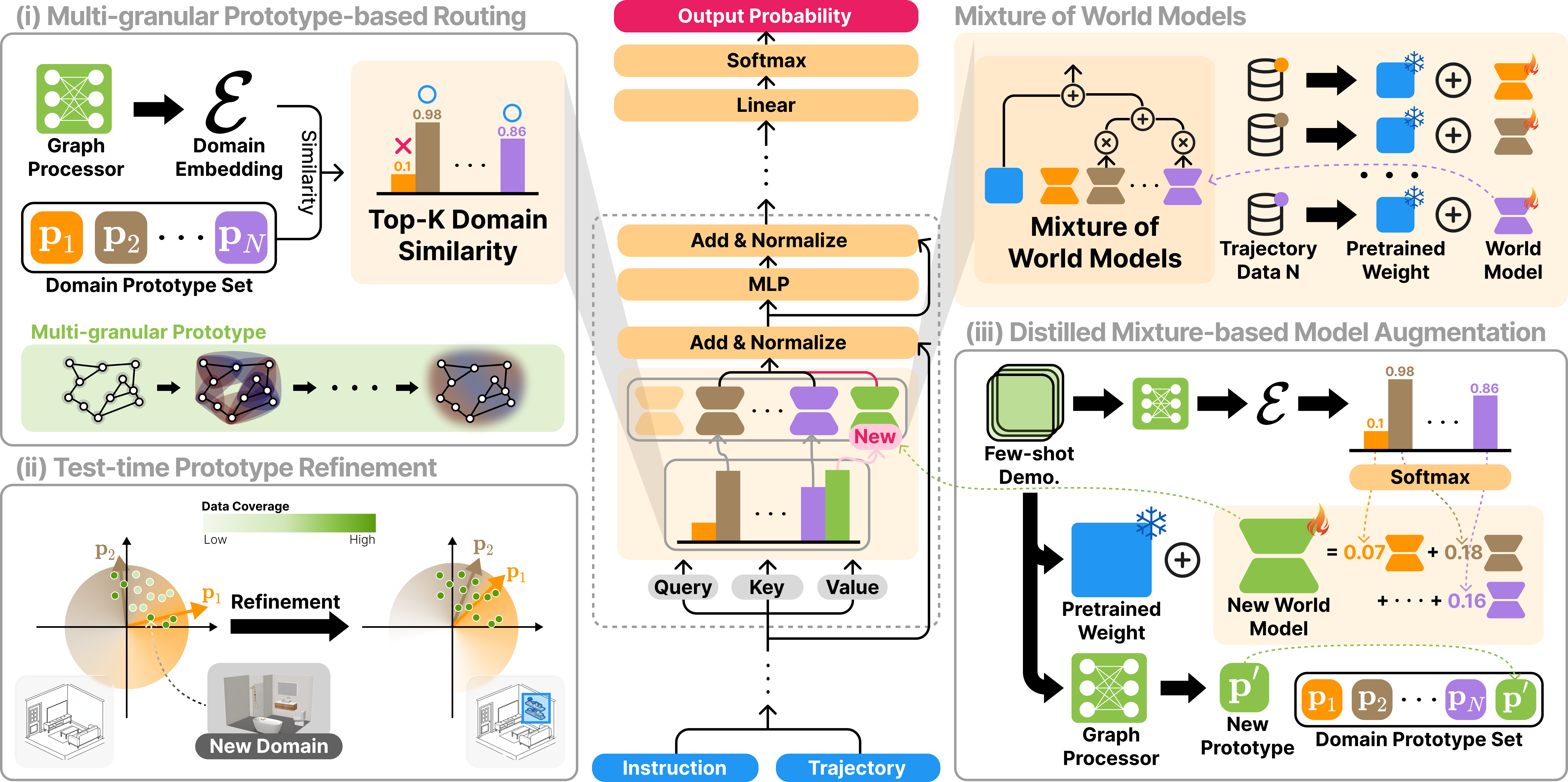

基于语言模型的具身智能体越来越多地部署在真实世界环境中。然而,它们在动态环境中的适应性仍然有限,在动态环境中,构建准确而灵活的世界模型对于有效的推理和决策至关重要。为了解决这个挑战,我们将混合专家(MoE)范式扩展到具身智能体。传统的MoE架构将知识模块化为具有预训练路由的专家组件,但一旦部署,它们仍然是刚性的,这使得它们在适应动态环境中未见过的领域时效果较差。因此,我们提出了测试时世界模型混合(TMoW),这是一个增强对未见和演化领域适应性的框架。与传统MoE中函数保持固定不同,TMoW在测试时更新其世界模型上的路由函数,使智能体能够重新组合现有模型并集成新模型以进行持续适应。它通过以下方式实现这一点:(i)多粒度原型路由,它适应对象到场景级别相似性之间的混合;(ii)测试时细化,在推理期间将未见领域特征与原型对齐;以及(iii)基于混合的蒸馏增强,它有效地从少量数据和现有原型构建新模型。我们在VirtualHome、ALFWorld和RLBench基准上评估了TMoW,证明了其在零样本适应和少样本扩展场景中的强大性能,并表明它使具身智能体能够在动态环境中有效运行。

🔬 方法详解

问题定义:现有基于语言模型的具身智能体在动态环境中面临适应性挑战。传统的混合专家模型(MoE)在部署后路由函数固定,无法有效适应未见过的领域或环境变化。这限制了智能体在真实世界动态环境中的应用。

核心思路:TMoW的核心思路是在测试时动态调整世界模型的混合方式,使其能够根据当前环境的特征自适应地选择和组合不同的世界模型。通过这种方式,智能体可以更好地理解和应对环境变化,提高决策的准确性和效率。

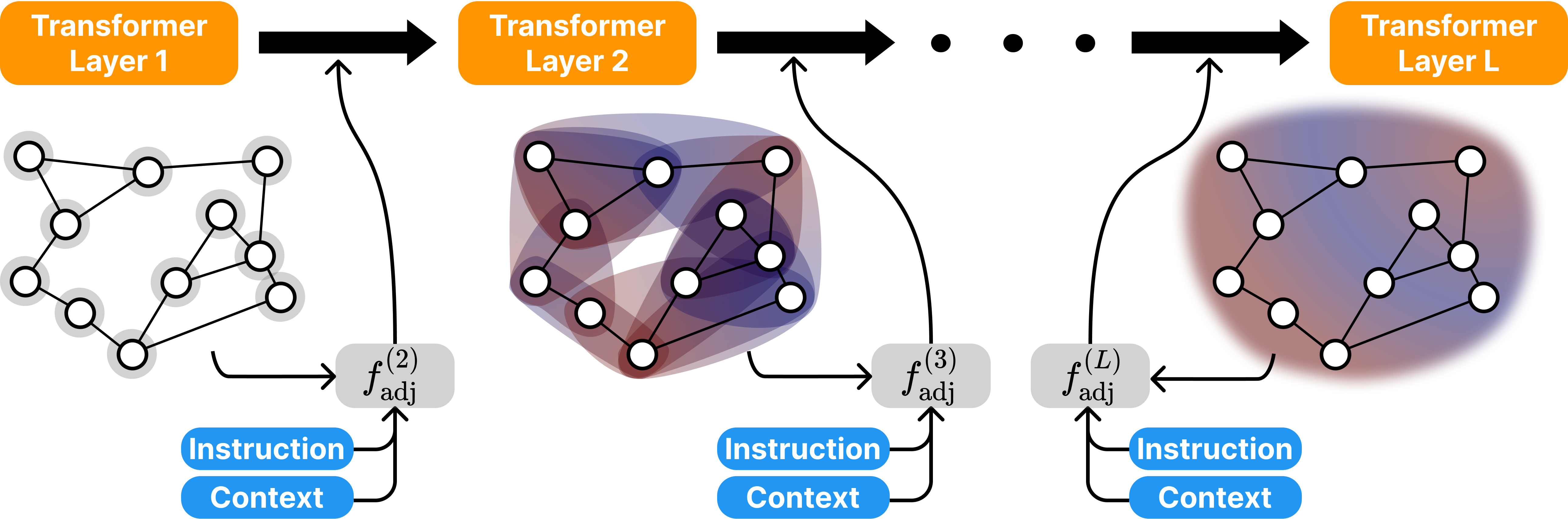

技术框架:TMoW框架主要包含三个核心模块:多粒度原型路由、测试时细化和基于混合的蒸馏增强。多粒度原型路由根据对象到场景级别的相似性自适应地混合世界模型。测试时细化模块将未见领域的特征与原型对齐,从而提高泛化能力。基于混合的蒸馏增强模块利用少量样本和现有原型高效地构建新的世界模型。

关键创新:TMoW的关键创新在于其测试时动态调整世界模型混合方式的能力。与传统的MoE方法不同,TMoW的路由函数不是固定的,而是在测试时根据环境特征进行更新。这使得智能体能够更好地适应未见过的环境,并利用少量样本快速学习新的世界模型。

关键设计:多粒度原型路由使用多层级的原型表示,从对象级别到场景级别捕捉环境的特征。测试时细化采用对比学习的方式,将未见领域的特征与原型对齐。基于混合的蒸馏增强使用知识蒸馏技术,将多个现有世界模型的知识迁移到新的世界模型中,从而提高学习效率。

🖼️ 关键图片

📊 实验亮点

TMoW在VirtualHome、ALFWorld和RLBench等基准测试中表现出色。在零样本适应场景中,TMoW显著优于现有方法。在少样本扩展场景中,TMoW能够利用少量样本快速学习新的世界模型,并取得与使用大量样本训练的模型相媲美的性能。实验结果表明,TMoW能够有效提升具身智能体在动态环境中的适应性。

🎯 应用场景

TMoW框架具有广泛的应用前景,可用于提升机器人、自动驾驶汽车等智能体在复杂动态环境中的适应性和鲁棒性。例如,在家庭服务机器人中,TMoW可以帮助机器人更好地理解和应对家庭环境的变化,从而提供更智能、更可靠的服务。在自动驾驶领域,TMoW可以提高自动驾驶系统在复杂交通场景中的决策能力,从而提高安全性。

📄 摘要(原文)

Language model (LM)-based embodied agents are increasingly deployed in real-world settings. Yet, their adaptability remains limited in dynamic environments, where constructing accurate and flexible world models is crucial for effective reasoning and decision-making. To address this challenge, we extend the Mixture-of-Experts (MoE) paradigm to embodied agents. While conventional MoE architectures modularize knowledge into expert components with pre-trained routing, they remain rigid once deployed, making them less effective for adapting to unseen domains in dynamic environments. We therefore propose Test-time Mixture of World Models (TMoW), a framework that enhances adaptability to unseen and evolving domains. TMoW updates its routing function over world models at test time, unlike conventional MoE where the function remains fixed, enabling agents to recombine existing models and integrate new ones for continual adaptation. It achieves this through (i) multi-granular prototype-based routing, which adapts mixtures across object- to scene-level similarities, (ii) test-time refinement that aligns unseen domain features with prototypes during inference, and (iii) distilled mixture-based augmentation, which efficiently constructs new models from few-shot data and existing prototypes. We evaluate TMoW on VirtualHome, ALFWorld, and RLBench benchmarks, demonstrating strong performance in both zero-shot adaptation and few-shot expansion scenarios, and showing that it enables embodied agents to operate effectively in dynamic environments.