The Patient is not a Moving Document: A World Model Training Paradigm for Longitudinal EHR

作者: Irsyad Adam, Zekai Chen, David Laprade, Shaun Porwal, David Laub, Erik Reinertsen, Arda Pekis, Kevin Brown

分类: cs.AI, cs.CE, q-bio.QM

发布日期: 2026-01-29

🔗 代码/项目: HUGGINGFACE

💡 一句话要点

提出SMB-Structure,用于模拟纵向电子病历中的患者动态,提升疾病轨迹预测能力。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 电子病历 世界模型 疾病轨迹预测 联合嵌入预测 临床自然语言处理

📋 核心要点

- 现有临床基础模型将患者视为文档进行总结,忽略了患者状态随时间和干预动态演变的特性。

- SMB-Structure通过联合嵌入预测架构(JEPA)和下一词预测(SFT)相结合,模拟患者状态的动态演变。

- 在两个大型队列上的实验表明,该模型能更好地捕捉疾病动态,并在复杂任务上取得优异性能。

📝 摘要(中文)

本文提出了一种针对结构化电子病历(EHR)的世界模型训练范式,称为SMB-Structure。该模型结合了联合嵌入预测架构(JEPA)和下一词预测(SFT)。SFT用于在token空间中重构未来的患者状态,而JEPA则仅从初始患者表征在潜在空间中预测这些未来状态,从而迫使模型在观察到下一个状态之前编码轨迹动态。在Memorial Sloan Kettering(肿瘤患者)和INSPECT(肺栓塞患者)两个大规模队列上的实验表明,SMB-Structure学习到的嵌入能够捕捉自回归基线无法恢复的疾病动态,从而在以高患者异质性为特征的复杂任务上实现有竞争力的性能。模型权重已公开。

🔬 方法详解

问题定义:现有的大型语言模型(LLMs)在临床领域取得了成功,但它们通常将患者视为静态文档进行处理,忽略了患者状态随时间推移的动态变化。这种方法无法很好地模拟患者的疾病轨迹,限制了其在复杂临床任务中的应用。现有方法缺乏对患者状态演变过程的建模能力,难以捕捉疾病的动态特征。

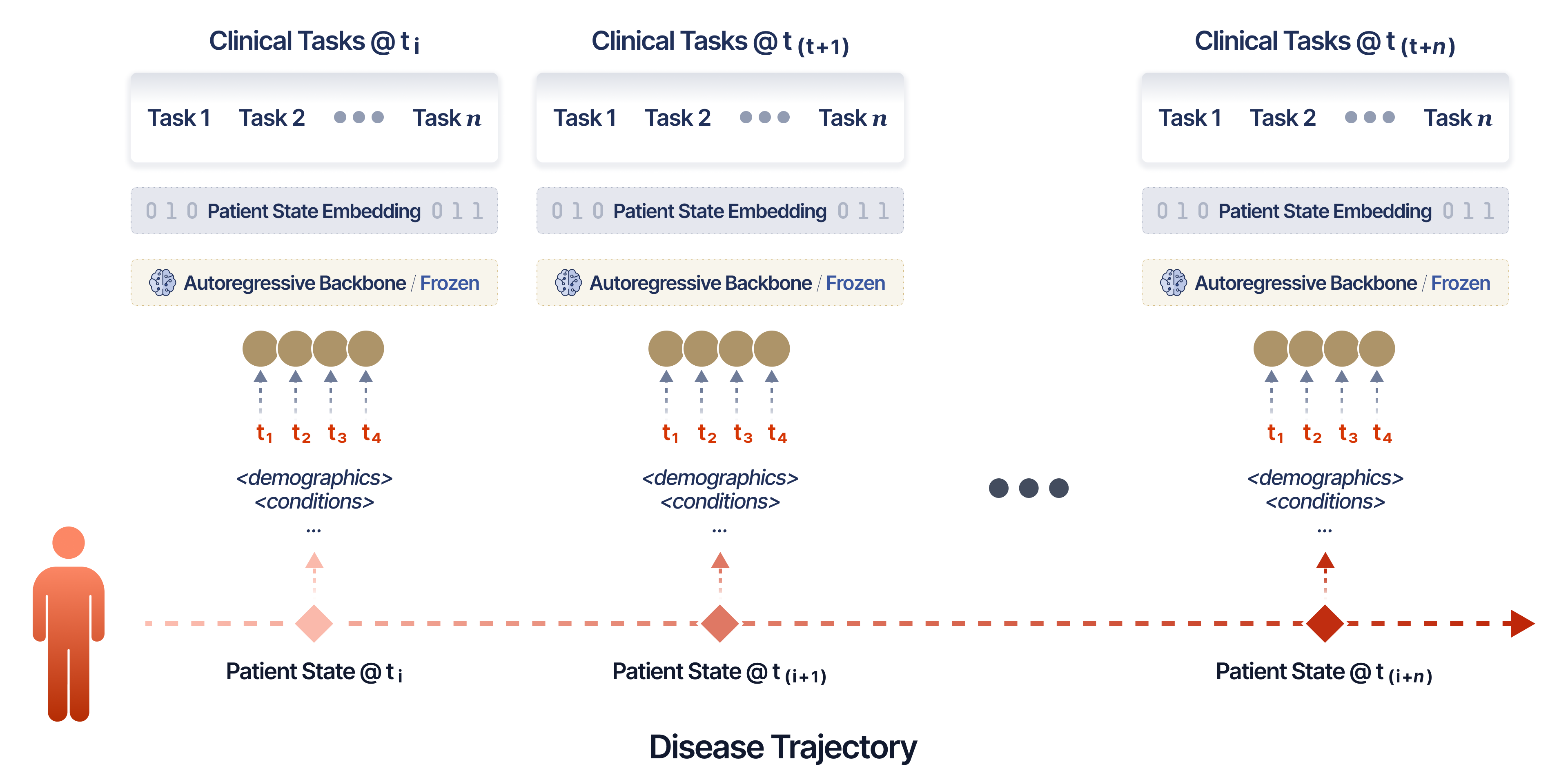

核心思路:本文的核心思路是将患者视为一个动态系统,通过构建世界模型来模拟患者状态的演变过程。该模型通过联合嵌入预测架构(JEPA)和下一词预测(SFT)相结合,迫使模型学习患者状态的动态变化规律,从而更好地预测未来的患者状态。这种方法强调对患者轨迹动态的编码,而不是简单地预测下一个token。

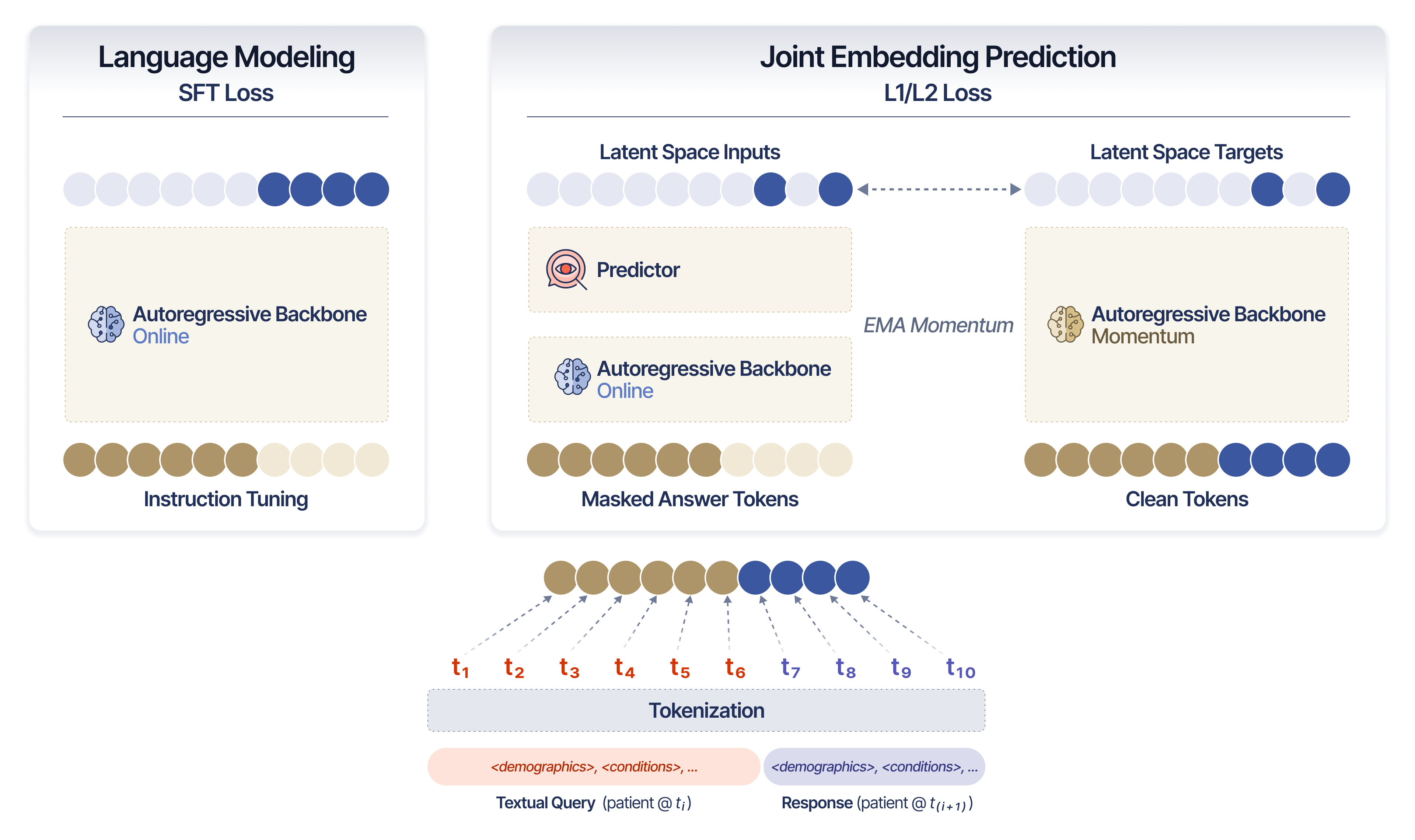

技术框架:SMB-Structure的整体架构包含两个主要模块:SFT模块和JEPA模块。SFT模块通过下一词预测任务,在token空间中重构未来的患者状态,从而将模型与实际的患者数据对齐。JEPA模块则仅从初始患者表征在潜在空间中预测这些未来状态,从而迫使模型学习患者状态的动态变化规律。这两个模块共同作用,使得模型能够更好地捕捉患者的疾病轨迹。

关键创新:该论文的关键创新在于提出了一个针对结构化电子病历的世界模型训练范式,该范式能够模拟患者状态的动态演变过程。与传统的自回归模型相比,SMB-Structure能够更好地捕捉疾病的动态特征,从而在复杂临床任务中取得更好的性能。该方法通过联合嵌入预测架构(JEPA)和下一词预测(SFT)相结合,实现了对患者状态动态的有效建模。

关键设计:在具体实现上,SFT模块采用标准的Transformer架构,通过最小化交叉熵损失函数来优化模型参数。JEPA模块则采用对比学习的方式,通过最大化初始患者表征和未来患者状态表征之间的相似度来优化模型参数。此外,论文还采用了多种数据增强技术,以提高模型的泛化能力。具体的参数设置和网络结构细节可以在论文的附录中找到。

🖼️ 关键图片

📊 实验亮点

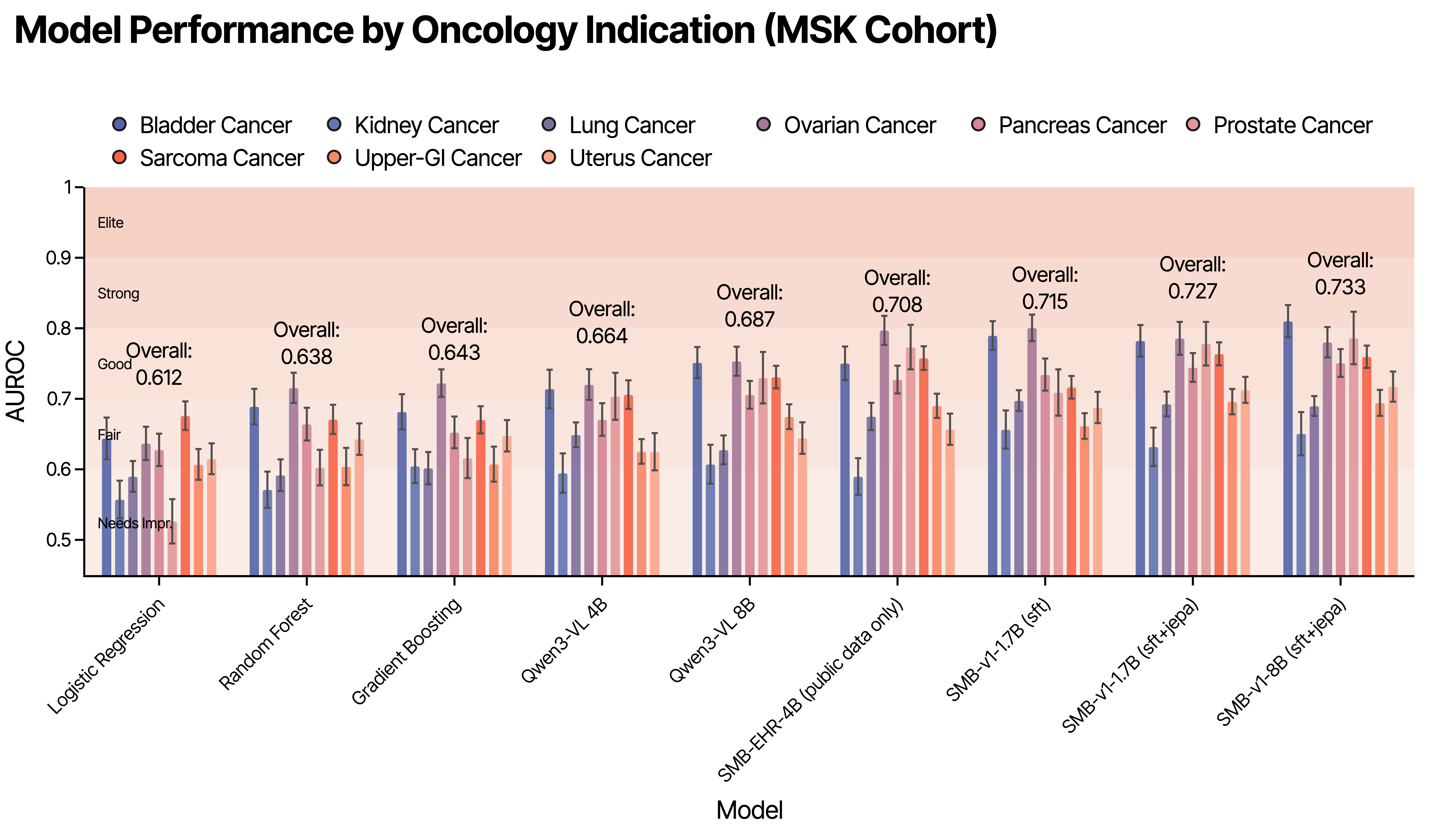

在Memorial Sloan Kettering(肿瘤患者)和INSPECT(肺栓塞患者)两个大规模队列上的实验表明,SMB-Structure学习到的嵌入能够捕捉自回归基线无法恢复的疾病动态。通过在线性探测评估中,SMB-Structure在疾病轨迹的多个时间点上都表现出优于自回归基线的性能,尤其是在患者异质性较高的复杂任务中,证明了其有效性。

🎯 应用场景

该研究成果可应用于多种临床场景,例如疾病风险预测、个性化治疗方案制定、患者预后评估等。通过模拟患者状态的动态演变过程,该模型能够为临床决策提供更准确、更全面的信息,从而改善患者的治疗效果。未来,该模型还可以与其他临床数据源(例如影像数据、基因组数据)相结合,构建更强大的临床决策支持系统。

📄 摘要(原文)

Large language models (LLMs) trained with next-word-prediction have achieved success as clinical foundation models. Representations from these language backbones yield strong linear probe performance across biomedical tasks, suggesting that patient semantics emerge from next-token prediction at scale. However, this paradigm treats patients as a document to be summarized rather than a dynamical system to be simulated; a patient's trajectory emerges from their state evolving under interventions and time, requiring models that simulate dynamics rather than predict tokens. To address this, we introduce SMB-Structure, a world model for structured EHR that grounds a joint-embedding prediction architecture (JEPA) with next-token prediction (SFT). SFT grounds our model to reconstruct future patient states in token space, while JEPA predicts those futures in latent space from the initial patient representation alone, forcing trajectory dynamics to be encoded before the next state is observed. We validate across two large-scale cohorts: Memorial Sloan Kettering (23,319 oncology patients; 323,000+ patient-years) and INSPECT (19,402 pulmonary embolism patients). Using a linear probe evaluated at multiple points along the disease trajectory, we demonstrate that our training paradigm learns embeddings that capture disease dynamics not recoverable by autoregressive baselines, enabling SMB-Structure to achieve competitive performance on complex tasks characterized by high patient heterogeneity. Model weights are available at https://huggingface.co/standardmodelbio/SMB-v1-1.7B-Structure.