WebArbiter: A Principle-Guided Reasoning Process Reward Model for Web Agents

作者: Yao Zhang, Shijie Tang, Zeyu Li, Zhen Han, Volker Tresp

分类: cs.AI

发布日期: 2026-01-29

备注: ICLR 2026

💡 一句话要点

WebArbiter:一种面向Web Agent的基于原则推理的过程奖励模型

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: Web Agent 过程奖励模型 推理建模 文本生成 强化学习 Web导航 原则引导

📋 核心要点

- 现有Web Agent过程奖励模型存在不足,如标量模型信号粗糙,检查表模型易受布局语义变化影响。

- WebArbiter将奖励建模视为文本生成,生成结构化理由和偏好判断,以实现更强的泛化能力。

- WebArbiter在WebPRMBench和WebArena-Lite上显著优于现有模型,验证了其鲁棒性和实用价值。

📝 摘要(中文)

Web Agent在自动化复杂计算机任务方面具有巨大潜力,但其交互涉及长程、序列决策和不可逆操作。在这种情况下,基于结果的监督是稀疏和延迟的,通常奖励不正确的轨迹,并且无法支持推理时扩展。这促使人们使用过程奖励模型(WebPRM)进行Web导航,但现有方法仍然有限:标量WebPRM将进度简化为粗略、弱接地的信号,而基于检查表的WebPRM依赖于脆弱的模板匹配,在布局或语义更改时会失效,并且经常将表面上正确的操作错误地标记为成功,几乎没有提供洞察力和可解释性。为了解决这些挑战,我们引入了WebArbiter,一种推理优先、原则诱导的WebPRM,它将奖励建模公式化为文本生成,产生结构化的理由,最终得出偏好判断,并确定在当前上下文中最有利于任务完成的操作。训练遵循两阶段流程:推理提炼使模型具备连贯的、原则指导的推理能力,强化学习通过直接将判断与正确性对齐来纠正教师偏差,从而实现更强的泛化能力。为了支持系统评估,我们发布了WebPRMBench,这是一个全面的基准,涵盖四个不同的Web环境,具有丰富的任务和高质量的偏好注释。在WebPRMBench上,WebArbiter-7B优于最强的基线GPT-5,提升了9.1个点。在WebArena-Lite上,在奖励引导的轨迹搜索中,它超过了最佳的先前WebPRM,提升高达7.2个点,突显了其在现实世界复杂Web任务中的鲁棒性和实际价值。

🔬 方法详解

问题定义:现有Web Agent的训练依赖于稀疏且延迟的奖励信号,导致模型难以学习正确的行为。现有的过程奖励模型(WebPRM)要么过于简化(标量WebPRM),要么过于依赖模板匹配(检查表WebPRM),无法很好地泛化到新的Web环境和任务。这些方法缺乏可解释性,难以调试和改进。

核心思路:WebArbiter的核心思路是将奖励建模转化为一个推理过程,模型需要生成一段文本,解释为什么某个动作比其他动作更好。这个推理过程基于预定义的原则,例如“点击链接应该导向更接近目标的页面”。通过显式地建模推理过程,WebArbiter可以更好地理解Web环境和任务,从而做出更明智的决策。

技术框架:WebArbiter的训练分为两个阶段:推理提炼和强化学习。在推理提炼阶段,模型学习生成符合预定义原则的推理过程。使用大量数据训练模型,使其能够根据当前上下文生成合理的理由,并给出偏好判断。在强化学习阶段,模型通过与环境交互,学习纠正推理提炼阶段产生的偏差,并优化最终的奖励信号。整体架构包含一个文本生成模型,输入是当前Web页面的状态和可能的动作,输出是推理过程和偏好判断。

关键创新:WebArbiter的关键创新在于将奖励建模转化为一个推理过程,并使用预定义的原则来指导推理。这使得模型能够更好地理解Web环境和任务,从而做出更明智的决策。与现有方法相比,WebArbiter具有更强的泛化能力和可解释性。此外,两阶段训练流程也保证了模型既能进行合理的推理,又能与真实环境对齐。

关键设计:WebArbiter使用一个大型语言模型(LLM)作为文本生成器。推理提炼阶段使用交叉熵损失函数来训练模型生成正确的推理过程和偏好判断。强化学习阶段使用策略梯度方法来优化模型的策略,目标是最大化累积奖励。具体参数设置包括LLM的大小(例如7B参数),训练数据集的大小,以及强化学习算法的学习率等。WebPRMBench基准的构建也为模型评估提供了高质量的数据。

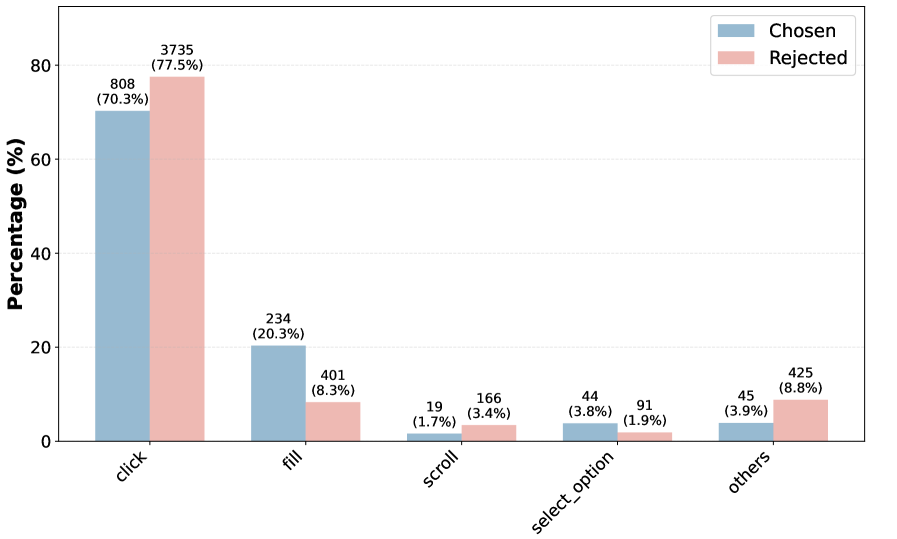

🖼️ 关键图片

📊 实验亮点

WebArbiter-7B在WebPRMBench上优于最强基线GPT-5,提升了9.1个点。在WebArena-Lite上,WebArbiter在奖励引导的轨迹搜索中超过了最佳的先前WebPRM,提升高达7.2个点。这些结果表明WebArbiter在复杂Web任务中具有显著的性能优势。

🎯 应用场景

WebArbiter可应用于各种Web Agent任务,例如自动化数据抓取、在线购物、信息搜索等。它可以提高Web Agent的效率和准确性,降低人工干预的需求。未来,WebArbiter可以扩展到其他类型的Agent任务,例如机器人控制和对话系统,从而实现更智能、更自主的Agent。

📄 摘要(原文)

Web agents hold great potential for automating complex computer tasks, yet their interactions involve long-horizon, sequential decision-making with irreversible actions. In such settings, outcome-based supervision is sparse and delayed, often rewarding incorrect trajectories and failing to support inference-time scaling. This motivates the use of Process Reward Models (WebPRMs) for web navigation, but existing approaches remain limited: scalar WebPRMs collapse progress into coarse, weakly grounded signals, while checklist-based WebPRMs rely on brittle template matching that fails under layout or semantic changes and often mislabels superficially correct actions as successful, providing little insight or interpretability. To address these challenges, we introduce WebArbiter, a reasoning-first, principle-inducing WebPRM that formulates reward modeling as text generation, producing structured justifications that conclude with a preference verdict and identify the action most conducive to task completion under the current context. Training follows a two-stage pipeline: reasoning distillation equips the model with coherent principle-guided reasoning, and reinforcement learning corrects teacher biases by directly aligning verdicts with correctness, enabling stronger generalization. To support systematic evaluation, we release WebPRMBench, a comprehensive benchmark spanning four diverse web environments with rich tasks and high-quality preference annotations. On WebPRMBench, WebArbiter-7B outperforms the strongest baseline, GPT-5, by 9.1 points. In reward-guided trajectory search on WebArena-Lite, it surpasses the best prior WebPRM by up to 7.2 points, underscoring its robustness and practical value in real-world complex web tasks.