Chain Of Thought Compression: A Theoritical Analysis

作者: Juncai Li, Ru Li, Yuxiang Zhou, Boxiang Ma, Jeff Z. Pan

分类: cs.AI

发布日期: 2026-01-29

💡 一句话要点

提出ALiCoT框架,通过对齐隐式推理状态,提升大语言模型推理效率并保持性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Chain-of-Thought 大语言模型 推理压缩 隐式推理 逻辑推理 知识表示 模型对齐

📋 核心要点

- 现有CoT推理计算成本高昂,隐式CoT压缩方法的内在机制尚不明确,阻碍了进一步优化。

- 论文提出ALiCoT框架,通过对齐潜在token分布与中间推理状态,克服了隐式推理中的信号衰减问题。

- 实验表明,ALiCoT在保持与显式CoT相当性能的同时,实现了54.4倍的推理加速,显著提升效率。

📝 摘要(中文)

Chain-of-Thought (CoT) 通过中间步骤解锁了大语言模型 (LLM) 的高级推理能力,但由于生成额外的 token 而导致计算成本过高。最近的研究表明,将推理步骤压缩为潜在状态,即隐式 CoT 压缩,提供了一种 token 效率高的替代方案。然而,CoT 压缩背后的机制仍不清楚。在本文中,我们首次对学习内化中间推理步骤的难度进行了理论分析。通过引入 Order-r Interaction,我们证明了高阶逻辑依赖的学习信号呈指数衰减,难以解决不可约问题,其中跳过中间步骤不可避免地导致高阶交互障碍。为了通过实验验证这一点,我们引入了 NatBool-DAG,这是一个具有挑战性的基准,旨在强制执行不可约逻辑推理并消除语义捷径。在我们的理论发现的指导下,我们提出了一种新颖的框架 ALiCoT (Aligned Implicit CoT),该框架通过将潜在 token 分布与中间推理状态对齐来克服信号衰减。实验结果表明,ALiCoT 成功地解锁了高效推理:它实现了 54.4 倍的加速,同时保持了与显式 CoT 相当的性能。

🔬 方法详解

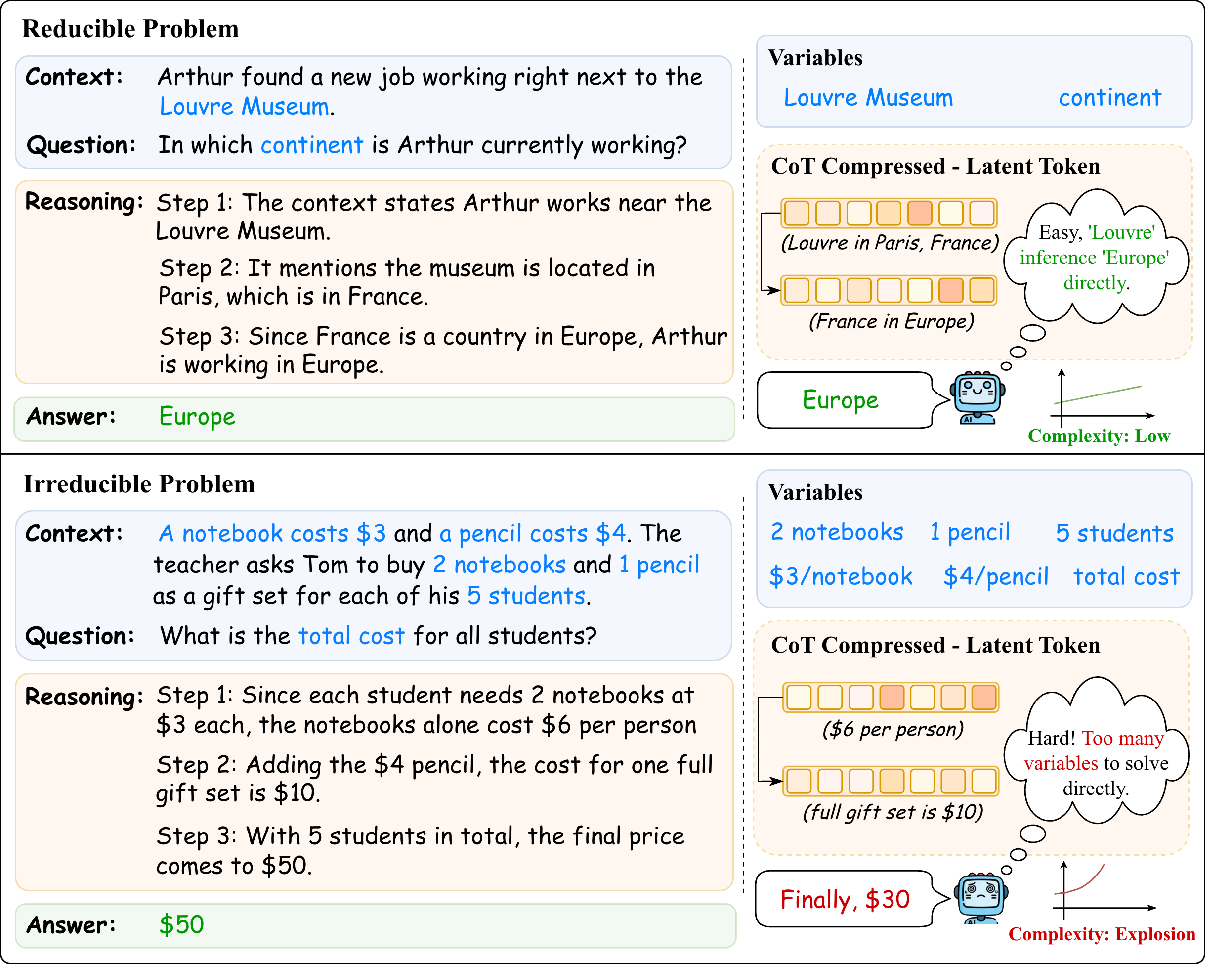

问题定义:论文旨在解决大语言模型中Chain-of-Thought (CoT) 推理计算成本高的问题。现有的显式CoT方法虽然提升了推理能力,但由于需要生成大量的中间步骤token,导致计算开销巨大。隐式CoT压缩方法虽然可以减少token数量,但其内在机制尚不明确,导致性能不稳定,且缺乏理论指导。

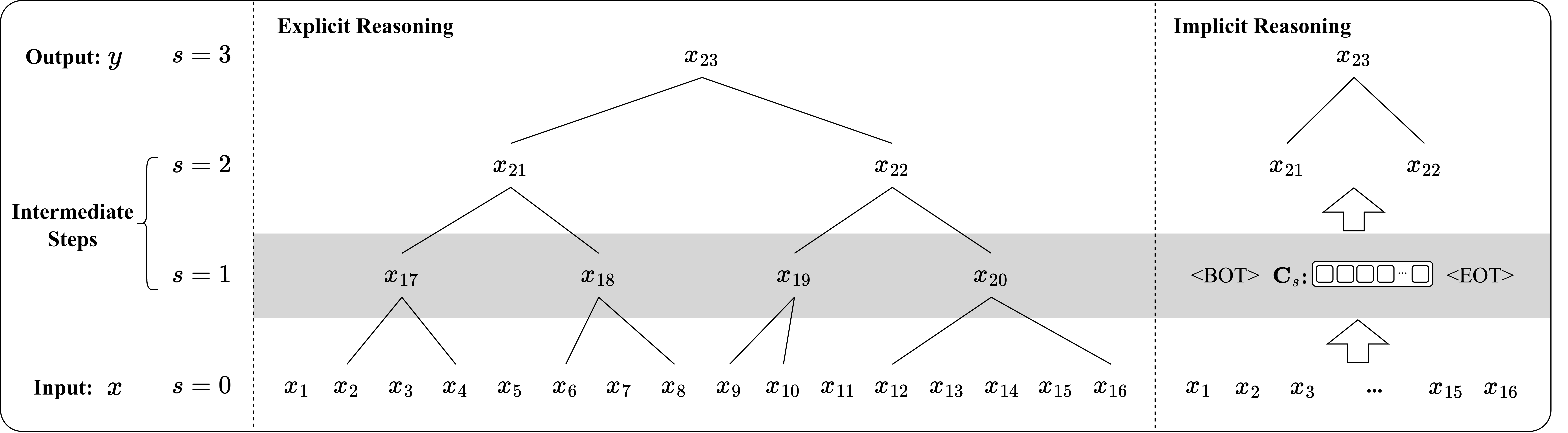

核心思路:论文的核心思路是通过理论分析揭示隐式CoT压缩的难点在于高阶逻辑依赖的学习信号衰减。为了克服这一问题,论文提出ALiCoT框架,其核心思想是将潜在token分布与中间推理状态对齐,从而增强模型对高阶逻辑关系的建模能力,避免信号衰减。

技术框架:ALiCoT框架主要包含以下几个阶段:首先,使用显式CoT生成中间推理步骤;然后,将这些中间步骤作为监督信号,训练模型学习将输入映射到与中间推理状态对齐的潜在token分布;最后,使用学习到的模型进行推理,直接从输入生成最终答案,无需显式生成中间步骤。整体架构旨在利用显式CoT的优势,同时避免其高计算成本。

关键创新:论文最重要的技术创新点在于提出了ALiCoT框架,该框架通过对齐潜在token分布与中间推理状态,克服了隐式CoT压缩中的信号衰减问题。与现有方法相比,ALiCoT不仅能够减少token数量,还能保持甚至提升推理性能,同时具有更强的理论支撑。

关键设计:ALiCoT的关键设计包括:1) 使用KL散度等损失函数来衡量潜在token分布与中间推理状态之间的对齐程度;2) 设计特定的网络结构,例如使用Transformer模型来学习输入到潜在token分布的映射;3) 引入NatBool-DAG基准测试,用于评估模型在不可约逻辑推理任务上的性能。此外,论文还对模型的训练策略和超参数进行了优化,以获得最佳性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ALiCoT在NatBool-DAG基准测试上取得了显著的性能提升,并在保持与显式CoT相当性能的同时,实现了54.4倍的推理加速。这表明ALiCoT能够有效地克服隐式CoT压缩中的信号衰减问题,并显著提升推理效率。

🎯 应用场景

该研究成果可应用于各种需要复杂推理的场景,例如智能问答、知识图谱推理、代码生成等。通过降低推理计算成本,可以使大语言模型在资源受限的环境中部署,并加速其在实际应用中的普及。此外,该研究也为未来研究隐式推理机制提供了理论基础。

📄 摘要(原文)

Chain-of-Thought (CoT) has unlocked advanced reasoning abilities of Large Language Models (LLMs) with intermediate steps, yet incurs prohibitive computational costs due to generation of extra tokens. Recent studies empirically show that compressing reasoning steps into latent states, or implicit CoT compression, offers a token-efficient alternative. However, the mechanism behind CoT compression remains unclear. In this paper, we provide the first theoretical analysis of the difficulty of learning to internalize intermediate reasoning steps. By introducing Order-r Interaction, we prove that the learning signal for high-order logical dependencies exponentially decays to solve irreducible problem, where skipping intermediate steps inevitably leads to high-order interaction barriers. To empirically validate this, we introduce NatBool-DAG, a challenging benchmark designed to enforce irreducible logical reasoning and eliminate semantic shortcuts. Guided by our theoretical findings, we propose ALiCoT (Aligned Implicit CoT), a novel framework that overcomes the signal decay by aligning latent token distributions with intermediate reasoning states. Experimental results demonstrate that ALiCoT successfully unlocks efficient reasoning: it achieves a 54.4x speedup while maintaining performance comparable to explicit CoT.