LLaMEA-SAGE: Guiding Automated Algorithm Design with Structural Feedback from Explainable AI

作者: Niki van Stein, Anna V. Kononova, Lars Kotthoff, Thomas Bäck

分类: cs.AI, cs.NE, cs.SE

发布日期: 2026-01-29

备注: 14 pages

💡 一句话要点

LLaMEA-SAGE:利用可解释AI的结构化反馈指导自动算法设计

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动算法设计 大型语言模型 可解释AI 结构化反馈 算法演化

📋 核心要点

- 现有自动算法设计方法主要依赖适应度反馈,忽略了生成代码的结构信息,导致效率低下。

- LLaMEA-SAGE利用可解释AI提取代码结构特征,并将其转化为自然语言指令,指导LLM生成更优算法。

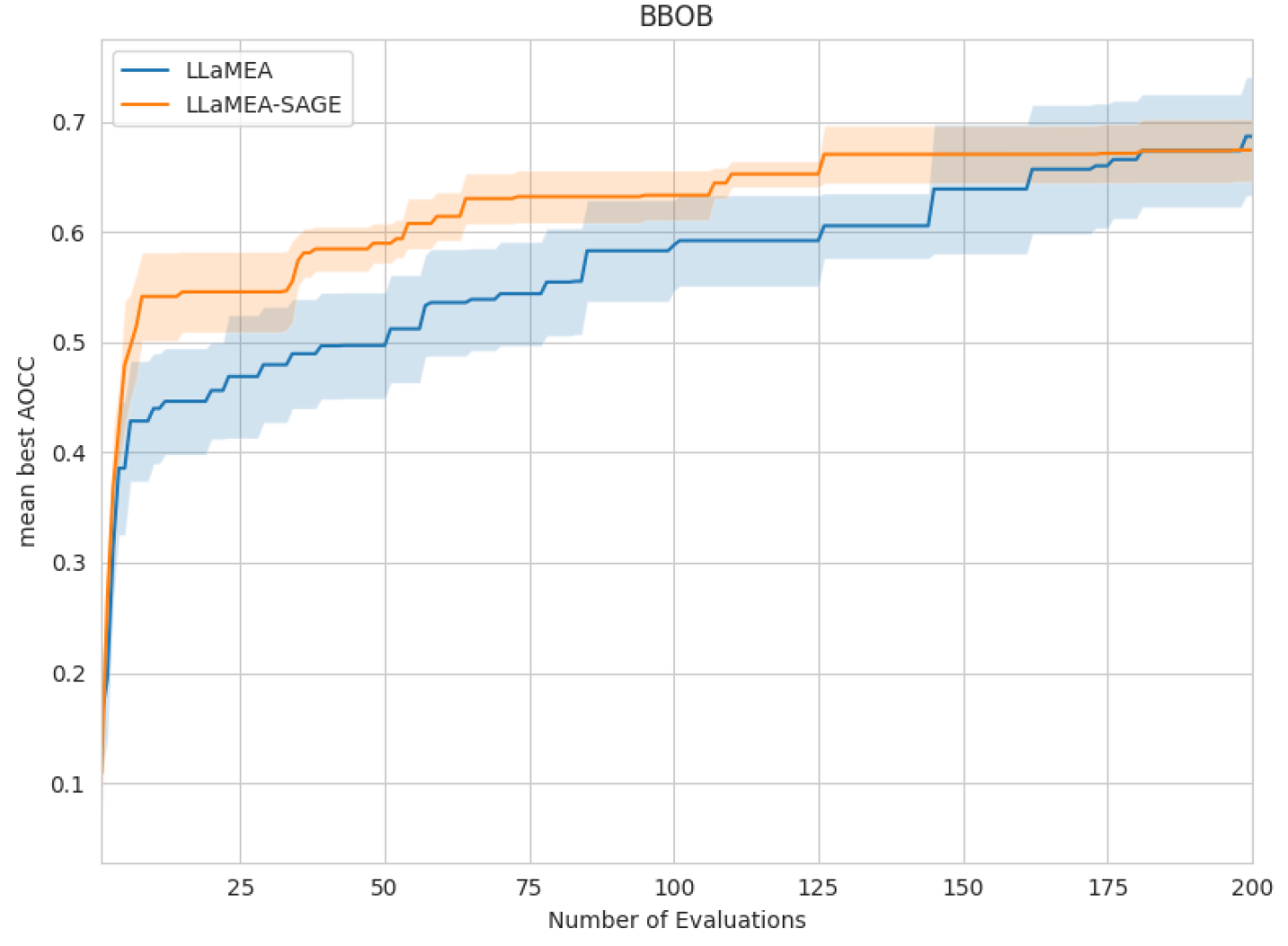

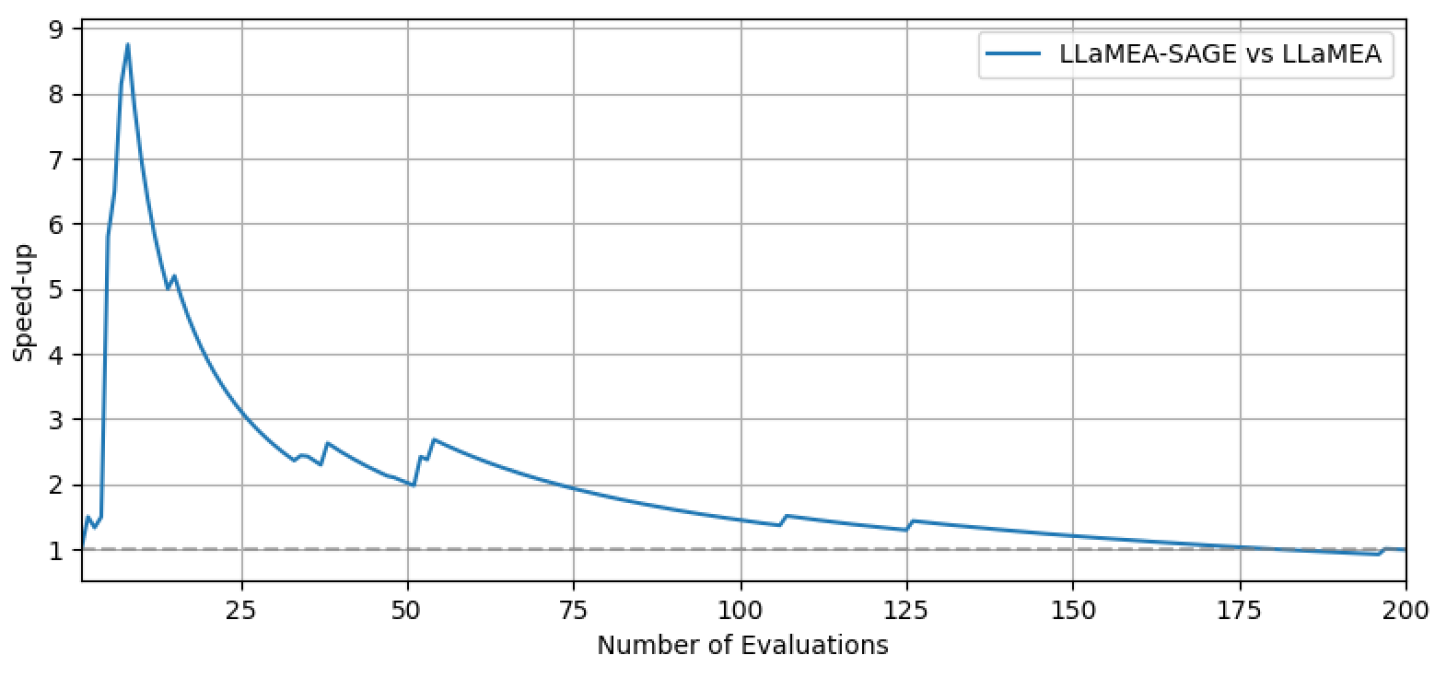

- 实验表明,LLaMEA-SAGE在小型实验中加速了性能提升,并在大规模实验中超越了现有AAD方法。

📝 摘要(中文)

大型语言模型(LLM)通过直接从自然语言提示生成优化算法,实现了自动算法设计(AAD)。虽然像LLaMEA这样的进化框架在算法设计空间中表现出强大的探索能力,但它们的搜索动态完全由适应度反馈驱动,导致大量关于生成代码的信息未被利用。我们提出了一种机制,通过基于已评估解决方案档案上学习的代理模型,从生成算法的抽象语法树中提取的图论和复杂度特征构建反馈,从而指导AAD。利用可解释AI技术,我们识别出显著影响性能的特征,并将它们转化为自然语言突变指令,从而在不限制表达能力的情况下引导后续基于LLM的代码生成。我们提出了LLaMEA-SAGE,它将这种特征驱动的指导集成到LLaMEA中,并在多个基准测试中对其进行评估。我们表明,在小型受控实验中,所提出的结构化指导比vanilla LLaMEA更快地达到相同的性能。在使用GECCO-MA-BBOB竞赛中的MA-BBOB套件进行的大规模实验中,我们的指导方法比最先进的AAD方法实现了卓越的性能。这些结果表明,从代码中导出的信号可以有效地偏置LLM驱动的算法演化,从而弥合自动算法设计中代码结构和人类可理解的性能反馈之间的差距。

🔬 方法详解

问题定义:论文旨在解决自动算法设计(AAD)中,现有方法仅依赖适应度反馈而忽略代码结构信息的问题。现有方法的痛点在于搜索效率低,难以充分利用LLM生成代码的潜力。

核心思路:论文的核心思路是利用可解释AI技术,从生成算法的抽象语法树中提取结构特征,并学习这些特征与算法性能之间的关系。然后,将这些关系转化为自然语言指令,指导LLM进行代码生成,从而实现更高效的算法搜索。

技术框架:LLaMEA-SAGE框架主要包含以下几个模块:1) 基于LLM的代码生成模块(LLaMEA);2) 抽象语法树(AST)提取与特征工程模块;3) 基于代理模型的性能预测模块;4) 可解释AI分析与自然语言指令生成模块。整体流程是:LLaMEA生成算法代码 -> 提取AST并计算结构特征 -> 代理模型预测性能 -> 可解释AI识别关键特征 -> 生成自然语言指令 -> 指导LLM下一轮代码生成。

关键创新:最重要的技术创新点在于将代码结构信息融入到LLM驱动的算法演化过程中。与现有方法仅依赖适应度反馈不同,LLaMEA-SAGE通过可解释AI技术,将代码的结构特征转化为人类可理解的指导信息,从而更有效地利用LLM的代码生成能力。

关键设计:关键设计包括:1) 抽象语法树特征的选择,例如图论特征和复杂度特征;2) 代理模型的选择与训练,用于预测算法性能;3) 可解释AI方法的选择,用于识别关键特征;4) 自然语言指令的生成策略,如何将特征信息转化为有效的指导。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在小型受控实验中,LLaMEA-SAGE比vanilla LLaMEA更快地达到相同的性能。在大规模实验中,使用GECCO-MA-BBOB套件,LLaMEA-SAGE的性能优于最先进的AAD方法,证明了结构化指导的有效性。具体性能提升幅度未知,论文未给出明确数据。

🎯 应用场景

该研究成果可应用于各种优化问题的自动算法设计,例如机器学习模型的超参数优化、组合优化问题的求解等。通过自动化算法设计,可以降低算法开发成本,提高算法性能,并加速相关领域的创新。未来,该方法有望扩展到更复杂的算法设计任务,例如自动生成深度学习模型结构。

📄 摘要(原文)

Large language models have enabled automated algorithm design (AAD) by generating optimization algorithms directly from natural-language prompts. While evolutionary frameworks such as LLaMEA demonstrate strong exploratory capabilities across the algorithm design space, their search dynamics are entirely driven by fitness feedback, leaving substantial information about the generated code unused. We propose a mechanism for guiding AAD using feedback constructed from graph-theoretic and complexity features extracted from the abstract syntax trees of the generated algorithms, based on a surrogate model learned over an archive of evaluated solutions. Using explainable AI techniques, we identify features that substantially affect performance and translate them into natural-language mutation instructions that steer subsequent LLM-based code generation without restricting expressivity. We propose LLaMEA-SAGE, which integrates this feature-driven guidance into LLaMEA, and evaluate it across several benchmarks. We show that the proposed structured guidance achieves the same performance faster than vanilla LLaMEA in a small controlled experiment. In a larger-scale experiment using the MA-BBOB suite from the GECCO-MA-BBOB competition, our guided approach achieves superior performance compared to state-of-the-art AAD methods. These results demonstrate that signals derived from code can effectively bias LLM-driven algorithm evolution, bridging the gap between code structure and human-understandable performance feedback in automated algorithm design.