White-Box Op-Amp Design via Human-Mimicking Reasoning

作者: Zihao Chen, Jiayin Wang, Ziyi Sun, Ji Zhuang, Jinyi Shen, Xiaoyue Ke, Li Shang, Xuan Zeng, Fan Yang

分类: cs.AI

发布日期: 2026-01-29

🔗 代码/项目: GITHUB

💡 一句话要点

提出White-Op,通过模仿人类推理设计可解释的运算放大器参数。

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 运算放大器设计 可解释性AI 模拟电路设计 大型语言模型 电路优化

📋 核心要点

- 现有运放设计方法通常是黑盒优化,缺乏可解释性,难以理解设计决策背后的原理。

- White-Op模仿人类专家设计运放的推理过程,通过引入假设约束,将设计问题转化为可解释的优化问题。

- 实验表明,White-Op在多种运放拓扑上实现了可靠的设计,且理论预测误差小,晶体管级映射后功能保持。

📝 摘要(中文)

本文提出White-Op,一个基于大型语言模型智能体模仿人类推理的可解释运算放大器(运放)参数设计框架。我们将隐式的人类推理机制形式化为显式的步骤,即 extbf{引入假设约束},并开发了一种迭代的、类似人类的 extbf{假设-验证-决策}工作流程。具体而言,引导智能体引入假设约束,以推导并适当调节符号可处理的极点和零点的位置,从而形成一个闭式数学优化问题,然后以编程方式解决并通过仿真验证。理论-仿真结果分析指导决策以进行改进。在9种运放拓扑上的实验表明,与在5种拓扑中最终失败的不可解释的黑盒基线不同,White-Op实现了可靠的、可解释的行为级设计,理论预测误差仅为8.52%,并且在所有拓扑的晶体管级映射后,设计功能得以保留。White-Op已在https://github.com/zhchenfdu/whiteop开源。

🔬 方法详解

问题定义:传统运放设计方法,尤其是基于优化的方法,通常是黑盒的。这意味着设计过程缺乏透明度和可解释性,工程师难以理解优化器做出的决策,也难以根据设计结果进行进一步的改进和优化。此外,黑盒方法在面对新的运放拓扑时,往往需要大量的重新训练和调整,泛化能力较弱。

核心思路:White-Op的核心思路是模仿人类专家设计运放的推理过程。人类专家在设计运放时,通常会基于对电路原理的理解,引入一些假设性的约束条件,例如设定某些极点和零点的位置,然后根据这些约束条件推导出电路参数。White-Op将这种隐式的推理过程显式地表达出来,并利用大型语言模型(LLM)来模拟人类专家的推理过程。

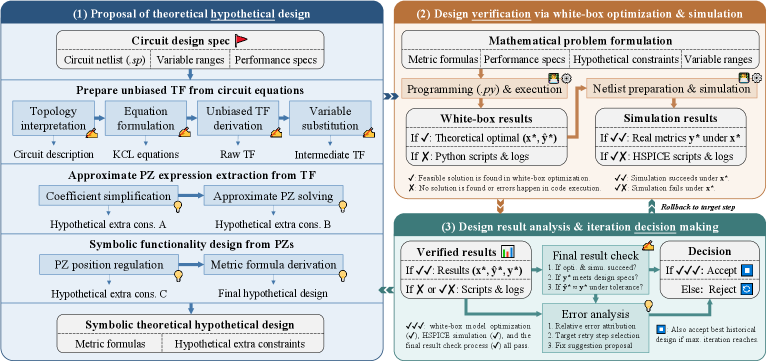

技术框架:White-Op的整体框架是一个迭代的“假设-验证-决策”循环。首先,LLM智能体根据运放的拓扑结构和设计目标,提出一些假设性的约束条件。然后,根据这些约束条件,利用电路理论推导出运放的参数值,并进行仿真验证。最后,根据仿真结果,LLM智能体会对假设条件进行调整,并重复上述过程,直到满足设计目标为止。这个过程可以看作是LLM智能体在不断地学习和优化设计策略。

关键创新:White-Op的关键创新在于将人类的推理过程形式化为显式的步骤,并利用LLM智能体来模拟这个过程。这种方法不仅可以提高运放设计的效率,还可以提高设计的可解释性。此外,White-Op还可以根据仿真结果自动调整设计策略,从而提高设计的鲁棒性和泛化能力。与传统的黑盒优化方法相比,White-Op的设计过程更加透明和可控。

关键设计:White-Op的关键设计包括:1) 如何将人类的推理过程形式化为显式的步骤;2) 如何利用LLM智能体来模拟人类的推理过程;3) 如何根据仿真结果自动调整设计策略。具体来说,论文中定义了一套规则,用于指导LLM智能体提出假设性的约束条件。此外,论文还设计了一个损失函数,用于衡量仿真结果与设计目标之间的差距。LLM智能体通过最小化这个损失函数来优化设计策略。

🖼️ 关键图片

📊 实验亮点

White-Op在9种运放拓扑上进行了实验,结果表明,与黑盒基线相比,White-Op能够实现更可靠的设计,且理论预测误差仅为8.52%。更重要的是,White-Op的设计在晶体管级映射后仍然保持功能,这表明该方法具有很强的实用性。而黑盒基线在5种拓扑上最终失败,凸显了White-Op的优势。

🎯 应用场景

White-Op可应用于各种模拟电路的设计,尤其是在需要高可靠性和可解释性的场景下,例如高性能放大器、滤波器、模数转换器等。该方法能够加速电路设计流程,降低对人工经验的依赖,并为电路优化提供理论指导,促进模拟电路设计的自动化和智能化。

📄 摘要(原文)

This brief proposes \emph{White-Op}, an interpretable operational amplifier (op-amp) parameter design framework based on the human-mimicking reasoning of large-language-model agents. We formalize the implicit human reasoning mechanism into explicit steps of \emph{\textbf{introducing hypothetical constraints}}, and develop an iterative, human-like \emph{\textbf{hypothesis-verification-decision}} workflow. Specifically, the agent is guided to introduce hypothetical constraints to derive and properly regulate positions of symbolically tractable poles and zeros, thus formulating a closed-form mathematical optimization problem, which is then solved programmatically and verified via simulation. Theory-simulation result analysis guides the decision-making for refinement. Experiments on 9 op-amp topologies show that, unlike the uninterpretable black-box baseline which finally fails in 5 topologies, White-Op achieves reliable, interpretable behavioral-level designs with only 8.52\% theoretical prediction error and the design functionality retains after transistor-level mapping for all topologies. White-Op is open-sourced at \textcolor{blue}{https://github.com/zhchenfdu/whiteop}.