MemCtrl: Using MLLMs as Active Memory Controllers on Embodied Agents

作者: Vishnu Sashank Dorbala, Dinesh Manocha

分类: cs.AI, cs.RO

发布日期: 2026-01-28

💡 一句话要点

MemCtrl:利用多模态大语言模型作为具身智能体的主动记忆控制器

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身智能 多模态大语言模型 记忆管理 在线学习 强化学习

📋 核心要点

- 现有具身智能体记忆管理方法将记忆视为离线存储,忽略了在线环境下的内存和计算约束。

- MemCtrl利用多模态大语言模型(MLLM)和可训练的记忆头μ,在线进行记忆修剪,提升效率。

- 实验表明,MemCtrl能显著提升具身智能体在复杂任务中的完成能力,平均提升约16%。

📝 摘要(中文)

基础模型依赖于上下文学习来实现个性化的决策。然而,上下文窗口大小的限制需要像RAG这样的记忆压缩和检索系统。这些系统通常将记忆视为大型离线存储空间,这对于需要在严格的内存和计算约束下在线运行的具身智能体是不利的。本文提出了MemCtrl,一种新颖的框架,它使用多模态大语言模型(MLLM)来在线修剪记忆。MemCtrl使用可训练的记忆头μ来增强MLLM,该记忆头充当门控,以确定在探索期间保留、更新或丢弃哪些观察或反思。我们通过训练两种类型的μ(1)通过离线专家,以及(2)通过在线强化学习进行评估,并观察到μ增强的MLLM在整体具身任务完成能力方面有显著提高。特别是在EmbodiedBench基准的多个子集上,用MemCtrl增强两个低性能的MLLM后,我们观察到μ增强的MLLM平均提高了约16%,在特定的指令子集上提高了20%以上。最后,我们对μ收集的记忆片段进行了定性分析,注意到μ增强的MLLM在长而复杂的指令类型上表现出优越的性能。

🔬 方法详解

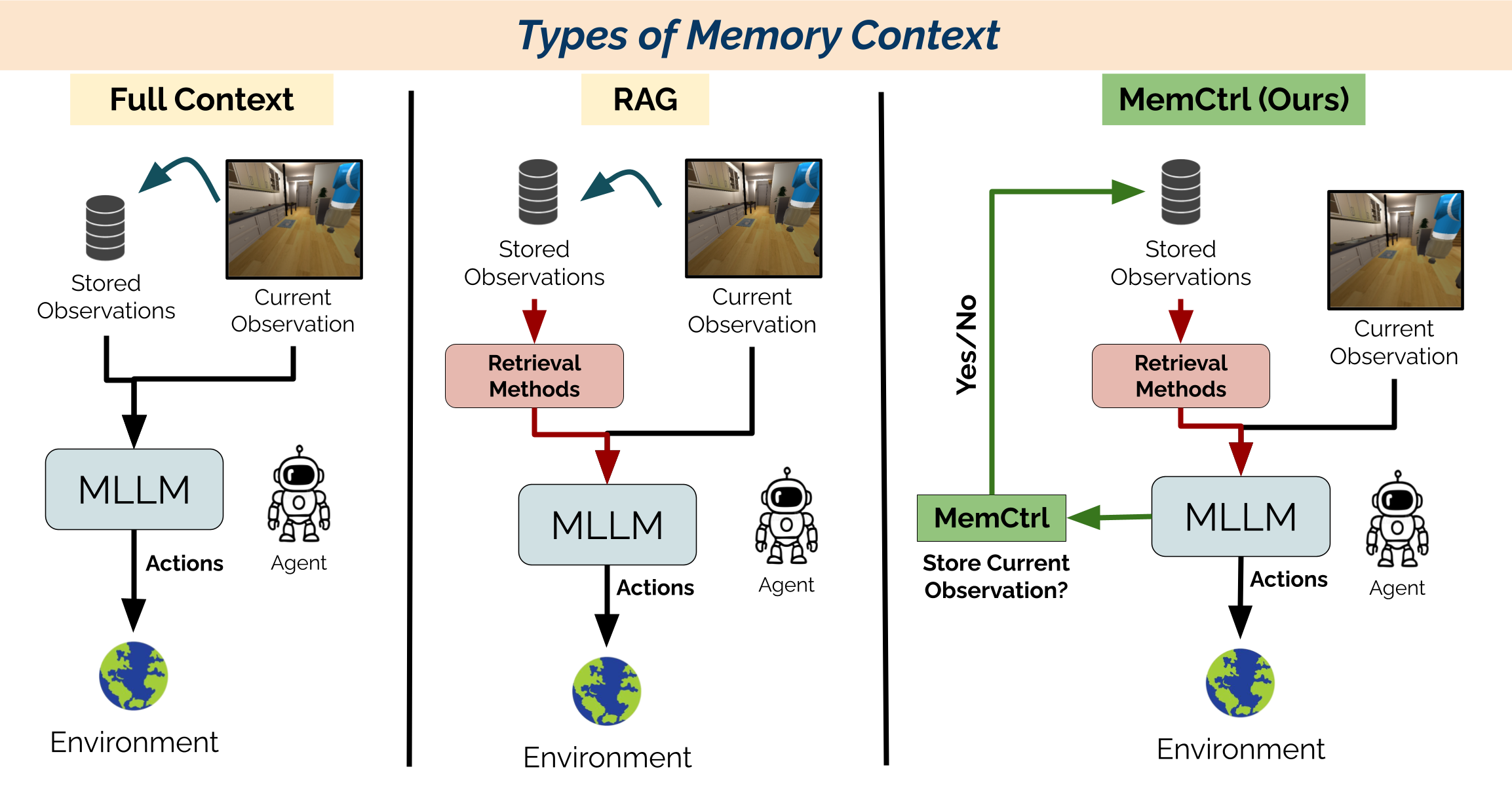

问题定义:具身智能体需要在资源有限的环境中进行决策,而现有方法通常将记忆视为大型离线存储,忽略了在线计算和内存约束。这导致智能体难以有效地管理和利用记忆,尤其是在处理长序列和复杂任务时,性能会显著下降。

核心思路:MemCtrl的核心思想是利用多模态大语言模型(MLLM)的强大理解和推理能力,结合一个可训练的记忆头μ,来主动地管理和修剪记忆。μ作为一个门控机制,决定哪些观察或反思应该被保留、更新或丢弃,从而优化记忆的使用效率。

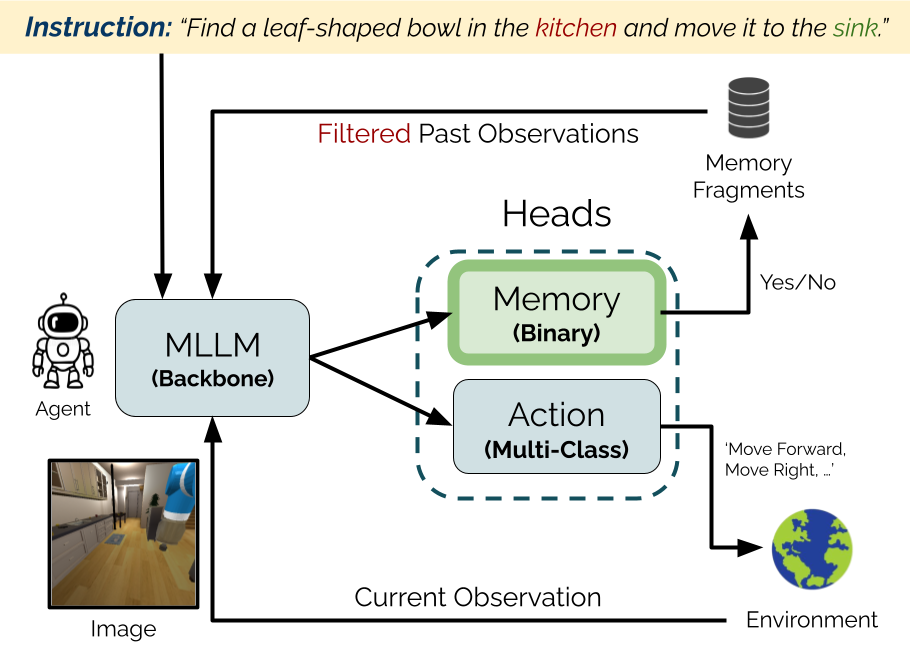

技术框架:MemCtrl框架包含三个主要组成部分:多模态大语言模型(MLLM)、可训练的记忆头μ和外部记忆存储。MLLM负责处理输入信息并生成决策,μ负责评估信息的价值并决定是否将其存储到外部记忆中,外部记忆存储则用于长期存储有用的信息。整个流程是:智能体观察环境,MLLM处理观察结果,μ决定哪些信息需要存储,MLLM基于当前观察和记忆做出决策。

关键创新:MemCtrl的关键创新在于将MLLM与可训练的记忆头μ相结合,实现了在线的、主动的记忆管理。与传统的被动记忆存储方法不同,MemCtrl能够根据任务需求动态地调整记忆内容,从而提高记忆的利用率和智能体的整体性能。

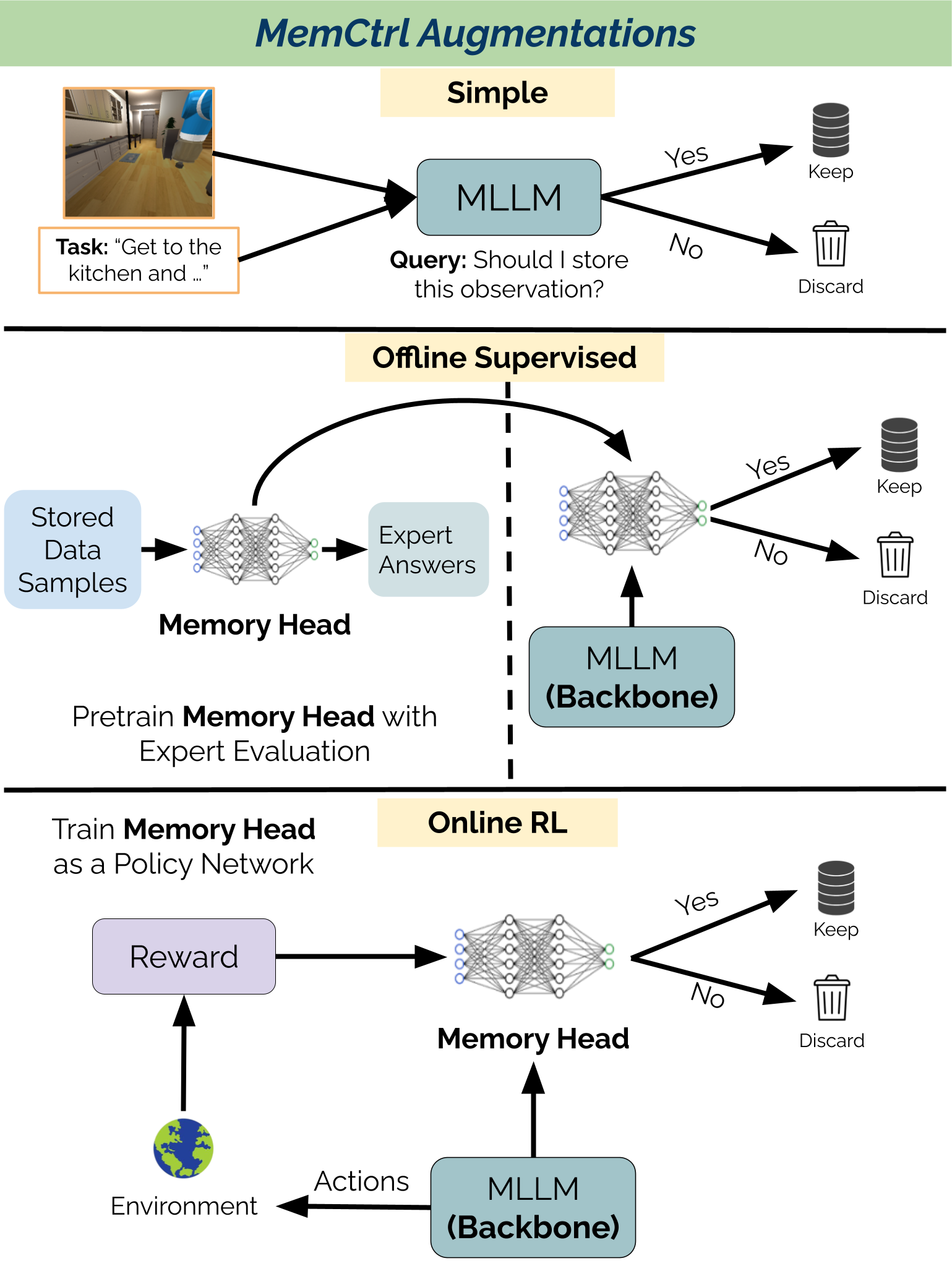

关键设计:记忆头μ可以通过两种方式进行训练:离线专家训练和在线强化学习。离线专家训练使用预先定义的规则或策略来指导μ的学习,而在线强化学习则通过奖励信号来优化μ的决策。μ的具体实现可以是一个小型神经网络,其输入是MLLM的输出和当前记忆状态,输出是一个概率值,表示该信息应该被保留的概率。损失函数的设计需要平衡记忆的完整性和效率,例如可以使用交叉熵损失或强化学习中的策略梯度方法。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在EmbodiedBench基准测试中,使用MemCtrl增强的MLLM在多个子集上都取得了显著的性能提升,平均提升约16%,在特定指令子集上提升超过20%。定性分析表明,MemCtrl能够有效地保留与长而复杂的指令相关的记忆片段,从而提高智能体在这些任务上的表现。

🎯 应用场景

MemCtrl具有广泛的应用前景,例如在机器人导航、智能家居、自动驾驶等领域。它可以帮助智能体更有效地管理和利用记忆,从而提高其在复杂环境中的适应性和决策能力。此外,MemCtrl还可以应用于其他需要长期记忆和推理的任务,例如对话系统、知识图谱构建等。

📄 摘要(原文)

Foundation models rely on in-context learning for personalized decision making. The limited size of this context window necessitates memory compression and retrieval systems like RAG. These systems however often treat memory as large offline storage spaces, which is unfavorable for embodied agents that are expected to operate under strict memory and compute constraints, online. In this work, we propose MemCtrl, a novel framework that uses Multimodal Large Language Models (MLLMs) for pruning memory online. MemCtrl augments MLLMs with a trainable memory head μthat acts as a gate to determine which observations or reflections to retain, update, or discard during exploration. We evaluate with training two types of μ, 1) via an offline expert, and 2) via online RL, and observe significant improvement in overall embodied task completion ability on μ-augmented MLLMs. In particular, on augmenting two low performing MLLMs with MemCtrl on multiple subsets of the EmbodiedBench benchmark, we observe that μ-augmented MLLMs show an improvement of around 16% on average, with over 20% on specific instruction subsets. Finally, we present a qualitative analysis on the memory fragments collected by μ, noting the superior performance of μaugmented MLLMs on long and complex instruction types.