OmegaUse: Building a General-Purpose GUI Agent for Autonomous Task Execution

作者: Le Zhang, Yixiong Xiao, Xinjiang Lu, Jingjia Cao, Yusai Zhao, Jingbo Zhou, Lang An, Zikan Feng, Wanxiang Sha, Yu Shi, Congxi Xiao, Jian Xiong, Yankai Zhang, Hua Wu, Haifeng Wang

分类: cs.AI

发布日期: 2026-01-28

💡 一句话要点

OmegaUse:构建通用GUI智能体,实现自主任务执行

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: GUI智能体 自主任务执行 数据合成 解耦训练 混合专家模型 人机交互 强化学习

📋 核心要点

- 现有GUI智能体在数据质量和训练方法上存在挑战,难以有效完成复杂任务。

- OmegaUse通过自动化合成框架生成高质量数据,并采用解耦训练范式提升性能。

- 实验表明,OmegaUse在多个GUI基准测试中达到SOTA,并在跨平台任务中表现出色。

📝 摘要(中文)

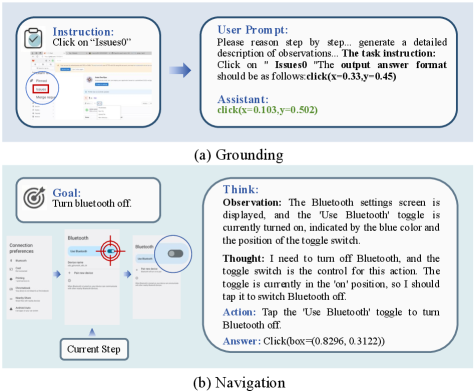

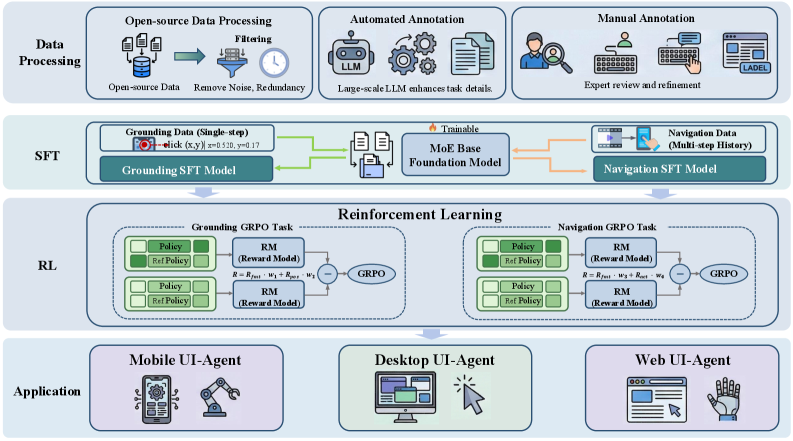

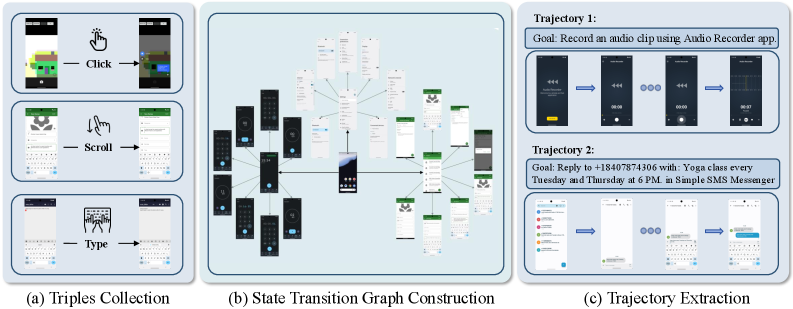

本文提出了OmegaUse,一个通用的GUI智能体模型,旨在自主执行移动和桌面平台上的任务,支持计算机和手机使用场景。构建有效的GUI智能体模型依赖于高质量的数据和有效的训练方法。为此,我们设计了一个精心构建的数据生成流程和一个解耦的训练范式。在数据构建方面,我们利用严格管理的开源数据集,并引入了一种新颖的自动化合成框架,该框架集成了自下而上的自主探索和自上而下的分类引导生成,以创建高保真合成数据。在训练方面,为了更好地利用这些数据,我们采用了一个两阶段策略:监督微调(SFT)以建立基本的交互语法,然后是群体相对策略优化(GRPO)以提高空间定位和序列规划。为了平衡计算效率和智能体推理能力,OmegaUse建立在混合专家(MoE)骨干网络之上。为了在离线环境中评估跨终端能力,我们引入了OS-Nav,一个跨多个操作系统的基准测试套件:ChiM-Nav,针对中国Android移动环境,以及Ubu-Nav,专注于Ubuntu上的日常桌面交互。大量实验表明,OmegaUse在已建立的GUI基准测试中具有很强的竞争力,在ScreenSpot-V2上实现了96.3%的SOTA分数,在AndroidControl上实现了79.1%的领先步成功率。OmegaUse在OS-Nav上也表现出色,在ChiM-Nav上达到了74.24%的步成功率,在Ubu-Nav上达到了55.9%的平均成功率。

🔬 方法详解

问题定义:现有的GUI智能体在真实世界任务中面临挑战,主要痛点在于缺乏高质量的训练数据,以及难以有效学习空间定位和序列规划能力。开源数据集往往存在偏差或覆盖范围不足,而现有的训练方法难以充分利用这些数据,导致智能体在复杂任务中表现不佳。

核心思路:OmegaUse的核心思路是通过构建高质量的合成数据和采用解耦训练范式来提升GUI智能体的性能。高质量的合成数据能够提供更全面和均衡的训练样本,而解耦训练范式能够分别优化智能体的交互语法、空间定位和序列规划能力。

技术框架:OmegaUse的整体框架包含数据构建和模型训练两个主要阶段。数据构建阶段利用开源数据集和自动化合成框架生成高质量的训练数据。模型训练阶段采用两阶段策略:首先使用监督微调(SFT)学习基本的交互语法,然后使用群体相对策略优化(GRPO)提高空间定位和序列规划能力。OmegaUse使用混合专家(MoE)模型作为骨干网络,以平衡计算效率和智能体推理能力。

关键创新:OmegaUse的关键创新在于其自动化合成框架和解耦训练范式。自动化合成框架集成了自下而上的自主探索和自上而下的分类引导生成,能够高效地生成高保真合成数据。解耦训练范式将训练过程分解为SFT和GRPO两个阶段,分别优化智能体的不同能力,从而提高整体性能。

关键设计:在数据合成方面,采用了基于任务分类的引导策略,确保合成数据覆盖各种任务类型。在模型训练方面,GRPO使用群体相对策略优化算法,通过比较不同智能体的行为来学习更有效的策略。MoE模型的具体结构和专家数量需要根据实际情况进行调整,以达到最佳的性能和效率平衡。

🖼️ 关键图片

📊 实验亮点

OmegaUse在多个GUI基准测试中取得了显著的成果。在ScreenSpot-V2上,OmegaUse达到了96.3%的SOTA分数,超越了现有最佳模型。在AndroidControl上,OmegaUse实现了79.1%的领先步成功率。此外,OmegaUse在OS-Nav基准测试中也表现出色,在ChiM-Nav上达到了74.24%的步成功率,在Ubu-Nav上达到了55.9%的平均成功率,证明了其跨平台任务处理能力。

🎯 应用场景

OmegaUse具有广泛的应用前景,可用于自动化测试、RPA(机器人流程自动化)、智能助手等领域。它可以帮助用户自动完成重复性的GUI操作,提高工作效率,并降低人工成本。未来,OmegaUse有望成为人机交互的重要组成部分,实现更加智能和便捷的人机协作。

📄 摘要(原文)

Graphical User Interface (GUI) agents show great potential for enabling foundation models to complete real-world tasks, revolutionizing human-computer interaction and improving human productivity. In this report, we present OmegaUse, a general-purpose GUI agent model for autonomous task execution on both mobile and desktop platforms, supporting computer-use and phone-use scenarios. Building an effective GUI agent model relies on two factors: (1) high-quality data and (2) effective training methods. To address these, we introduce a carefully engineered data-construction pipeline and a decoupled training paradigm. For data construction, we leverage rigorously curated open-source datasets and introduce a novel automated synthesis framework that integrates bottom-up autonomous exploration with top-down taxonomy-guided generation to create high-fidelity synthetic data. For training, to better leverage these data, we adopt a two-stage strategy: Supervised Fine-Tuning (SFT) to establish fundamental interaction syntax, followed by Group Relative Policy Optimization (GRPO) to improve spatial grounding and sequential planning. To balance computational efficiency with agentic reasoning capacity, OmegaUse is built on a Mixture-of-Experts (MoE) backbone. To evaluate cross-terminal capabilities in an offline setting, we introduce OS-Nav, a benchmark suite spanning multiple operating systems: ChiM-Nav, targeting Chinese Android mobile environments, and Ubu-Nav, focusing on routine desktop interactions on Ubuntu. Extensive experiments show that OmegaUse is highly competitive across established GUI benchmarks, achieving a state-of-the-art (SOTA) score of 96.3% on ScreenSpot-V2 and a leading 79.1% step success rate on AndroidControl. OmegaUse also performs strongly on OS-Nav, reaching 74.24% step success on ChiM-Nav and 55.9% average success on Ubu-Nav.