Scaling Medical Reasoning Verification via Tool-Integrated Reinforcement Learning

作者: Hang Zhang, Ruheng Wang, Yuelyu Ji, Mingu Kwak, Xizhi Wu, Chenyu Li, Li Zhang, Wenqi Shi, Yifan Peng, Yanshan Wang

分类: cs.AI, cs.CL

发布日期: 2026-01-28

💡 一句话要点

提出Tool-Integrated RL框架,提升医学推理验证的可扩展性和可靠性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 医学推理 强化学习 知识检索 工具增强 可解释性

📋 核心要点

- 现有医学推理验证方法依赖标量奖励,缺乏可解释性,且单次检索限制了知识获取。

- 提出Tool-Integrated RL框架,通过迭代查询外部医学语料库进行工具增强验证。

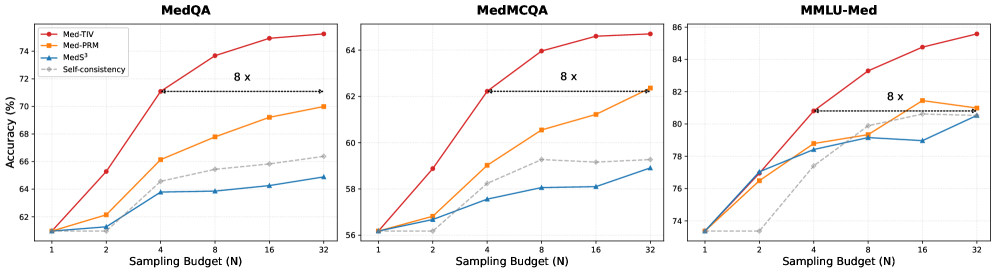

- 实验表明,该方法在多个医学推理基准上显著提升性能,并大幅降低采样预算。

📝 摘要(中文)

大型语言模型在医学推理基准测试中表现出色,但部署到临床环境需要严格验证以确保事实准确性。现有的奖励模型方法存在两个局限:仅产生标量奖励值而缺乏明确的理由,以及依赖于单次检索,无法在验证过程中自适应地访问知识。我们提出了一个agentic框架,通过训练医学推理验证器在评估期间迭代查询外部医学语料库来解决这些限制。我们的方法结合了工具增强验证和迭代强化学习范式,只需要trace级别的监督,以及动态调整训练数据分布的自适应课程机制。在四个医学推理基准测试中,相对于基础生成器,该方法取得了显著的提升,尤其是在MedQA上提高了23.5%,在MedXpertQA上提高了32.0%。至关重要的是,与之前的奖励模型基线相比,该方法在采样预算需求方面降低了8倍。这些发现表明,将验证建立在动态检索的证据基础上,为更可靠的医学推理系统提供了一条有原则的途径。

🔬 方法详解

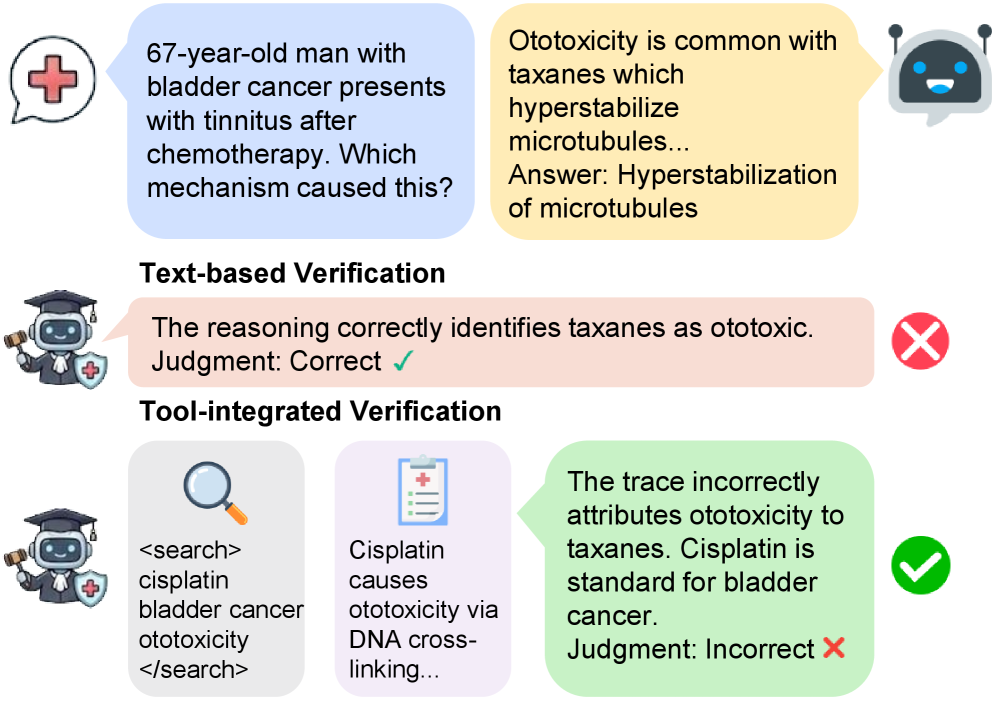

问题定义:论文旨在解决医学推理验证中,现有奖励模型方法的局限性。这些方法主要存在两个痛点:一是奖励信号是标量值,缺乏明确的推理依据,难以解释验证结果;二是依赖于单次检索,无法根据验证过程中的需要动态获取和利用外部医学知识,导致验证效果受限。

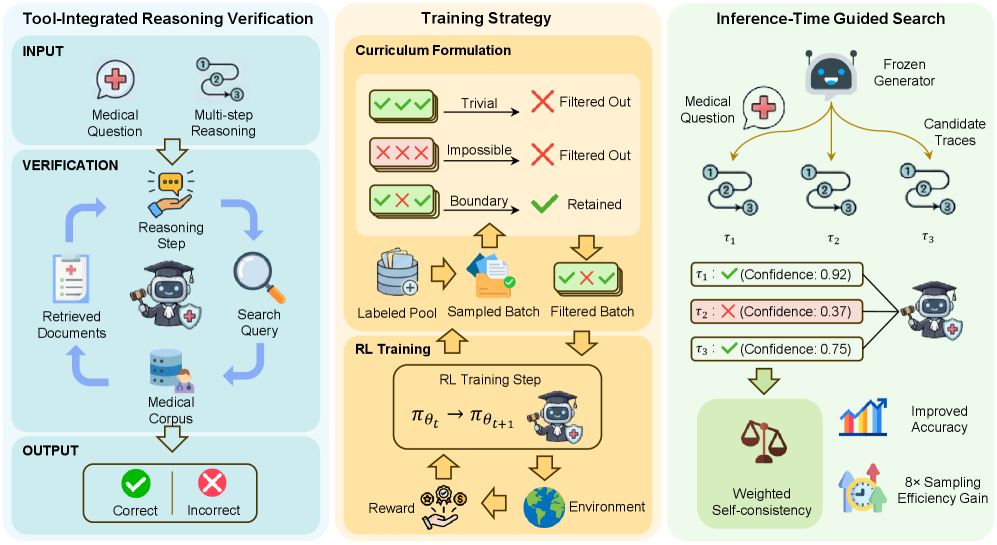

核心思路:论文的核心思路是将医学推理验证过程建模为一个agent与环境交互的过程。agent通过迭代查询外部医学语料库来获取相关医学知识,并基于这些知识进行推理验证。这种迭代式的知识获取和推理过程,使得验证过程更加灵活和可解释。同时,利用强化学习来训练agent,使其能够根据验证结果不断优化知识获取和推理策略。

技术框架:整体框架包含一个agent和一个环境。agent负责根据当前状态(包括问题、已检索到的知识等)选择一个动作(例如,查询外部语料库),然后环境根据agent的动作返回新的状态和奖励。agent的目标是最大化累积奖励。具体来说,框架包含以下几个主要模块:1) 知识检索模块:负责根据agent的查询从外部医学语料库中检索相关知识;2) 推理验证模块:负责根据检索到的知识和问题进行推理验证,并给出验证结果;3) 奖励函数:用于评估agent的验证结果,并提供反馈信号;4) 强化学习算法:用于训练agent,使其能够学习到最优的知识获取和推理策略。

关键创新:最重要的技术创新点在于将工具增强验证与迭代强化学习相结合。与传统的单次检索方法相比,该方法能够根据验证过程中的需要动态获取和利用外部医学知识,从而提高验证的准确性和可靠性。此外,该方法只需要trace级别的监督,降低了训练成本。

关键设计:论文采用了一种自适应课程机制,动态调整训练数据的分布,以提高训练效率和泛化能力。具体来说,课程机制根据agent在不同难度样本上的表现,动态调整训练样本的采样概率,使得agent能够更加关注那些对其学习最有帮助的样本。此外,论文还设计了一个奖励函数,用于评估agent的验证结果。奖励函数综合考虑了验证的准确性、检索到的知识的相关性等因素。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在四个医学推理基准测试中取得了显著的提升,尤其是在MedQA上提高了23.5%,在MedXpertQA上提高了32.0%,相对于基础生成器。更重要的是,与之前的奖励模型基线相比,该方法在采样预算需求方面降低了8倍,表明该方法具有更高的效率和可扩展性。

🎯 应用场景

该研究成果可应用于临床决策支持系统、医学知识问答系统等领域,提升医学推理的准确性和可靠性,辅助医生进行诊断和治疗,减少医疗错误,提高医疗质量。未来可扩展到其他需要知识密集型推理的领域,如法律、金融等。

📄 摘要(原文)

Large language models have achieved strong performance on medical reasoning benchmarks, yet their deployment in clinical settings demands rigorous verification to ensure factual accuracy. While reward models offer a scalable approach for reasoning trace verification, existing methods face two limitations: they produce only scalar reward values without explicit justification, and they rely on single-pass retrieval that precludes adaptive knowledge access as verification unfolds. We introduce $\method$, an agentic framework that addresses these limitations by training medical reasoning verifiers to iteratively query external medical corpora during evaluation. Our approach combines tool-augmented verification with an iterative reinforcement learning paradigm that requires only trace-level supervision, alongside an adaptive curriculum mechanism that dynamically adjusts training data distribution. Across four medical reasoning benchmarks, $\method$ achieves substantial gains over existing methods, improving MedQA accuracy by 23.5% and MedXpertQA by 32.0% relative to the base generator in particular. Crucially, $\method$ demonstrates an $\mathbf{8\times}$ reduction in sampling budget requirement compared to prior reward model baselines. These findings establish that grounding verification in dynamically retrieved evidence offers a principled path toward more reliable medical reasoning systems.