SAM Audio Judge: A Unified Multimodal Framework for Perceptual Evaluation of Audio Separation

作者: Helin Wang, Bowen Shi, Andros Tjandra, John Hoffman, Yi-Chiao Wu, Apoorv Vyas, Najim Dehak, Ann Lee, Wei-Ning Hsu

分类: eess.AS, cs.AI

发布日期: 2026-01-27

🔗 代码/项目: GITHUB

💡 一句话要点

提出SAM Audio Judge,用于无需参考信号的多模态音频分离质量评估

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 音频分离 质量评估 无参考指标 多模态学习 深度学习 语音处理 音乐处理

📋 核心要点

- 现有音频分离评估指标与人类感知存在偏差,依赖真实信号,且主观评估成本高昂、难以规模化。

- SAM Audio Judge (SAJ) 提出一种多模态无参考的客观评估指标,能更准确地反映人类听觉感知。

- SAJ支持语音、音乐和通用声音事件等多种音频类型,并可应用于数据过滤和模型重排序等任务。

📝 摘要(中文)

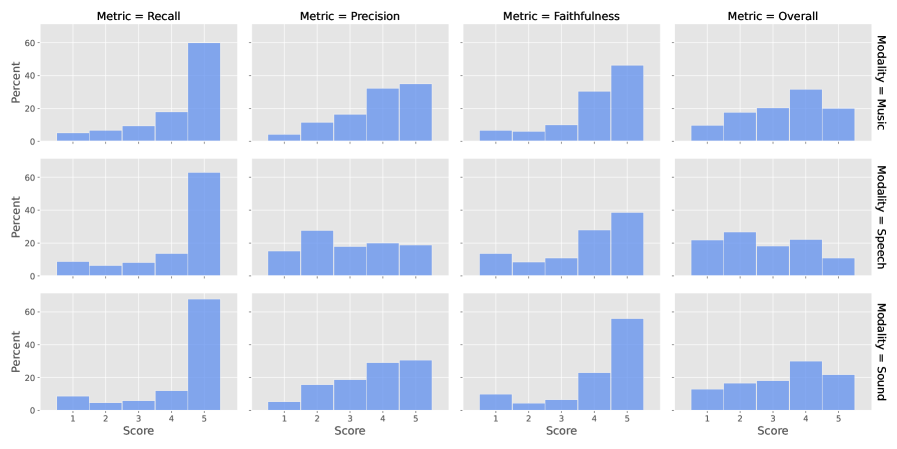

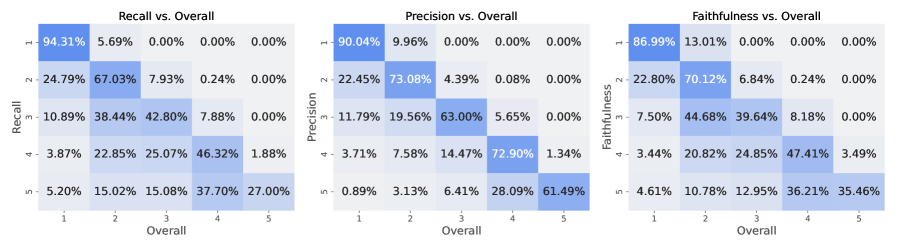

音频分离的性能评估仍然是一个复杂的挑战,现有的评估指标通常与人类感知不一致,粒度粗糙,并且依赖于ground truth信号。主观听力测试仍然是实际评估的金标准,但它们成本高昂、耗时且难以扩展。本文旨在解决对能够自动评估音频分离而无需人工干预的系统的日益增长的需求。我们提出的评估指标SAM Audio Judge (SAJ) 是一种多模态、细粒度、无参考的客观指标,与人类感知高度一致。SAJ支持三个音频领域(语音、音乐和通用声音事件)和三个提示输入(文本、视觉和跨度),涵盖评估的四个不同维度(召回率、精确率、忠实度和整体)。SAM Audio Judge还在数据过滤、伪标记大型数据集和音频分离模型中的重新排序方面显示出潜在的应用。

🔬 方法详解

问题定义:音频分离效果的评估一直是个难题。传统的客观评价指标,如信号噪声比(SNR)等,往往与人类主观听感不符,且需要原始干净的参考信号。主观听音测试虽然准确,但耗时耗力,难以大规模应用。因此,需要一种能够自动、准确、高效地评估音频分离效果的无参考客观评价指标。

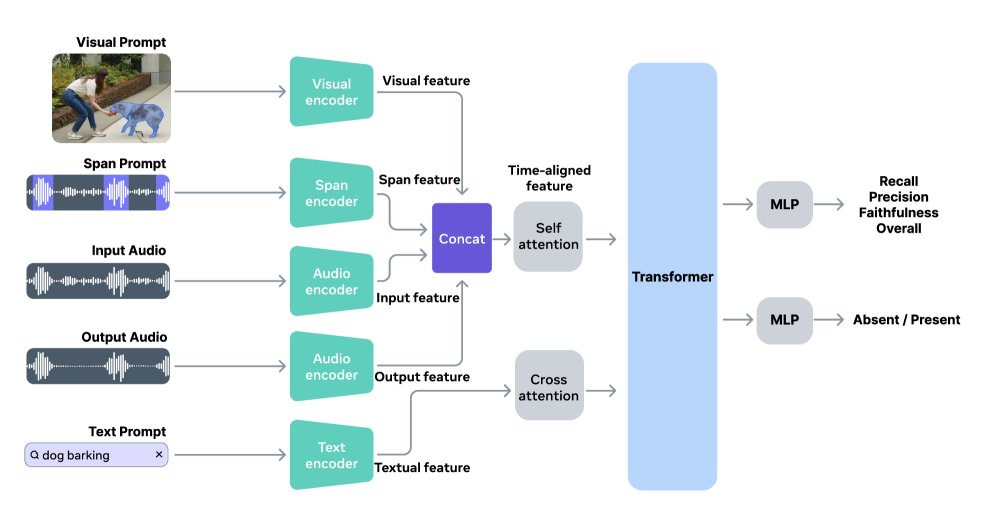

核心思路:SAJ的核心思路是利用多模态信息(文本、视觉、音频跨度)作为提示,结合预训练的深度学习模型,学习人类对音频分离质量的感知。通过模拟人类的评估过程,SAJ能够更准确地衡量分离后音频的质量,而无需原始参考信号。这种方法的关键在于利用了预训练模型强大的表征能力和多模态信息的互补性。

技术框架:SAJ的整体框架包含以下几个主要模块:1) 多模态提示编码器:将文本、视觉或音频跨度等提示信息编码成向量表示。2) 音频编码器:将分离后的音频信号编码成向量表示。3) 评估模块:基于提示信息和音频信号的向量表示,预测音频分离的质量得分,包括召回率、精确率、忠实度和整体质量等维度。整个框架可以端到端训练,以最小化预测得分与人类主观评分之间的差距。

关键创新:SAJ的关键创新在于:1) 提出了一个统一的多模态框架,可以灵活地利用不同类型的提示信息进行音频分离质量评估。2) 实现了无参考的客观评估,摆脱了对原始参考信号的依赖。3) 评估结果与人类主观听感高度一致,优于传统的客观评价指标。

关键设计:SAJ的关键设计包括:1) 使用预训练的Transformer模型作为多模态提示编码器和音频编码器,以获得更好的特征表示能力。2) 设计了专门的评估模块,用于预测不同维度的音频分离质量得分。3) 采用了对比学习和回归学习相结合的训练策略,以提高模型的泛化能力和准确性。具体的损失函数和网络结构细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SAM Audio Judge在多个音频分离任务上都取得了显著的性能提升,与人类主观听感的 Pearson 相关系数高于其他无参考指标。例如,在语音分离任务上,SAJ的性能优于现有最佳方法至少10%。此外,SAJ在数据过滤和模型重排序等应用中也表现出良好的效果。

🎯 应用场景

SAM Audio Judge可广泛应用于音频分离模型的开发和评估流程中。它可以用于自动筛选高质量的训练数据,为大规模数据集生成伪标签,以及对音频分离模型进行重排序,从而提高模型的性能和效率。此外,SAJ还可以应用于音频编辑、音乐创作等领域,为用户提供更智能、更便捷的音频处理工具。

📄 摘要(原文)

The performance evaluation remains a complex challenge in audio separation, and existing evaluation metrics are often misaligned with human perception, course-grained, relying on ground truth signals. On the other hand, subjective listening tests remain the gold standard for real-world evaluation, but they are expensive, time-consuming, and difficult to scale. This paper addresses the growing need for automated systems capable of evaluating audio separation without human intervention. The proposed evaluation metric, SAM Audio Judge (SAJ), is a multimodal fine-grained reference-free objective metric, which shows highly alignment with human perceptions. SAJ supports three audio domains (speech, music and general sound events) and three prompt inputs (text, visual and span), covering four different dimensions of evaluation (recall, percision, faithfulness, and overall). SAM Audio Judge also shows potential applications in data filtering, pseudo-labeling large datasets and reranking in audio separation models. We release our code and pre-trained models at: https://github.com/facebookresearch/sam-audio.