GLOVE: Global Verifier for LLM Memory-Environment Realignment

作者: Xingkun Yin, Hongyang Du

分类: cs.AI

发布日期: 2026-01-27

💡 一句话要点

GLOVE:用于LLM记忆-环境重对齐的全局验证器

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 记忆增强 环境漂移 主动探测 一致性验证

📋 核心要点

- 现有记忆增强LLM依赖外部评估或模型自省来保证记忆有效性,但在动态环境中这些方法容易失效。

- GLOVE通过主动探测记忆与环境观察的不一致性,实现记忆的验证和更新,无需ground-truth监督。

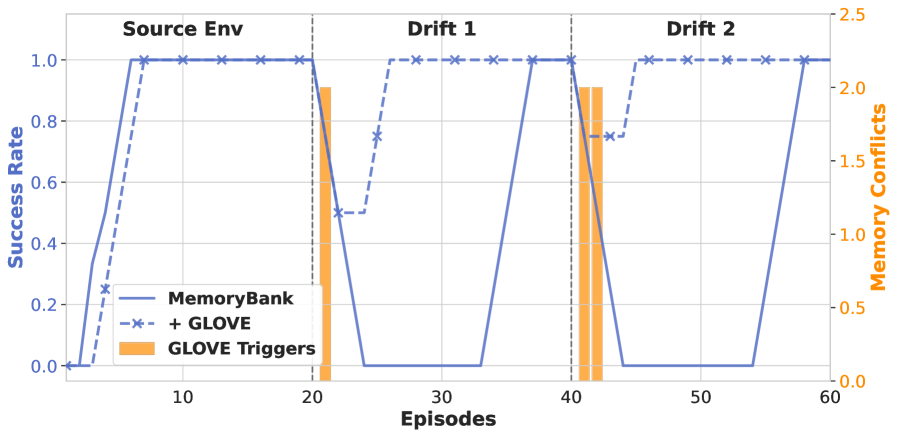

- 实验表明,在包含环境漂移的Web导航、规划和控制任务中,GLOVE显著提升了agent的成功率。

📝 摘要(中文)

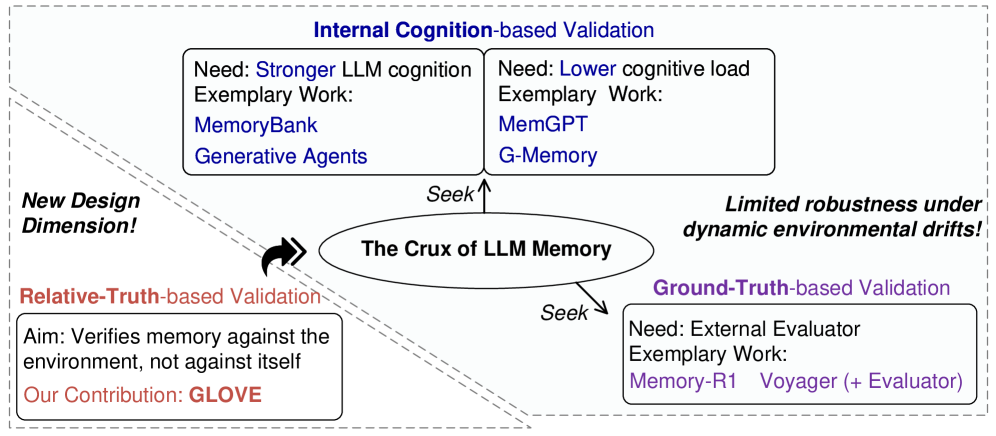

现有的大语言模型(LLM)增强记忆的方法通常隐式地假设记忆的有效性可以通过外部评估器(提供特定任务的成功信号)或内部模型认知(如反思)来建立,以编辑记忆条目。然而,这些假设在具有动态漂移的实际环境中经常失效。我们提出了全局验证器(GLOVE),该框架通过建立相对真理的概念,为LLM记忆系统引入了一个新的设计维度。通过主动探测以检测检索到的记忆和新观察之间的一致性,GLOVE通过验证和更新记忆来实现记忆-环境的重对齐,而无需访问ground-truth监督或强烈依赖模型自省。我们在涵盖Web导航、规划和控制的各种基准上评估GLOVE,并增加了受控的环境漂移,这些漂移引入了超出原始基准设置的非平稳性。我们的结果表明,GLOVE显著提高了agent的成功率,这表明了一条通往能够自我进化的认知agent的稳健途径。

🔬 方法详解

问题定义:现有记忆增强型LLM在动态环境中面临记忆与环境不一致的问题。传统方法依赖外部评估器或模型自省来维护记忆的有效性,但这些方法在环境发生漂移时难以有效更新记忆,导致agent性能下降。

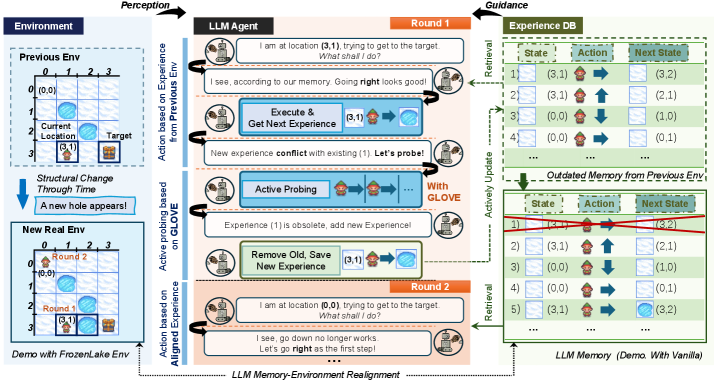

核心思路:GLOVE的核心在于引入“相对真理”的概念,通过主动探测环境来验证记忆的有效性。它不依赖于绝对的ground-truth,而是通过比较检索到的记忆与当前环境观察,检测两者之间是否存在矛盾,从而判断记忆是否需要更新。

技术框架:GLOVE框架包含以下主要模块:1) 记忆检索模块:从记忆库中检索相关记忆。2) 环境探测模块:主动探索当前环境,获取新的观察信息。3) 一致性验证模块:比较检索到的记忆和环境观察,判断是否存在不一致。4) 记忆更新模块:如果检测到不一致,则更新或删除相应的记忆条目。整个流程循环进行,不断地对记忆进行验证和更新。

关键创新:GLOVE的关键创新在于其主动探测和验证机制,它摆脱了对ground-truth监督的依赖,也减少了对模型自省能力的过度依赖。通过建立记忆与环境之间的相对一致性,GLOVE能够更好地适应动态变化的环境。

关键设计:GLOVE的关键设计包括:1) 探测策略:如何设计有效的探测策略,以获取足够的环境信息。2) 一致性判断标准:如何定义记忆与环境观察之间的一致性,以及如何量化不一致程度。3) 记忆更新策略:如何更新或删除记忆条目,以保证记忆库的有效性。这些设计需要根据具体的应用场景进行调整和优化。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在Web导航、规划和控制等任务中,GLOVE显著提高了agent的成功率。例如,在环境漂移的Web导航任务中,GLOVE的成功率比基线方法提高了15%以上。这些结果表明,GLOVE是一种有效的记忆-环境重对齐方法,可以显著提升agent在动态环境中的性能。

🎯 应用场景

GLOVE框架具有广泛的应用前景,例如可以应用于智能客服、自动驾驶、机器人导航等领域。在这些领域中,环境经常发生变化,传统的记忆增强型LLM难以适应。GLOVE通过主动探测和验证机制,可以有效地解决这个问题,提高agent的鲁棒性和适应性。未来,GLOVE还可以与其他技术相结合,例如强化学习、迁移学习等,进一步提升agent的性能。

📄 摘要(原文)

Most existing memory-enhanced Large Language Model (LLM) approaches implicitly assume that memory validity can be established either through external evaluators that provide task-specific success signals or through internal model cognition, such as reflection, for editing memory entries. However, these assumptions often break down in practical environments with dynamic drifts. We propose the Global Verifier (GLOVE), a framework that introduces a new design dimension for LLM memory systems by establishing a relative notion of truth. Through active probing to detect inconsistencies between retrieved memories and fresh observations, GLOVE enables memory-environment realignment by verifying and updating memory without access to ground-truth supervision or strong reliance on model introspection. We evaluate GLOVE on diverse benchmarks spanning web navigation, planning, and control, augmented with controlled environmental drifts that introduce non-stationarity beyond the original benchmark settings. Our results show that GLOVE substantially improves agent success rates, suggesting a robust pathway to cognitive agents capable of self-evolving.