Bridging Visual and Wireless Sensing: A Unified Radiation Field for 3D Radio Map Construction

作者: Chaozheng Wen, Jingwen Tong, Zehong Lin, Chenghong Bian, Jun Zhang

分类: cs.NI, cs.AI, cs.CV, cs.LG

发布日期: 2026-01-27

备注: The code for this work will be publicly available at: https://github.com/wenchaozheng/URF-GS

💡 一句话要点

提出URF-GS框架,融合视觉与无线感知,构建精确可泛化的3D无线电地图

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D无线电地图 辐射场 3D高斯溅射 逆渲染 视觉无线融合

📋 核心要点

- 现有3D无线电地图构建方法未能充分利用光学和无线电传播的物理关联性,导致精度和泛化性受限。

- URF-GS框架融合视觉和无线感知数据,利用3D高斯溅射和逆渲染,统一建模光和无线电辐射场。

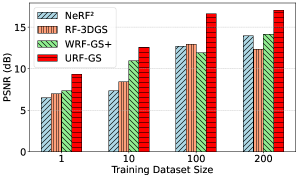

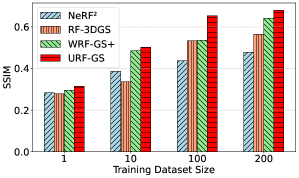

- 实验表明,URF-GS在空间频谱预测精度和样本效率方面显著优于NeRF等现有方法,提升幅度高达24.7%和10倍。

📝 摘要(中文)

下一代无线网络(如沉浸式3D通信、低空网络和集成感知与通信)的涌现,需要高保真环境智能。3D无线电地图已成为实现这一目标的关键工具,通过弥合物理环境和电磁信号传播之间的差距,实现频谱感知规划和环境感知。然而,构建精确的3D无线电地图需要精细的3D几何信息和对电磁波传播的深刻理解。现有方法通常将光学和无线知识视为不同的模态,未能利用光和电磁传播的基本物理原理。为了弥合这一差距,我们提出了URF-GS,一个统一的无线电-光学辐射场表示框架,用于基于3D高斯溅射(3D-GS)和逆渲染的精确和可泛化的3D无线电地图构建。通过融合视觉和无线感知观测,URF-GS恢复场景几何和材料属性,同时准确预测任意发射机-接收机(Tx-Rx)配置下的无线电信号行为。实验结果表明,与基于神经辐射场(NeRF)的方法相比,URF-GS在空间频谱预测精度方面提高了24.7%,在3D无线电地图构建的样本效率方面提高了10倍。这项工作通过整体辐射场重建整合感知、交互和通信,为下一代无线网络奠定了基础。

🔬 方法详解

问题定义:现有3D无线电地图构建方法通常将视觉信息和无线电信号传播信息视为独立的模态,缺乏对二者内在物理联系的建模。这导致模型在复杂环境中预测精度下降,泛化能力不足,且需要大量的样本数据进行训练。因此,如何有效地融合视觉和无线感知信息,构建精确且泛化性强的3D无线电地图是一个关键问题。

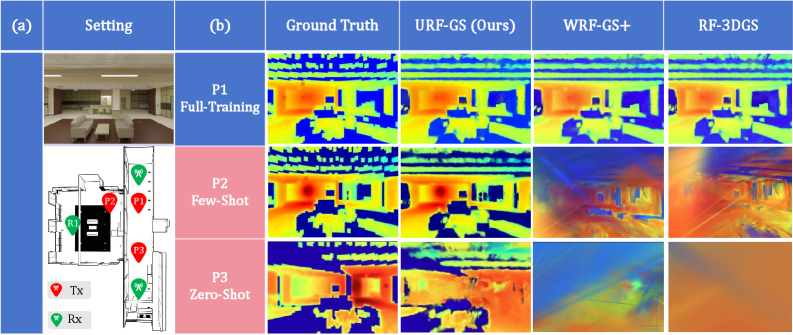

核心思路:URF-GS的核心思路是将光和无线电信号的传播统一建模为辐射场,利用3D高斯溅射(3D-GS)来表示场景的几何结构和材质属性,并通过逆渲染技术从视觉和无线感知数据中学习辐射场的参数。这种统一表示能够充分利用光和无线电信号传播的物理相似性,从而提高模型的预测精度和泛化能力。

技术框架:URF-GS框架主要包含以下几个模块:1) 数据采集模块:采集场景的视觉图像和无线电信号强度数据,包括不同位置的发射机和接收机配置下的信号强度测量值。2) 3D高斯溅射模块:使用3D高斯溅射表示场景的几何结构和材质属性,每个高斯分布表示场景中的一个局部区域。3) 辐射场建模模块:基于3D高斯溅射,建立统一的辐射场模型,该模型能够预测任意发射机-接收机配置下的无线电信号强度。4) 逆渲染优化模块:利用视觉图像和无线电信号强度数据,通过逆渲染技术优化3D高斯溅射的参数和辐射场模型,从而实现场景的重建和无线电信号传播的预测。

关键创新:URF-GS的关键创新在于提出了一个统一的无线电-光学辐射场表示框架,将视觉和无线感知信息融合到一个统一的模型中。与现有方法相比,URF-GS能够更好地利用光和无线电信号传播的物理相似性,从而提高模型的预测精度和泛化能力。此外,URF-GS还采用了3D高斯溅射技术,能够更有效地表示场景的几何结构和材质属性。

关键设计:URF-GS的关键设计包括:1) 使用3D高斯溅射表示场景的几何结构和材质属性,每个高斯分布的参数包括位置、协方差矩阵、颜色和透明度等。2) 建立统一的辐射场模型,该模型能够预测任意发射机-接收机配置下的无线电信号强度,模型参数包括每个高斯分布的辐射强度和方向性。3) 使用逆渲染技术优化3D高斯溅射的参数和辐射场模型,损失函数包括视觉图像的重建误差和无线电信号强度预测误差。4) 采用了一种自适应的采样策略,能够更有效地采集无线电信号强度数据,从而提高模型的训练效率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,URF-GS在空间频谱预测精度方面比基于NeRF的方法提高了24.7%,并且在3D无线电地图构建的样本效率方面提高了10倍。这表明URF-GS能够更精确地预测无线电信号的传播行为,并且能够使用更少的样本数据进行训练,从而降低了构建3D无线电地图的成本。

🎯 应用场景

URF-GS在下一代无线网络中具有广泛的应用前景,例如:1) 沉浸式3D通信:构建精确的3D无线电地图,优化无线通信链路,提高通信质量。2) 低空网络:为无人机等低空设备提供精确的无线电环境信息,实现智能导航和资源管理。3) 集成感知与通信:利用无线电信号进行环境感知,例如目标定位和跟踪,实现更智能的无线网络。

📄 摘要(原文)

The emerging applications of next-generation wireless networks (e.g., immersive 3D communication, low-altitude networks, and integrated sensing and communication) necessitate high-fidelity environmental intelligence. 3D radio maps have emerged as a critical tool for this purpose, enabling spectrum-aware planning and environment-aware sensing by bridging the gap between physical environments and electromagnetic signal propagation. However, constructing accurate 3D radio maps requires fine-grained 3D geometric information and a profound understanding of electromagnetic wave propagation. Existing approaches typically treat optical and wireless knowledge as distinct modalities, failing to exploit the fundamental physical principles governing both light and electromagnetic propagation. To bridge this gap, we propose URF-GS, a unified radio-optical radiation field representation framework for accurate and generalizable 3D radio map construction based on 3D Gaussian splatting (3D-GS) and inverse rendering. By fusing visual and wireless sensing observations, URF-GS recovers scene geometry and material properties while accurately predicting radio signal behavior at arbitrary transmitter-receiver (Tx-Rx) configurations. Experimental results demonstrate that URF-GS achieves up to a 24.7% improvement in spatial spectrum prediction accuracy and a 10x increase in sample efficiency for 3D radio map construction compared with neural radiance field (NeRF)-based methods. This work establishes a foundation for next-generation wireless networks by integrating perception, interaction, and communication through holistic radiation field reconstruction.