Multi-Agent Procedural Graph Extraction with Structural and Logical Refinement

作者: Wangyang Ying, Yanchi Liu, Xujiang Zhao, Wei Cheng, Zhengzhang Chen, Wenchao Yu, Yanjie Fu, Haifeng Chen

分类: cs.AI

发布日期: 2026-01-27

💡 一句话要点

提出多代理程序图提取框架以解决结构有效性与逻辑一致性问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 程序图提取 多代理系统 自然语言处理 结构优化 逻辑一致性

📋 核心要点

- 现有方法在从自然语言提取程序图时,常常面临结构不良和逻辑流误解的问题,导致提取结果的有效性不足。

- 本文提出的多代理框架通过多轮推理过程,结合结构和逻辑优化,旨在提高程序图提取的准确性和一致性。

- 实验结果显示,该框架在结构正确性和逻辑一致性方面显著优于现有强基线,验证了其有效性。

📝 摘要(中文)

自动从自然语言中提取工作流作为程序图是一项前景广阔但尚未充分探索的任务,要求具备结构有效性和逻辑一致性。尽管近期的大型语言模型在程序图提取中展现出潜力,但常常产生结构不良或逻辑流误解的问题。本文提出了 extit{model},一个多代理框架,将程序图提取形式化为多轮推理过程,包含专门的结构和逻辑优化。该框架分为三个阶段:图提取阶段、结构反馈阶段和逻辑反馈阶段。重要反馈以自然语言形式表达并注入后续提示中,从而实现可解释和可控的优化。实验表明, extit{model}在结构正确性和逻辑一致性方面相较于强基线有显著提升。

🔬 方法详解

问题定义:本文旨在解决从自然语言中提取程序图时的结构有效性和逻辑一致性问题。现有方法常常产生不良结构或误解逻辑流,影响提取结果的质量。

核心思路:论文提出的多代理框架通过多轮推理过程,分别针对结构和逻辑进行优化,确保提取结果的准确性和可解释性。这样的设计使得每个代理可以专注于特定类型的错误,而无需进行监督或参数更新。

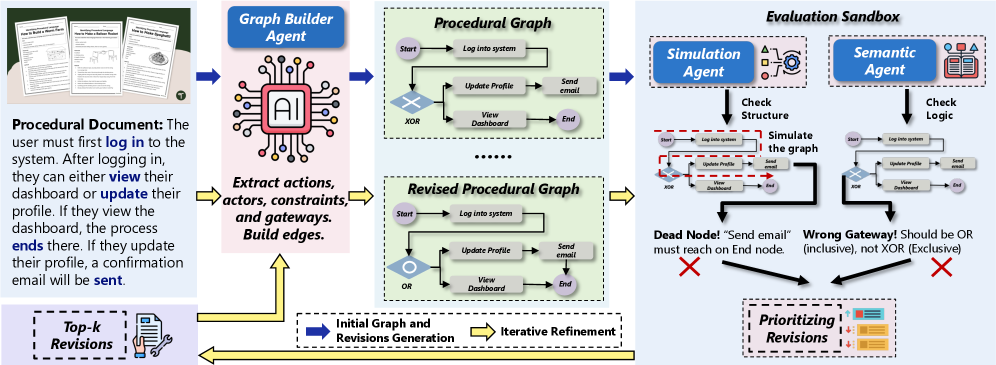

技术框架:整体框架分为三个主要阶段:第一阶段是图提取阶段,由图构建代理负责;第二阶段是结构反馈阶段,模拟代理诊断和解释结构缺陷;第三阶段是逻辑反馈阶段,语义代理对流逻辑与源文本中的语言线索进行语义对齐。

关键创新:最重要的创新在于将程序图提取过程模块化,使得不同代理能够独立处理特定错误类型,从而提高了提取的灵活性和准确性。这与现有方法的集中式处理方式有本质区别。

关键设计:框架中的反馈信息以自然语言形式表达,并注入到后续的提示中,增强了可解释性和可控性。具体的参数设置和损失函数设计未在摘要中详细说明,需参考完整论文以获取更多技术细节。

🖼️ 关键图片

📊 实验亮点

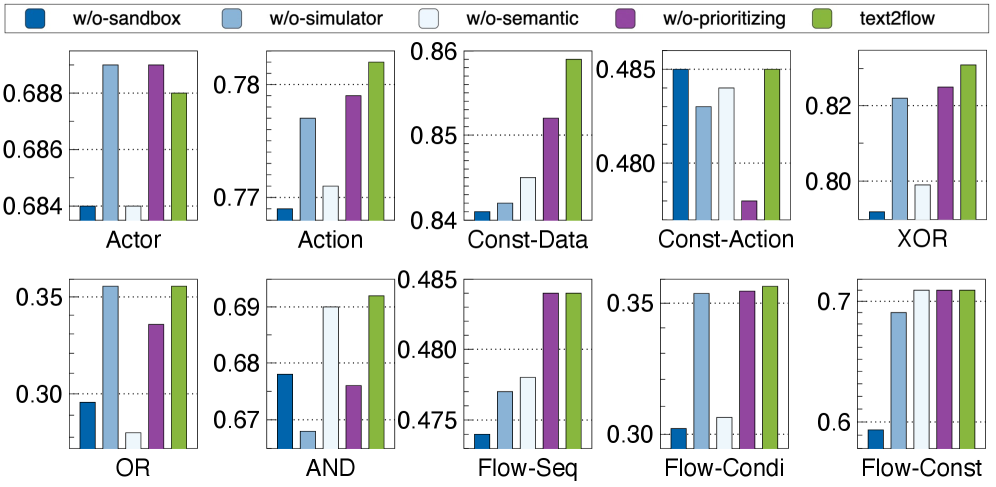

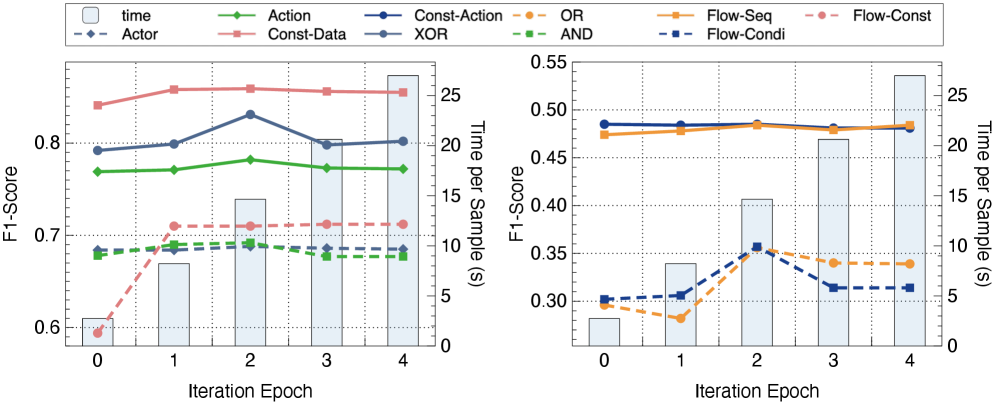

实验结果表明, extit{model}在结构正确性和逻辑一致性方面相较于强基线有显著提升,具体性能数据未在摘要中提供,需参考完整论文以获取详细信息。

🎯 应用场景

该研究的潜在应用领域包括自动化工作流生成、智能助手、以及自然语言处理中的信息提取等。通过提高程序图提取的准确性和一致性,能够为各类智能系统提供更可靠的支持,进而推动相关领域的发展。

📄 摘要(原文)

Automatically extracting workflows as procedural graphs from natural language is promising yet underexplored, demanding both structural validity and logical alignment. While recent large language models (LLMs) show potential for procedural graph extraction, they often produce ill-formed structures or misinterpret logical flows. We present \model{}, a multi-agent framework that formulates procedural graph extraction as a multi-round reasoning process with dedicated structural and logical refinement. The framework iterates through three stages: (1) a graph extraction phase with the graph builder agent, (2) a structural feedback phase in which a simulation agent diagnoses and explains structural defects, and (3) a logical feedback phase in which a semantic agent aligns semantics between flow logic and linguistic cues in the source text. Important feedback is prioritized and expressed in natural language, which is injected into subsequent prompts, enabling interpretable and controllable refinement. This modular design allows agents to target distinct error types without supervision or parameter updates. Experiments demonstrate that \model{} achieves substantial improvements in both structural correctness and logical consistency over strong baselines.