A Balanced Neuro-Symbolic Approach for Commonsense Abductive Logic

作者: Joseph Cotnareanu, Didier Chetelat, Yingxue Zhang, Mark Coates

分类: cs.AI, cs.LG

发布日期: 2026-01-26

💡 一句话要点

提出一种平衡神经符号的归纳逻辑方法,提升常识推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 神经符号推理 常识推理 大型语言模型 逻辑求解器 归纳逻辑

📋 核心要点

- 大型语言模型在复杂推理中面临挑战,尤其是在缺乏必要常识知识的情况下。

- 该方法利用逻辑求解器的反馈,迭代地用大型语言模型提供的常识知识来增强逻辑问题。

- 实验表明,该方法在常识缺失的逻辑推理数据集上显著优于现有技术。

📝 摘要(中文)

大型语言模型(LLM)在形式推理方面表现出令人印象深刻的能力,但在需要复杂证明规划的问题上常常失效。一种有前景的改进LLM推理能力的方法是将问题转化为形式逻辑并使用逻辑求解器。虽然现成的逻辑求解器在逻辑推理方面原则上比LLM更有效,但它们假设所有相关事实都在问题中提供,并且无法处理缺失的常识关系。本文提出了一种新方法,该方法使用来自逻辑求解器的反馈,以迭代方式用LLM提供的常识关系来扩充逻辑问题。这涉及通过潜在的常识假设进行搜索,以最大化找到有用事实的机会,同时保持成本可控。在一系列纯逻辑推理数据集上,从中移除了一些常识信息,我们的方法始终比现有技术取得了显著的改进,证明了在人类环境中工作时平衡神经和符号元素的价值。

🔬 方法详解

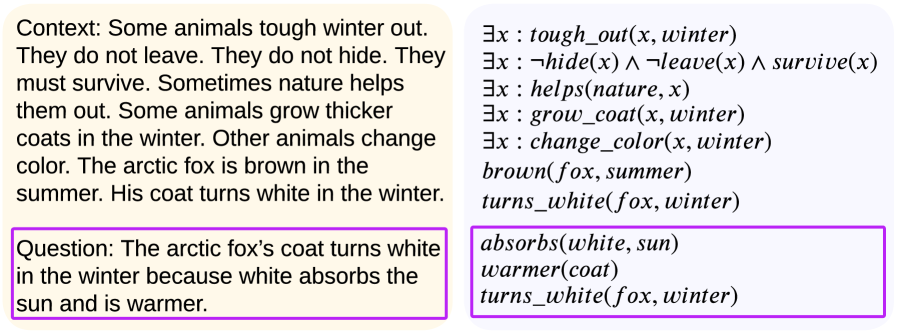

问题定义:论文旨在解决大型语言模型(LLM)在进行复杂逻辑推理时,由于缺乏常识知识而表现不佳的问题。现有的逻辑求解器虽然在逻辑推理上效率很高,但它们依赖于问题中提供所有相关事实,无法处理缺失常识关系的情况。这限制了它们在现实世界问题中的应用,因为现实世界的问题通常需要补充常识知识才能解决。

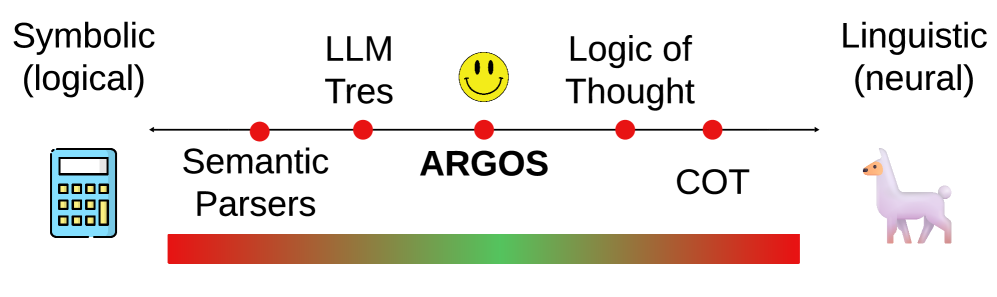

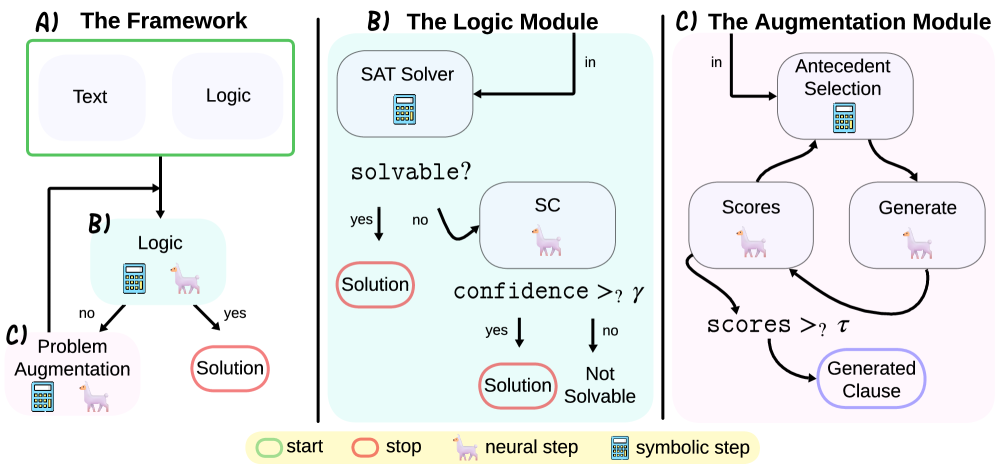

核心思路:论文的核心思路是结合神经方法(LLM)和符号方法(逻辑求解器)的优点,构建一个平衡的神经符号系统。具体来说,利用LLM的常识知识来补充逻辑问题,并使用逻辑求解器来验证和指导LLM的常识推理。通过迭代地添加常识假设,直到逻辑问题可以被求解,从而提高推理的准确性和效率。

技术框架:该方法包含以下主要模块:1) 逻辑问题编码:将问题转化为形式逻辑表示。2) LLM常识生成:利用LLM生成可能的常识假设。3) 逻辑求解器验证:使用逻辑求解器验证添加常识假设后的逻辑问题是否可解。4) 反馈与迭代:根据逻辑求解器的结果,调整LLM的常识生成策略,并重复迭代过程,直到找到可行的解决方案或达到最大迭代次数。

关键创新:该方法最重要的创新点在于它使用逻辑求解器的反馈来指导LLM的常识推理。这种反馈机制可以有效地过滤掉不相关的或错误的常识假设,并引导LLM生成更有用的常识知识。与传统的神经符号方法相比,该方法更加灵活和高效,因为它不需要预先定义所有的常识规则。

关键设计:该方法的关键设计包括:1) 常识假设的搜索策略:如何有效地搜索可能的常识假设,以最大化找到有用事实的机会,同时保持计算成本可控。2) LLM的提示工程:如何设计合适的提示,以引导LLM生成高质量的常识知识。3) 逻辑求解器的选择:选择合适的逻辑求解器,以保证推理的效率和准确性。4) 迭代停止条件:如何确定何时停止迭代过程,以避免过度搜索。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在常识缺失的逻辑推理数据集上取得了显著的改进。与现有技术相比,该方法能够更有效地利用LLM的常识知识,并提高推理的准确性和效率。具体的性能数据和对比基线在论文中进行了详细的描述。

🎯 应用场景

该研究成果可应用于需要常识推理的各种领域,例如问答系统、对话系统、智能助手和机器人。通过提高机器的常识推理能力,可以使其更好地理解人类的意图,并做出更合理的决策。未来,该方法有望扩展到更复杂的推理任务,并与其他知识表示和推理技术相结合,构建更强大的智能系统。

📄 摘要(原文)

Although Large Language Models (LLMs) have demonstrated impressive formal reasoning abilities, they often break down when problems require complex proof planning. One promising approach for improving LLM reasoning abilities involves translating problems into formal logic and using a logic solver. Although off-the-shelf logic solvers are in principle substantially more efficient than LLMs at logical reasoning, they assume that all relevant facts are provided in a question and are unable to deal with missing commonsense relations. In this work, we propose a novel method that uses feedback from the logic solver to augment a logic problem with commonsense relations provided by the LLM, in an iterative manner. This involves a search procedure through potential commonsense assumptions to maximize the chance of finding useful facts while keeping cost tractable. On a collection of pure-logical reasoning datasets, from which some commonsense information has been removed, our method consistently achieves considerable improvements over existing techniques, demonstrating the value in balancing neural and symbolic elements when working in human contexts.