Reasoning Promotes Robustness in Theory of Mind Tasks

作者: Ian B. de Haan, Peter van der Putten, Max van Duijn

分类: cs.AI, cs.CL

发布日期: 2026-01-23

备注: 14 pages, 2 figures

💡 一句话要点

利用推理提升大语言模型在心理理论任务中的鲁棒性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 心理理论 大语言模型 强化学习 鲁棒性 推理能力

📋 核心要点

- 现有大语言模型在心理理论任务中表现出色,但其能力的本质和真实水平仍存在争议。

- 论文研究了通过强化学习训练的、面向推理的大语言模型在心理理论任务中的表现,并分析其鲁棒性。

- 实验表明,推理模型在面对提示变化和任务扰动时,表现出更强的鲁棒性,提升来源于找到正确解的能力。

📝 摘要(中文)

大型语言模型(LLM)最近在心理理论(ToM)测试中表现出强大的性能,引发了关于其底层能力本质和真实性能的争论。与此同时,通过可验证奖励的强化学习(RLVR)训练的面向推理的LLM在一系列基准测试中取得了显著的改进。本文通过对机器心理实验的新颖改编以及来自已建立基准测试的结果,研究了这种推理模型在ToM任务中的行为。我们观察到,推理模型在提示变化和任务扰动方面始终表现出更高的鲁棒性。我们的分析表明,观察到的收益更可能归因于在找到正确解决方案方面的鲁棒性提高,而不是归因于根本上新的ToM推理形式。我们讨论了这种解释对评估LLM中的社会认知行为的影响。

🔬 方法详解

问题定义:论文旨在研究大型语言模型在心理理论(ToM)任务中的表现,特别是关注模型在面对prompt变化和任务扰动时的鲁棒性。现有方法虽然在ToM任务上取得了进展,但其真实的推理能力和泛化能力仍然受到质疑,容易受到prompt的影响,缺乏稳定性。

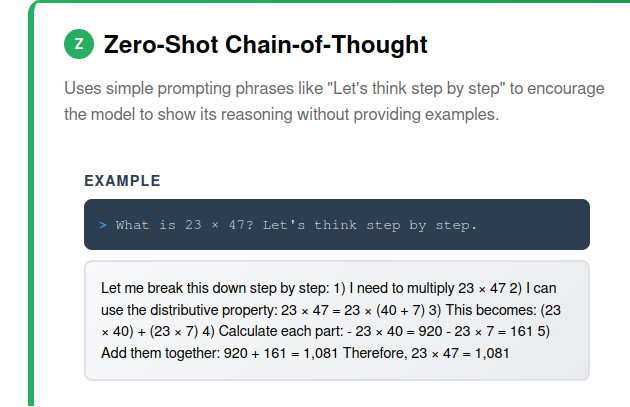

核心思路:论文的核心思路是利用通过可验证奖励的强化学习(RLVR)训练的、面向推理的大语言模型,来提升模型在ToM任务中的鲁棒性。通过强化学习,模型能够学习到更可靠的推理策略,从而更好地应对不同的prompt和任务变化。

技术框架:论文采用了一种基于强化学习的训练框架,该框架使用可验证的奖励信号来指导模型的学习过程。具体来说,模型首先接收一个ToM任务的描述,然后生成一个推理过程,最后输出答案。奖励信号基于答案的正确性以及推理过程的合理性。通过不断地迭代训练,模型能够学习到更有效的推理策略。

关键创新:论文的关键创新在于将面向推理的强化学习模型应用于心理理论任务,并证明了这种方法可以显著提高模型在面对prompt变化和任务扰动时的鲁棒性。此外,论文还对模型获得的收益进行了深入分析,认为这些收益更可能归因于找到正确解决方案的能力的提高,而不是根本上新的ToM推理形式。

关键设计:论文使用了特定的prompt模板来生成不同的ToM任务,并设计了相应的奖励函数来指导模型的学习。奖励函数包括正确性奖励和推理过程奖励,其中正确性奖励基于答案的正确性,推理过程奖励基于推理过程的合理性。具体的网络结构和参数设置在论文中未详细说明,属于未知信息。

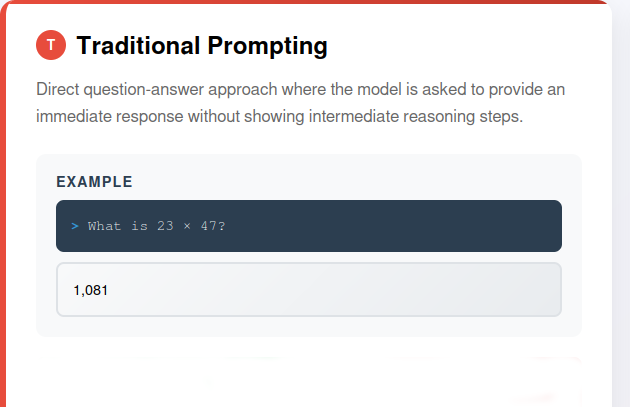

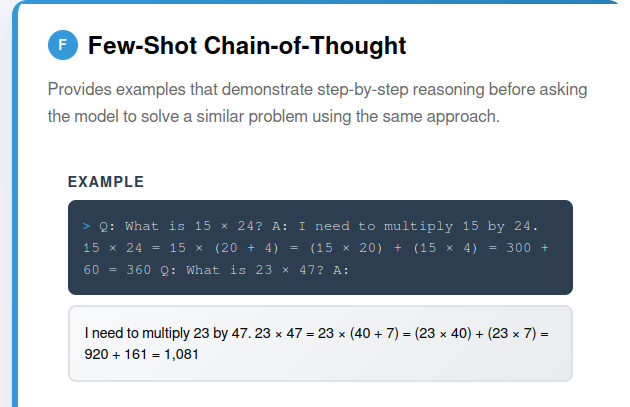

🖼️ 关键图片

📊 实验亮点

实验结果表明,通过强化学习训练的推理模型在心理理论任务中表现出更高的鲁棒性,能够更好地应对prompt变化和任务扰动。具体性能数据和对比基线在论文中未详细说明,属于未知信息。但总体而言,该研究证明了推理能力对于提升模型在社会认知任务中的表现至关重要。

🎯 应用场景

该研究成果可应用于开发更可靠、更鲁棒的人工智能系统,尤其是在需要进行复杂推理和理解人类意图的场景中,例如人机交互、智能助手、教育和医疗等领域。通过提升模型在心理理论任务中的表现,可以使其更好地理解人类行为,从而提供更个性化、更有效的服务。

📄 摘要(原文)

Large language models (LLMs) have recently shown strong performance on Theory of Mind (ToM) tests, prompting debate about the nature and true performance of the underlying capabilities. At the same time, reasoning-oriented LLMs trained via reinforcement learning with verifiable rewards (RLVR) have achieved notable improvements across a range of benchmarks. This paper examines the behavior of such reasoning models in ToM tasks, using novel adaptations of machine psychological experiments and results from established benchmarks. We observe that reasoning models consistently exhibit increased robustness to prompt variations and task perturbations. Our analysis indicates that the observed gains are more plausibly attributed to increased robustness in finding the correct solution, rather than to fundamentally new forms of ToM reasoning. We discuss the implications of this interpretation for evaluating social-cognitive behavior in LLMs.