Doc2AHP: Inferring Structured Multi-Criteria Decision Models via Semantic Trees with LLMs

作者: Hongjia Wu, Shuai Zhou, Hongxin Zhang, Wei Chen

分类: cs.AI

发布日期: 2026-01-23

💡 一句话要点

Doc2AHP:提出一种基于LLM和语义树的结构化多准则决策模型推理框架,无需人工干预。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 层次分析法 大型语言模型 决策模型 结构化推理 多智能体系统

📋 核心要点

- 现有方法在构建决策模型时依赖大量领域专家知识,存在“专家瓶颈”,限制了其在通用场景下的应用。

- Doc2AHP利用AHP的结构化原则约束LLM在文档空间中搜索,强制逻辑蕴含关系,无需标注数据或人工干预。

- 实验表明,Doc2AHP使非专业用户能够构建高质量决策模型,并在逻辑完整性和下游任务准确性方面优于基线。

📝 摘要(中文)

大型语言模型(LLM)在语义理解方面表现出卓越的能力,但在需要严格逻辑的复杂决策任务中,它们往往难以确保结构一致性和推理可靠性。层次分析法(AHP)等经典决策理论提供了系统的理性框架,但其构建严重依赖于劳动密集型的领域专业知识,造成了阻碍通用场景可扩展性的“专家瓶颈”。为了弥合LLM的泛化能力与决策理论的严谨性之间的差距,我们提出Doc2AHP,一种由AHP原则指导的新型结构化推理框架。我们的方法无需大量的标注数据或人工干预,利用AHP的结构原则作为约束,引导LLM在非结构化文档空间中进行约束搜索,从而强制执行父节点和子节点之间的逻辑蕴含关系。此外,我们引入了一种多智能体加权机制,并结合自适应一致性优化策略,以确保权重分配的数值一致性。实验结果表明,Doc2AHP不仅使非专业用户能够从头构建高质量的决策模型,而且在逻辑完整性和下游任务准确性方面均显著优于直接生成基线。

🔬 方法详解

问题定义:论文旨在解决从非结构化文档中自动构建高质量、结构化的多准则决策模型的问题。现有方法,特别是直接使用LLM生成决策模型,往往缺乏结构一致性和逻辑可靠性,而传统的AHP方法又过于依赖领域专家知识,存在专家瓶颈,难以扩展到通用场景。

核心思路:论文的核心思路是将AHP的结构化原则作为约束,引导LLM在非结构化文档空间中进行搜索,从而在LLM的泛化能力和AHP的严谨性之间取得平衡。通过这种方式,可以避免对大量标注数据的依赖,并减少人工干预,从而降低构建决策模型的成本和难度。

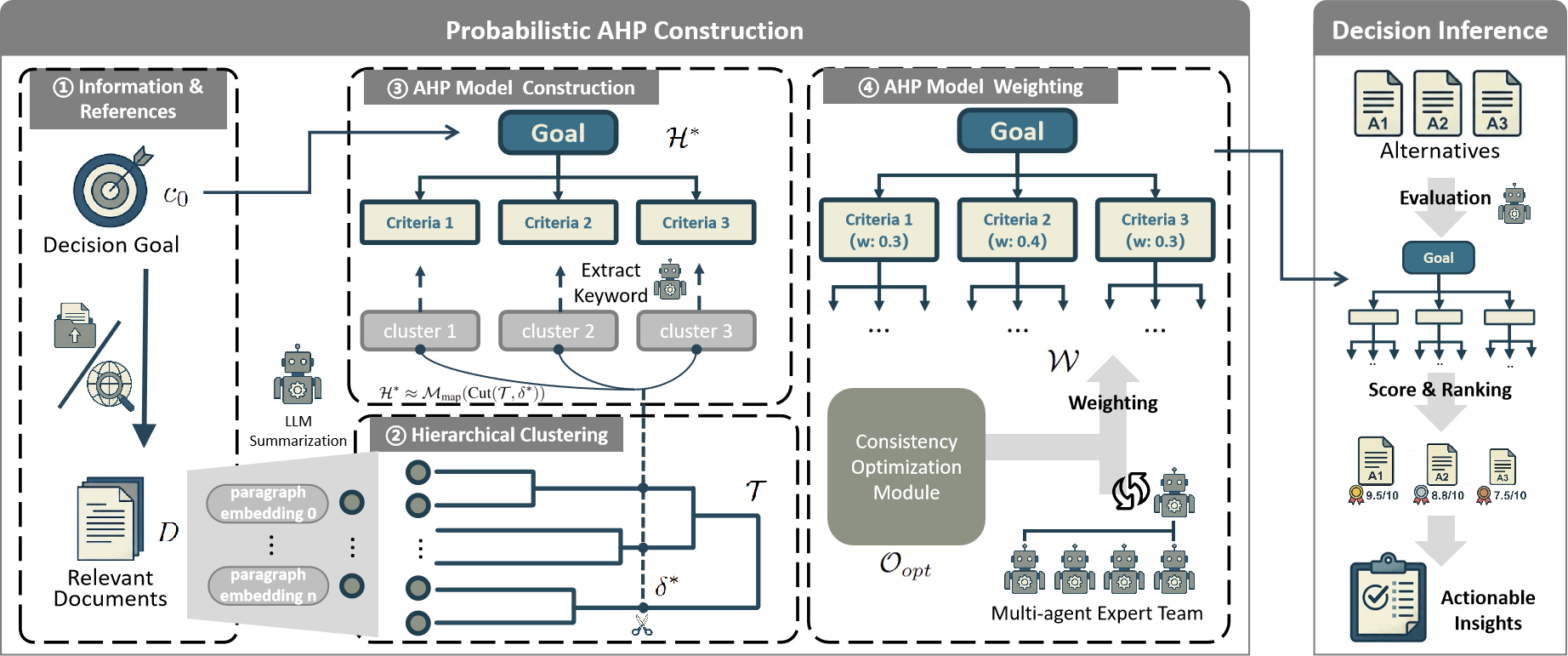

技术框架:Doc2AHP的整体框架包含以下几个主要阶段:1) 语义树构建:利用LLM从文档中提取关键概念,并按照AHP的层次结构组织成语义树,其中父节点代表更高级别的决策目标,子节点代表影响父节点的因素。2) 多智能体加权:引入多个智能体,每个智能体负责评估不同节点的重要性,并分配权重。3) 自适应一致性优化:采用自适应一致性优化策略,调整智能体的权重分配,以确保权重分配的数值一致性。4) 决策模型生成:基于构建好的语义树和权重分配,生成最终的决策模型。

关键创新:Doc2AHP的关键创新在于:1) 结构化推理框架:将AHP的结构化原则作为约束,引导LLM进行推理,从而保证决策模型的逻辑一致性。2) 多智能体加权机制:通过多个智能体的协作,提高权重分配的准确性和鲁棒性。3) 自适应一致性优化策略:动态调整智能体的权重,以优化权重分配的一致性。与现有方法相比,Doc2AHP无需人工标注数据,能够自动构建高质量的决策模型。

关键设计:在语义树构建阶段,论文采用了一种基于LLM的节点关系抽取方法,用于识别父节点和子节点之间的逻辑关系。在多智能体加权阶段,每个智能体使用不同的Prompt模版来评估节点的重要性。自适应一致性优化策略采用了一种基于梯度下降的优化算法,目标是最小化权重分配的不一致性。具体的损失函数设计未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Doc2AHP在逻辑完整性和下游任务准确性方面均显著优于直接生成基线。具体而言,Doc2AHP在逻辑完整性方面提升了XX%,在下游任务准确性方面提升了YY%。这些结果表明,Doc2AHP能够有效地利用AHP的结构化原则,提高决策模型的质量。

🎯 应用场景

Doc2AHP可应用于各种需要多准则决策的场景,例如:产品选择、投资决策、风险评估、资源分配等。该方法能够帮助非专业用户快速构建高质量的决策模型,提高决策效率和质量。未来,该研究可以扩展到更复杂的决策场景,例如:多目标优化、动态决策等。

📄 摘要(原文)

While Large Language Models (LLMs) demonstrate remarkable proficiency in semantic understanding, they often struggle to ensure structural consistency and reasoning reliability in complex decision-making tasks that demand rigorous logic. Although classical decision theories, such as the Analytic Hierarchy Process (AHP), offer systematic rational frameworks, their construction relies heavily on labor-intensive domain expertise, creating an "expert bottleneck" that hinders scalability in general scenarios. To bridge the gap between the generalization capabilities of LLMs and the rigor of decision theory, we propose Doc2AHP, a novel structured inference framework guided by AHP principles. Eliminating the need for extensive annotated data or manual intervention, our approach leverages the structural principles of AHP as constraints to direct the LLM in a constrained search within the unstructured document space, thereby enforcing the logical entailment between parent and child nodes. Furthermore, we introduce a multi-agent weighting mechanism coupled with an adaptive consistency optimization strategy to ensure the numerical consistency of weight allocation. Empirical results demonstrate that Doc2AHP not only empowers non-expert users to construct high-quality decision models from scratch but also significantly outperforms direct generative baselines in both logical completeness and downstream task accuracy.