Deja Vu in Plots: Leveraging Cross-Session Evidence with Retrieval-Augmented LLMs for Live Streaming Risk Assessment

作者: Yiran Qiao, Xiang Ao, Jing Chen, Yang Liu, Qiwei Zhong, Qing He

分类: cs.AI

发布日期: 2026-01-22

💡 一句话要点

提出CS-VAR,利用检索增强LLM进行直播风险跨会话证据感知评估

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 直播风险评估 跨会话学习 检索增强 大型语言模型 知识蒸馏

📋 核心要点

- 现有直播风险检测方法难以捕捉跨会话的关联性和渐进式风险演变,导致检测效果不佳。

- CS-VAR利用检索增强的LLM,从历史会话中检索相关证据,辅助轻量级模型进行风险评估,实现知识迁移。

- 实验表明,CS-VAR在大型工业数据集上取得了SOTA性能,并能提供可解释的风险信号,提升审核效率。

📝 摘要(中文)

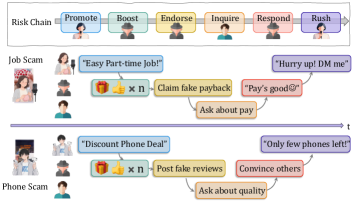

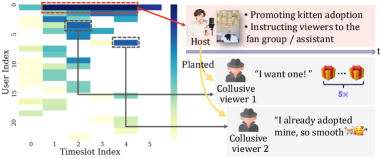

直播的兴起改变了在线互动方式,实现了大规模的实时参与,但也使平台面临诈骗和协同恶意行为等复杂风险。检测这些风险具有挑战性,因为有害行为通常会逐渐累积,并在看似无关的直播间中重复出现。为了解决这个问题,我们提出了CS-VAR(跨会话证据感知检索增强检测器)用于直播风险评估。在CS-VAR中,一个轻量级的、特定领域的模型执行快速的会话级别风险推断,并在训练期间由大型语言模型(LLM)指导,该LLM对检索到的跨会话行为证据进行推理,并将其局部到全局的洞察力转移到小型模型。这种设计使小型模型能够识别跨直播间重复出现的模式,执行结构化的风险评估,并保持实时部署的效率。大规模工业数据集上的广泛离线实验以及在线验证表明了CS-VAR的先进性能。此外,CS-VAR提供了可解释的、本地化的信号,有效地支持了直播的实际审核。

🔬 方法详解

问题定义:直播平台面临着日益严峻的风险,例如诈骗和协同恶意行为。这些风险往往不是孤立发生的,而是在不同的直播会话中逐渐积累和重复出现。现有的风险检测方法通常只关注单个会话内的信息,忽略了跨会话的关联性,难以有效识别这些渐进式风险。

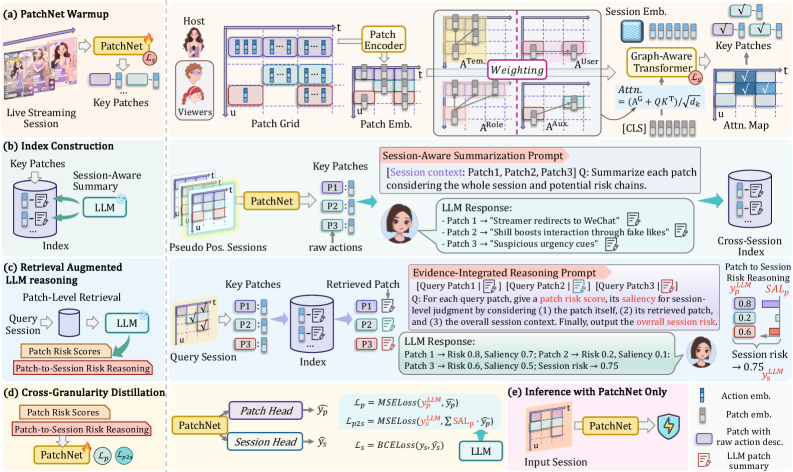

核心思路:CS-VAR的核心思路是利用大型语言模型(LLM)的推理能力,结合跨会话检索到的行为证据,来指导一个轻量级模型进行风险评估。通过检索与当前会话相似的历史会话,并利用LLM对这些历史会话进行分析,提取出潜在的风险模式和关联性,从而提升轻量级模型的风险识别能力。这样既能利用LLM的强大推理能力,又能保证实时部署的效率。

技术框架:CS-VAR的整体框架包含以下几个主要模块:1) 会话表示模块:将直播会话中的文本、图像、用户行为等信息编码成向量表示。2) 跨会话检索模块:根据当前会话的表示,从历史会话库中检索出相似的会话。3) LLM推理模块:利用LLM对检索到的历史会话进行分析,提取风险相关的证据和模式。4) 轻量级风险评估模块:利用LLM提供的证据,对当前会话进行风险评估,输出风险等级和解释。

关键创新:CS-VAR最重要的创新点在于将检索增强和LLM推理相结合,用于直播风险评估。传统的风险检测方法通常依赖于人工设计的特征或简单的机器学习模型,难以捕捉复杂的跨会话关联性。CS-VAR通过检索相似的历史会话,并利用LLM进行推理,能够有效地识别这些关联性,从而提升风险检测的准确性和召回率。此外,通过知识蒸馏,将LLM的知识迁移到轻量级模型,保证了实时部署的效率。

关键设计:在会话表示方面,论文采用了多模态融合的方法,将文本、图像和用户行为等信息进行整合。在跨会话检索方面,使用了基于向量相似度的检索方法,并采用了一些优化策略来提高检索效率。在LLM推理方面,设计了特定的prompt,引导LLM提取风险相关的证据和模式。在轻量级风险评估方面,使用了简单的神经网络结构,并采用知识蒸馏的方法,将LLM的知识迁移到该模型。

🖼️ 关键图片

📊 实验亮点

CS-VAR在大型工业数据集上进行了离线实验和在线验证,结果表明其性能优于现有的基线方法。具体而言,CS-VAR在风险检测的准确率和召回率方面均取得了显著提升,并且能够提供可解释的风险信号,帮助审核人员快速定位和处理风险事件。在线验证结果也表明,CS-VAR能够有效地降低平台的风险事件发生率。

🎯 应用场景

CS-VAR可应用于各种直播平台,用于实时检测和预防各类风险行为,如诈骗、恶意营销、违规内容等。该技术能够有效提升平台的风险防控能力,保障用户体验,维护平台生态安全。未来,该技术还可以扩展到其他在线社交平台,用于检测和预防各类网络欺诈和恶意行为。

📄 摘要(原文)

The rise of live streaming has transformed online interaction, enabling massive real-time engagement but also exposing platforms to complex risks such as scams and coordinated malicious behaviors. Detecting these risks is challenging because harmful actions often accumulate gradually and recur across seemingly unrelated streams. To address this, we propose CS-VAR (Cross-Session Evidence-Aware Retrieval-Augmented Detector) for live streaming risk assessment. In CS-VAR, a lightweight, domain-specific model performs fast session-level risk inference, guided during training by a Large Language Model (LLM) that reasons over retrieved cross-session behavioral evidence and transfers its local-to-global insights to the small model. This design enables the small model to recognize recurring patterns across streams, perform structured risk assessment, and maintain efficiency for real-time deployment. Extensive offline experiments on large-scale industrial datasets, combined with online validation, demonstrate the state-of-the-art performance of CS-VAR. Furthermore, CS-VAR provides interpretable, localized signals that effectively empower real-world moderation for live streaming.