ErrorMap and ErrorAtlas: Charting the Failure Landscape of Large Language Models

作者: Shir Ashury-Tahan, Yifan Mai, Elron Bandel, Michal Shmueli-Scheuer, Leshem Choshen

分类: cs.AI, cs.CL

发布日期: 2026-01-22

💡 一句话要点

提出ErrorMap和ErrorAtlas,用于剖析大语言模型失败原因并构建错误分类体系。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 错误分析 模型评测 ErrorMap ErrorAtlas 失败原因 模型调试

📋 核心要点

- 现有LLM评测基准缺乏对模型失败原因的细致分析,无法有效指导模型改进。

- ErrorMap通过提取模型“失败签名”,分析失败来源,从而更准确地评估模型能力。

- ErrorAtlas构建了模型错误分类体系,揭示了LLM研究中未被充分探索的错误类型。

📝 摘要(中文)

大语言模型(LLM)的评测基准告诉我们模型何时失败,但没有说明失败的原因。在推理数据集上的错误答案可能源于格式问题、计算错误或数据集噪声,而并非推理能力不足。若不区分这些原因,评测基准是不完整的,无法可靠地指导模型改进。我们引入ErrorMap,这是首个用于分析LLM失败来源的方法。它提取模型独特的“失败签名”,阐明评测基准的衡量标准,并扩展错误识别范围以减少盲点。这有助于开发者调试模型,使评测基准目标与结果对齐,并支持明智的模型选择。ErrorMap适用于任何模型或数据集。我们将该方法应用于35个数据集和83个模型,生成ErrorAtlas,一个模型错误分类体系,揭示了重复出现的失败模式。ErrorAtlas突出了LLM研究中目前未被充分探索的错误类型,例如输出中缺少必要细节和问题误解。通过将重点从模型成功的地方转移到模型失败的原因,ErrorMap和ErrorAtlas实现了高级评估——揭示隐藏的弱点并指导进步。与通常由任务级指标衡量的成功不同,我们的方法引入了一个更深层次的评估层,可以全局应用于模型和任务,从而更深入地了解模型的行为和局限性。我们将公开分类体系和代码,并计划随着新基准和模型的出现定期更新ErrorAtlas。

🔬 方法详解

问题定义:论文旨在解决大语言模型评测中,仅仅关注模型成功率而忽略失败原因的问题。现有评测方法无法区分由于推理能力不足导致的失败,还是由于格式错误、计算错误或数据集噪声等其他因素导致的失败。这种模糊性使得评测结果难以指导模型改进,开发者难以针对性地调试模型。

核心思路:论文的核心思路是通过构建ErrorMap和ErrorAtlas,对LLM的失败原因进行系统性的分析和分类。ErrorMap用于提取每个模型在特定数据集上的“失败签名”,即模型特有的错误模式。ErrorAtlas则是一个通用的错误分类体系,用于对各种模型的失败原因进行归类和总结。通过分析失败原因,可以更准确地评估模型的能力,并为模型改进提供更具体的指导。

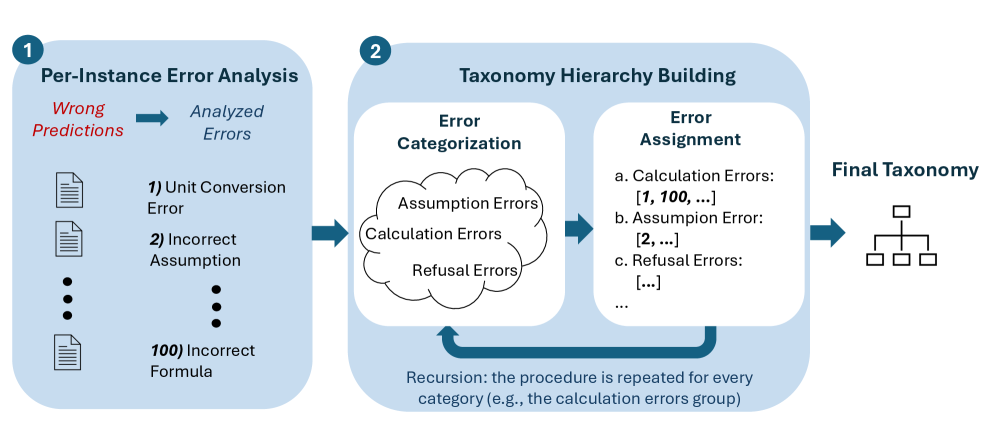

技术框架:ErrorMap和ErrorAtlas的构建流程如下: 1. 数据收集:收集LLM在各种数据集上的预测结果和真实标签。 2. 错误标注:人工或自动地对模型的错误进行标注,标注其属于ErrorAtlas中的哪种错误类型。 3. ErrorMap构建:对于每个模型和数据集,统计各种错误类型的出现频率,形成ErrorMap,即模型的“失败签名”。 4. ErrorAtlas更新:随着新模型和数据集的出现,不断更新ErrorAtlas,完善错误分类体系。

关键创新:论文最重要的创新点在于提出了ErrorMap和ErrorAtlas的概念,并将其应用于LLM的评测。与传统的只关注成功率的评测方法相比,ErrorMap和ErrorAtlas能够更深入地分析模型的失败原因,从而为模型改进提供更有效的指导。此外,ErrorAtlas作为一个通用的错误分类体系,可以促进不同模型和数据集之间的比较和分析。

关键设计:ErrorAtlas的设计是关键。论文中ErrorAtlas的具体分类标准和层级结构未知,但可以推测其设计需要考虑以下因素: * 错误类型的完备性:ErrorAtlas需要覆盖尽可能多的LLM可能出现的错误类型。 * 错误类型的互斥性:不同的错误类型之间应该尽可能互斥,避免出现歧义。 * 错误类型的可解释性:ErrorAtlas中的错误类型应该易于理解和标注。

🖼️ 关键图片

📊 实验亮点

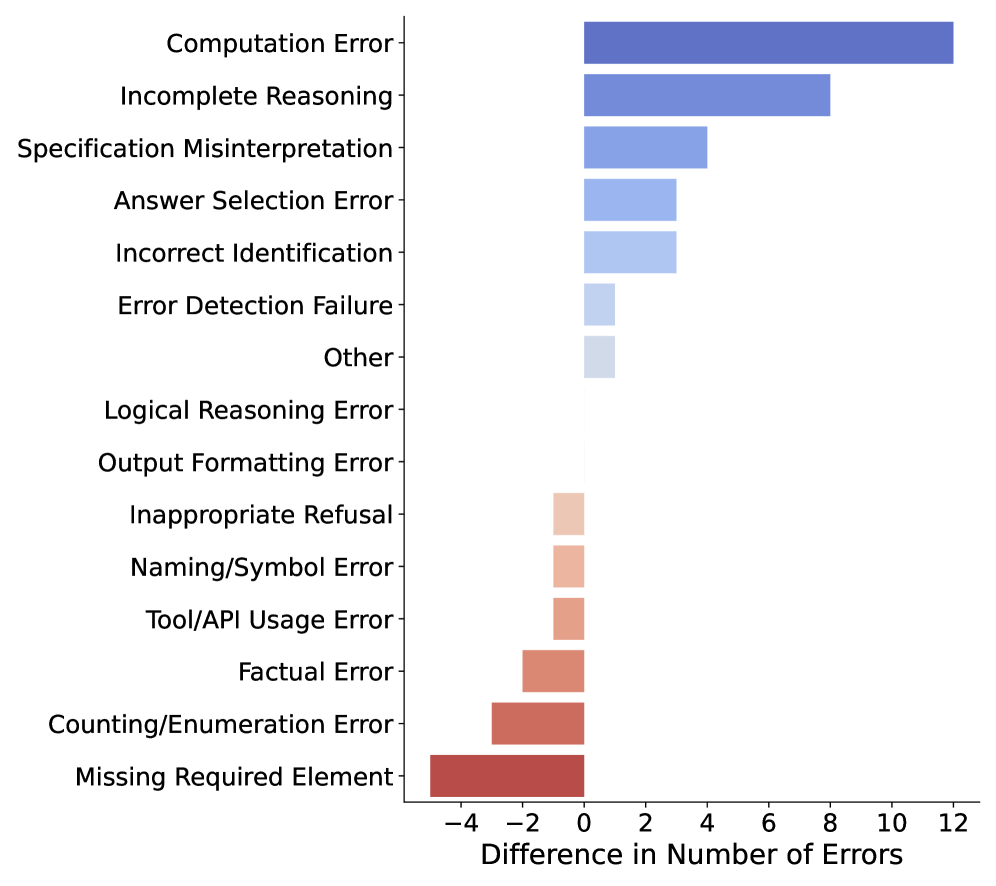

论文通过对35个数据集和83个模型进行实验,构建了ErrorAtlas,揭示了LLM中常见的错误类型,例如输出中缺少必要细节和问题误解。这些发现表明,LLM研究需要更加关注这些未被充分探索的错误类型,从而更有效地提升模型性能。

🎯 应用场景

该研究成果可应用于大语言模型的开发、评测和调试。开发者可以利用ErrorMap识别模型的弱点,并针对性地进行改进。评测机构可以使用ErrorAtlas对模型进行更全面的评估,避免只关注成功率的片面性。此外,该研究还可以促进LLM研究领域的交流和合作,推动LLM技术的进步。

📄 摘要(原文)

Large Language Models (LLM) benchmarks tell us when models fail, but not why they fail. A wrong answer on a reasoning dataset may stem from formatting issues, calculation errors, or dataset noise rather than weak reasoning. Without disentangling such causes, benchmarks remain incomplete and cannot reliably guide model improvement. We introduce ErrorMap, the first method to chart the sources of LLM failure. It extracts a model's unique "failure signature", clarifies what benchmarks measure, and broadens error identification to reduce blind spots. This helps developers debug models, aligns benchmark goals with outcomes, and supports informed model selection. ErrorMap works on any model or dataset with the same logic. Applying our method to 35 datasets and 83 models we generate ErrorAtlas, a taxonomy of model errors, revealing recurring failure patterns. ErrorAtlas highlights error types that are currently underexplored in LLM research, such as omissions of required details in the output and question misinterpretation. By shifting focus from where models succeed to why they fail, ErrorMap and ErrorAtlas enable advanced evaluation - one that exposes hidden weaknesses and directs progress. Unlike success, typically measured by task-level metrics, our approach introduces a deeper evaluation layer that can be applied globally across models and tasks, offering richer insights into model behavior and limitations. We make the taxonomy and code publicly available with plans to periodically update ErrorAtlas as new benchmarks and models emerge.