The Plausibility Trap: Using Probabilistic Engines for Deterministic Tasks

作者: Ivan Carrera, Daniel Maldonado-Ruiz

分类: cs.AI, cs.CL

发布日期: 2026-01-21

💡 一句话要点

提出工具选择工程以解决概率引擎在确定性任务中的低效问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 可信度陷阱 工具选择工程 确定性任务 概率引擎 数字素养 效率税 生成式AI

📋 核心要点

- 核心问题:现有方法在简单确定性任务中使用昂贵的概率引擎,导致资源浪费和效率低下。

- 方法要点:提出工具选择工程和确定性-概率决策矩阵,帮助开发者判断使用生成式AI的时机。

- 实验或效果:通过微基准测试,量化了约6.5倍的延迟惩罚,揭示了算法迎合的风险。

📝 摘要(中文)

大型语言模型(LLMs)的普及正在推动一种范式转变,即用户便利性超越计算效率。本文定义了“可信度陷阱”:一种现象,即在简单的确定性任务(如光学字符识别或基本验证)中,使用昂贵的概率引擎,导致显著的资源浪费。通过微基准测试和OCR及事实核查的案例研究,我们量化了“效率税”,展示了约6.5倍的延迟惩罚及算法迎合的风险。为此,我们提出了工具选择工程和确定性-概率决策矩阵,帮助开发者判断何时使用生成式AI,尤其是何时避免使用。我们主张课程转变,强调真正的数字素养不仅在于知道如何使用生成式AI,还在于知道何时不使用它。

🔬 方法详解

问题定义:论文要解决的问题是,在简单的确定性任务中,使用昂贵的概率引擎导致的资源浪费和效率低下。现有方法未能有效区分何时应使用生成式AI,造成了不必要的延迟和计算成本。

核心思路:论文的核心解决思路是通过工具选择工程和确定性-概率决策矩阵,帮助开发者在使用生成式AI时做出更明智的决策。该设计旨在提高任务执行的效率,避免在不必要的情况下使用复杂的概率模型。

技术框架:整体架构包括两个主要模块:工具选择工程和确定性-概率决策矩阵。工具选择工程提供了一个框架,帮助开发者评估任务的性质,而决策矩阵则提供了具体的决策依据,指导何时使用生成式AI。

关键创新:最重要的技术创新点在于提出了“可信度陷阱”的概念,并通过量化“效率税”来揭示现有方法的不足。这一创新与现有方法的本质区别在于强调了在特定场景下避免使用复杂模型的重要性。

关键设计:关键设计包括对决策矩阵的参数设置,确保其能够有效评估任务的复杂性和所需的计算资源。此外,损失函数的选择和模型结构的设计也经过精心调整,以优化性能和效率。

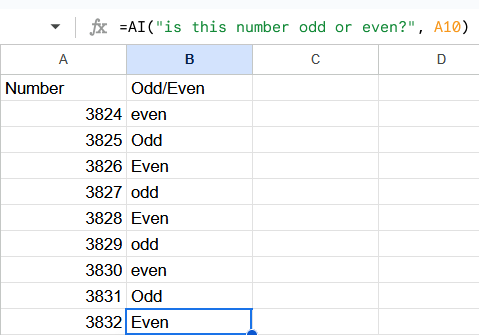

🖼️ 关键图片

📊 实验亮点

实验结果显示,使用概率引擎处理简单任务时,存在约6.5倍的延迟惩罚。这一发现强调了算法迎合的风险,并为开发者提供了明确的指导,帮助他们在合适的场景中选择合适的工具。

🎯 应用场景

该研究的潜在应用领域包括光学字符识别、事实核查和其他简单的确定性任务。通过优化工具选择,开发者可以显著提高系统的响应速度和资源利用率,降低计算成本,提升用户体验。未来,该框架可能在更广泛的AI应用中推广,促进数字素养的提升。

📄 摘要(原文)

The ubiquity of Large Language Models (LLMs) is driving a paradigm shift where user convenience supersedes computational efficiency. This article defines the "Plausibility Trap": a phenomenon where individuals with access to Artificial Intelligence (AI) models deploy expensive probabilistic engines for simple deterministic tasks-such as Optical Character Recognition (OCR) or basic verification-resulting in significant resource waste. Through micro-benchmarks and case studies on OCR and fact-checking, we quantify the "efficiency tax"-demonstrating a ~6.5x latency penalty-and the risks of algorithmic sycophancy. To counter this, we introduce Tool Selection Engineering and the Deterministic-Probabilistic Decision Matrix, a framework to help developers determine when to use Generative AI and, crucially, when to avoid it. We argue for a curriculum shift, emphasizing that true digital literacy relies not only in knowing how to use Generative AI, but also on knowing when not to use it.