Visual and Cognitive Demands of a Large Language Model-Powered In-vehicle Conversational Agent

作者: Chris Monk, Allegra Ayala, Christine S. P. Yu, Gregory M. Fitch, Dara Gruber

分类: cs.HC, cs.AI

发布日期: 2026-01-21

💡 一句话要点

评估LLM车载对话代理的视觉和认知负荷,支持安全部署。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 车载对话代理 大型语言模型 驾驶员分心 认知负荷 视觉负荷 人机交互 驾驶安全

📋 核心要点

- 驾驶分心是交通事故的重要原因,现有车载技术评估不足。

- 研究评估LLM驱动的对话代理Gemini Live的视觉和认知负荷。

- 实验表明Gemini Live的负荷与免提电话相当,支持安全部署。

📝 摘要(中文)

驾驶员分心是导致交通事故的主要原因,因此需要严格评估新型车载技术。本研究评估了在实际驾驶过程中,由大型语言模型(LLM)驱动的先进对话代理(Gemini Live)所带来的视觉和认知负荷。研究将其与免提电话、可视化逐向导航(低负荷基线)以及Operation Span (OSPAN)任务(高负荷锚点)进行了比较。三十二名持证驾驶员在完成五个次要任务的同时,通过检测反应任务(DRT)测量认知负荷,通过眼动追踪测量视觉注意力,并通过主观工作负荷评级进行评估。结果表明,Gemini Live交互(单轮和多轮)和免提电话的认知负荷水平相似,介于可视化逐向导航和OSPAN之间。探索性分析表明,认知负荷在扩展的多轮对话中保持稳定。所有任务的平均注视时长均远低于公认的2秒安全阈值,证实了较低的视觉需求。此外,驾驶员在完成任务期间,在短暂的视线离开道路转向设备后,会持续将更长时间的视线集中在道路上,尤其是在基于语音的交互中,这使得较长的总视线离开道路时间的影响减小。主观评级与客观数据相符,参与者报告Gemini Live的努力程度、需求和感知到的分心程度较低。这些发现表明,先进的LLM对话代理,当通过语音界面实现时,其认知和视觉需求与已建立的低风险免提基准相当,支持其在驾驶环境中安全部署。

🔬 方法详解

问题定义:论文旨在评估在驾驶场景下使用大型语言模型(LLM)驱动的车载对话代理(Gemini Live)所产生的视觉和认知负荷。现有车载信息系统和交互方式可能导致驾驶员分心,增加交通事故风险。因此,需要量化评估新型车载技术,确保其安全性。

核心思路:论文的核心思路是将Gemini Live与已知的低风险(可视化逐向导航)和高风险(OSPAN任务)基准进行对比,通过客观指标(DRT、眼动追踪)和主观评级,综合评估其对驾驶员认知和视觉的影响。通过这种对比分析,确定Gemini Live是否在可接受的安全范围内。

技术框架:研究采用实验方法,招募驾驶员在实际道路上驾驶,同时执行次要任务。这些任务包括与Gemini Live进行单轮和多轮对话、使用免提电话、进行可视化逐向导航以及执行OSPAN任务。在驾驶过程中,使用检测反应任务(DRT)测量认知负荷,使用眼动追踪技术记录驾驶员的视觉行为,并通过主观问卷收集驾驶员对工作负荷的感知。

关键创新:该研究的关键创新在于首次系统性地评估了基于大型语言模型的车载对话代理在实际驾驶环境中的安全性和可用性。以往研究较少关注LLM在车载环境下的应用,以及其对驾驶员认知和视觉负荷的潜在影响。该研究为LLM在车载领域的安全部署提供了重要依据。

关键设计:研究的关键设计包括:1) 选择合适的基准任务(可视化逐向导航和OSPAN任务)进行对比;2) 使用多种客观指标(DRT、眼动追踪)和主观评级相结合,全面评估认知和视觉负荷;3) 在真实道路环境中进行实验,提高研究结果的外部有效性;4) 探索性分析多轮对话对认知负荷的影响,评估LLM的长期使用安全性。

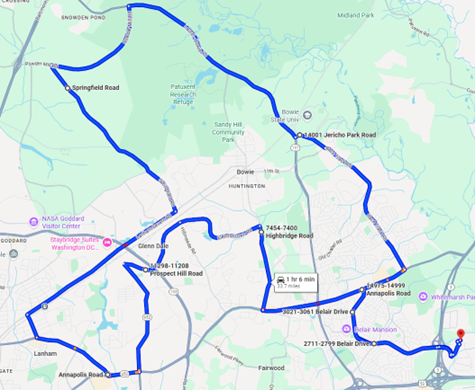

🖼️ 关键图片

📊 实验亮点

实验结果表明,Gemini Live交互的认知负荷与免提电话相当,低于OSPAN任务,且平均注视时长远低于2秒安全阈值。驾驶员在语音交互中更倾向于将视线集中在道路上。主观评级也显示驾驶员对Gemini Live的努力程度、需求和分心程度评价较低。这些结果支持了LLM车载对话代理在驾驶环境中的安全应用。

🎯 应用场景

该研究成果可应用于车载信息娱乐系统设计、人机交互界面优化以及驾驶员辅助系统开发。通过合理设计语音交互界面,降低驾驶员的认知和视觉负荷,从而提高驾驶安全性。未来,可进一步研究不同LLM模型、不同交互方式对驾驶员的影响,为车载智能设备的普及提供理论支持。

📄 摘要(原文)

Driver distraction remains a leading contributor to motor vehicle crashes, necessitating rigorous evaluation of new in-vehicle technologies. This study assessed the visual and cognitive demands associated with an advanced Large Language Model (LLM) conversational agent (Gemini Live) during on-road driving, comparing it against handsfree phone calls, visual turn-by-turn guidance (low load baseline), and the Operation Span (OSPAN) task (high load anchor). Thirty-two licensed drivers completed five secondary tasks while visual and cognitive demands were measured using the Detection Response Task (DRT) for cognitive load, eye-tracking for visual attention, and subjective workload ratings. Results indicated that Gemini Live interactions (both single-turn and multi-turn) and hands-free phone calls shared similar levels of cognitive load, between that of visual turn-by-turn guidance and OSPAN. Exploratory analysis showed that cognitive load remained stable across extended multi-turn conversations. All tasks maintained mean glance durations well below the well-established 2-second safety threshold, confirming low visual demand. Furthermore, drivers consistently dedicated longer glances to the roadway between brief off-road glances toward the device during task completion, particularly during voice-based interactions, rendering longer total-eyes-off-road time findings less consequential. Subjective ratings mirrored objective data, with participants reporting low effort, demands, and perceived distraction for Gemini Live. These findings demonstrate that advanced LLM conversational agents, when implemented via voice interfaces, impose cognitive and visual demands comparable to established, low-risk hands-free benchmarks, supporting their safe deployment in the driving environment.