GEGO: A Hybrid Golden Eagle and Genetic Optimization Algorithm for Efficient Hyperparameter Tuning in Resource-Constrained Environments

作者: Amaras Nazarians, Sachin Kumar

分类: cs.NE, cs.AI

发布日期: 2026-01-21

💡 一句话要点

提出GEGO混合算法,用于资源受限环境下的高效超参数调优

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 超参数优化 元启发式算法 金雕优化 遗传算法 混合算法 神经网络 资源受限环境

📋 核心要点

- 神经网络超参数调优计算成本高,在高维非凸空间中尤其困难,现有方法易陷入局部最优。

- GEGO将金雕优化算法的种群移动策略与遗传算法的算子融合,提升种群多样性,避免早熟收敛。

- 实验表明,GEGO在基准测试和MNIST超参数调优中,均优于GEO和GA,实现了更高的精度和更稳定的收敛。

📝 摘要(中文)

超参数调优是训练神经网络的关键步骤,但计算成本高昂,尤其是在高维非凸搜索空间中。元启发式优化算法因其无导数特性和对局部最优的鲁棒性而被广泛使用。本文提出了一种混合元启发式算法——金雕遗传优化(GEGO),它将金雕优化(GEO)的种群移动策略与选择、交叉和变异等遗传算子相结合。GEGO的主要创新在于将遗传算子直接嵌入到GEO的迭代搜索过程中,而不是作为单独的进化阶段应用。这种设计提高了搜索过程中的种群多样性,减少了早熟收敛,同时保留了GEO的探索行为。GEGO在CEC2017标准单峰、多峰和复合基准函数上进行了评估,在解决方案质量和鲁棒性方面始终优于其组成算法和几种经典元启发式算法。该算法还应用于MNIST数据集上人工神经网络的超参数调优,与GEO和GA相比,GEGO实现了更高的分类精度和更稳定的收敛性。这些结果表明,GEGO提供了平衡的探索-利用权衡,非常适合在受限计算环境下进行超参数优化。

🔬 方法详解

问题定义:论文旨在解决神经网络超参数调优过程中计算资源消耗大、易陷入局部最优的问题。传统的超参数调优方法,如网格搜索和随机搜索,效率低下。而现有的元启发式算法在复杂搜索空间中容易过早收敛,导致无法找到最优解。

核心思路:GEGO的核心思路是将金雕优化算法(GEO)的全局探索能力与遗传算法(GA)的局部搜索能力相结合。GEO擅长全局探索,但容易收敛到次优解;GA具有较强的局部搜索能力,但容易陷入局部最优。通过将两者的优势结合,GEGO旨在实现更好的探索-利用平衡,从而更有效地找到最优超参数组合。

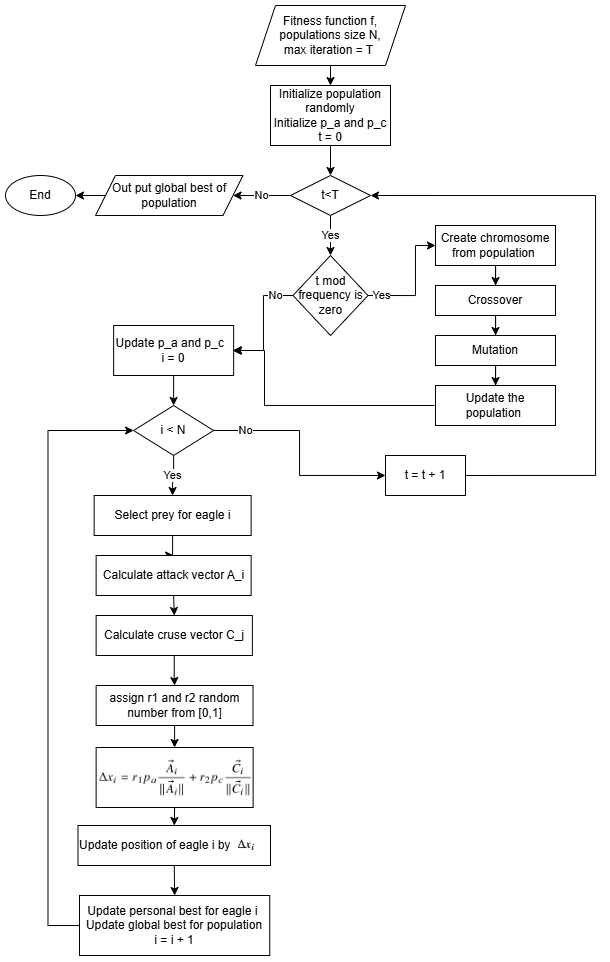

技术框架:GEGO算法的整体流程如下:1. 初始化种群;2. 使用GEO的种群移动策略更新种群位置;3. 对种群进行选择操作,选择适应度高的个体;4. 对选择后的种群进行交叉操作,生成新的个体;5. 对交叉后的种群进行变异操作,引入新的基因;6. 评估新种群的适应度;7. 重复步骤2-6,直到满足停止条件。

关键创新:GEGO的关键创新在于将遗传算子(选择、交叉、变异)直接嵌入到GEO的迭代搜索过程中。与传统的混合方法不同,GEGO不是将GA作为独立的进化阶段应用,而是将遗传算子与GEO的种群移动策略紧密结合,从而更有效地利用了两种算法的优势。这种设计提高了种群多样性,减少了早熟收敛,同时保留了GEO的探索行为。

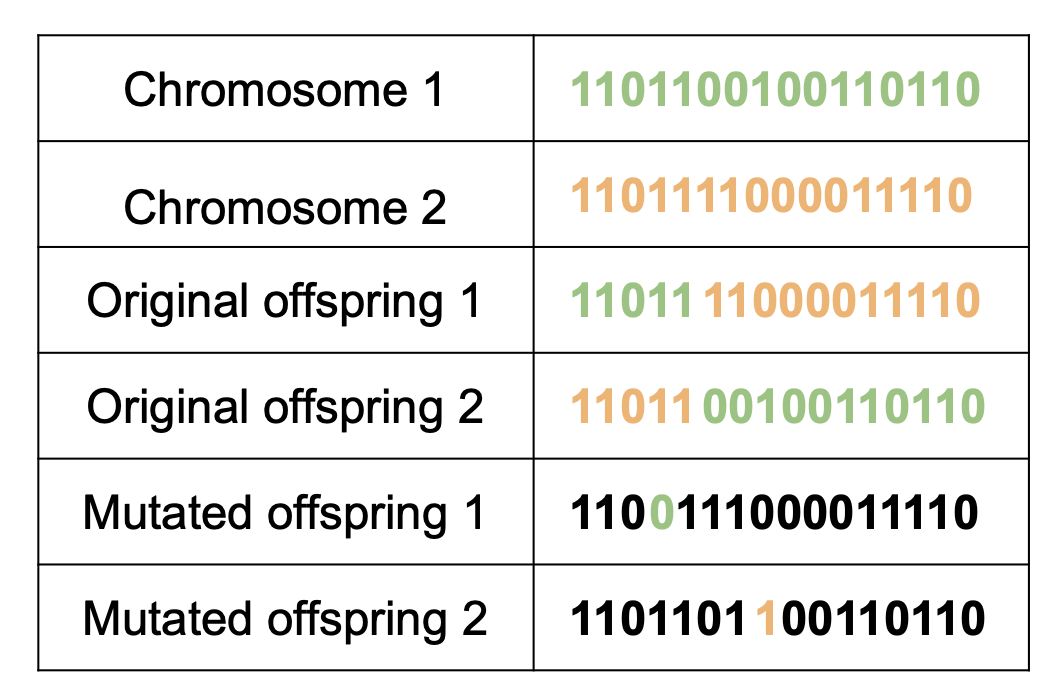

关键设计:GEGO的关键设计包括:1. 选择算子:使用轮盘赌选择或锦标赛选择等方法,选择适应度高的个体;2. 交叉算子:使用单点交叉、多点交叉或均匀交叉等方法,生成新的个体;3. 变异算子:使用位翻转变异或高斯变异等方法,引入新的基因;4. 适应度函数:根据具体的超参数调优任务,选择合适的适应度函数,例如验证集上的准确率或损失函数值。

🖼️ 关键图片

📊 实验亮点

GEGO在CEC2017基准测试中,在解的质量和鲁棒性上优于GEO和GA等算法。在MNIST数据集的神经网络超参数调优中,GEGO相较于GEO和GA,实现了更高的分类精度和更稳定的收敛。例如,GEGO在MNIST上的分类精度比GEO提高了约1%-2%。

🎯 应用场景

GEGO算法可广泛应用于各种机器学习模型的超参数调优,尤其是在计算资源受限的环境下。例如,在嵌入式设备或移动设备上部署深度学习模型时,可以使用GEGO算法来优化模型的超参数,以在有限的计算资源下获得最佳的性能。此外,GEGO还可以应用于其他优化问题,如特征选择、模型压缩等。

📄 摘要(原文)

Hyperparameter tuning is a critical yet computationally expensive step in training neural networks, particularly when the search space is high dimensional and nonconvex. Metaheuristic optimization algorithms are often used for this purpose due to their derivative free nature and robustness against local optima. In this work, we propose Golden Eagle Genetic Optimization (GEGO), a hybrid metaheuristic that integrates the population movement strategy of Golden Eagle Optimization with the genetic operators of selection, crossover, and mutation. The main novelty of GEGO lies in embedding genetic operators directly into the iterative search process of GEO, rather than applying them as a separate evolutionary stage. This design improves population diversity during search and reduces premature convergence while preserving the exploration behavior of GEO. GEGO is evaluated on standard unimodal, multimodal, and composite benchmark functions from the CEC2017 suite, where it consistently outperforms its constituent algorithms and several classical metaheuristics in terms of solution quality and robustness. The algorithm is further applied to hyperparameter tuning of artificial neural networks on the MNIST dataset, where GEGO achieves improved classification accuracy and more stable convergence compared to GEO and GA. These results indicate that GEGO provides a balanced exploration-exploitation tradeoff and is well suited for hyperparameter optimization under constrained computational settings.