Learning Discrete Successor Transitions in Continuous Attractor Networks: Emergence, Limits, and Topological Constraints

作者: Daniel Brownell

分类: q-bio.NC, cs.AI

发布日期: 2026-01-20

备注: An open-source reference implementation is available at https://github.com/javadan/can-paper

💡 一句话要点

研究连续吸引子网络中离散后继状态转移的学习:涌现、局限与拓扑约束

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱八:物理动画 (Physics-based Animation)

关键词: 连续吸引子网络 状态转移 循环神经网络 拓扑约束 自主学习

📋 核心要点

- 现有CAN模型依赖外部位移信号驱动状态转移,缺乏自主学习转移动力学的能力。

- 该论文提出训练CAN学习离散后继状态转移,无需外部位移信号,探索网络自主学习能力。

- 实验表明,短时评估易导致网络收敛到非吸引子动力学的快捷方案,拓扑结构也限制了学习能力。

📝 摘要(中文)

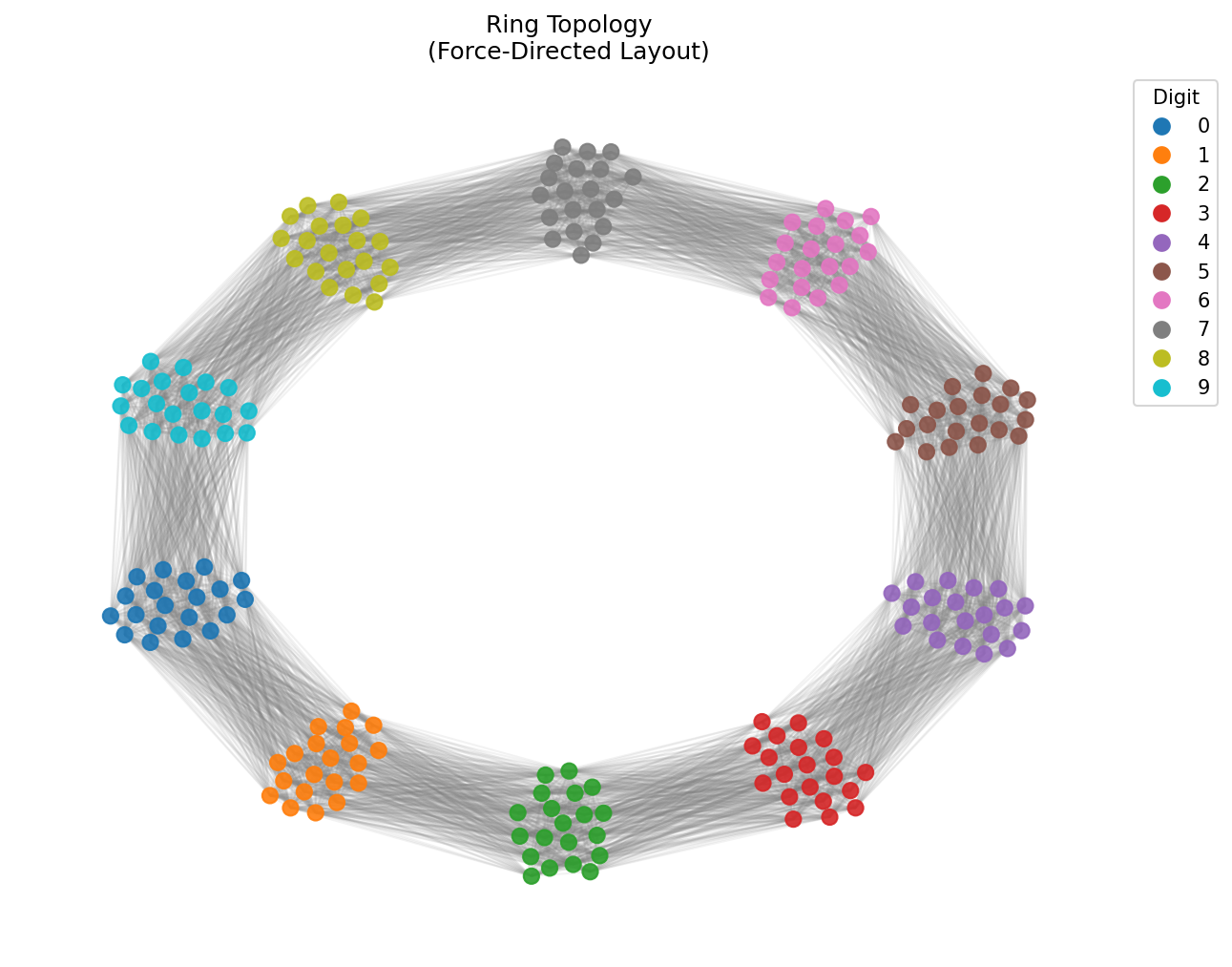

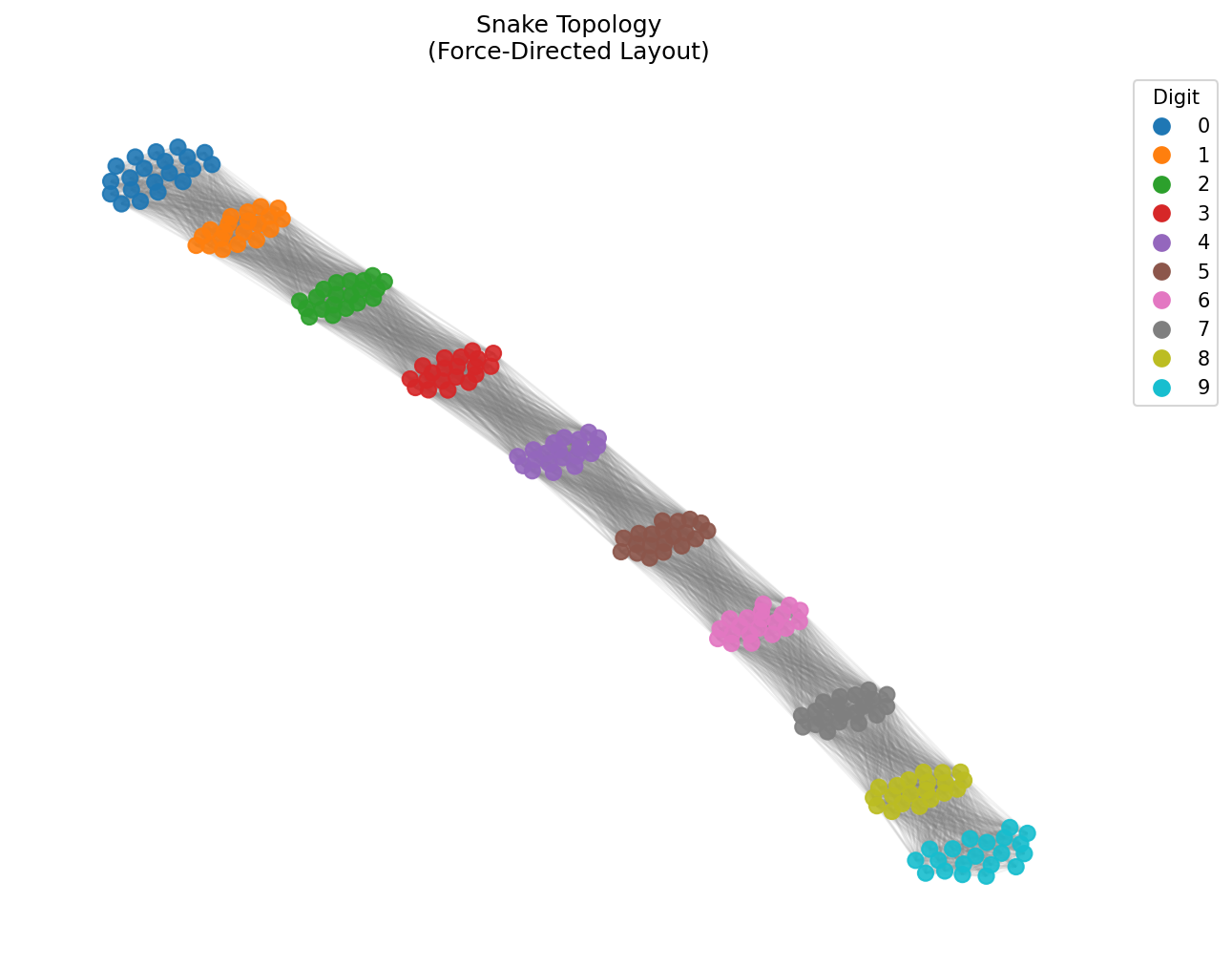

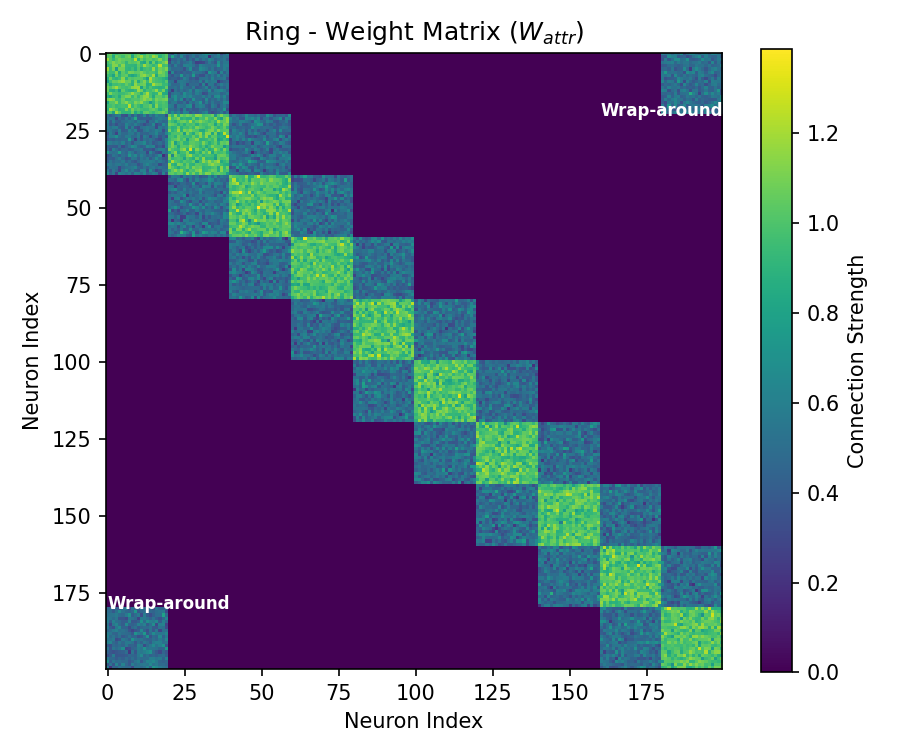

连续吸引子网络(CANs)是一类成熟的模型,用于表示诸如头部方向、空间位置和相位等低维连续变量。在典型的空间领域中,沿吸引子流形的转移由连续位移信号驱动,例如由CAN外部的传感器运动系统提供的角速度。当没有明确提供此类信号作为专用位移输入时,基于吸引子的电路是否能够可靠地获得支持稳定状态转移的循环动力学,或者替代预测策略是否占主导地位,仍然不清楚。本文提出了一个实验框架,用于训练CAN在没有外部提供的位移信号的情况下,在稳定的吸引子状态之间执行类似后继状态的转移。我们比较了两种循环拓扑结构,一个圆形环和一个折叠的蛇形流形,并系统地改变了评估稳定性的时间范围。我们发现,在较短的评估窗口下,网络始终收敛到脉冲驱动的关联解决方案,这些解决方案实现了较高的表面精度,但缺乏持久的吸引子动力学。只有当在较长的自由运行期间明确强制执行稳定性时,才会出现真正的基于吸引子的转移动力学。这表明快捷方式解决方案是循环网络中局部学习的默认结果,而吸引子动力学代表了一种约束机制,而不是一个通用结果。此外,我们证明了拓扑结构严格限制了学习转移的能力。虽然连续环形拓扑结构在较长时间范围内实现了完美的稳定性,但折叠的蛇形拓扑结构达到了一个几何极限,其特征是在流形不连续处发生故障,课程学习和受基底神经节启发的门控都无法完全克服。

🔬 方法详解

问题定义:论文旨在研究在没有外部位移信号的情况下,连续吸引子网络(CANs)是否能够学习到稳定的状态转移动力学。现有方法通常依赖于外部提供的位移信号来驱动CAN中的状态转移,这限制了CAN的自主性和灵活性。论文关注的痛点是:CAN是否能够仅通过内部循环连接学习到状态转移,以及这种学习受到哪些因素的限制?

核心思路:论文的核心思路是通过训练CAN来模拟后继状态转移,即从一个稳定状态转移到另一个稳定状态。通过比较不同拓扑结构(圆形环和折叠蛇形流形)的CAN在不同时间尺度下的学习表现,来研究网络自主学习状态转移的能力,并分析拓扑结构对学习的限制。论文假设,如果CAN能够成功学习到状态转移,那么它应该表现出持久的吸引子动力学,而不是简单的关联记忆。

技术框架:论文的整体框架包括以下几个步骤:1) 构建具有不同拓扑结构的CANs(圆形环和折叠蛇形流形);2) 设计训练目标,使CAN学习从一个稳定状态转移到另一个稳定状态;3) 使用循环神经网络训练CAN;4) 在不同时间尺度下评估CAN的稳定性,即评估网络在没有外部输入的情况下,能否保持在目标状态附近;5) 分析不同拓扑结构和时间尺度对学习效果的影响。

关键创新:论文的关键创新在于:1) 提出了一个实验框架,用于研究CAN在没有外部位移信号的情况下学习状态转移的能力;2) 揭示了CAN在学习状态转移时存在“快捷方式”问题,即网络容易收敛到非吸引子动力学的解决方案;3) 证明了拓扑结构对CAN学习状态转移的能力存在严格的限制,特别是对于具有不连续性的流形(如折叠蛇形流形)。

关键设计:论文的关键设计包括:1) 使用循环神经网络(RNN)作为CAN的基础架构;2) 设计了损失函数,用于鼓励CAN学习稳定的状态转移;3) 通过改变评估窗口的大小来控制对稳定性的要求;4) 比较了圆形环和折叠蛇形流形两种不同的拓扑结构,以研究拓扑结构对学习的影响。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在短时间评估窗口下,网络倾向于收敛到脉冲驱动的关联解决方案,缺乏持久的吸引子动力学。只有在长时间自由运行期间强制执行稳定性时,真正的基于吸引子的转移动力学才会出现。此外,连续环形拓扑结构在长时间范围内实现了完美的稳定性,而折叠的蛇形拓扑结构则受到几何限制,在流形不连续处出现故障。

🎯 应用场景

该研究成果可应用于机器人导航、运动控制和认知建模等领域。例如,可以用于设计自主导航机器人,使其能够在没有外部传感器信号的情况下,仅通过内部模型进行路径规划和状态转移。此外,该研究还可以帮助我们理解大脑中神经环路如何学习和表示状态转移,从而为认知计算和神经科学提供新的思路。

📄 摘要(原文)

Continuous attractor networks (CANs) are a well-established class of models for representing low-dimensional continuous variables such as head direction, spatial position, and phase. In canonical spatial domains, transitions along the attractor manifold are driven by continuous displacement signals, such as angular velocity-provided by sensorimotor systems external to the CAN itself. When such signals are not explicitly provided as dedicated displacement inputs, it remains unclear whether attractor-based circuits can reliably acquire recurrent dynamics that support stable state transitions, or whether alternative predictive strategies dominate. In this work, we present an experimental framework for training CANs to perform successor-like transitions between stable attractor states in the absence of externally provided displacement signals. We compare two recurrent topologies, a circular ring and a folded snake manifold, and systematically vary the temporal regime under which stability is evaluated. We find that, under short evaluation windows, networks consistently converge to impulse-driven associative solutions that achieve high apparent accuracy yet lack persistent attractor dynamics. Only when stability is explicitly enforced over extended free-run periods do genuine attractor-based transition dynamics emerge. This suggests that shortcut solutions are the default outcome of local learning in recurrent networks, while attractor dynamics represent a constrained regime rather than a generic result. Furthermore, we demonstrate that topology strictly limits the capacity for learned transitions. While the continuous ring topology achieves perfect stability over long horizons, the folded snake topology hits a geometric limit characterized by failure at manifold discontinuities, which neither curriculum learning nor basal ganglia-inspired gating can fully overcome.