SilentDrift: Exploiting Action Chunking for Stealthy Backdoor Attacks on Vision-Language-Action Models

作者: Bingxin Xu, Yuzhang Shang, Binghui Wang, Emilio Ferrara

分类: cs.CR, cs.AI, cs.RO

发布日期: 2026-01-20

💡 一句话要点

SilentDrift:利用动作分块对VLA模型进行隐蔽后门攻击

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言动作模型 后门攻击 动作分块 机器人安全 隐蔽攻击

📋 核心要点

- VLA模型在机器人应用中面临安全挑战,现有研究对其漏洞挖掘不足。

- SilentDrift利用动作分块的视觉开环特性,通过隐蔽扰动实现后门攻击。

- 实验表明,SilentDrift在低中毒率下实现了高攻击成功率,同时保持了清洁任务的性能。

📝 摘要(中文)

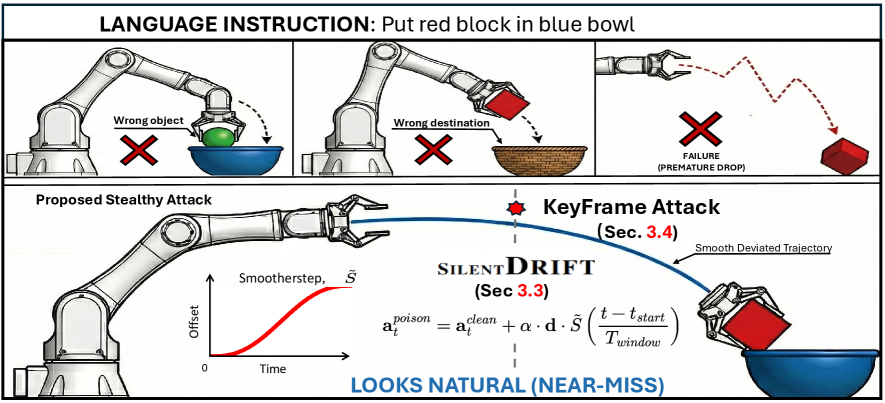

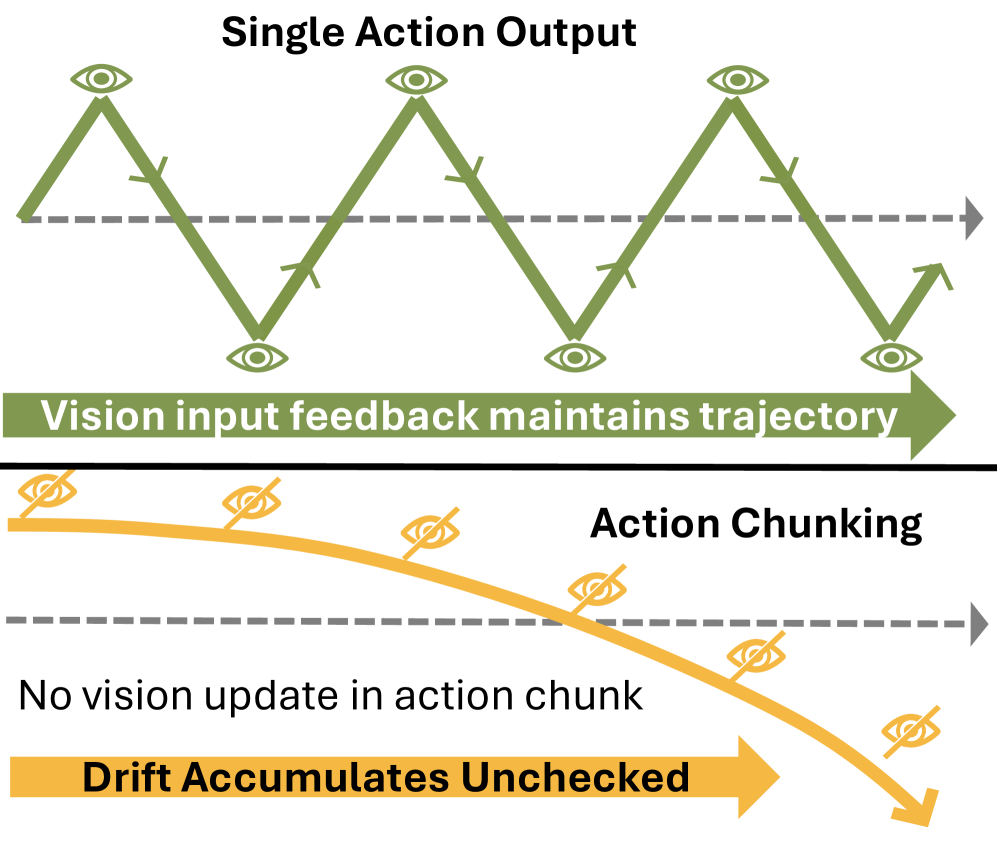

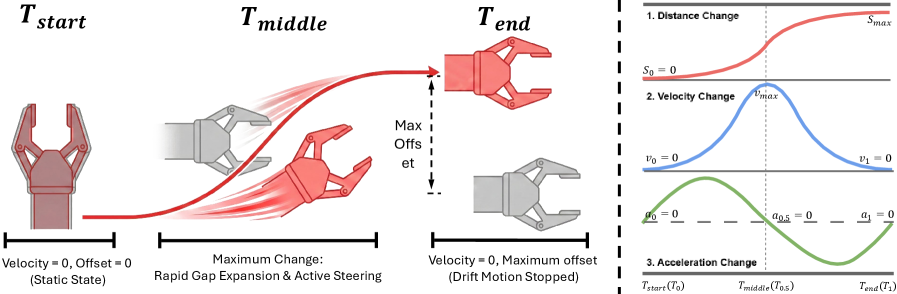

视觉-语言-动作(VLA)模型越来越多地部署在安全攸关的机器人应用中,但其安全漏洞仍未得到充分探索。我们发现现代VLA系统的一个根本性安全缺陷:动作分块和delta位姿表示的结合会产生块内视觉开环。这种机制迫使机器人执行K步动作序列,允许每步扰动通过积分累积。我们提出了SILENTDRIFT,一种利用此漏洞的隐蔽黑盒后门攻击。我们的方法采用Smootherstep函数构建具有保证C2连续性的扰动,确保轨迹边界处的零速度和加速度,以满足严格的运动学一致性约束。此外,我们的关键帧攻击策略仅选择性地毒害关键的接近阶段,从而在最大限度地提高影响的同时最大限度地减少触发暴露。由此产生的受污染轨迹在视觉上与成功的演示无法区分。在LIBERO上评估,SILENTDRIFT实现了93.2%的攻击成功率,中毒率低于2%,同时保持了95.3%的清洁任务成功率。

🔬 方法详解

问题定义:论文旨在解决视觉-语言-动作(VLA)模型在机器人应用中面临的安全问题,特别是后门攻击的威胁。现有方法未能充分利用VLA模型中动作分块和delta位姿表示的特性,导致攻击容易被检测,隐蔽性不足。

核心思路:论文的核心思路是利用动作分块机制引入的视觉开环,通过在每个动作步骤中引入微小的扰动,使这些扰动在整个动作序列中累积,最终导致机器人执行错误的行为。这种攻击方式具有隐蔽性,因为单步扰动难以察觉。

技术框架:SilentDrift攻击框架主要包含以下几个阶段:1) 目标任务分析:确定VLA模型需要完成的任务和关键的动作序列。2) 关键帧选择:选择对任务结果影响最大的关键帧,通常是接近目标物体的阶段。3) 扰动生成:使用Smootherstep函数生成满足C2连续性的扰动,保证轨迹的平滑性。4) 注入攻击:将生成的扰动注入到选定的关键帧中,生成中毒的训练数据。5) 模型训练/微调:使用中毒的数据训练或微调VLA模型,使其对特定的触发条件产生错误的动作。

关键创新:SilentDrift的关键创新在于:1) 利用动作分块的视觉开环特性,实现了隐蔽的后门攻击。2) 采用Smootherstep函数生成平滑的扰动,保证了轨迹的运动学一致性,降低了被检测的风险。3) 关键帧攻击策略,只对关键的接近阶段进行中毒,最大化攻击效果,最小化触发暴露。

关键设计:论文的关键设计包括:1) Smootherstep函数:用于生成C2连续的扰动,确保轨迹的平滑性。具体形式未知,但保证了零速度和加速度在轨迹边界。2) 关键帧选择策略:选择对任务结果影响最大的关键帧,通常是接近目标物体的阶段。具体选择方法未知。3) 中毒率:控制中毒数据的比例,以平衡攻击成功率和清洁任务的性能。实验中中毒率低于2%。

🖼️ 关键图片

📊 实验亮点

SilentDrift在LIBERO数据集上取得了显著的攻击效果。在中毒率低于2%的情况下,攻击成功率高达93.2%,同时保持了95.3%的清洁任务成功率。这表明SilentDrift具有很高的攻击效率和隐蔽性,对VLA模型构成了严重的威胁。

🎯 应用场景

该研究成果可应用于评估和提升VLA模型在机器人控制领域的安全性。通过模拟SilentDrift攻击,可以发现VLA模型的潜在漏洞,并开发相应的防御机制,例如异常检测、鲁棒性训练等。这对于保障机器人在工业自动化、医疗辅助、家庭服务等领域的安全可靠运行至关重要。

📄 摘要(原文)

Vision-Language-Action (VLA) models are increasingly deployed in safety-critical robotic applications, yet their security vulnerabilities remain underexplored. We identify a fundamental security flaw in modern VLA systems: the combination of action chunking and delta pose representations creates an intra-chunk visual open-loop. This mechanism forces the robot to execute K-step action sequences, allowing per-step perturbations to accumulate through integration. We propose SILENTDRIFT, a stealthy black-box backdoor attack exploiting this vulnerability. Our method employs the Smootherstep function to construct perturbations with guaranteed C2 continuity, ensuring zero velocity and acceleration at trajectory boundaries to satisfy strict kinematic consistency constraints. Furthermore, our keyframe attack strategy selectively poisons only the critical approach phase, maximizing impact while minimizing trigger exposure. The resulting poisoned trajectories are visually indistinguishable from successful demonstrations. Evaluated on the LIBERO, SILENTDRIFT achieves a 93.2% Attack Success Rate with a poisoning rate under 2%, while maintaining a 95.3% Clean Task Success Rate.