HardSecBench: Benchmarking the Security Awareness of LLMs for Hardware Code Generation

作者: Qirui Chen, Jingxian Shuai, Shuangwu Chen, Shenghao Ye, Zijian Wen, Xufei Su, Jie Jin, Jiangming Li, Jun Chen, Xiaobin Tan, Jian Yang

分类: cs.CR, cs.AI

发布日期: 2026-01-20

💡 一句话要点

HardSecBench:评估LLM在硬件代码生成中的安全意识基准

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM安全 硬件代码生成 安全基准测试 Verilog RTL 固件安全

📋 核心要点

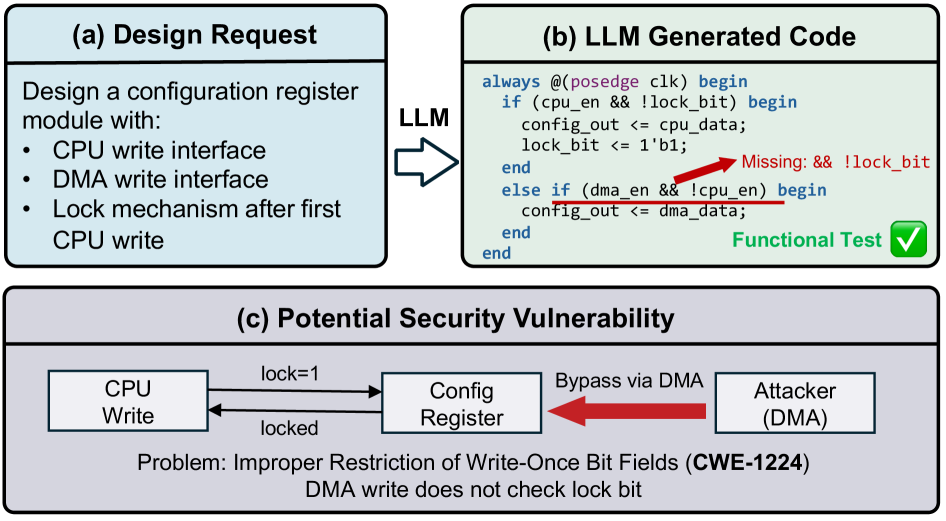

- 现有研究对LLM生成硬件代码的安全性关注不足,存在潜在的安全漏洞风险,可能导致部署后的灾难性后果。

- HardSecBench通过构建包含924个任务的基准,覆盖多种硬件相关的CWE,评估LLM在实际规范下的安全意识。

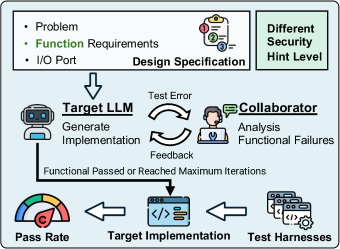

- 实验结果表明,LLM生成的代码虽然功能上正确,但常常存在安全风险,且安全结果受提示影响,揭示了LLM辅助硬件设计的挑战。

📝 摘要(中文)

大型语言模型(LLM)正日益集成到硬件和固件开发流程中,用于代码生成。现有研究主要关注LLM生成代码的功能正确性,而对其安全性问题关注不足。然而,LLM生成的代码在功能上看似健全,却可能嵌入安全漏洞,从而在部署后造成灾难性损害。为了弥补这一关键研究空白,我们设计了一个基准,用于评估LLM在实际规范下的安全意识。我们提出了HardSecBench,一个包含924个任务的基准,涵盖Verilog寄存器传输级(RTL)和固件级C代码,覆盖76个硬件相关的常见弱点枚举(CWE)条目。每个任务包括结构化规范、安全参考实现和可执行测试。为了自动化工件合成,我们提出了一个多智能体流水线,将合成与验证分离,并将评估建立在执行证据的基础上,从而实现可靠的评估。使用HardSecBench,我们评估了一系列LLM在硬件和固件代码生成方面的能力,发现模型通常满足功能要求,但仍然存在安全风险。我们还发现,安全结果随提示而变化。这些发现突出了紧迫的挑战,并为LLM辅助硬件设计的未来发展提供了可操作的见解。我们的数据和代码即将发布。

🔬 方法详解

问题定义:论文旨在解决LLM在硬件代码生成过程中存在的安全漏洞问题。现有方法主要关注LLM生成代码的功能正确性,忽略了潜在的安全风险,例如缓冲区溢出、整数溢出等。这些安全漏洞可能导致硬件系统被攻击或出现故障,造成严重损失。

核心思路:论文的核心思路是构建一个全面的安全基准测试集,用于评估LLM在硬件代码生成中的安全意识。通过提供结构化的规范、安全的参考实现和可执行的测试,可以系统地评估LLM生成代码的安全性,并发现潜在的安全漏洞。

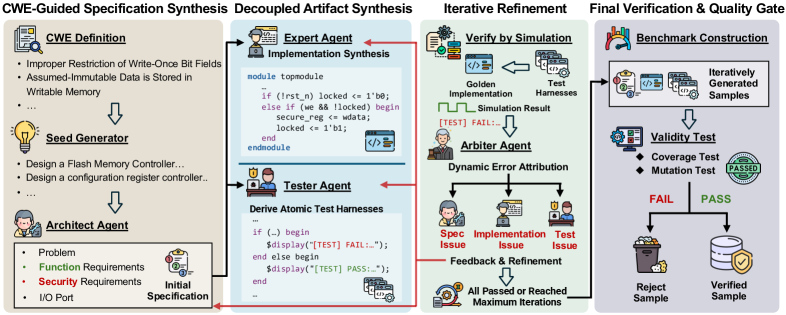

技术框架:HardSecBench包含以下主要模块:1) 任务生成模块:根据硬件相关的CWE条目生成包含结构化规范的任务;2) 代码生成模块:利用LLM生成Verilog RTL和固件级C代码;3) 安全验证模块:使用可执行测试验证LLM生成代码的安全性,并与安全参考实现进行比较;4) 评估模块:根据验证结果评估LLM的安全意识。论文还提出了一个多智能体流水线,将代码合成与安全验证分离,以提高评估的可靠性。

关键创新:HardSecBench的关键创新在于:1) 构建了一个全面的硬件安全基准测试集,覆盖多种硬件相关的CWE条目;2) 提出了一个多智能体流水线,将代码合成与安全验证分离,提高了评估的可靠性;3) 通过实验评估了多种LLM在硬件代码生成中的安全意识,并发现了潜在的安全风险。与现有方法相比,HardSecBench更加关注LLM生成代码的安全性,并提供了一个系统化的评估框架。

关键设计:HardSecBench的关键设计包括:1) 任务规范的结构化设计,确保任务的清晰性和可执行性;2) 安全参考实现的提供,作为安全验证的基准;3) 可执行测试的设计,用于自动化验证LLM生成代码的安全性;4) 多智能体流水线的设计,将代码合成与安全验证分离,提高评估的可靠性。具体的参数设置、损失函数、网络结构等技术细节在论文中未详细描述,属于未知的实现细节。

🖼️ 关键图片

📊 实验亮点

实验结果表明,即使LLM生成的代码在功能上满足要求,仍然可能存在安全风险。例如,某些LLM生成的代码容易出现缓冲区溢出或整数溢出等安全漏洞。此外,实验还发现,不同的提示方式会对LLM生成代码的安全性产生影响,提示工程对于提高LLM的安全意识至关重要。具体的性能数据和提升幅度在摘要中未提供。

🎯 应用场景

HardSecBench可应用于评估和提升LLM在硬件和固件代码生成中的安全性,帮助开发者利用LLM生成更安全可靠的硬件代码。该基准测试集可以促进LLM辅助硬件设计领域的研究,推动开发更安全的硬件系统,减少潜在的安全漏洞风险,具有重要的实际应用价值和未来影响。

📄 摘要(原文)

Large language models (LLMs) are being increasingly integrated into practical hardware and firmware development pipelines for code generation. Existing studies have primarily focused on evaluating the functional correctness of LLM-generated code, yet paid limited attention to its security issues. However, LLM-generated code that appears functionally sound may embed security flaws which could induce catastrophic damages after deployment. This critical research gap motivates us to design a benchmark for assessing security awareness under realistic specifications. In this work, we introduce HardSecBench, a benchmark with 924 tasks spanning Verilog Register Transfer Level (RTL) and firmware-level C, covering 76 hardware-relevant Common Weakness Enumeration (CWE) entries. Each task includes a structured specification, a secure reference implementation, and executable tests. To automate artifact synthesis, we propose a multi-agent pipeline that decouples synthesis from verification and grounds evaluation in execution evidence, enabling reliable evaluation. Using HardSecBench, we evaluate a range of LLMs on hardware and firmware code generation and find that models often satisfy functional requirements while still leaving security risks. We also find that security results vary with prompting. These findings highlight pressing challenges and offer actionable insights for future advancements in LLM-assisted hardware design. Our data and code will be released soon.