CORVUS: Red-Teaming Hallucination Detectors via Internal Signal Camouflage in Large Language Models

作者: Nay Myat Min, Long H. Pham, Hongyu Zhang, Jun Sun

分类: cs.CR, cs.AI

发布日期: 2026-01-19

备注: 13 pages, 1 figure

💡 一句话要点

CORVUS:通过内部信号伪装对抗大语言模型幻觉检测器

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 幻觉检测 对抗攻击 红队测试 内部信号伪装

📋 核心要点

- 现有单次幻觉检测器依赖模型内部信号,但假设幻觉会留下可分离的信号痕迹,这为对抗攻击提供了可能。

- CORVUS通过微调LoRA适配器,学习伪装模型内部的遥测信号,使幻觉行为难以被检测器识别。

- 实验表明,CORVUS能够有效降低多种幻觉检测器的性能,包括无训练和基于探针的检测器,且具有跨模型迁移能力。

📝 摘要(中文)

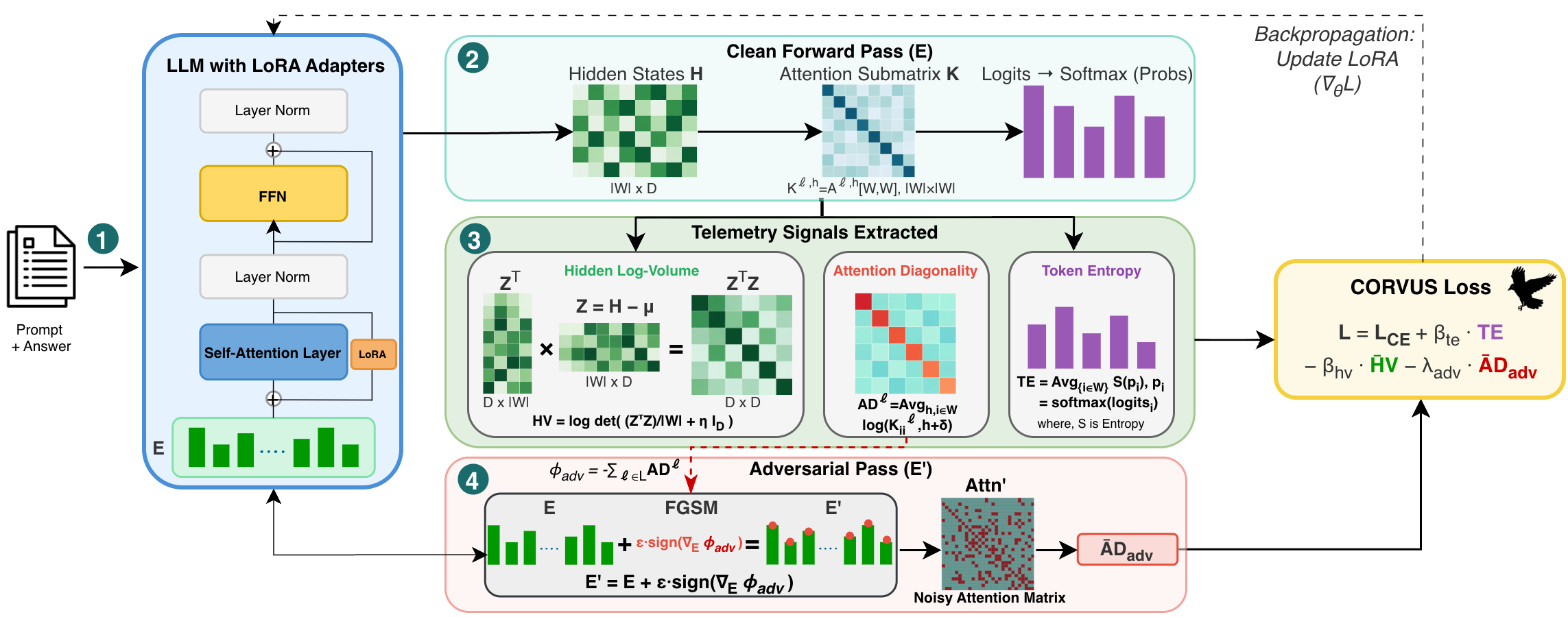

单次通过的幻觉检测器依赖于大型语言模型的内部遥测数据(例如,不确定性、隐藏状态几何结构和注意力),隐含地假设幻觉在这些信号中留下可分离的痕迹。我们研究了一种白盒、模型侧的对抗方法,该方法在保持检测器固定的同时,在模型上微调轻量级的LoRA适配器,并引入CORVUS,这是一种有效的红队程序,学习在教师强制下伪装检测器可见的遥测数据,包括嵌入空间FGSM注意力压力测试。CORVUS在1,000个分布外的Alpaca指令上进行训练(<0.5%的可训练参数),可以迁移到Llama-2、Vicuna、Llama-3和Qwen2.5上的FAVA-Annotation,并降低了无训练检测器(例如,LLM-Check)和基于探针的检测器(例如,SEP,ICR-probe)的性能,从而推动了包含外部 grounding 或跨模型证据的对抗感知审计。

🔬 方法详解

问题定义:现有幻觉检测器依赖于大语言模型内部信号(如不确定性、隐藏状态、注意力等)来识别幻觉。这些方法假设幻觉会在这些信号中留下独特的、可被检测到的痕迹。然而,这种假设可能存在漏洞,攻击者可以通过操纵这些内部信号来隐藏幻觉行为,从而绕过检测器。现有方法缺乏针对这种对抗性攻击的有效防御机制。

核心思路:CORVUS的核心思路是通过微调大语言模型,使其在生成幻觉内容的同时,能够伪装其内部信号,使其看起来与正常生成的内容相似,从而欺骗幻觉检测器。这种伪装是通过学习一个轻量级的LoRA适配器来实现的,该适配器能够修改模型的内部表示,使其在生成幻觉时不会留下明显的“幻觉痕迹”。

技术框架:CORVUS采用白盒对抗攻击框架,攻击者可以访问目标大语言模型的内部结构和参数。该框架包含以下主要步骤:1) 选择目标大语言模型和幻觉检测器;2) 使用分布外的指令数据集训练LoRA适配器,目标是最小化检测器识别幻觉的能力;3) 使用训练好的适配器修改大语言模型的行为,使其在生成幻觉内容的同时,能够伪装其内部信号。框架中使用了嵌入空间FGSM(Fast Gradient Sign Method)注意力压力测试,以进一步增强伪装效果。

关键创新:CORVUS的关键创新在于其能够学习到一种有效的内部信号伪装策略,使得大语言模型在生成幻觉内容时,能够避免被现有的幻觉检测器识别。这种伪装策略是通过微调LoRA适配器来实现的,该适配器能够以较小的计算成本修改模型的内部表示,从而实现有效的对抗攻击。此外,CORVUS还引入了嵌入空间FGSM注意力压力测试,以进一步增强伪装效果。

关键设计:CORVUS使用LoRA(Low-Rank Adaptation)作为微调方法,仅需训练少量参数(<0.5%),降低了计算成本。损失函数的设计目标是最小化幻觉检测器的输出,即使得检测器难以区分真实内容和幻觉内容。嵌入空间FGSM注意力压力测试通过在注意力权重上添加扰动,进一步增强了模型的鲁棒性和伪装能力。实验中使用了1000个分布外的Alpaca指令进行训练,并评估了在Llama-2、Vicuna、Llama-3和Qwen2.5等多个模型上的迁移能力。

🖼️ 关键图片

📊 实验亮点

CORVUS在多个大语言模型(Llama-2, Vicuna, Llama-3, Qwen2.5)上进行了评估,结果表明,即使只在1000个Alpaca指令上进行训练,CORVUS也能有效降低多种幻觉检测器的性能,包括无训练检测器(如LLM-Check)和基于探针的检测器(如SEP, ICR-probe)。这表明CORVUS具有良好的泛化能力和迁移性,能够有效地对抗现有的幻觉检测方法。

🎯 应用场景

CORVUS的研究成果可以应用于评估和改进大语言模型的安全性。通过使用CORVUS进行红队测试,可以发现现有幻觉检测器的漏洞,并促进开发更鲁棒的检测方法。此外,该研究也为开发更安全的语言模型提供了新的思路,例如,可以通过对抗训练来提高模型抵抗对抗攻击的能力。该研究对于构建可信赖的人工智能系统具有重要意义。

📄 摘要(原文)

Single-pass hallucination detectors rely on internal telemetry (e.g., uncertainty, hidden-state geometry, and attention) of large language models, implicitly assuming hallucinations leave separable traces in these signals. We study a white-box, model-side adversary that fine-tunes lightweight LoRA adapters on the model while keeping the detector fixed, and introduce CORVUS, an efficient red-teaming procedure that learns to camouflage detector-visible telemetry under teacher forcing, including an embedding-space FGSM attention stress test. Trained on 1,000 out-of-distribution Alpaca instructions (<0.5% trainable parameters), CORVUS transfers to FAVA-Annotation across Llama-2, Vicuna, Llama-3, and Qwen2.5, and degrades both training-free detectors (e.g., LLM-Check) and probe-based detectors (e.g., SEP, ICR-probe), motivating adversary-aware auditing that incorporates external grounding or cross-model evidence.