Prompt Injection Mitigation with Agentic AI, Nested Learning, and AI Sustainability via Semantic Caching

作者: Diego Gosmar, Deborah A. Dahl

分类: cs.AI, cs.MA

发布日期: 2026-01-19

备注: 33 pages, 19 figures

💡 一句话要点

提出基于Agentic AI、嵌套学习和语义缓存的提示注入缓解方法,提升LLM安全性与可持续性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 提示注入缓解 Agentic AI 嵌套学习 语义缓存 可观察性 LLM安全 AI可持续性

📋 核心要点

- 现有方法在多智能体环境中难以有效缓解提示注入攻击,中间输出可能被恶意指令利用。

- 利用Agentic AI和嵌套学习架构,结合语义相似性缓存,提升防御效果并降低计算成本。

- 实验表明,该系统在保证安全性的同时,显著降低了LLM调用次数,实现了节能减排。

📝 摘要(中文)

提示注入仍然是大型语言模型安全部署的核心障碍,尤其是在多智能体环境中,中间输出会传播或放大恶意指令。本文基于先前引入的四指标总注入漏洞评分(TIVS)的工作,通过基于语义相似性的缓存和第五个指标(可观察性评分比率)扩展了评估框架,得到TIVS-O,研究了防御有效性如何在受HOPE启发的嵌套学习架构中与透明度相互作用。所提出的系统将智能体管道与连续记忆系统相结合,该系统在来自十个攻击系列的301个合成生成的注入聚焦提示中实现基于语义相似性的缓存,而第四个智能体使用五个关键性能指标执行全面的安全分析。除了传统的注入指标外,OSR还量化了每个智能体暴露的与安全相关的推理的丰富性和清晰度,从而能够对严格缓解和可审计性之间的权衡进行显式分析。实验表明,该系统实现了安全的响应,且没有高风险违规行为,而语义缓存提供了大量的计算节省,减少了41.6%的LLM调用,并相应地减少了延迟、能源消耗和碳排放。五个TIVS-O配置揭示了缓解严格性和取证透明度之间的最佳权衡。这些结果表明,可观察性感知评估可以揭示多智能体管道中的非单调效应,并且记忆增强智能体可以共同最大化安全鲁棒性、实时性能、运营成本节省和环境可持续性,而无需修改底层模型权重,从而为安全和绿色的LLM部署提供了一条生产就绪的途径。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在多智能体环境中面临的提示注入攻击问题。现有的防御方法往往难以有效阻止恶意指令的传播和放大,尤其是在复杂的智能体交互过程中。此外,传统的安全评估方法缺乏对防御系统透明度和可审计性的考量,难以在安全性和可解释性之间取得平衡。

核心思路:论文的核心思路是构建一个基于Agentic AI和嵌套学习的防御体系,并引入语义相似性缓存机制,以提高防御效率和降低计算成本。通过可观察性评分比率(OSR)来量化防御系统的透明度,从而在缓解攻击的同时,保证系统的可审计性。

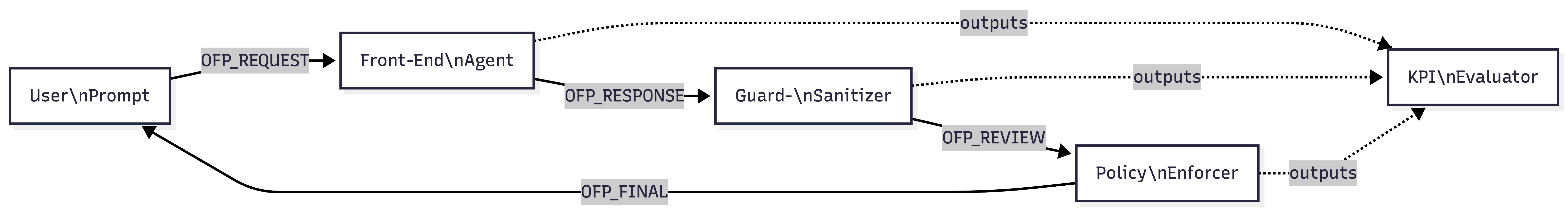

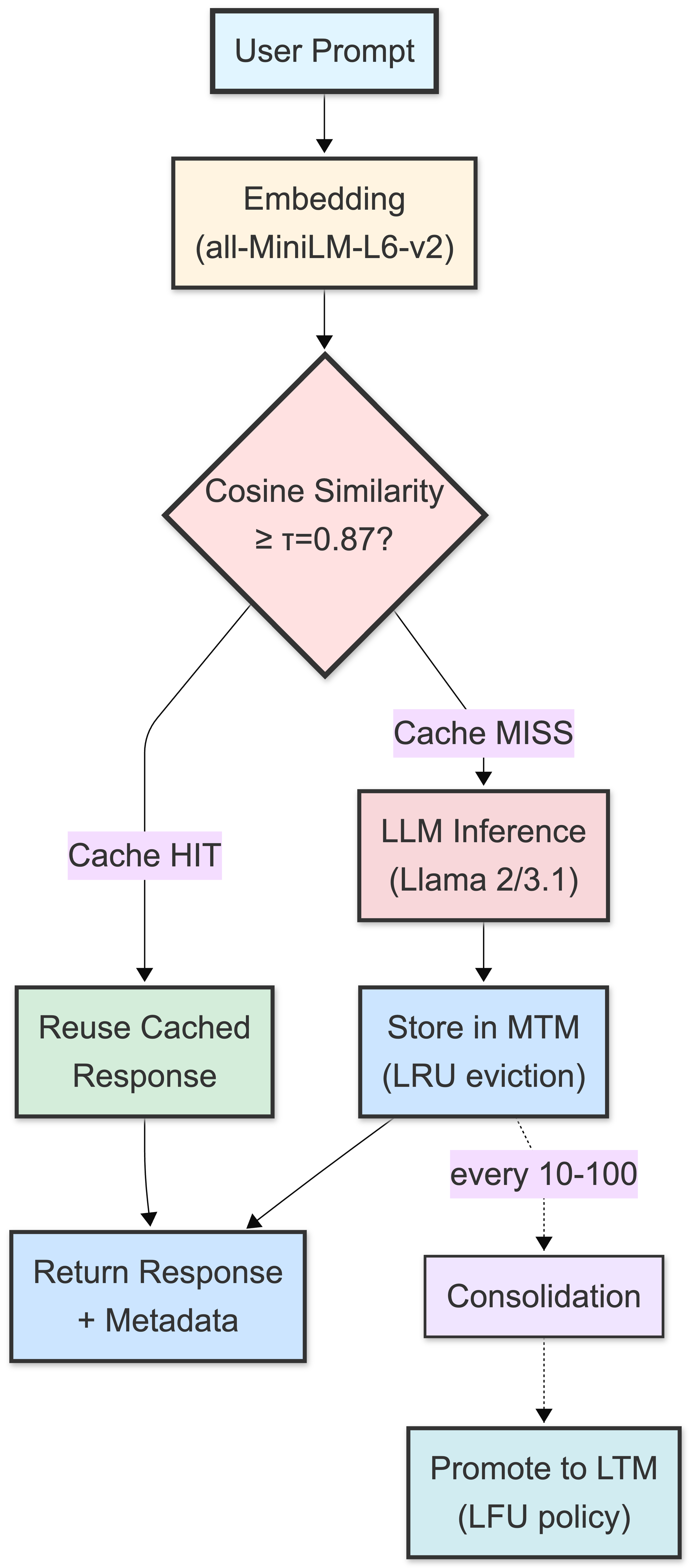

技术框架:该系统采用嵌套学习架构,包含多个智能体。一个智能体负责处理用户输入,另一个智能体负责安全分析,还有一个智能体负责执行任务。系统使用连续记忆系统实现语义相似性缓存,存储先前处理过的提示及其对应的安全分析结果。当接收到新的提示时,系统首先检查缓存中是否存在相似的提示,如果存在,则直接使用缓存结果,否则,进行安全分析并更新缓存。

关键创新:该论文的关键创新在于:1) 提出了基于语义相似性缓存的提示注入缓解方法,有效降低了LLM的调用次数,提高了防御效率;2) 引入了可观察性评分比率(OSR),用于量化防御系统的透明度,实现了安全性和可解释性的平衡;3) 构建了基于Agentic AI和嵌套学习的防御体系,提高了防御的鲁棒性。

关键设计:在语义相似性缓存中,使用了余弦相似度来衡量提示之间的相似性。OSR的计算方式为安全相关推理的丰富度和清晰度之比。实验中使用了301个合成生成的注入聚焦提示,这些提示来自十个不同的攻击家族。系统通过调整TIVS-O配置,探索了缓解严格性和取证透明度之间的最佳权衡。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该系统能够实现安全的响应,且没有高风险违规行为。语义缓存显著降低了LLM的调用次数,减少了41.6%,并相应地减少了延迟、能源消耗和碳排放。通过调整TIVS-O配置,可以实现缓解严格性和取证透明度之间的最佳权衡。

🎯 应用场景

该研究成果可应用于各种需要安全可靠的LLM部署场景,例如智能客服、自动化代码生成、金融风险评估等。通过提高LLM的安全性、降低计算成本和提升可审计性,该方法有助于推动LLM在实际应用中的广泛采用,并促进人工智能的可持续发展。

📄 摘要(原文)

Prompt injection remains a central obstacle to the safe deployment of large language models, particularly in multi-agent settings where intermediate outputs can propagate or amplify malicious instructions. Building on earlier work that introduced a four-metric Total Injection Vulnerability Score (TIVS), this paper extends the evaluation framework with semantic similarity-based caching and a fifth metric (Observability Score Ratio) to yield TIVS-O, investigating how defence effectiveness interacts with transparency in a HOPE-inspired Nested Learning architecture. The proposed system combines an agentic pipeline with Continuum Memory Systems that implement semantic similarity-based caching across 301 synthetically generated injection-focused prompts drawn from ten attack families, while a fourth agent performs comprehensive security analysis using five key performance indicators. In addition to traditional injection metrics, OSR quantifies the richness and clarity of security-relevant reasoning exposed by each agent, enabling an explicit analysis of trade-offs between strict mitigation and auditability. Experiments show that the system achieves secure responses with zero high-risk breaches, while semantic caching delivers substantial computational savings, achieving a 41.6% reduction in LLM calls and corresponding decreases in latency, energy consumption, and carbon emissions. Five TIVS-O configurations reveal optimal trade-offs between mitigation strictness and forensic transparency. These results indicate that observability-aware evaluation can reveal non-monotonic effects within multi-agent pipelines and that memory-augmented agents can jointly maximize security robustness, real-time performance, operational cost savings, and environmental sustainability without modifying underlying model weights, providing a production-ready pathway for secure and green LLM deployments.