Communication Methods in Multi-Agent Reinforcement Learning

作者: Christoph Wittner

分类: cs.MA, cs.AI, cs.LG

发布日期: 2026-01-19

备注: 12 pages, 2 figures

💡 一句话要点

综述多智能体强化学习中的通信方法,分析优劣并指出未来研究方向

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多智能体强化学习 通信方法 显式通信 隐式通信 注意力机制 图神经网络 分层强化学习

📋 核心要点

- 多智能体强化学习面临部分可观测、非平稳环境以及动作空间指数增长等挑战,现有方法难以有效解决。

- 本文通过深入分析多种通信机制,旨在为多智能体强化学习提供通信方法的全面概述和选择指导。

- 研究表明,没有适用于所有问题的通用通信框架,通信方法的选择应高度依赖于具体问题,并需关注计算开销。

📝 摘要(中文)

多智能体强化学习是一个很有前景的研究领域,它将已建立的强化学习方法扩展到多智能体系统问题。最近,大量的通信方法被引入该领域,以解决诸如部分可观察环境、非平稳性和指数增长的动作空间等问题。通信进一步实现了在环境中交互的所有智能体之间的有效合作。本文旨在概述多智能体强化学习中的通信技术。通过对该主题的29篇出版物的深入分析,评估了显式、隐式、基于注意力、基于图和基于分层/角色的通信的优缺点。比较结果表明,对于每个问题,没有通用的、最佳的通信框架。相反,通信的选择在很大程度上取决于手头的问题。比较还强调了具有低计算开销的通信方法的重要性,以实现可扩展到许多智能体交互的环境。最后,本文讨论了当前的研究差距,强调需要对系统级指标进行标准化基准测试,并在实际通信条件下提高鲁棒性,以增强这些方法在现实世界中的适用性。

🔬 方法详解

问题定义:多智能体强化学习中,智能体间的有效通信是解决部分可观测环境、非平稳性以及动作空间爆炸的关键。现有方法在计算开销、泛化能力和鲁棒性方面存在不足,难以适应复杂多变的环境。

核心思路:本文的核心在于对现有通信方法进行分类和评估,分析其在不同场景下的优缺点,从而为研究者提供选择和设计通信机制的指导。通过对比不同方法的性能,揭示其适用范围和局限性。

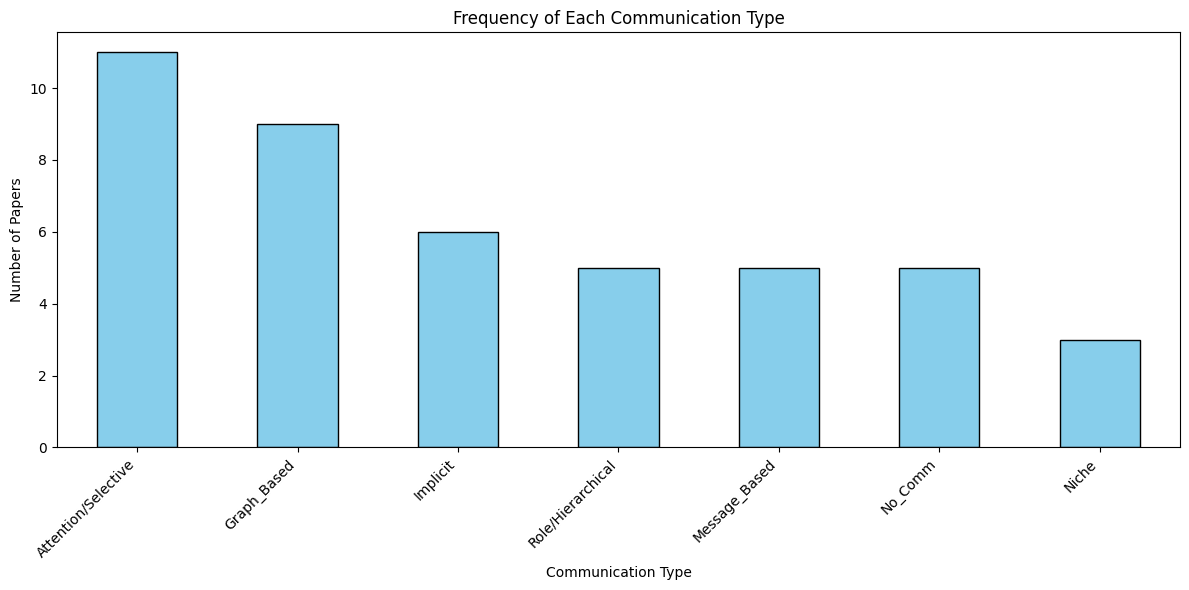

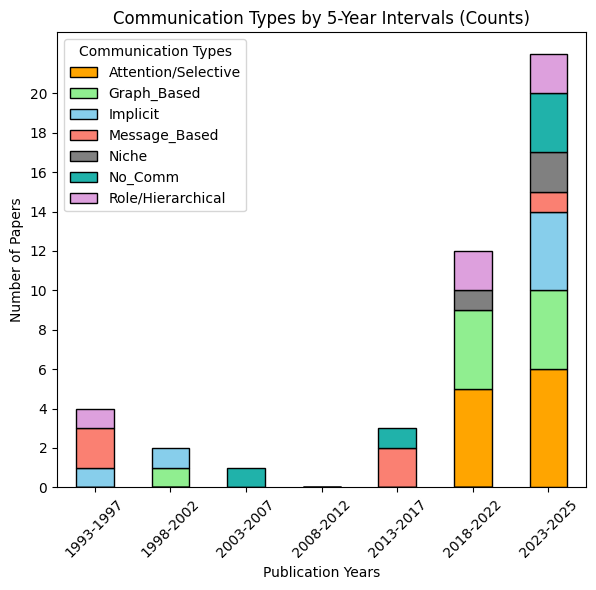

技术框架:本文通过文献调研,将多智能体强化学习中的通信方法分为五类:显式通信、隐式通信、基于注意力的通信、基于图的通信和基于分层/角色的通信。然后,对每种类型的代表性方法进行深入分析,包括其原理、优缺点和适用场景。

关键创新:本文的创新之处在于对现有通信方法进行了系统性的分类和比较,并指出了不同方法之间的联系和区别。此外,本文还强调了计算开销的重要性,并提出了未来研究方向,例如标准化基准测试和提高鲁棒性。

关键设计:本文主要关注不同通信方法的理论分析和性能比较,并未涉及具体的参数设置或网络结构设计。然而,文章强调了在实际应用中需要考虑计算开销,并根据具体问题选择合适的通信方法。

🖼️ 关键图片

📊 实验亮点

本文通过对29篇相关文献的深入分析,对比了不同通信方法在多智能体强化学习中的表现。研究结果表明,没有一种通用的最佳通信框架,通信方法的选择应取决于具体问题。此外,研究强调了低计算开销通信方法的重要性,以实现系统在多智能体环境中的可扩展性。

🎯 应用场景

该研究成果可应用于机器人协同、自动驾驶、智能交通、博弈对抗等领域。通过选择合适的通信机制,可以提高多智能体系统的协作效率、鲁棒性和泛化能力,从而实现更智能、更高效的决策和控制。

📄 摘要(原文)

Multi-agent reinforcement learning is a promising research area that extends established reinforcement learning approaches to problems formulated as multi-agent systems. Recently, a multitude of communication methods have been introduced to this field to address problems such as partially observable environments, non-stationarity, and exponentially growing action spaces. Communication further enables efficient cooperation among all agents interacting in an environment. This work aims at providing an overview of communication techniques in multi-agent reinforcement learning. By an in-depth analysis of 29 publications on this topic, the strengths and weaknesses of explicit, implicit, attention-based, graph-based, and hierarchical/role-based communication are evaluated. The results of this comparison show that there is no general, optimal communication framework for every problem. On the contrary, the choice of communication depends heavily on the problem at hand. The comparison also highlights the importance of communication methods with low computational overhead to enable scalability to environments where many agents interact. Finally, the paper discusses current research gaps, emphasizing the need for standardized benchmarking of system-level metrics and improved robustness under realistic communication conditions to enhance the real-world applicability of these approaches.