Vision Language Models for Optimization-Driven Intent Processing in Autonomous Networks

作者: Tasnim Ahmed, Yifan Zhu, Salimur Choudhury

分类: cs.AI, cs.NI, cs.SE

发布日期: 2026-01-19

备注: Accepted for presentation at The IEEE International Conference on Communications (ICC) 2026

💡 一句话要点

IntentOpt:评估视觉语言模型在自治网络中优化驱动意图处理的能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言模型 意图网络 优化代码生成 网络拓扑 多模态学习

📋 核心要点

- 现有基于意图的网络系统依赖于文本描述网络拓扑和参数,缺乏利用网络图直观表达的能力。

- 提出IntentOpt基准,探索视觉语言模型处理带注释的网络草图并生成优化代码的可行性。

- 实验评估了多个VLM在不同提示策略下的性能,揭示了视觉信息处理的挑战和开源模型的差距。

📝 摘要(中文)

本文研究了视觉语言模型(VLM)在基于意图的网络(IBN)中,将带注释的网络草图转化为优化代码的能力。IBN允许运营商指定高级网络目标,而无需进行底层配置。虽然大型语言模型已用于自动化配置任务,但某些意图需要生成优化代码来计算流量工程、路由和资源分配的最佳解决方案。本文提出了IntentOpt,一个包含17个类别共85个优化问题的基准,用于评估四个VLM(GPT-5-Mini、Claude-Haiku-4.5、Gemini-2.5-Flash、Llama-3.2-11B-Vision)在多模态与纯文本输入下,三种提示策略的表现。评估结果表明,视觉参数提取使执行成功率降低了12-21个百分点,程序思维提示使性能降低了高达13个百分点。开源模型落后于闭源模型。通过使用模型上下文协议将VLM生成的代码部署到网络测试平台基础设施的案例研究,证明了实际可行性。结果确立了当前VLM在IBN系统中生成优化代码的基线能力和局限性。

🔬 方法详解

问题定义:论文旨在解决基于意图的网络(IBN)中,如何利用视觉语言模型(VLM)将网络拓扑图转换为优化代码的问题。现有的IBN系统通常依赖于文本描述网络拓扑和参数,这种方式不够直观,且容易出错。网络工程师更习惯于使用图表来表达网络结构,因此需要一种能够理解网络图并自动生成优化代码的方法。

核心思路:论文的核心思路是利用VLM的多模态能力,直接从带注释的网络草图中提取网络拓扑和参数信息,并将其转化为优化代码。通过这种方式,可以简化IBN的配置过程,提高效率,并减少人为错误。论文设计了IntentOpt基准,用于评估不同VLM在这一任务上的表现。

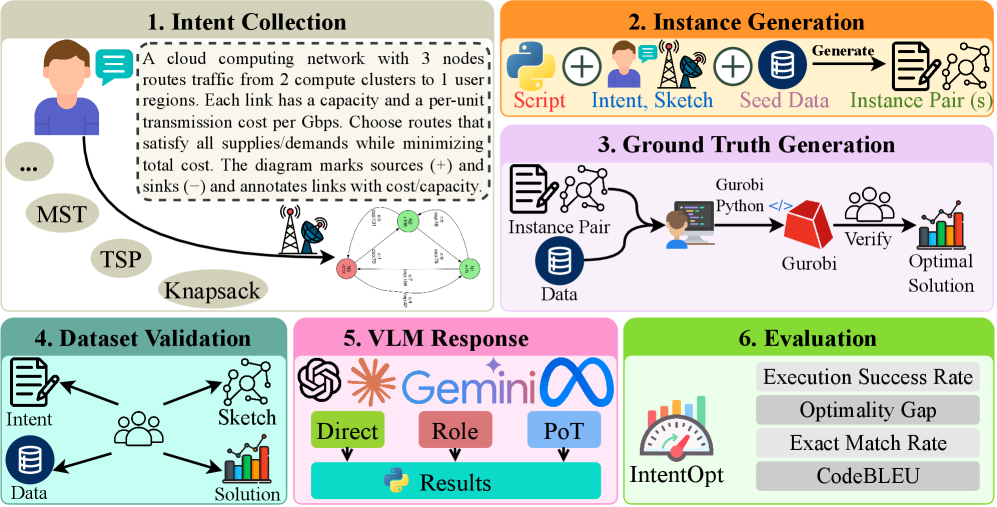

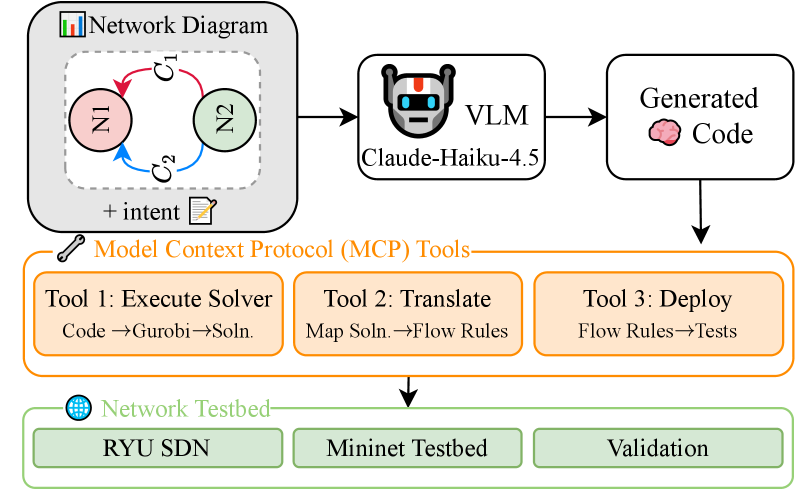

技术框架:论文的技术框架主要包括以下几个部分:1)IntentOpt基准数据集的构建,包含17个类别共85个优化问题,每个问题都包含网络拓扑图和相应的优化目标;2)选择四个VLM模型(GPT-5-Mini、Claude-Haiku-4.5、Gemini-2.5-Flash、Llama-3.2-11B-Vision)进行评估;3)设计三种提示策略,包括标准提示、程序思维提示等;4)评估VLM在多模态输入(网络图+文本)和纯文本输入下的性能;5)通过案例研究,将VLM生成的代码部署到网络测试平台基础设施中进行验证。

关键创新:论文的关键创新在于:1)提出了IntentOpt基准,为评估VLM在IBN中的应用提供了一个标准化的平台;2)首次探索了VLM直接从网络拓扑图中生成优化代码的可行性;3)通过实验评估,揭示了当前VLM在处理视觉信息方面的局限性,并为未来的研究方向提供了指导。

关键设计:论文的关键设计包括:1)IntentOpt基准数据集的设计,涵盖了各种常见的网络优化问题,并提供了详细的注释;2)三种提示策略的设计,旨在引导VLM更好地理解问题并生成正确的代码;3)评估指标的选择,包括执行成功率等,能够全面反映VLM的性能;4)案例研究的设计,验证了VLM生成的代码在实际网络环境中的可行性。

🖼️ 关键图片

📊 实验亮点

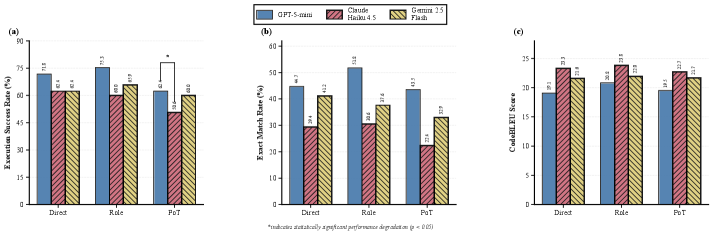

实验结果表明,视觉参数提取会降低VLM的执行成功率,例如GPT-5-Mini从93%降至72%。程序思维提示也会降低性能,最高达13个百分点。闭源模型优于开源模型,GPT-5-Mini的成功率为75%,而Llama-3.2-11B-Vision仅为18%。这些结果揭示了当前VLM在处理网络拓扑图和生成优化代码方面的局限性。

🎯 应用场景

该研究成果可应用于自动化网络配置、智能网络管理和优化等领域。通过VLM自动生成优化代码,可以降低网络管理的复杂性,提高网络效率,并减少人为错误。未来,该技术有望应用于更复杂的网络环境,例如5G/6G网络、云计算数据中心等,实现更智能、更高效的网络管理。

📄 摘要(原文)

Intent-Based Networking (IBN) allows operators to specify high-level network goals rather than low-level configurations. While recent work demonstrates that large language models can automate configuration tasks, a distinct class of intents requires generating optimization code to compute provably optimal solutions for traffic engineering, routing, and resource allocation. Current systems assume text-based intent expression, requiring operators to enumerate topologies and parameters in prose. Network practitioners naturally reason about structure through diagrams, yet whether Vision-Language Models (VLMs) can process annotated network sketches into correct optimization code remains unexplored. We present IntentOpt, a benchmark of 85 optimization problems across 17 categories, evaluating four VLMs (GPT-5-Mini, Claude-Haiku-4.5, Gemini-2.5-Flash, Llama-3.2-11B-Vision) under three prompting strategies on multimodal versus text-only inputs. Our evaluation shows that visual parameter extraction reduces execution success by 12-21 percentage points (pp), with GPT-5-Mini dropping from 93% to 72%. Program-of-thought prompting decreases performance by up to 13 pp, and open-source models lag behind closed-source ones, with Llama-3.2-11B-Vision reaching 18% compared to 75% for GPT-5-Mini. These results establish baseline capabilities and limitations of current VLMs for optimization code generation within an IBN system. We also demonstrate practical feasibility through a case study that deploys VLM-generated code to network testbed infrastructure using Model Context Protocol.