STEP-LLM: Generating CAD STEP Models from Natural Language with Large Language Models

作者: Xiangyu Shi, Junyang Ding, Xu Zhao, Sinong Zhan, Payal Mohapatra, Daniel Quispe, Kojo Welbeck, Jian Cao, Wei Chen, Ping Guo, Qi Zhu

分类: cs.AI

发布日期: 2026-01-19

备注: Accepted to the Design, Automation & Test in Europe Conference (DATE) 2026

💡 一句话要点

STEP-LLM:利用大语言模型从自然语言生成CAD STEP模型,提升几何保真度。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 文本到CAD 大型语言模型 STEP文件 几何建模 深度优先搜索 强化学习 检索增强生成 CAD设计

📋 核心要点

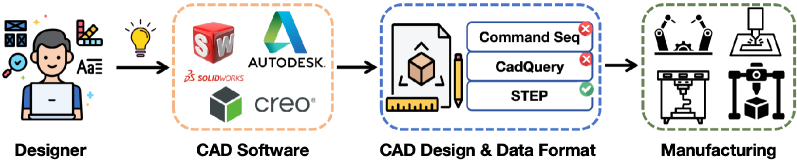

- 现有文本到CAD方法依赖于内核特定的命令序列或脚本,缺乏制造的通用性,无法直接用于生产。

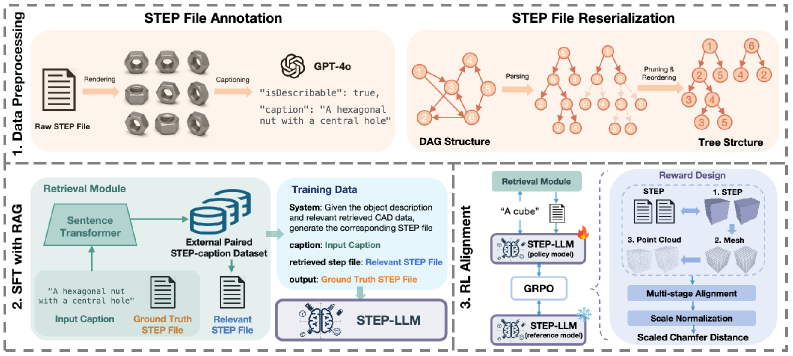

- STEP-LLM通过深度优先搜索重序列化STEP文件,并结合链式思考注释,优化了LLM对图结构数据的处理。

- 实验结果表明,STEP-LLM在几何保真度上显著优于现有方法,证明了其在CAD设计领域的潜力。

📝 摘要(中文)

计算机辅助设计(CAD)对现代制造业至关重要,但模型创建仍然是劳动密集型且需要专业知识。为了使非专业人士能够将直观的设计意图转化为可制造的制品,最近基于大型语言模型的文本到CAD的研究主要集中在命令序列或基于脚本的格式(如CadQuery)上。然而,这些格式依赖于内核,并且缺乏制造的通用性。相比之下,产品数据交换标准(STEP, ISO 10303)文件是一种被广泛采用的、中性的边界表示(B-rep)格式,可直接与制造兼容,但其图结构、交叉引用的性质对自回归LLM提出了独特的挑战。为了解决这个问题,我们整理了一个包含约4万个STEP-caption对的数据集,并引入了专门为STEP的图结构格式量身定制的预处理方法,包括基于深度优先搜索的重新序列化,该方法线性化了交叉引用,同时保留了局部性,以及链式思考(CoT)风格的结构注释,以指导全局连贯性。我们集成了检索增强生成,以在相关示例中进行预测,用于监督微调,并通过强化学习,使用特定的基于倒角距离的几何奖励来改进生成质量。实验表明,我们的STEP-LLM在几何保真度方面始终优于Text2CAD基线,改进来自我们框架的多个阶段:RAG模块显著提高了完整性和可渲染性,基于DFS的重新序列化增强了整体准确性,RL进一步减少了几何差异。指标和视觉比较都证实,STEP-LLM生成的形状比Text2CAD具有更高的保真度。这些结果表明了LLM驱动的从自然语言生成STEP模型的可行性,显示了其在制造领域普及CAD设计的潜力。

🔬 方法详解

问题定义:现有文本到CAD的方法,例如基于CadQuery等脚本语言的方法,依赖于特定的CAD内核,导致生成的模型缺乏通用性,难以直接应用于实际的制造流程。STEP文件作为一种通用的、中性的边界表示格式,能够直接与制造流程兼容,但其图结构的特性以及大量的交叉引用,给基于LLM的自回归生成带来了挑战。

核心思路:STEP-LLM的核心思路是利用大型语言模型强大的文本生成能力,直接从自然语言描述生成STEP格式的CAD模型。为了克服STEP文件图结构的复杂性,论文提出了一系列预处理和优化策略,包括重新序列化、结构化注释和强化学习,以提高生成模型的几何保真度和整体质量。

技术框架:STEP-LLM的整体框架包含以下几个主要模块:1) 数据集构建:构建包含约4万个STEP文件和对应自然语言描述的数据集。2) 预处理:对STEP文件进行深度优先搜索(DFS)的重新序列化,将图结构转化为线性序列,并添加链式思考(CoT)风格的结构化注释,以帮助LLM理解STEP文件的结构。3) 检索增强生成(RAG):利用RAG模块,根据输入的自然语言描述,检索最相关的STEP文件示例,作为LLM生成的参考。4) 监督微调:使用预处理后的数据集和RAG检索到的示例,对LLM进行监督微调。5) 强化学习:使用基于倒角距离的几何奖励函数,通过强化学习进一步优化生成模型的几何保真度。

关键创新:STEP-LLM的关键创新在于针对STEP文件图结构的特性,提出了深度优先搜索的重新序列化方法和链式思考风格的结构化注释。这种方法能够有效地将复杂的图结构信息转化为LLM更容易处理的线性序列,并帮助LLM理解STEP文件的结构和语义。此外,利用强化学习进一步优化几何保真度也是一个重要的创新点。

关键设计:在预处理阶段,深度优先搜索的重新序列化方法旨在保留STEP文件中的局部信息,并减少交叉引用的距离。链式思考风格的结构化注释则通过添加额外的结构化信息,帮助LLM理解STEP文件的层次结构和组件之间的关系。在强化学习阶段,倒角距离被用作奖励函数,以鼓励生成模型生成更精确的几何形状。RAG模块使用余弦相似度来检索最相关的STEP文件示例。

🖼️ 关键图片

📊 实验亮点

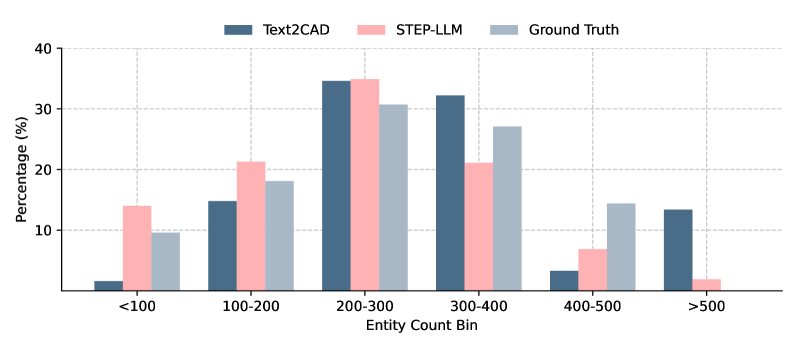

实验结果表明,STEP-LLM在几何保真度方面显著优于Text2CAD基线模型。RAG模块的引入显著提高了生成模型的完整性和可渲染性,DFS重序列化增强了整体准确性,而强化学习则进一步降低了几何差异。指标和视觉比较均证实,STEP-LLM生成的形状具有更高的保真度。

🎯 应用场景

STEP-LLM具有广泛的应用前景,可用于快速原型设计、定制化产品制造、以及CAD教育等领域。它降低了CAD设计的门槛,使非专业人士也能参与到产品设计过程中,加速产品创新和迭代。未来,该技术有望与智能制造系统集成,实现自动化CAD设计和生产。

📄 摘要(原文)

Computer-aided design (CAD) is vital to modern manufacturing, yet model creation remains labor-intensive and expertise-heavy. To enable non-experts to translate intuitive design intent into manufacturable artifacts, recent large language models-based text-to-CAD efforts focus on command sequences or script-based formats like CadQuery. However, these formats are kernel-dependent and lack universality for manufacturing. In contrast, the Standard for the Exchange of Product Data (STEP, ISO 10303) file is a widely adopted, neutral boundary representation (B-rep) format directly compatible with manufacturing, but its graph-structured, cross-referenced nature poses unique challenges for auto-regressive LLMs. To address this, we curate a dataset of ~40K STEP-caption pairs and introduce novel preprocessing tailored for the graph-structured format of STEP, including a depth-first search-based reserialization that linearizes cross-references while preserving locality and chain-of-thought(CoT)-style structural annotations that guide global coherence. We integrate retrieval-augmented generation to ground predictions in relevant examples for supervised fine-tuning, and refine generation quality through reinforcement learning with a specific Chamfer Distance-based geometric reward. Experiments demonstrate consistent gains of our STEP-LLM in geometric fidelity over the Text2CAD baseline, with improvements arising from multiple stages of our framework: the RAG module substantially enhances completeness and renderability, the DFS-based reserialization strengthens overall accuracy, and the RL further reduces geometric discrepancy. Both metrics and visual comparisons confirm that STEP-LLM generates shapes with higher fidelity than Text2CAD. These results show the feasibility of LLM-driven STEP model generation from natural language, showing its potential to democratize CAD design for manufacturing.