SD-RAG: A Prompt-Injection-Resilient Framework for Selective Disclosure in Retrieval-Augmented Generation

作者: Aiman Al Masoud, Marco Arazzi, Antonino Nocera

分类: cs.CR, cs.AI

发布日期: 2026-01-16

💡 一句话要点

SD-RAG:一种针对提示注入攻击的检索增强生成选择性披露框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强生成 选择性披露 提示注入攻击 安全策略 隐私保护

📋 核心要点

- 现有RAG方法在处理敏感信息时存在安全风险,容易受到提示注入攻击,导致信息泄露。

- SD-RAG通过在检索阶段实施清理和披露控制,将安全约束与生成过程解耦,避免了提示级别的脆弱性。

- 实验结果表明,SD-RAG在隐私保护方面显著优于现有方法,并且对提示注入攻击具有更强的抵抗力,隐私得分提升高达58%。

📝 摘要(中文)

检索增强生成(RAG)因其结合了大型语言模型(LLM)的生成能力与通过大规模数据集合上的高效检索机制获得的知识的能力而备受关注。目前,大多数现有方法忽略了将敏感或访问控制信息直接暴露给生成模型相关的风险。只有少数方法提出了指示生成模型避免披露敏感信息的技术;然而,最近的研究也表明,LLM仍然容易受到提示注入攻击的影响,这些攻击可以覆盖预期的行为约束。因此,我们提出了一种新的检索增强生成中的选择性披露方法,称为SD-RAG,它将安全和隐私约束的执行与生成过程本身分离。SD-RAG不是依赖于提示级别的保护措施,而是在检索阶段,在增强语言模型的输入之前,应用清理和披露控制。此外,我们引入了一种语义机制,允许摄取人类可读的动态安全和隐私约束,以及一种优化的基于图的数据模型,该模型支持细粒度的、策略感知的检索。我们的实验评估表明,SD-RAG优于现有的基线方法,在隐私得分方面提高了高达58%,同时也显示出对针对生成模型的提示注入攻击的强大抵抗力。

🔬 方法详解

问题定义:现有检索增强生成(RAG)方法在处理包含敏感或受访问控制的数据时,容易受到提示注入攻击的影响。攻击者可以通过精心设计的提示绕过模型自身的安全策略,从而泄露不应公开的信息。现有的方法主要依赖于提示级别的安全措施,但这些措施已被证明容易被绕过,无法有效防止提示注入攻击。

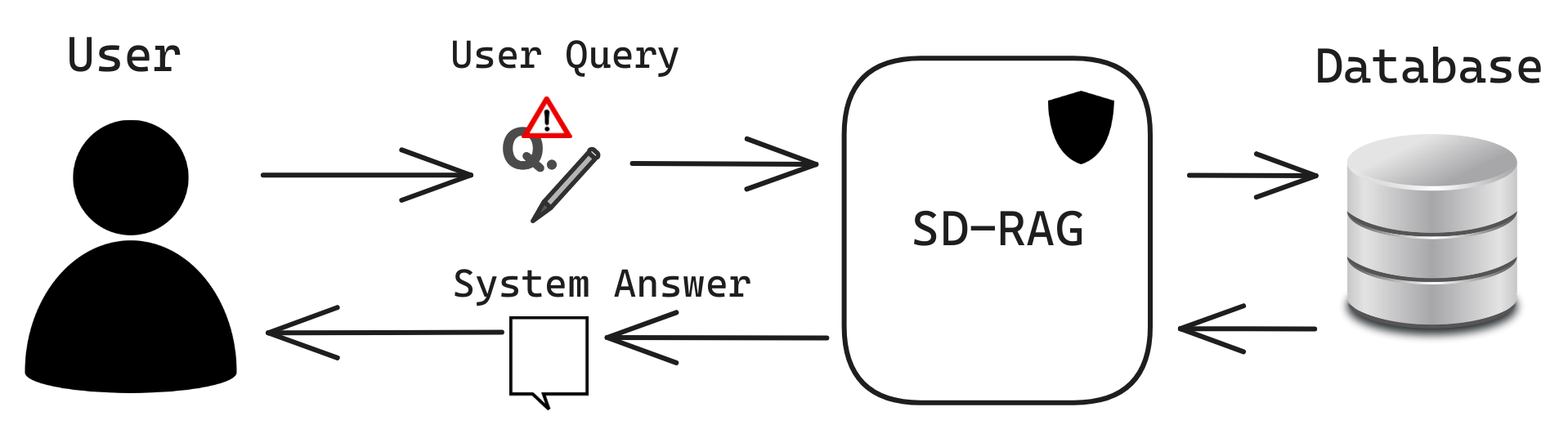

核心思路:SD-RAG的核心思路是在检索阶段实施选择性披露,即在将检索到的文档传递给生成模型之前,对其进行清理和过滤,确保只提供符合安全和隐私策略的信息。通过将安全约束的执行从生成阶段转移到检索阶段,SD-RAG可以有效地防止提示注入攻击,因为即使攻击者能够操纵生成模型的行为,他们也无法访问未经授权的信息。

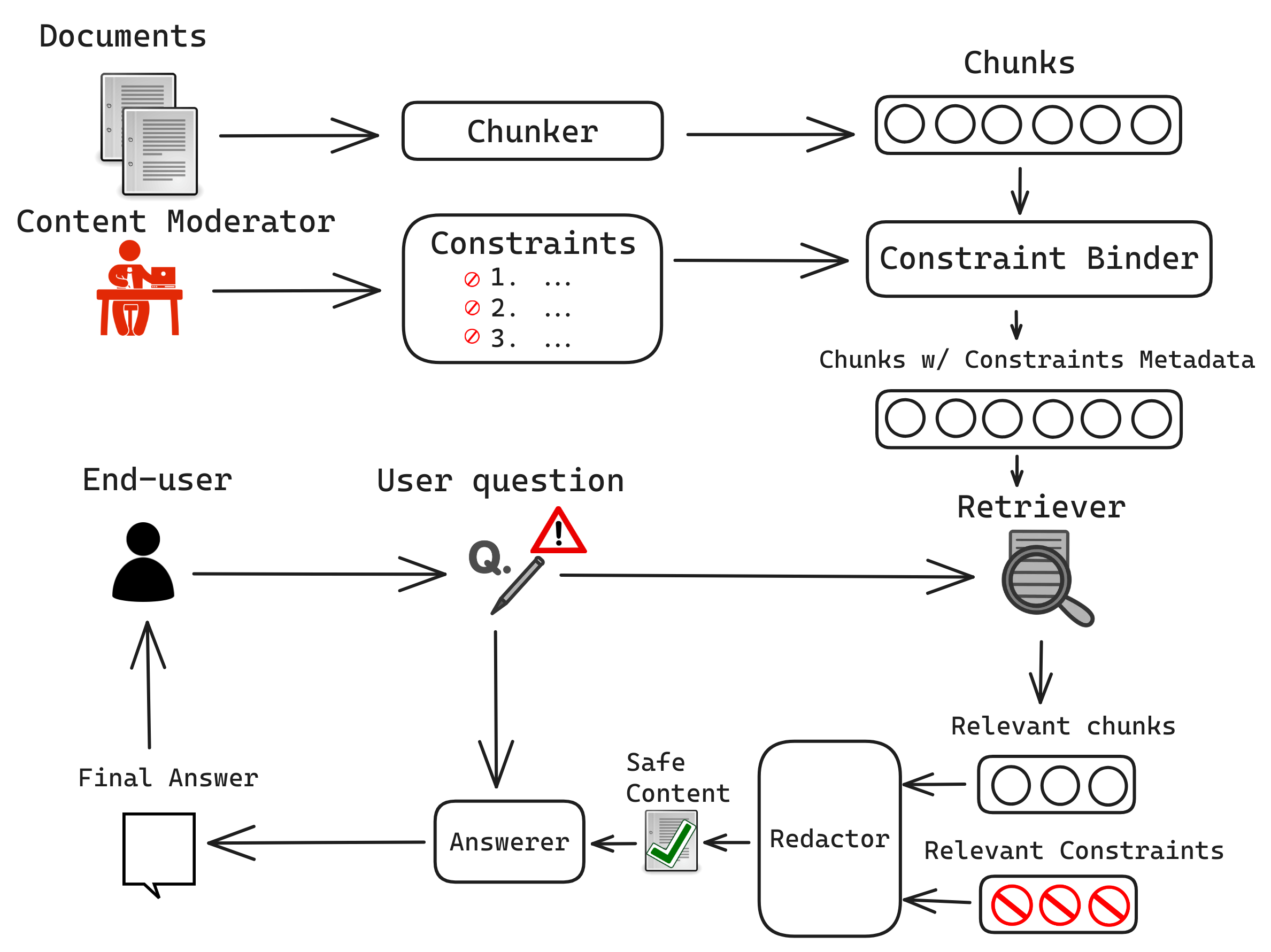

技术框架:SD-RAG框架包含以下几个主要模块:1) 数据摄取模块:负责将数据加载到图数据库中,并关联相应的安全和隐私策略。2) 策略管理模块:允许用户定义和管理动态的安全和隐私约束,这些约束以人类可读的形式表示。3) 检索模块:根据用户的查询和策略,从图数据库中检索相关文档。4) 清理和过滤模块:根据策略对检索到的文档进行清理和过滤,移除敏感信息。5) 生成模块:使用清理后的文档作为上下文,生成最终的输出。

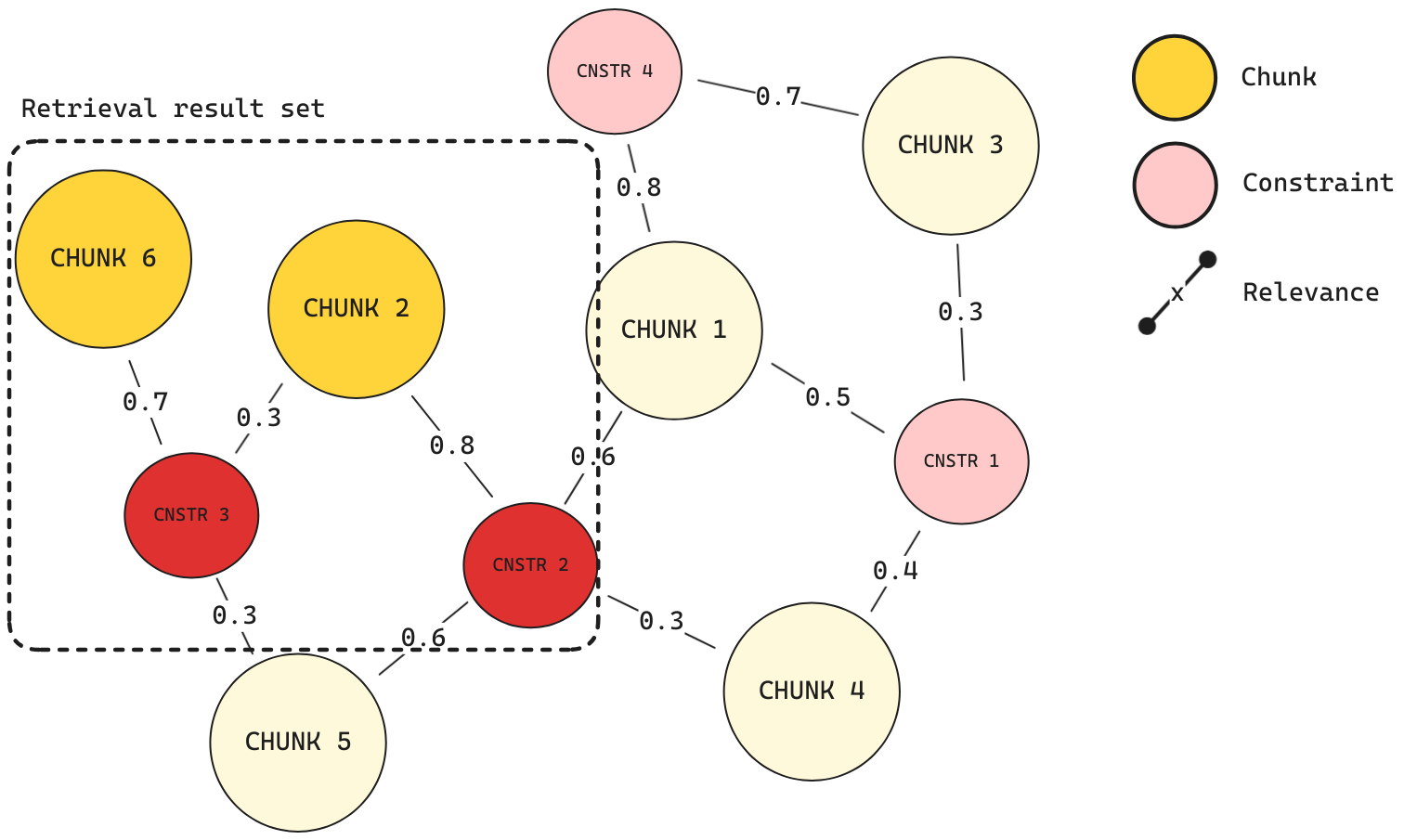

关键创新:SD-RAG的关键创新在于其将安全和隐私约束的执行与生成过程解耦。通过在检索阶段实施选择性披露,SD-RAG可以有效地防止提示注入攻击,而无需依赖于提示级别的安全措施。此外,SD-RAG还引入了一种语义机制,允许摄取人类可读的动态安全和隐私约束,以及一种优化的基于图的数据模型,该模型支持细粒度的、策略感知的检索。

关键设计:SD-RAG使用图数据库来存储数据和策略,图的节点表示文档和实体,边表示它们之间的关系。策略以属性图的形式存储,并与相应的节点关联。检索模块使用图遍历算法来查找与查询相关的文档,并根据策略对这些文档进行过滤。清理和过滤模块使用正则表达式和自然语言处理技术来识别和移除敏感信息。具体的参数设置、损失函数、网络结构等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SD-RAG在隐私保护方面显著优于现有的基线方法,隐私得分提高了高达58%。此外,SD-RAG还显示出对提示注入攻击的强大抵抗力,即使在攻击者试图操纵生成模型的情况下,也能有效地防止敏感信息的泄露。这些结果证明了SD-RAG在保护隐私和安全方面的有效性。

🎯 应用场景

SD-RAG可应用于需要处理敏感信息的各种场景,例如医疗保健、金融服务和法律领域。它可以帮助组织在利用大型语言模型的能力的同时,保护用户的隐私和数据的安全。未来,SD-RAG可以扩展到支持更复杂的安全策略和更细粒度的数据访问控制,从而进一步提高其适用性和有效性。

📄 摘要(原文)

Retrieval-Augmented Generation (RAG) has attracted significant attention due to its ability to combine the generative capabilities of Large Language Models (LLMs) with knowledge obtained through efficient retrieval mechanisms over large-scale data collections. Currently, the majority of existing approaches overlook the risks associated with exposing sensitive or access-controlled information directly to the generation model. Only a few approaches propose techniques to instruct the generative model to refrain from disclosing sensitive information; however, recent studies have also demonstrated that LLMs remain vulnerable to prompt injection attacks that can override intended behavioral constraints. For these reasons, we propose a novel approach to Selective Disclosure in Retrieval-Augmented Generation, called SD-RAG, which decouples the enforcement of security and privacy constraints from the generation process itself. Rather than relying on prompt-level safeguards, SD-RAG applies sanitization and disclosure controls during the retrieval phase, prior to augmenting the language model's input. Moreover, we introduce a semantic mechanism to allow the ingestion of human-readable dynamic security and privacy constraints together with an optimized graph-based data model that supports fine-grained, policy-aware retrieval. Our experimental evaluation demonstrates the superiority of SD-RAG over baseline existing approaches, achieving up to a $58\%$ improvement in the privacy score, while also showing a strong resilience to prompt injection attacks targeting the generative model.