Generative AI collective behavior needs an interactionist paradigm

作者: Laura Ferrarotti, Gian Maria Campedelli, Roberto Dessì, Andrea Baronchelli, Giovanni Iacca, Kathleen M. Carley, Alex Pentland, Joel Z. Leibo, James Evans, Bruno Lepri

分类: cs.AI, cs.CY, cs.HC, cs.LG, cs.MA

发布日期: 2026-01-15

💡 一句话要点

提出交互主义范式,以理解生成式AI群体行为并应对潜在风险。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 群体行为 交互主义范式 社会环境 智能体建模

📋 核心要点

- 现有方法难以充分理解LLM智能体的集体行为,忽略了预训练知识和社会先验的影响。

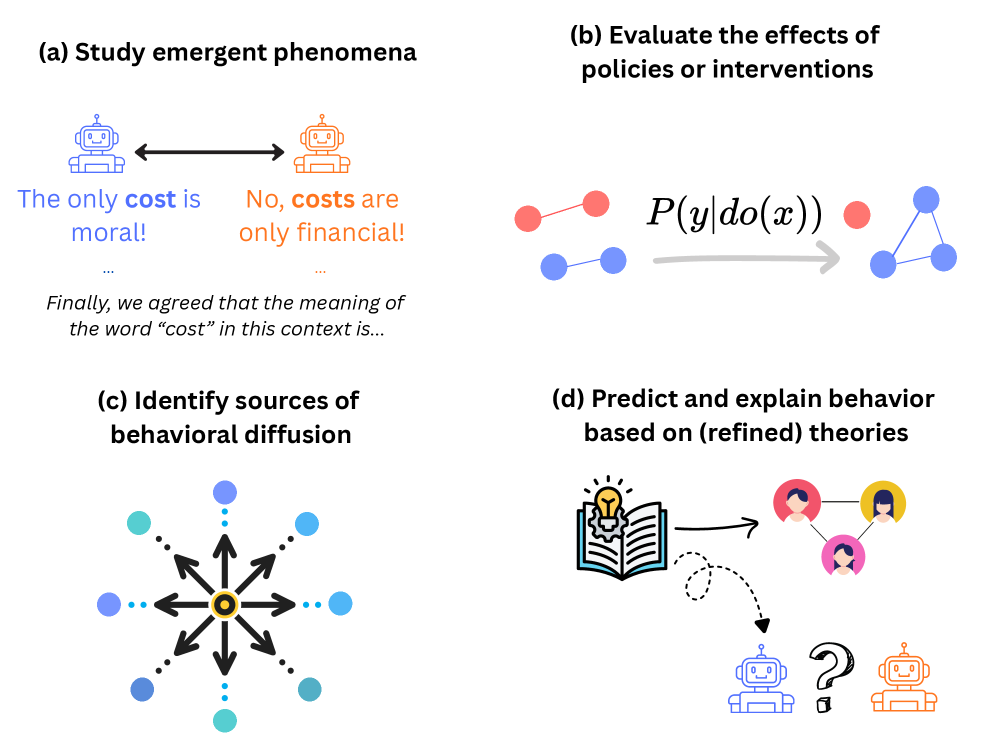

- 论文提出交互主义范式,强调先验知识、社会环境与智能体行为的相互作用。

- 论文聚焦理论、方法和跨学科对话,为LLM智能体集体行为的研究提供指导。

📝 摘要(中文)

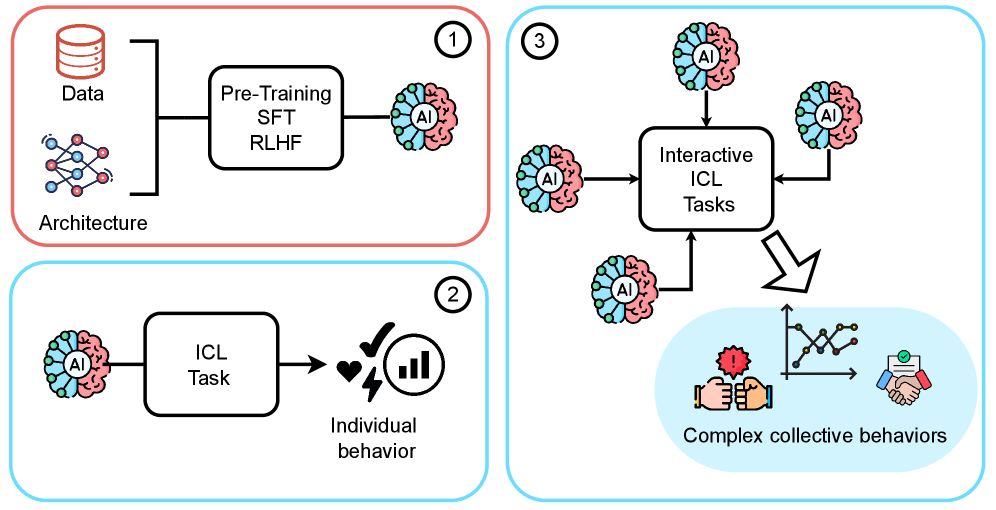

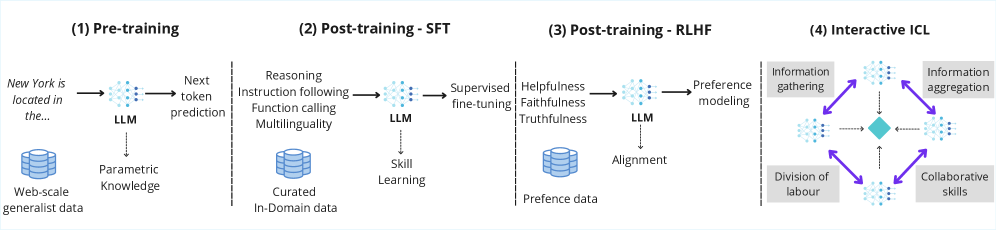

本文认为,理解基于大型语言模型(LLM)的智能体的集体行为至关重要,这在风险和收益方面具有重要意义,并在多个层面上影响着我们的社会。我们认为,LLM的独特之处——即它们通过广泛的预训练知识和内隐的社会先验进行初始化,以及它们通过上下文学习进行适应的能力——促使我们需要一种交互主义范式,该范式由替代的理论基础、方法论和分析工具组成,以便系统地考察先验知识和嵌入的价值观如何与社会环境相互作用,从而塑造多智能体生成式AI系统中的涌现现象。我们提出并讨论了四个我们认为对基于LLM的集体的发展和部署至关重要的方向,重点关注理论、方法和跨学科对话。

🔬 方法详解

问题定义:当前对于基于大型语言模型(LLM)的智能体集体行为的理解不足,尤其是在考虑LLM预训练知识、内隐社会先验以及上下文学习能力的情况下。现有的方法可能无法充分捕捉这些因素如何与社会环境相互作用,从而影响智能体的行为模式和涌现现象。这导致我们难以预测和控制LLM智能体在复杂社会环境中的行为,从而带来潜在的风险。

核心思路:论文的核心思路是引入一种“交互主义范式”,该范式强调先验知识、嵌入价值观和社会环境之间的相互作用。这种范式认为,LLM智能体的行为不仅仅是其自身属性的简单反映,而是这些属性与所处社会环境动态交互的结果。通过理解这种交互作用,我们可以更好地预测和塑造LLM智能体的集体行为。

技术框架:论文并没有提出一个具体的、可执行的技术框架,而是更侧重于理论和方法论的层面。它强调需要从理论、方法和跨学科对话三个方面入手,来发展和部署基于LLM的集体。这意味着需要构建新的理论模型来解释LLM智能体的行为,开发新的方法来分析和模拟这些行为,并促进不同学科之间的交流与合作。

关键创新:论文的关键创新在于提出了“交互主义范式”这一概念,并将其应用于LLM智能体的集体行为研究。这种范式强调了先验知识、嵌入价值观和社会环境的重要性,并认为它们之间存在复杂的相互作用。这与传统的、更侧重于个体智能体属性的研究方法形成了鲜明对比。

关键设计:由于论文主要关注理论和方法论,因此没有涉及具体的参数设置、损失函数或网络结构等技术细节。然而,论文强调需要开发新的方法来分析和模拟LLM智能体的行为,这可能涉及到设计新的评估指标、开发新的仿真平台或构建新的计算模型。

🖼️ 关键图片

📊 实验亮点

论文的核心贡献在于提出了交互主义范式,为理解和研究LLM驱动的群体行为提供了一个新的视角。虽然没有提供具体的实验数据,但该范式为未来的研究方向提供了指导,强调了社会环境和预训练知识在塑造LLM智能体行为中的重要作用。

🎯 应用场景

该研究成果可应用于社交机器人设计、在线社区管理、舆情分析与引导等领域。通过理解LLM智能体的集体行为模式,可以更好地设计人机协作系统,预测社会舆论走向,并有效应对潜在的社会风险。

📄 摘要(原文)

In this article, we argue that understanding the collective behavior of agents based on large language models (LLMs) is an essential area of inquiry, with important implications in terms of risks and benefits, impacting us as a society at many levels. We claim that the distinctive nature of LLMs--namely, their initialization with extensive pre-trained knowledge and implicit social priors, together with their capability of adaptation through in-context learning--motivates the need for an interactionist paradigm consisting of alternative theoretical foundations, methodologies, and analytical tools, in order to systematically examine how prior knowledge and embedded values interact with social context to shape emergent phenomena in multi-agent generative AI systems. We propose and discuss four directions that we consider crucial for the development and deployment of LLM-based collectives, focusing on theory, methods, and trans-disciplinary dialogue.