Toward Ultra-Long-Horizon Agentic Science: Cognitive Accumulation for Machine Learning Engineering

作者: Xinyu Zhu, Yuzhu Cai, Zexi Liu, Bingyang Zheng, Cheng Wang, Rui Ye, Jiaao Chen, Hanrui Wang, Wei-Chen Wang, Yuzhi Zhang, Linfeng Zhang, Weinan E, Di Jin, Siheng Chen

分类: cs.AI

发布日期: 2026-01-15

备注: 26 pages. 5 figures

💡 一句话要点

提出分层认知缓存,ML-Master 2.0实现超长程机器学习工程自主

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 超长程自主性 机器学习工程 分层认知缓存 认知积累 自主智能体

📋 核心要点

- 现有LLM在长程推理中易被细节淹没,无法有效整合稀疏反馈,导致在超长程任务中表现不佳。

- 论文提出分层认知缓存(HCC)架构,模拟计算机系统,结构化区分经验,解耦执行与策略。

- ML-Master 2.0在MLE-Bench的24小时测试中,奖牌率达56.44%,验证了超长程自主性的潜力。

📝 摘要(中文)

人工智能向自主科学发展目前受限于超长程自主性的挑战,即在数天或数周的实验周期内维持战略一致性和迭代修正的能力。大型语言模型(LLM)在短程推理方面表现出色,但在现实研究的高维、延迟反馈环境中,它们容易被执行细节淹没,无法将稀疏反馈整合为连贯的长期指导。本文提出了ML-Master 2.0,一个掌握超长程机器学习工程(MLE)的自主智能体,MLE是科学发现的代表性缩影。通过将上下文管理重新定义为认知积累的过程,本文引入了分层认知缓存(HCC),这是一种受计算机系统启发的、多层架构,能够对经验进行结构化的时间区分。通过动态地将瞬时执行轨迹提炼为稳定的知识和跨任务智慧,HCC允许智能体将即时执行与长期实验策略分离,有效地克服了静态上下文窗口的扩展限制。在OpenAI的MLE-Bench上,24小时预算下的评估中,ML-Master 2.0实现了56.44%的最先进奖牌率。研究结果表明,超长程自主性为人工智能提供了一个可扩展的蓝图,使其能够自主探索超出人类先例的复杂性。

🔬 方法详解

问题定义:论文旨在解决机器学习工程(MLE)中的超长程自主性问题。现有方法,特别是依赖大型语言模型(LLM)的方法,在面对需要数天甚至数周才能完成的实验周期时,难以维持战略一致性和迭代修正。LLM虽然擅长短程推理,但在高维、延迟反馈的真实研究环境中,容易被大量的执行细节所淹没,无法有效地将稀疏的反馈信息整合为连贯的长期指导,从而限制了其在复杂科学发现任务中的应用。

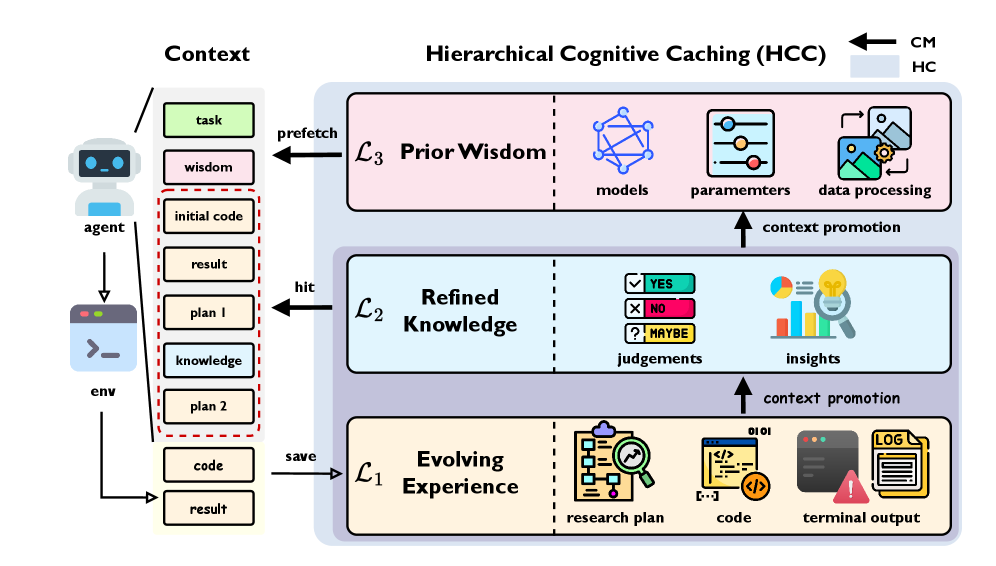

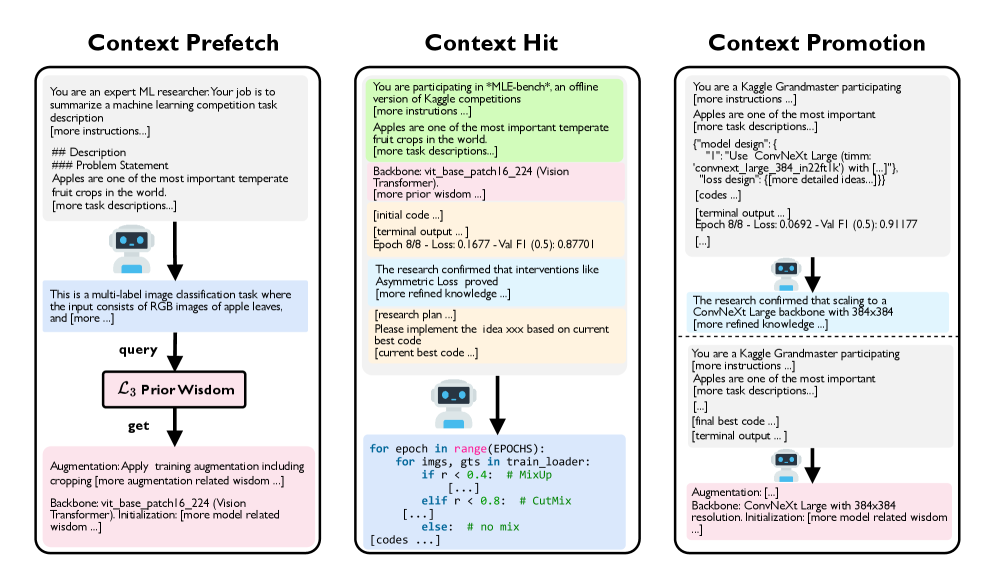

核心思路:论文的核心思路是将上下文管理重新定义为认知积累的过程。借鉴计算机系统的缓存机制,设计了一种分层认知缓存(Hierarchical Cognitive Caching, HCC)架构。通过分层存储和处理经验数据,HCC能够动态地将瞬时执行轨迹提炼为稳定的知识和跨任务智慧,从而使智能体能够将即时执行与长期实验策略解耦,克服了静态上下文窗口的限制。

技术框架:ML-Master 2.0的整体架构基于分层认知缓存(HCC)。HCC包含多个层级,用于存储不同时间尺度和抽象程度的经验数据。底层缓存存储详细的执行轨迹,中间层缓存存储提炼后的知识,顶层缓存存储跨任务的智慧。智能体在执行任务时,首先从顶层缓存获取指导,然后根据中间层缓存的知识进行调整,最后通过底层缓存记录执行细节。在实验结束后,智能体会将底层缓存中的数据进行提炼,更新中间层和顶层缓存。

关键创新:论文最重要的技术创新点是分层认知缓存(HCC)架构。HCC通过模拟计算机系统的缓存机制,实现了对经验数据的结构化存储和处理,从而使智能体能够有效地管理超长程任务中的大量信息。与现有方法相比,HCC能够动态地将瞬时执行轨迹提炼为稳定的知识和跨任务智慧,从而使智能体能够将即时执行与长期实验策略解耦,克服了静态上下文窗口的限制。

关键设计:HCC的关键设计包括缓存层级的划分、数据提炼算法和缓存更新策略。缓存层级的划分需要根据任务的特点进行调整。数据提炼算法需要能够有效地将瞬时执行轨迹提炼为稳定的知识。缓存更新策略需要能够保证缓存中的数据始终是最新的和最有用的。具体的参数设置、损失函数、网络结构等技术细节在论文中没有详细描述,可能需要参考相关的计算机系统和机器学习文献。

🖼️ 关键图片

📊 实验亮点

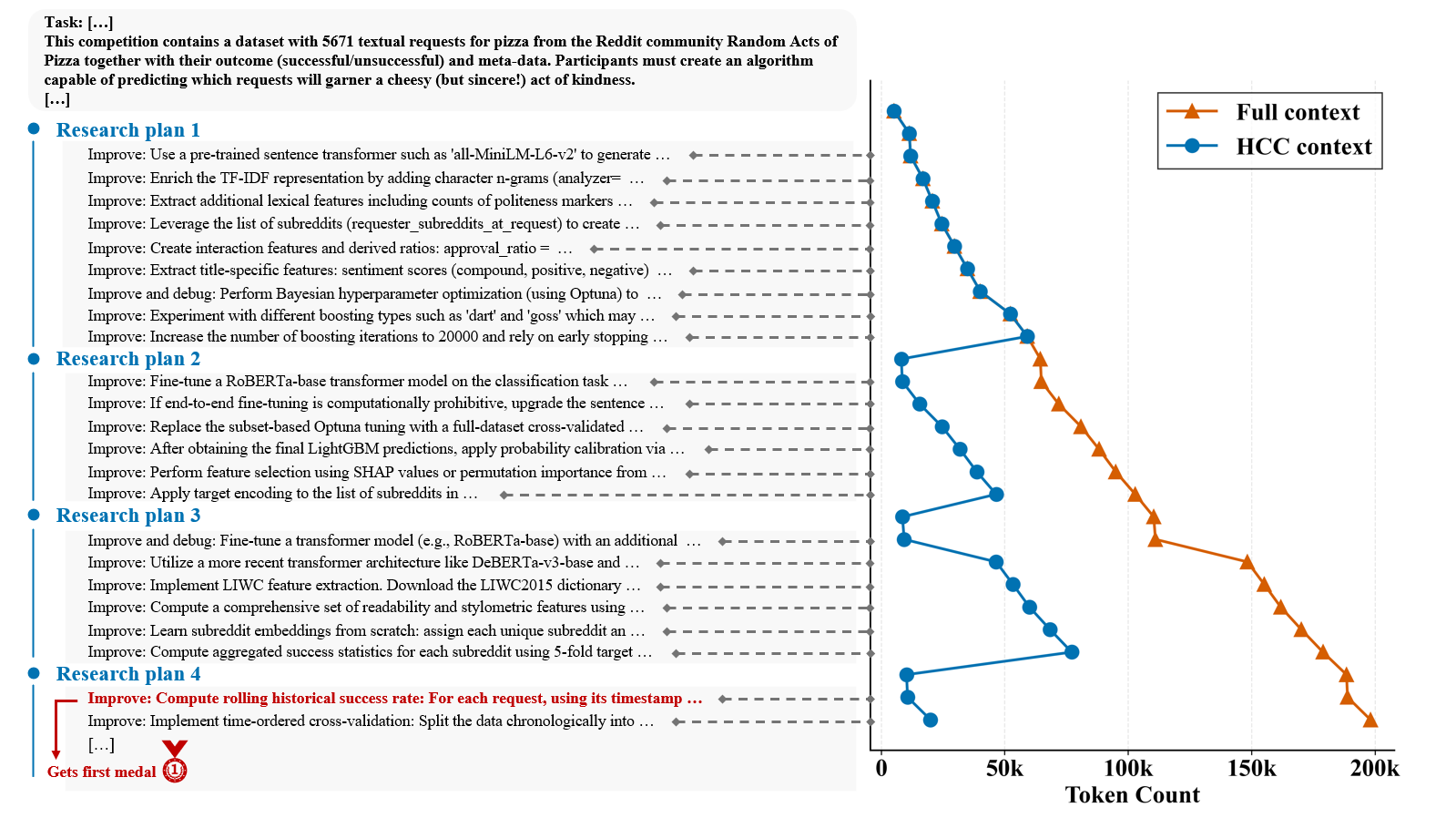

ML-Master 2.0在OpenAI的MLE-Bench上进行了24小时预算的评估,实现了56.44%的最先进奖牌率。这一结果显著优于现有方法,证明了分层认知缓存(HCC)在超长程机器学习工程中的有效性,为实现更高级别的自主科学奠定了基础。

🎯 应用场景

该研究成果可应用于各种需要超长程自主性的科学发现任务,例如新材料设计、药物研发、自动化机器学习等。通过提升AI在复杂、高维、延迟反馈环境下的决策能力,有望加速科学研究进程,实现超越人类能力的自主探索。

📄 摘要(原文)

The advancement of artificial intelligence toward agentic science is currently bottlenecked by the challenge of ultra-long-horizon autonomy, the ability to sustain strategic coherence and iterative correction over experimental cycles spanning days or weeks. While Large Language Models (LLMs) have demonstrated prowess in short-horizon reasoning, they are easily overwhelmed by execution details in the high-dimensional, delayed-feedback environments of real-world research, failing to consolidate sparse feedback into coherent long-term guidance. Here, we present ML-Master 2.0, an autonomous agent that masters ultra-long-horizon machine learning engineering (MLE) which is a representative microcosm of scientific discovery. By reframing context management as a process of cognitive accumulation, our approach introduces Hierarchical Cognitive Caching (HCC), a multi-tiered architecture inspired by computer systems that enables the structural differentiation of experience over time. By dynamically distilling transient execution traces into stable knowledge and cross-task wisdom, HCC allows agents to decouple immediate execution from long-term experimental strategy, effectively overcoming the scaling limits of static context windows. In evaluations on OpenAI's MLE-Bench under 24-hour budgets, ML-Master 2.0 achieves a state-of-the-art medal rate of 56.44%. Our findings demonstrate that ultra-long-horizon autonomy provides a scalable blueprint for AI capable of autonomous exploration beyond human-precedent complexities.