MATRIX AS PLAN: Structured Logical Reasoning with Feedback-Driven Replanning

作者: Ke Chen, Jiandian Zeng, Zihao Peng, Guo Li, Guangxue Zhang, Tian Wang

分类: cs.AI, cs.CL

发布日期: 2026-01-15

备注: 12 pages, 5 figures, 2 tables. Accepted at The Web Conference (WWW) 2026

💡 一句话要点

提出MatrixCoT以解决LLM逻辑推理能力不足问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 逻辑推理 大型语言模型 结构化推理 神经符号方法 矩阵计划 反馈机制 可解释性 鲁棒性

📋 核心要点

- 现有的LLMs在逻辑推理任务中表现不足,尤其是在符号表达和严格演绎规则的应用上。

- 本文提出MatrixCoT,通过结构化的矩阵计划方法,增强LLMs的逻辑推理能力,确保执行的稳定性和可验证性。

- 在五个逻辑推理基准和五个LLMs上的实验结果显示,MatrixCoT在不依赖外部求解器的情况下,提升了鲁棒性和可解释性。

📝 摘要(中文)

随着网络知识和语义的日益复杂,提升大型语言模型(LLMs)的理解和推理能力显得尤为重要。链式思维(CoT)提示已被证明能增强LLMs的推理能力,但在依赖符号表达和严格演绎规则的逻辑推理任务中仍显不足。神经符号方法通过外部求解器强制执行形式正确性,但这些求解器对格式高度敏感,模型输出的小波动可能导致频繁的处理失败。为此,本文提出了MatrixCoT,一个基于矩阵的结构化CoT框架,旨在增强LLMs的逻辑推理能力。实验表明,MatrixCoT在处理复杂符号推理任务时,增强了鲁棒性和可解释性,同时保持了竞争力的性能。

🔬 方法详解

问题定义:本文旨在解决大型语言模型在逻辑推理任务中表现不足的问题,尤其是对符号表达和演绎规则的处理能力不足。现有方法如链式思维提示在复杂推理任务中存在局限性,且神经符号方法对格式敏感,导致处理失败。

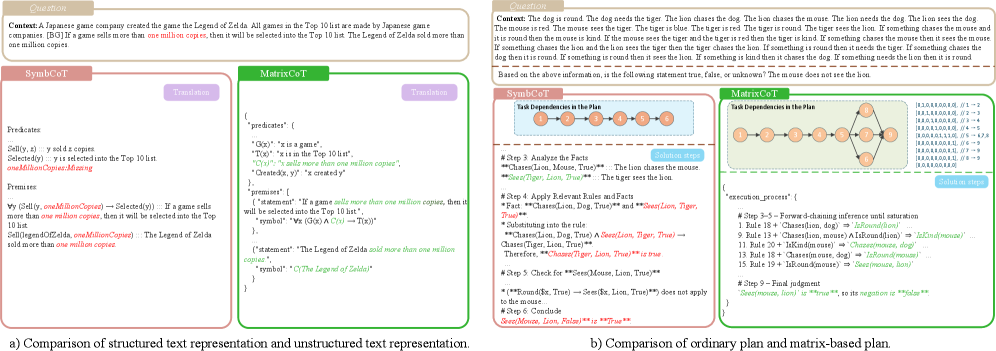

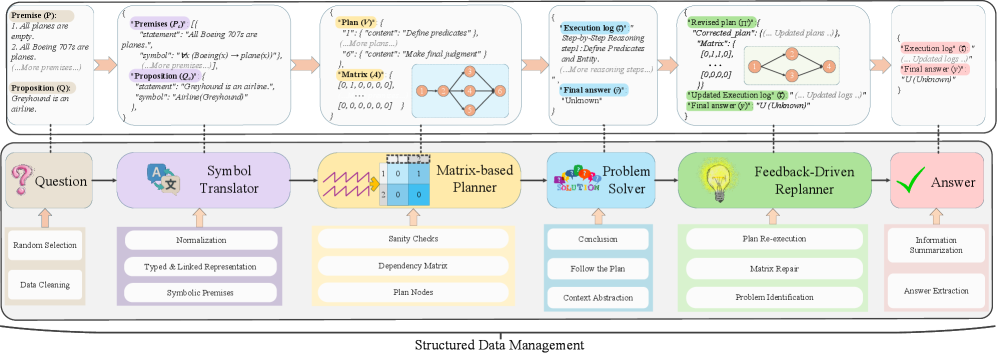

核心思路:MatrixCoT框架通过结构化的矩阵计划方法,规范化和类型化自然语言表达,附加明确的引用字段,从而增强LLMs的逻辑推理能力。该设计旨在保持步骤之间的全局关系,使计划成为可验证的工件。

技术框架:MatrixCoT的整体架构包括自然语言表达的规范化、引用字段的附加、矩阵计划的引入以及反馈驱动的重规划机制。该框架通过这些模块实现了更稳定的执行和更高的可解释性。

关键创新:最重要的创新点在于引入了矩阵计划方法和反馈驱动的重规划机制,使得逻辑推理过程不仅可验证,还能自动识别遗漏和缺陷,从而提升最终答案的可信度。

关键设计:在设计中,模型通过规范化自然语言表达和引入依赖矩阵来增强结构化表示,反馈机制则通过语义等价约束来优化和压缩依赖矩阵,确保最终输出的准确性和可靠性。

🖼️ 关键图片

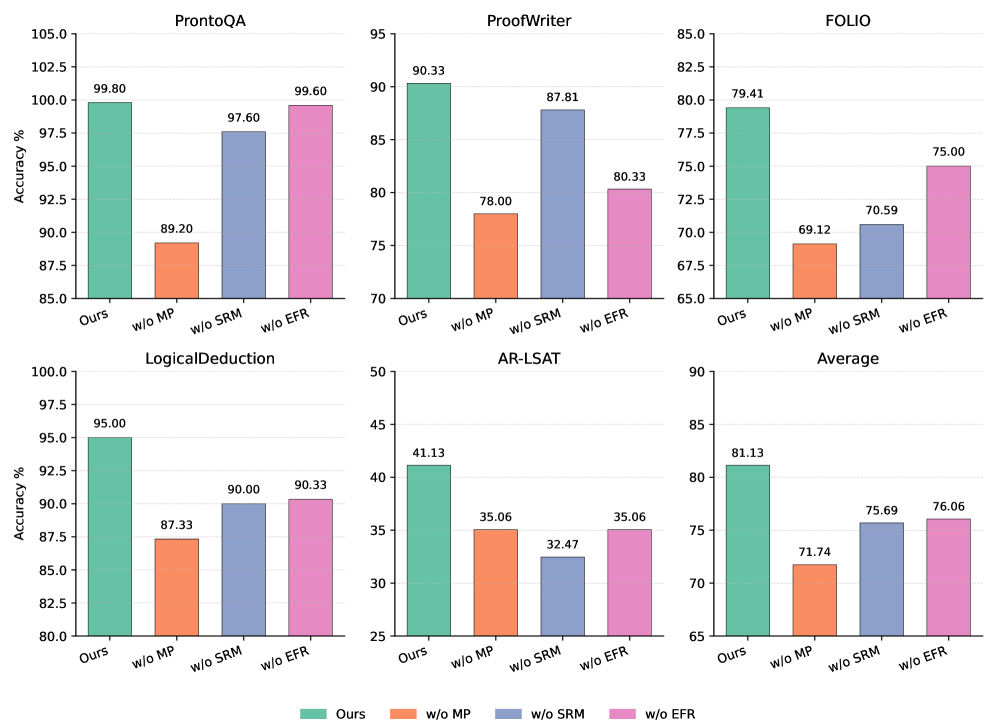

📊 实验亮点

实验结果表明,MatrixCoT在五个逻辑推理基准上表现优异,相较于基线方法,鲁棒性和可解释性显著提升,且在处理复杂符号推理任务时保持了竞争力的性能,具体提升幅度未知。

🎯 应用场景

该研究的潜在应用领域包括智能问答系统、自动推理和决策支持系统等。通过提升LLMs在逻辑推理任务中的表现,MatrixCoT可以为复杂问题的解决提供更可靠的支持,未来可能在教育、法律和科学研究等领域产生深远影响。

📄 摘要(原文)

As knowledge and semantics on the web grow increasingly complex, enhancing Large Language Models (LLMs) comprehension and reasoning capabilities has become particularly important. Chain-of-Thought (CoT) prompting has been shown to enhance the reasoning capabilities of LLMs. However, it still falls short on logical reasoning tasks that rely on symbolic expressions and strict deductive rules. Neuro-symbolic methods address this gap by enforcing formal correctness through external solvers. Yet these solvers are highly format-sensitive, and small instabilities in model outputs can lead to frequent processing failures. LLM-driven approaches avoid parsing brittleness, but they lack structured representations and process-level error-correction mechanisms. To further enhance the logical reasoning capabilities of LLMs, we propose MatrixCoT, a structured CoT framework with a matrix-based plan. Specifically, we normalize and type natural language expressions, attach explicit citation fields, and introduce a matrix-based planning method to preserve global relations among steps. The plan becomes a verifiable artifact, making execution more stable. For verification, we also add a feedback-driven replanning mechanism. Under semantic-equivalence constraints, it identifies omissions and defects, rewrites and compresses the dependency matrix, and produces a more trustworthy final answer. Experiments on five logical-reasoning benchmarks and five LLMs show that, without relying on external solvers, MatrixCoT enhances both robustness and interpretability when tackling complex symbolic reasoning tasks, while maintaining competitive performance.