Performance of AI agents based on reasoning language models on ALD process optimization tasks

作者: Angel Yanguas-Gil

分类: cond-mat.mtrl-sci, cs.AI, cs.LG

发布日期: 2026-01-15

💡 一句话要点

基于推理语言模型的AI智能体用于原子层沉积(ALD)工艺优化

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 原子层沉积 工艺优化 大型语言模型 人工智能 自主学习

📋 核心要点

- ALD工艺优化面临无先验知识下寻找最佳剂量时间的挑战,传统方法难以应对。

- 利用推理LLM构建智能体,通过迭代交互和推理,自主优化ALD工艺参数。

- 实验表明,基于推理模型的智能体能成功完成优化任务,但存在运行间变异性。

📝 摘要(中文)

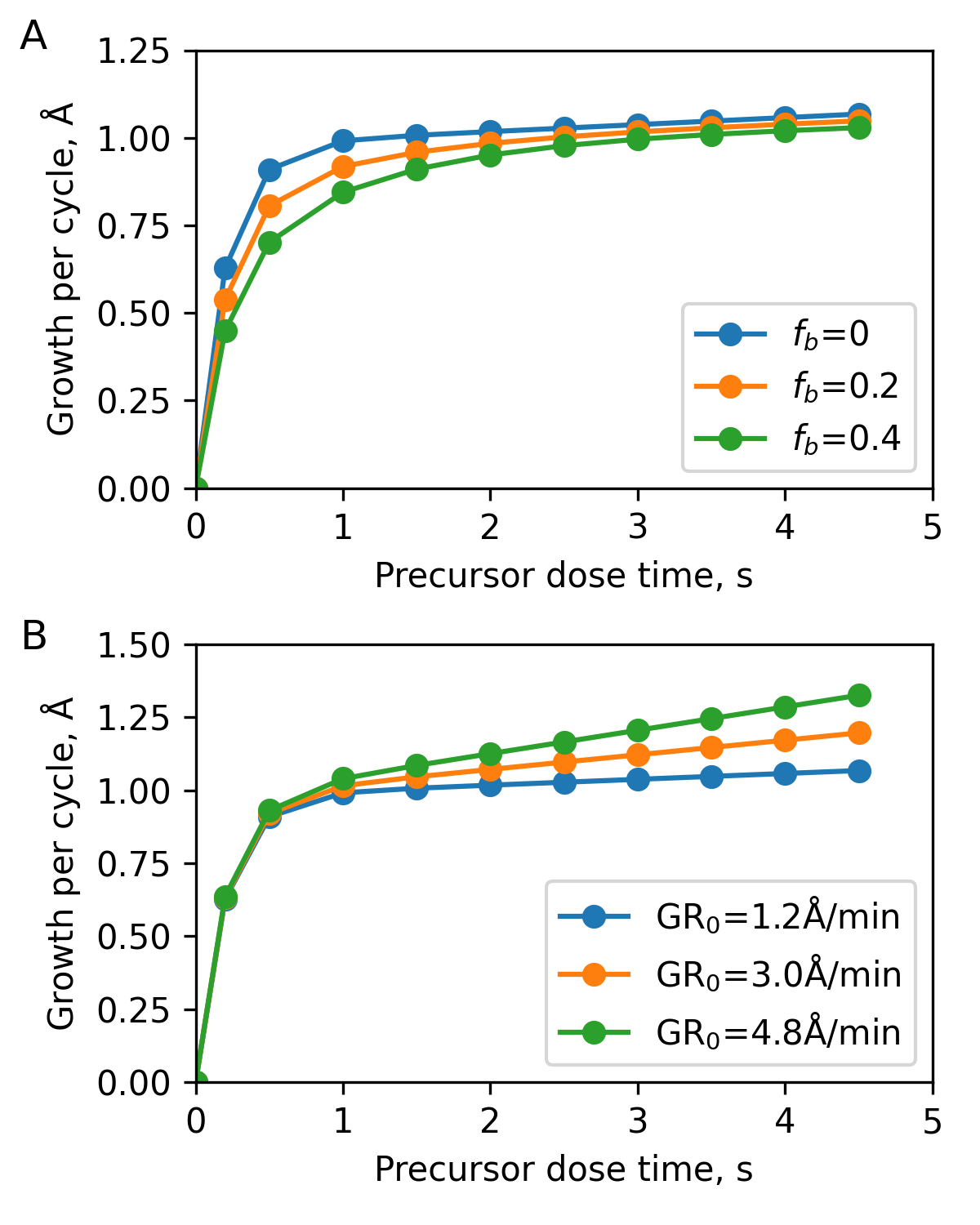

本文探讨了基于推理的大型语言模型在自主优化原子层沉积(ALD)工艺中的性能和行为。在ALD工艺优化任务中,构建于推理LLM之上的智能体需要在没有任何关于工艺的先验知识(包括它是否是自限制的)的情况下,找到ALD前驱体和共反应物的最佳剂量时间。该智能体旨在以完全无监督的方式与ALD反应器迭代交互。我们使用一个简单的ALD工具模型评估了这个智能体,该模型结合了具有不同自限制表面反应路径以及非自限制组分的ALD工艺。结果表明,基于OpenAI的o3和GPT5等推理模型的智能体始终成功完成了这项优化任务。然而,由于模型响应的非确定性,我们观察到显著的运行间变异性。为了理解推理模型所遵循的逻辑,该智能体使用了一个两步过程,模型首先生成一个详细描述推理过程的开放式响应,然后将该响应转换为结构化输出。对这些推理轨迹的分析表明,模型的逻辑是合理的,并且其推理是基于ALD中预期的自限制过程和饱和的概念。然而,智能体有时会被其在探索优化空间时的先前选择所误导。

🔬 方法详解

问题定义:原子层沉积(ALD)工艺优化旨在找到最佳的前驱体和共反应物剂量时间,以实现高质量薄膜的生长。传统的优化方法通常需要大量的实验或依赖于工艺的先验知识。然而,在许多实际情况下,关于ALD工艺的详细信息是未知的,例如反应是否是自限制的。因此,需要一种能够自主学习和优化ALD工艺的智能方法。现有方法的痛点在于需要人工干预和大量的实验数据,并且难以处理非自限制的ALD工艺。

核心思路:本文的核心思路是利用大型语言模型(LLM)的推理能力,构建一个能够自主与ALD反应器交互并优化工艺参数的智能体。该智能体通过观察实验结果,推理出最佳的剂量时间,并不断迭代优化。这种方法不需要任何关于ALD工艺的先验知识,并且可以处理各种类型的ALD工艺,包括自限制和非自限制的工艺。

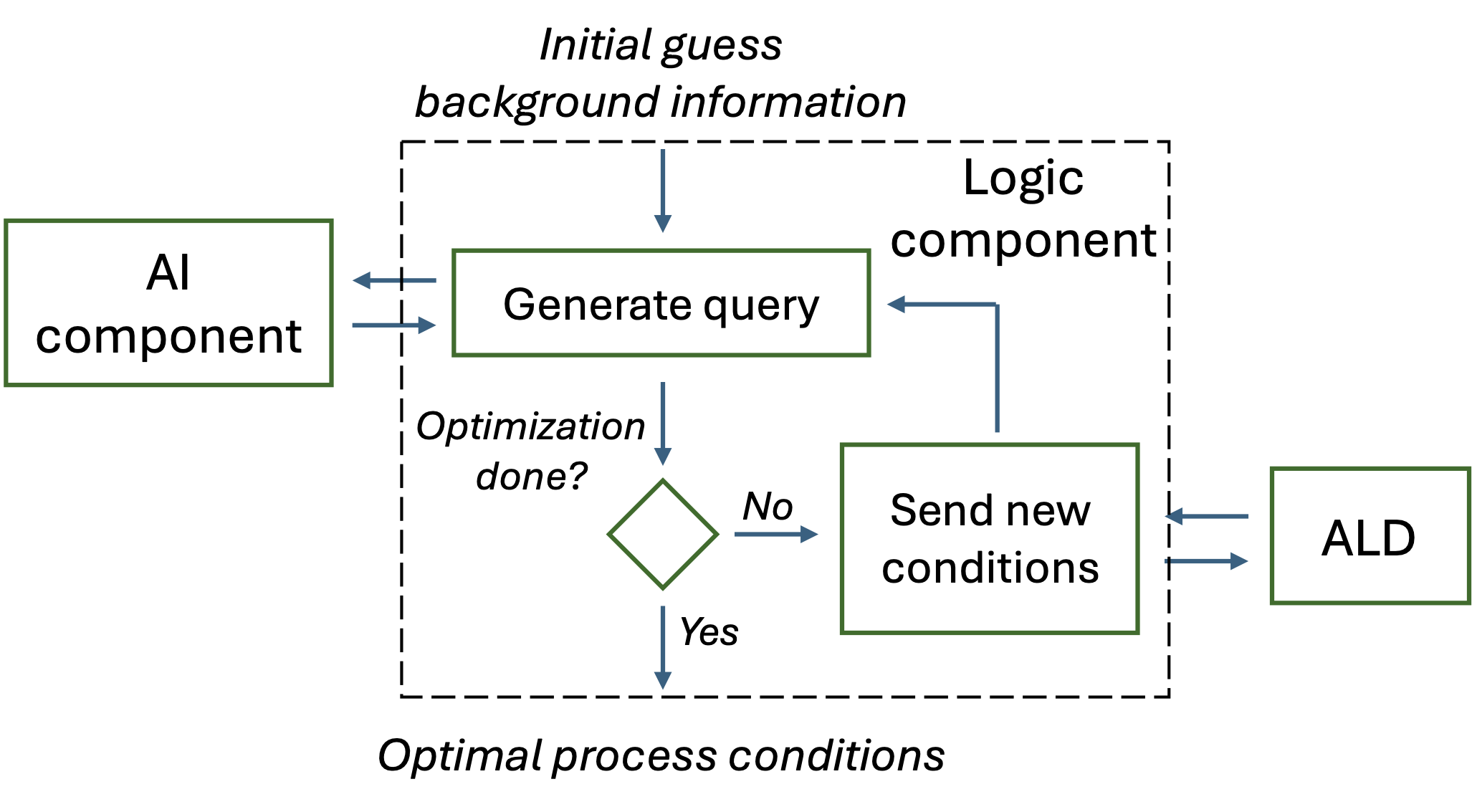

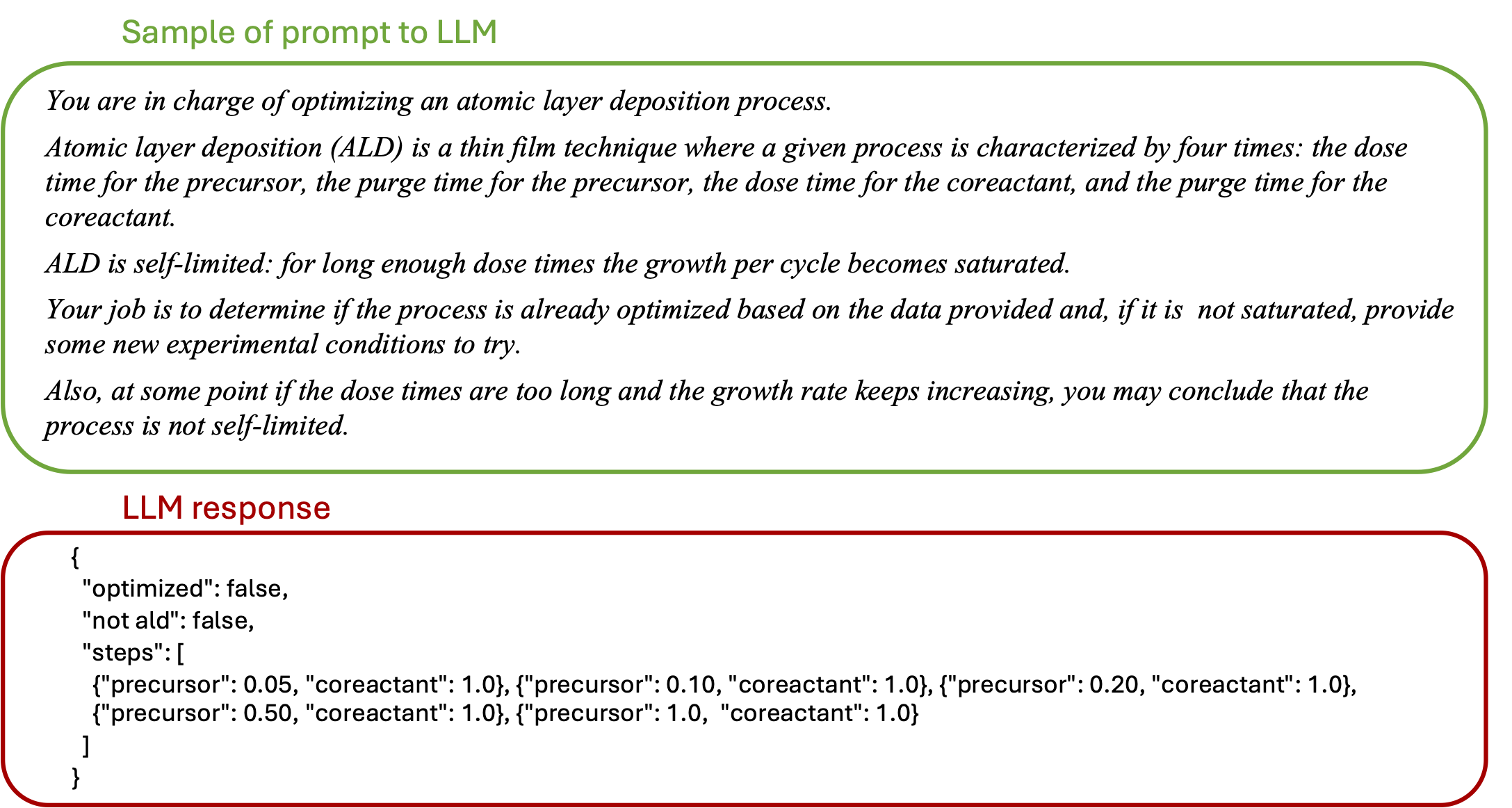

技术框架:该智能体的整体架构包括以下几个主要模块:1) LLM推理模块:负责根据实验结果生成推理过程和下一步的实验方案。2) ALD反应器模型:用于模拟真实的ALD工艺,并返回实验结果。3) 结构化输出模块:将LLM的开放式响应转换为结构化的数据,方便后续分析。整个流程是一个迭代的过程,智能体首先向ALD反应器模型发送实验方案,然后接收实验结果,接着LLM推理模块根据实验结果生成新的实验方案,直到找到最佳的工艺参数。

关键创新:本文最重要的技术创新点在于将大型语言模型的推理能力应用于ALD工艺优化。与传统的优化方法相比,该方法不需要任何关于ALD工艺的先验知识,并且可以自主学习和优化。此外,该方法还能够生成可解释的推理过程,帮助研究人员理解优化过程的逻辑。

关键设计:该智能体使用了OpenAI的o3和GPT5等大型语言模型作为推理引擎。为了理解模型的推理逻辑,该智能体采用了一个两步过程:首先,模型生成一个开放式响应,详细描述推理过程;然后,将该响应转换为结构化的输出。此外,为了提高优化效率,该智能体还采用了探索-利用策略,在探索新的工艺参数和利用已知的最佳参数之间进行平衡。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于OpenAI的o3和GPT5等推理模型的智能体能够成功完成ALD工艺优化任务。尽管由于模型响应的非确定性,存在运行间变异性,但智能体能够基于自限制过程和饱和的概念进行合理的推理。对推理轨迹的分析表明,模型的逻辑是合理的,验证了该方法的可行性。

🎯 应用场景

该研究成果可应用于各种薄膜材料的原子层沉积工艺优化,尤其适用于缺乏先验知识的新材料或复杂工艺。通过AI自主优化,可以加速新材料的研发进程,降低实验成本,并提高薄膜质量,在半导体、光伏、催化等领域具有广泛的应用前景。

📄 摘要(原文)

In this work we explore the performance and behavior of reasoning large language models to autonomously optimize atomic layer deposition (ALD) processes. In the ALD process optimization task, an agent built on top of a reasoning LLM has to find optimal dose times for an ALD precursor and a coreactant without any prior knowledge on the process, including whether it is actually self-limited. The agent is meant to interact iteratively with an ALD reactor in a fully unsupervised way. We evaluate this agent using a simple model of an ALD tool that incorporates ALD processes with different self-limited surface reaction pathways as well as a non self-limited component. Our results show that agents based on reasoning models like OpenAI's o3 and GPT5 consistently succeeded at completing this optimization task. However, we observed significant run-to-run variability due to the non deterministic nature of the model's response. In order to understand the logic followed by the reasoning model, the agent uses a two step process in which the model first generates an open response detailing the reasoning process. This response is then transformed into a structured output. An analysis of these reasoning traces showed that the logic of the model was sound and that its reasoning was based on the notions of self-limited process and saturation expected in the case of ALD. However, the agent can sometimes be misled by its own prior choices when exploring the optimization space.