On-Device Large Language Models for Sequential Recommendation

作者: Xin Xia, Hongzhi Yin, Shane Culpepper

分类: cs.IR, cs.AI

发布日期: 2026-01-14

备注: WSDM'26

💡 一句话要点

提出OD-LLM,用于序列推荐任务中大语言模型在端侧的高效部署。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 端侧部署 大语言模型 序列推荐 模型压缩 奇异值分解

📋 核心要点

- 现有大语言模型(LLM)在序列推荐任务中表现出色,但其庞大的内存占用和计算开销使其难以在资源受限的设备上部署。

- OD-LLM通过低秩结构压缩(SVD)和tokenization归一化技术,有效减少模型参数冗余,实现LLM在端侧的高效部署。

- 实验表明,在模型大小减半的情况下,OD-LLM的推荐效果与原始模型相当,验证了其有效性和可扩展性。

📝 摘要(中文)

本文提出OD-LLM,这是一个任务自适应压缩框架,专门为序列推荐任务中大语言模型在端侧的高效准确部署而设计。OD-LLM独特地集成了两种互补的压缩策略:一种是低秩结构压缩算法,它使用奇异值分解(SVD)来显著减少模型中的参数冗余;另一种是新颖的tokenization归一化技术,更好地补充了所使用的低秩分解过程。此外,为了最大限度地减少使用较高压缩比时可能出现的性能下降,使用了一种新颖的渐进对齐算法来迭代地细化目标模型中逐层所需的参数。在序列推荐基准上进行的实证评估表明,当部署的模型大小减半时,与原始推荐模型相比,OD-LLM在有效性方面没有损失。这些有希望的结果证明了OD-LLM的有效性和可扩展性,使得这种新颖的解决方案成为希望替代昂贵的远程执行LLM的实时端侧解决方案的实用替代方案。

🔬 方法详解

问题定义:论文旨在解决大语言模型(LLM)在序列推荐任务中,由于模型体积和计算复杂度过高,难以在资源受限的端侧设备上部署的问题。现有方法通常无法在模型大小和推荐性能之间取得良好的平衡,限制了LLM在端侧推荐系统中的应用。

核心思路:论文的核心思路是通过模型压缩,在尽可能保持推荐性能的前提下,显著减小LLM的模型体积,使其能够在端侧设备上高效运行。具体而言,论文结合了低秩分解和tokenization归一化两种压缩策略,并采用渐进对齐算法来优化压缩后的模型。

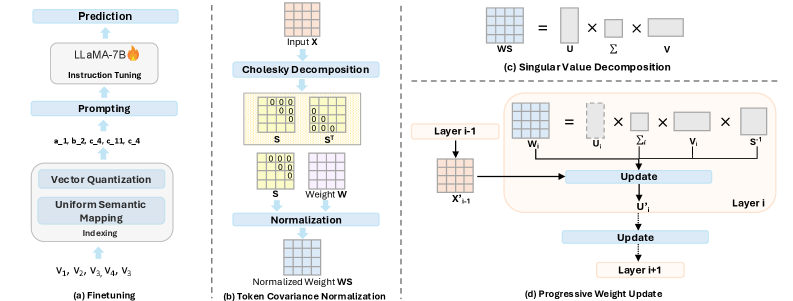

技术框架:OD-LLM框架主要包含三个阶段:1) 低秩结构压缩:使用奇异值分解(SVD)对LLM的权重矩阵进行分解,去除冗余参数;2) Tokenization归一化:对token embedding进行归一化处理,以更好地配合低秩分解过程,提升压缩效果;3) 渐进对齐:通过迭代的方式,逐层微调压缩后的模型参数,以恢复因压缩造成的性能损失。

关键创新:OD-LLM的关键创新在于其集成了低秩结构压缩和tokenization归一化两种互补的压缩策略,并提出了渐进对齐算法来优化压缩后的模型。这种联合优化方法能够更有效地减小模型体积,同时保持较高的推荐性能。此外,OD-LLM是第一个专门为序列推荐任务设计的端侧LLM压缩框架。

关键设计:在低秩分解中,需要确定SVD分解后的秩的大小,这会影响模型的压缩率和性能。Tokenization归一化的具体实现方式未知,但推测可能涉及到对token embedding进行L2归一化或其他类似的normalization操作。渐进对齐算法的具体迭代策略和损失函数未知,但推测可能采用知识蒸馏或对抗训练等方法来引导压缩模型的学习。

🖼️ 关键图片

📊 实验亮点

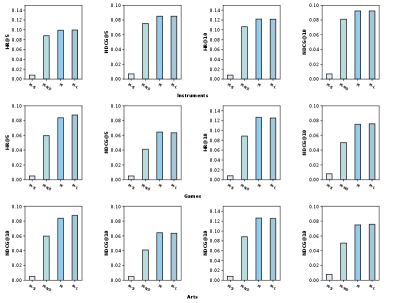

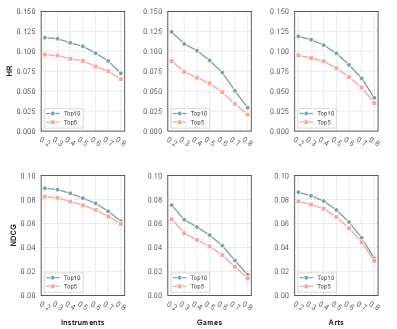

实验结果表明,在序列推荐基准数据集上,使用OD-LLM压缩后的模型大小减半时,其推荐效果与原始模型相当,没有明显的性能损失。这表明OD-LLM能够有效地减小模型体积,同时保持较高的推荐精度,为LLM在端侧部署提供了可行的解决方案。

🎯 应用场景

该研究成果可应用于各种需要端侧推荐的场景,例如移动应用、智能穿戴设备和离线推荐系统。通过在本地设备上部署LLM,可以提高推荐速度、保护用户隐私,并在网络连接不稳定或不可用时提供可靠的推荐服务。未来,该技术有望推动个性化推荐在更多场景下的普及。

📄 摘要(原文)

On-device recommendation is critical for a number of real-world applications, especially in scenarios that have agreements on execution latency, user privacy, and robust functionality when internet connectivity is unstable or even impossible. While large language models (LLMs) can now provide exceptional capabilities that model user behavior for sequential recommendation tasks, their substantial memory footprint and computational overhead make the deployment on resource-constrained devices a high risk proposition. In this paper, we propose OD-LLM, the first task-adaptive compression framework explicitly designed to provide efficient and accurate on-device deployment of LLMs for sequential recommendation tasks. OD-LLM uniquely integrates two complementary compression strategies: a low-rank structural compression algorithm which uses Singular Value Decomposition (SVD) to significantly reduce parameter redundancy in the model, and a novel tokenization normalization technique that better complements the low-rank decomposition process being used. Additionally, to minimize any potential performance degradation when using higher compression ratios, a novel progressive alignment algorithm is used to iteratively refine the parameters required layerwise in the target model. Empirical evaluations conducted on sequential recommendation benchmarks show that OD-LLM exhibits no loss in effectiveness when compared to the original recommendation model, when the deployed model size is halved. These promising results demonstrate the efficacy and scalability of OD-LLM, making this novel solution a practical alternative for real-time, on-device solutions wishing to replace expensive, remotely executed LLMs.