Learning from Demonstrations via Capability-Aware Goal Sampling

作者: Yuanlin Duan, Yuning Wang, Wenjie Qiu, He Zhu

分类: cs.AI

发布日期: 2026-01-13

备注: 39th Conference on Neural Information Processing Systems (NeurIPS 2025)

期刊: 39th Conference on Neural Information Processing Systems (NeurIPS 2025)

💡 一句话要点

提出能力感知目标采样(Cago),提升模仿学习在长程稀疏奖励任务中的性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 模仿学习 能力感知 目标采样 稀疏奖励 长程任务

📋 核心要点

- 长程任务中,模仿学习依赖完美专家轨迹,误差累积导致性能下降,是核心挑战。

- Cago通过动态跟踪智能体能力,自适应选择略超能力范围的目标,引导学习。

- 实验表明,Cago在稀疏奖励任务中,显著提升了样本效率和最终性能。

📝 摘要(中文)

模仿学习虽然前景广阔,但在长程环境中,由于完美复现演示轨迹不现实,且微小误差会灾难性累积,因此常常失败。我们提出了一种新的从演示中学习方法Cago(Capability-Aware Goal Sampling,能力感知目标采样),它减轻了对专家轨迹直接模仿的脆弱依赖。与仅依赖演示进行策略初始化或奖励塑造的先前方法不同,Cago动态跟踪智能体沿专家轨迹的能力,并使用此信号来选择中间步骤——即略微超出智能体当前能力范围的目标——来指导学习。这产生了一个自适应课程,能够稳步朝着解决完整任务的方向发展。实验结果表明,Cago显著提高了各种稀疏奖励、目标条件任务中的样本效率和最终性能,始终优于现有的从演示中学习的基线方法。

🔬 方法详解

问题定义:论文旨在解决长程、稀疏奖励环境下,模仿学习对专家轨迹过度依赖的问题。现有方法通常直接模仿专家轨迹,或利用专家轨迹进行奖励塑造,但这些方法对专家轨迹的质量要求很高,且容易受到误差累积的影响,导致智能体难以完成任务。尤其是在长程任务中,智能体稍有偏差,就可能导致后续轨迹偏离,最终无法达到目标。

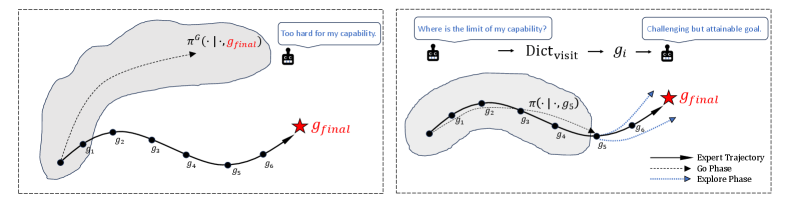

核心思路:Cago的核心思路是让智能体学习达到一系列由易到难的中间目标,而不是直接模仿完整的专家轨迹。这些中间目标的选择是基于智能体当前的能力水平,选择那些略微超出智能体能力范围的目标,从而形成一个自适应的课程学习过程。通过逐步完成这些中间目标,智能体可以逐渐提升自身能力,最终完成整个任务。

技术框架:Cago的整体框架包含以下几个主要模块:1) 能力评估模块:用于评估智能体当前的能力水平,例如,智能体能够到达哪些状态,或者能够完成哪些子任务。2) 目标采样模块:基于智能体的能力评估结果,选择那些略微超出智能体能力范围的中间目标。3) 策略学习模块:利用强化学习算法,学习如何达到这些中间目标。4) 课程更新模块:根据智能体的学习进度,动态调整中间目标的难度,形成一个自适应的课程学习过程。

关键创新:Cago的关键创新在于其能力感知的目标采样策略。与传统的模仿学习方法不同,Cago不是直接模仿专家轨迹,而是根据智能体自身的能力水平,选择合适的中间目标。这种方法可以有效地缓解对专家轨迹的依赖,并提高智能体的泛化能力。此外,Cago的自适应课程学习机制可以帮助智能体逐步提升自身能力,最终完成整个任务。

关键设计:Cago的关键设计包括:1) 能力评估指标的选择:论文中使用了智能体到达某个状态的概率作为能力评估指标。2) 目标采样策略的设计:论文中使用了基于智能体能力水平的概率分布来选择中间目标。3) 策略学习算法的选择:论文中使用了SAC(Soft Actor-Critic)算法来学习如何达到这些中间目标。4) 课程更新策略的设计:论文中使用了基于智能体学习进度的动态调整策略,例如,如果智能体能够轻松达到某个中间目标,则提高该目标的难度。

🖼️ 关键图片

📊 实验亮点

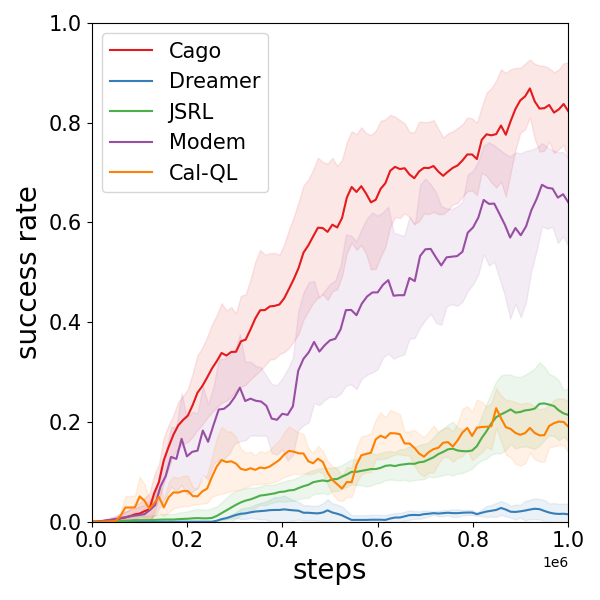

实验结果表明,Cago在多个稀疏奖励、目标条件任务中显著优于现有基线方法。例如,在某项任务中,Cago的成功率比最佳基线方法提高了20%以上,并且样本效率也得到了显著提升。这些结果表明,Cago的能力感知目标采样策略能够有效地引导智能体学习,并提高其在复杂环境中的性能。

🎯 应用场景

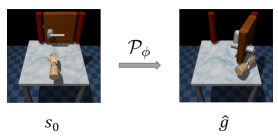

Cago方法具有广泛的应用前景,例如机器人操作、自动驾驶、游戏AI等领域。在机器人操作中,可以利用Cago方法训练机器人完成复杂的装配任务。在自动驾驶中,可以利用Cago方法训练自动驾驶系统在复杂的交通环境中安全行驶。在游戏AI中,可以利用Cago方法训练游戏AI完成各种游戏任务。该方法通过降低对专家数据的依赖,提升了智能体在复杂环境中的学习效率和泛化能力,具有重要的实际价值和未来影响。

📄 摘要(原文)

Despite its promise, imitation learning often fails in long-horizon environments where perfect replication of demonstrations is unrealistic and small errors can accumulate catastrophically. We introduce Cago (Capability-Aware Goal Sampling), a novel learning-from-demonstrations method that mitigates the brittle dependence on expert trajectories for direct imitation. Unlike prior methods that rely on demonstrations only for policy initialization or reward shaping, Cago dynamically tracks the agent's competence along expert trajectories and uses this signal to select intermediate steps--goals that are just beyond the agent's current reach--to guide learning. This results in an adaptive curriculum that enables steady progress toward solving the full task. Empirical results demonstrate that Cago significantly improves sample efficiency and final performance across a range of sparse-reward, goal-conditioned tasks, consistently outperforming existing learning from-demonstrations baselines.