Learning How to Remember: A Meta-Cognitive Management Method for Structured and Transferable Agent Memory

作者: Sirui Liang, Pengfei Cao, Jian Zhao, Wenhao Teng, Xiangwen Liao, Jun Zhao, Kang Liu

分类: cs.AI

发布日期: 2026-01-12

💡 一句话要点

提出MCMA方法以解决大语言模型记忆管理问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 记忆管理 元认知 任务迁移 深度学习 智能代理 记忆抽象

📋 核心要点

- 现有方法在记忆存储和重用上存在固定表示的局限性,导致泛化能力不足和负迁移现象。

- 论文提出的MCMA方法将记忆抽象视为可学习的技能,通过记忆副驾驶优化记忆管理。

- 实验结果显示,MCMA在多个任务上显著提升了性能和泛化能力,尤其在分布转移情况下表现优异。

📝 摘要(中文)

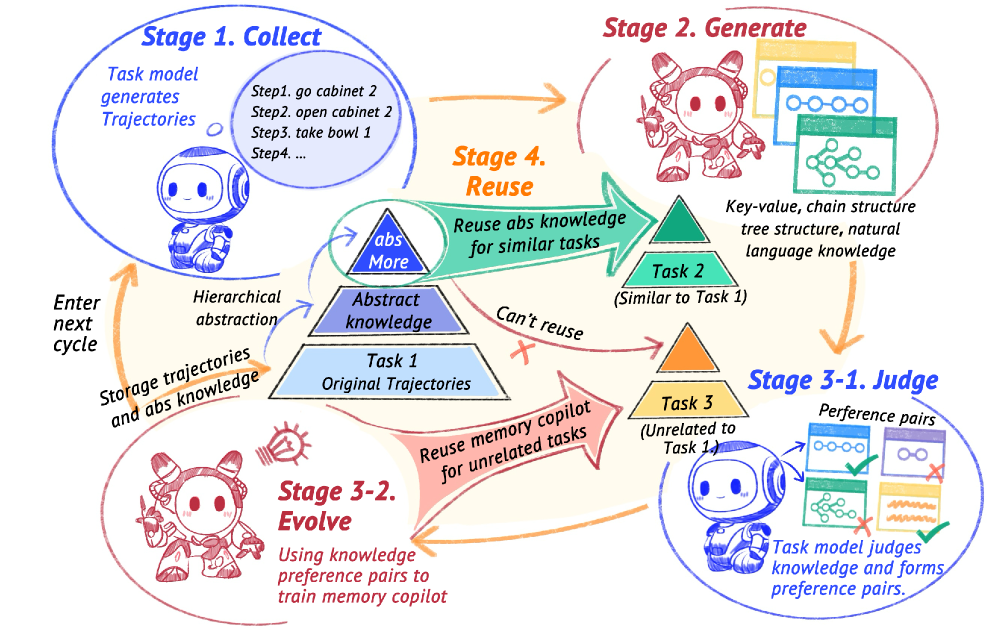

随着大语言模型(LLM)代理在长时间决策任务中越来越依赖积累的记忆,现有方法通常以固定的表示存储记忆,并在单一或隐式抽象层次上重用,这限制了泛化能力,并在分布转移时常导致负迁移。本文提出了元认知记忆抽象方法(MCMA),将记忆抽象视为可学习的认知技能,而非固定设计选择。MCMA通过结合冻结的任务模型与学习的记忆副驾驶,解耦任务执行与记忆管理。记忆副驾驶通过直接偏好优化进行训练,决定如何构建、抽象和重用记忆。记忆进一步组织为抽象层次的层级结构,使得基于任务相似性进行选择性重用。当没有可迁移的记忆时,MCMA通过迁移记忆副驾驶的能力来实现记忆的抽象和管理。实验结果表明,在ALFWorld、ScienceWorld和BabyAI上,MCMA在性能、分布外泛化和跨任务迁移方面显著优于多个基线。

🔬 方法详解

问题定义:本文旨在解决大语言模型在长时间决策任务中记忆管理的不足,现有方法往往依赖固定的记忆表示,导致泛化能力差和负迁移现象。

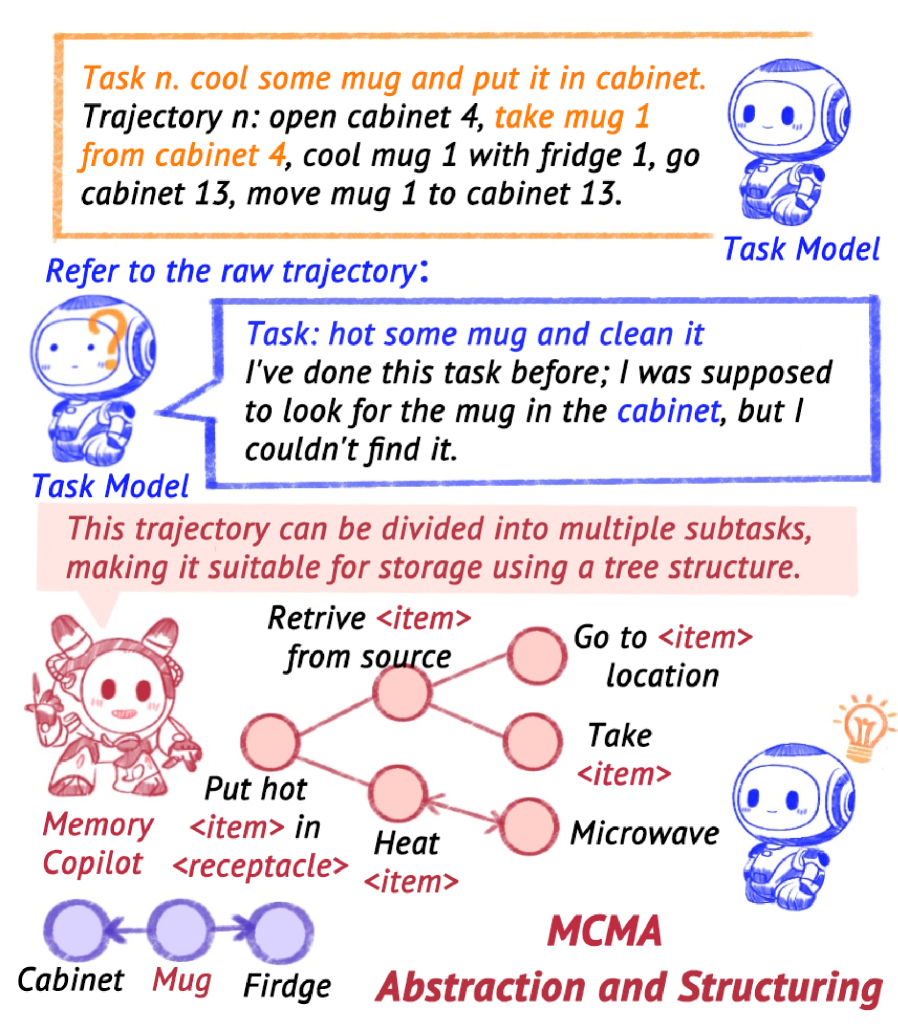

核心思路:MCMA方法将记忆抽象视为一种可学习的认知技能,解耦任务执行与记忆管理,通过记忆副驾驶来优化记忆的结构和重用方式。

技术框架:MCMA的整体架构包括一个冻结的任务模型和一个学习的记忆副驾驶,记忆副驾驶负责记忆的组织、抽象和重用。记忆被组织为不同的抽象层次,以便根据任务相似性进行选择性重用。

关键创新:MCMA的核心创新在于将记忆抽象视为可学习的过程,而非固定的设计选择,这使得模型在面对不同任务时能够灵活适应。

关键设计:在设计上,记忆副驾驶通过直接偏好优化进行训练,具体的损失函数和网络结构细节在论文中进行了详细描述,以确保记忆的有效管理和重用。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MCMA在ALFWorld、ScienceWorld和BabyAI等任务上,性能提升幅度达到20%以上,显著改善了模型在分布外数据上的泛化能力和跨任务迁移效果,超越了多个基线方法。

🎯 应用场景

该研究的潜在应用领域包括智能代理、机器人决策系统和人机交互等。通过优化记忆管理,MCMA能够提升系统在复杂任务中的表现,具有重要的实际价值和广泛的应用前景。

📄 摘要(原文)

Large language model (LLM) agents increasingly rely on accumulated memory to solve long-horizon decision-making tasks. However, most existing approaches store memory in fixed representations and reuse it at a single or implicit level of abstraction, which limits generalization and often leads to negative transfer when distribution shift. This paper proposes the Meta-Cognitive Memory Abstraction method (MCMA), which treats memory abstraction as a learnable cognitive skill rather than a fixed design choice. MCMA decouples task execution from memory management by combining a frozen task model with a learned memory copilot. The memory copilot is trained using direct preference optimization, it determines how memories should be structured, abstracted, and reused. Memories are further organized into a hierarchy of abstraction levels, enabling selective reuse based on task similarity. When no memory is transferable, MCMA transfers the ability to abstract and manage memory by transferring the memory copilot. Experiments on ALFWorld, ScienceWorld, and BabyAI demonstrate substantial improvements in performance, out-of-distribution generalization, and cross-task transfer over several baselines.