Beyond Dialogue Time: Temporal Semantic Memory for Personalized LLM Agents

作者: Miao Su, Yucan Guo, Zhongni Hou, Long Bai, Zixuan Li, Yufei Zhang, Guojun Yin, Wei Lin, Xiaolong Jin, Jiafeng Guo, Xueqi Cheng

分类: cs.AI

发布日期: 2026-01-12

💡 一句话要点

提出时间语义记忆(TSM)框架,解决LLM Agent中记忆的时间不准确和碎片化问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间语义记忆 LLM Agent 持续性记忆 语义时间线 长期记忆 个性化Agent 时间建模

📋 核心要点

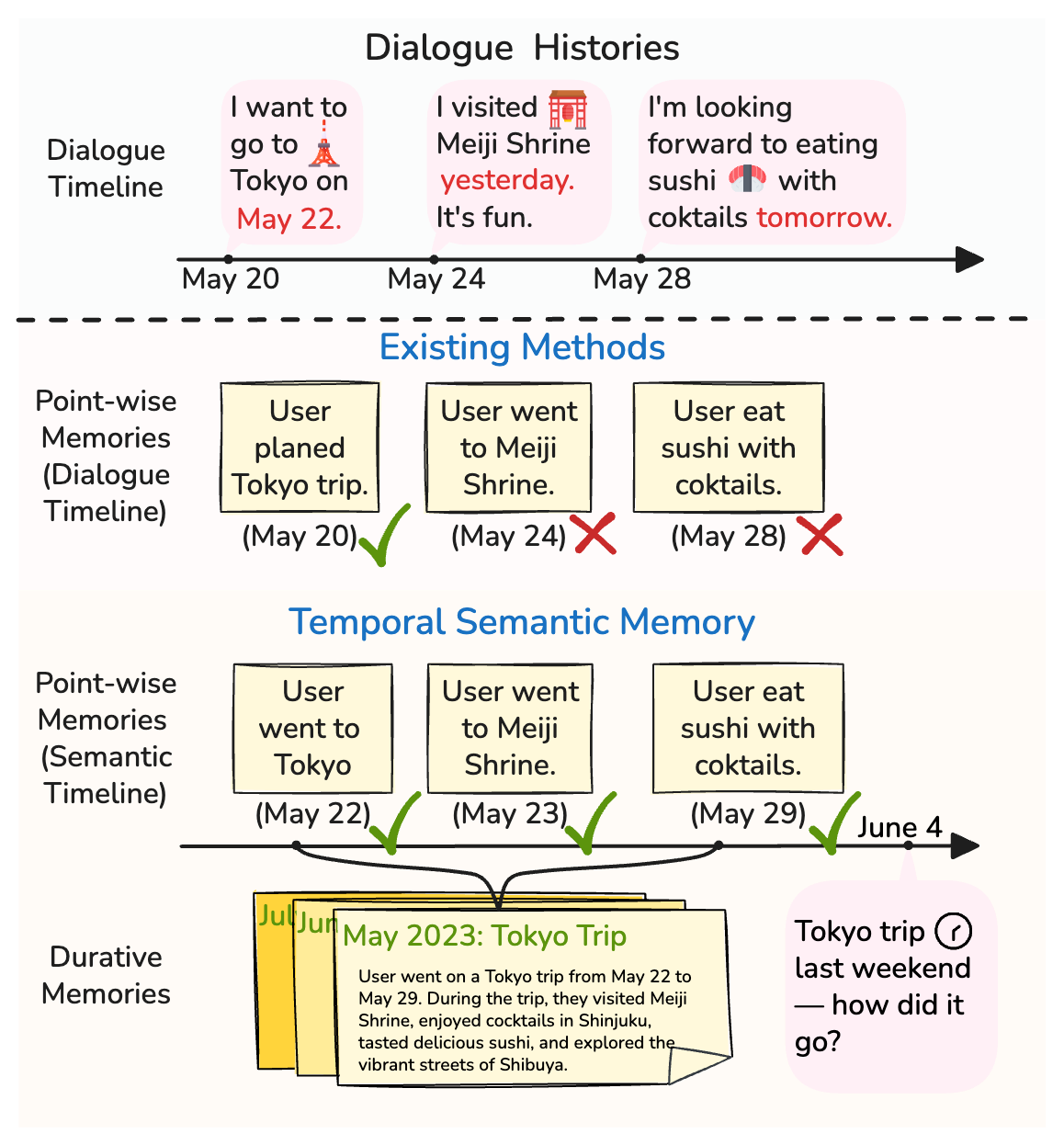

- 现有LLM Agent的记忆方法在时间建模上存在不足,主要表现为时间不准确(以对话时间为准)和时间碎片化(缺乏对持续性信息的建模)。

- 论文提出时间语义记忆(TSM)框架,核心思想是构建语义时间线,并将时间上连续且语义相关的信息整合为持续性记忆。

- 实验结果表明,TSM在LongMemEval和LoCoMo数据集上显著优于现有方法,准确率提升高达12.2%,验证了其有效性。

📝 摘要(中文)

本文提出了一种时间语义记忆(TSM)框架,旨在解决大型语言模型(LLM)Agent在记忆建模中存在的两个时间维度问题:一是时间不准确,现有方法以对话时间而非实际发生时间组织记忆;二是时间碎片化,现有方法侧重于点状记忆,忽略了持续性信息,无法捕捉持久状态和演变模式。TSM通过构建语义时间线而非对话时间线来建模语义时间,并支持构建和利用持续性记忆。在记忆利用阶段,TSM将查询的时间意图融入语义时间线,从而检索时间上合适的持续性记忆,并提供时间有效、持续一致的上下文来支持响应生成。在LongMemEval和LoCoMo上的实验表明,TSM始终优于现有方法,准确率绝对提升高达12.2%,证明了该方法的有效性。

🔬 方法详解

问题定义:现有LLM Agent的记忆模块主要存在两个问题:一是记忆的时间戳不准确,通常使用对话时间而非事件实际发生的时间;二是记忆是碎片化的,缺乏对持续性状态和演变趋势的建模,无法有效捕捉长期依赖关系。这些问题导致Agent在需要时间敏感信息的任务中表现不佳。

核心思路:论文的核心思路是引入语义时间的概念,构建一个基于事件语义而非对话顺序的时间线。通过将语义上相关且时间上连续的信息整合为“持续性记忆”,从而克服时间不准确和碎片化的问题。这种方法允许Agent根据查询的时间意图,检索到在语义时间线上最相关的持续性记忆。

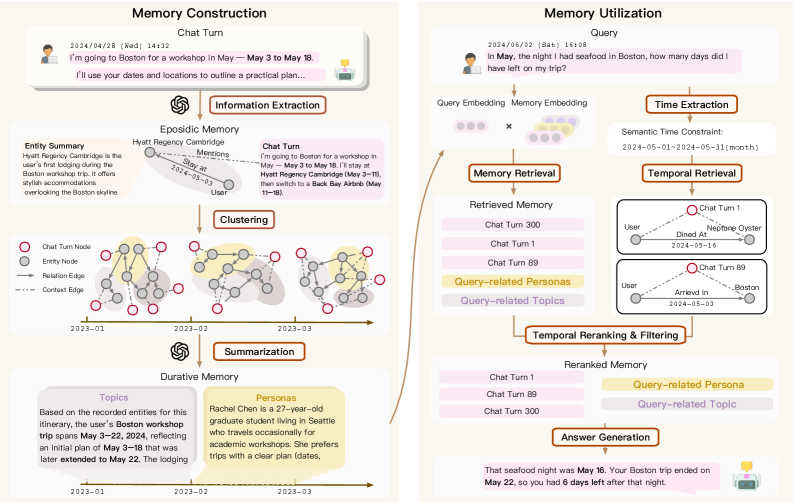

技术框架:TSM框架包含两个主要阶段:记忆构建和记忆利用。在记忆构建阶段,首先解析对话历史,提取事件及其发生时间,并构建语义时间线。然后,将时间上连续且语义相关的信息合并为持续性记忆。在记忆利用阶段,根据用户查询的时间意图,在语义时间线上检索相关的持续性记忆,并将这些记忆作为上下文提供给LLM进行响应生成。

关键创新:TSM的关键创新在于引入了语义时间线和持续性记忆的概念。与传统的基于对话时间的记忆方法不同,TSM能够更准确地捕捉事件的实际发生时间和持续状态。此外,持续性记忆的设计允许Agent利用更丰富的上下文信息,从而提高响应的准确性和一致性。

关键设计:TSM框架的关键设计包括:1) 语义时间线的构建方法,需要定义事件之间的时间关系和语义相似度;2) 持续性记忆的合并策略,需要平衡记忆的粒度和信息量;3) 记忆检索机制,需要根据查询的时间意图,在语义时间线上高效地找到相关的持续性记忆。具体的参数设置、损失函数和网络结构等技术细节在论文中可能有所涉及,但摘要中未明确说明。

🖼️ 关键图片

📊 实验亮点

实验结果表明,TSM在LongMemEval和LoCoMo两个数据集上均取得了显著的性能提升。在LongMemEval数据集上,TSM的准确率比现有最佳方法提高了12.2%。在LoCoMo数据集上,TSM也取得了显著的性能提升,证明了其在不同场景下的有效性和泛化能力。

🎯 应用场景

TSM框架可应用于需要长期记忆和时间敏感信息的LLM Agent,例如个性化推荐系统、智能客服、医疗诊断助手等。通过更准确地建模时间信息,Agent可以更好地理解用户需求,提供更个性化、更准确的服务。该研究有助于提升LLM Agent的智能化水平和实际应用价值。

📄 摘要(原文)

Memory enables Large Language Model (LLM) agents to perceive, store, and use information from past dialogues, which is essential for personalization. However, existing methods fail to properly model the temporal dimension of memory in two aspects: 1) Temporal inaccuracy: memories are organized by dialogue time rather than their actual occurrence time; 2) Temporal fragmentation: existing methods focus on point-wise memory, losing durative information that captures persistent states and evolving patterns. To address these limitations, we propose Temporal Semantic Memory (TSM), a memory framework that models semantic time for point-wise memory and supports the construction and utilization of durative memory. During memory construction, it first builds a semantic timeline rather than a dialogue one. Then, it consolidates temporally continuous and semantically related information into a durative memory. During memory utilization, it incorporates the query's temporal intent on the semantic timeline, enabling the retrieval of temporally appropriate durative memories and providing time-valid, duration-consistent context to support response generation. Experiments on LongMemEval and LoCoMo show that TSM consistently outperforms existing methods and achieves up to 12.2% absolute improvement in accuracy, demonstrating the effectiveness of the proposed method.