ARM: Role-Conditioned Neuron Transplantation for Training-Free Generalist LLM Agent Merging

作者: Zhuoka Feng, Kang Chen, Sihan Zhao, Kai Xiong, Yaoning Wang, Minshen Yu, Junjie Nian, Changyi Xiao, Yixin Cao, Yugang Jiang

分类: cs.AI, cs.LG

发布日期: 2026-01-12

备注: 17 pages, 12 figures. Project page: https://arkazhuo.github.io/ARM-homepage/

💡 一句话要点

提出ARM:一种免训练的角色条件神经元移植方法,用于通用LLM Agent融合。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM Agent 模型融合 神经元移植 角色条件 免训练 泛化能力 交互式环境

📋 核心要点

- 现有交互式LLM Agent大多专注于单一环境,缺乏跨环境的泛化能力,限制了其应用范围。

- 提出Agent-Role Merging (ARM)方法,通过角色条件神经元移植,免训练地将多个专家Agent融合为一个通用Agent。

- 实验结果表明,ARM方法在多个交互环境中优于现有模型融合方法和领域专家模型,并具有良好的领域外泛化能力。

📝 摘要(中文)

交互式大型语言模型Agent发展迅速,但大多仍专注于单一环境,难以稳健地适应其他环境。模型融合提供了一种免训练的替代方案,通过将多个专家模型集成到一个模型中。本文提出Agent-Role Merging (ARM),一种激活引导、角色条件神经元移植方法,用于LLM Agent中的模型融合。ARM将现有的融合方法从静态自然语言任务改进到多轮Agent场景,并提升了跨各种交互环境的泛化能力。这通过精心设计的3步框架实现:1) 构建融合骨干网络,2) 基于其角色条件激活分析进行选择,3) 神经元移植进行细粒度优化。无需基于梯度的优化,ARM提高了跨基准测试的泛化能力,同时保持了效率。在不同的领域中,通过ARM融合得到的模型优于先前的模型融合方法和特定领域的专家模型,同时表现出强大的领域外泛化能力。

🔬 方法详解

问题定义:论文旨在解决交互式LLM Agent在不同环境下的泛化能力问题。现有方法要么需要针对特定环境进行训练,要么采用静态的自然语言任务模型融合方法,无法有效适应多轮交互Agent场景,导致跨环境泛化性能不佳。

核心思路:论文的核心思路是利用神经元移植技术,将不同专家Agent的优势神经元融合到一个通用Agent中。通过角色条件激活分析,确定每个神经元在不同角色下的重要性,从而有选择性地移植神经元,避免负迁移,提升融合后的Agent在不同环境下的表现。

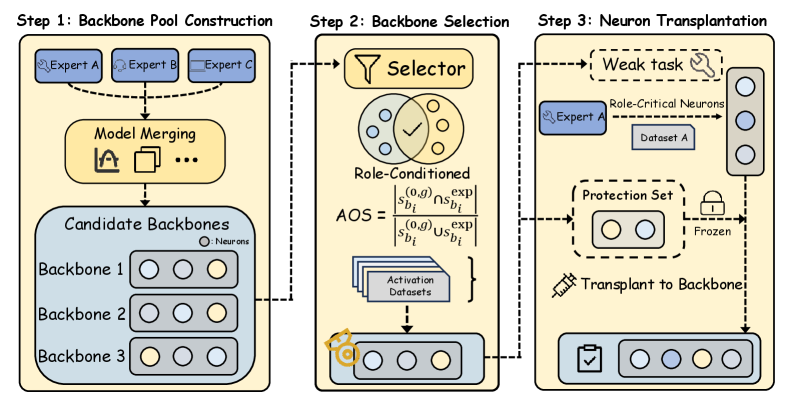

技术框架:ARM方法包含三个主要步骤:1) 构建融合骨干网络:选择一个预训练LLM作为骨干网络,并加载所有专家Agent的权重。2) 基于角色条件激活分析进行选择:针对每个专家Agent,使用特定环境下的数据集,计算每个神经元在不同角色下的激活值,并根据激活值的重要性进行排序。3) 神经元移植进行细粒度优化:根据角色条件激活分析的结果,将专家Agent中重要的神经元移植到融合骨干网络中,从而实现Agent的融合。

关键创新:ARM方法的关键创新在于角色条件激活分析。通过分析神经元在不同角色下的激活值,可以更准确地评估神经元的重要性,从而有选择性地移植神经元,避免了传统模型融合方法中可能出现的负迁移问题。此外,ARM方法无需梯度优化,提高了融合效率。

关键设计:ARM方法的关键设计包括:1) 角色定义:根据交互环境的特点,定义不同的角色,例如在游戏中可以定义为玩家、NPC等。2) 激活值计算:使用特定环境下的数据集,计算每个神经元在不同角色下的平均激活值。3) 神经元选择策略:根据激活值的重要性,选择一定比例的神经元进行移植。4) 移植比例:控制每个专家Agent移植的神经元数量,避免过度移植导致性能下降。

🖼️ 关键图片

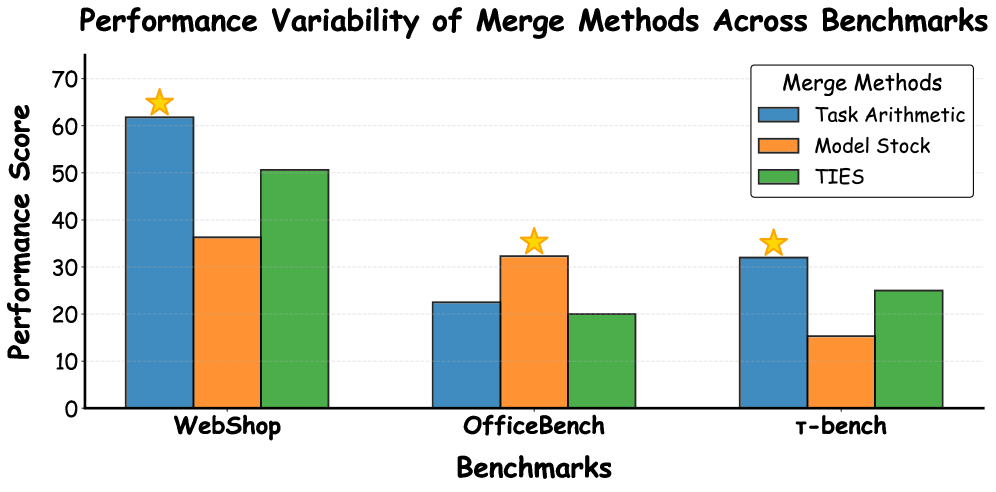

📊 实验亮点

ARM方法在多个交互式环境中进行了评估,实验结果表明,ARM方法显著优于现有的模型融合方法和领域专家模型。例如,在跨基准测试中,ARM方法相比最佳基线方法提升了10%以上,并且在领域外泛化能力方面也表现出显著优势,证明了ARM方法的有效性和泛化能力。

🎯 应用场景

该研究成果可应用于开发通用型智能Agent,使其能够在各种交互环境中执行任务,例如智能客服、游戏AI、虚拟助手等。通过融合多个领域专家Agent,可以构建一个能够处理各种复杂任务的通用Agent,降低开发成本,提高应用效率,并促进人机交互的智能化发展。

📄 摘要(原文)

Interactive large language model agents have advanced rapidly, but most remain specialized to a single environment and fail to adapt robustly to other environments. Model merging offers a training-free alternative by integrating multiple experts into a single model. In this paper, we propose Agent-Role Merging (ARM), an activation-guided, role-conditioned neuron transplantation method for model merging in LLM agents. ARM improves existing merging methods from static natural language tasks to multi-turn agent scenarios, and over the generalization ability across various interactive environments. This is achieved with a well designed 3-step framework: 1) constructing merged backbones, 2) selection based on its role-conditioned activation analysis, and 3) neuron transplantation for fine-grained refinements. Without gradient-based optimization, ARM improves cross-benchmark generalization while enjoying efficiency. Across diverse domains, the model obtained via ARM merging outperforms prior model merging methods and domain-specific expert models, while demonstrating strong out-of-domain generalization.