A Large-Scale Study on the Development and Issues of Multi-Agent AI Systems

作者: Daniel Liu, Krishna Upadhyay, Vinaik Chhetri, A. B. Siddique, Umar Farooq

分类: cs.SE, cs.AI

发布日期: 2026-01-12

备注: 8 pages, 8 figures, IEEE BigData Workshop on Software Engineering for Agentic AI 2025

💡 一句话要点

大规模分析多智能体AI系统演进与问题,揭示开发挑战与维护需求。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多智能体系统 大型语言模型 软件维护 实证研究 开源项目 开发模式 问题分析

📋 核心要点

- 现有研究对多智能体AI系统的演进和维护缺乏深入了解,阻碍了该领域的健康发展。

- 通过大规模分析开源MAS的提交记录和问题报告,揭示不同开发模式和常见问题。

- 研究结果强调了改进测试、文档和维护实践的必要性,以提升系统的可靠性和可持续性。

📝 摘要(中文)

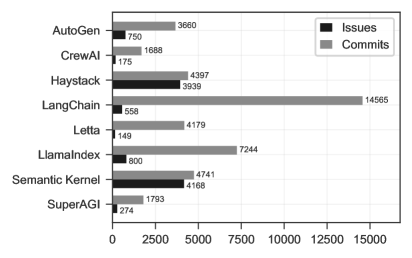

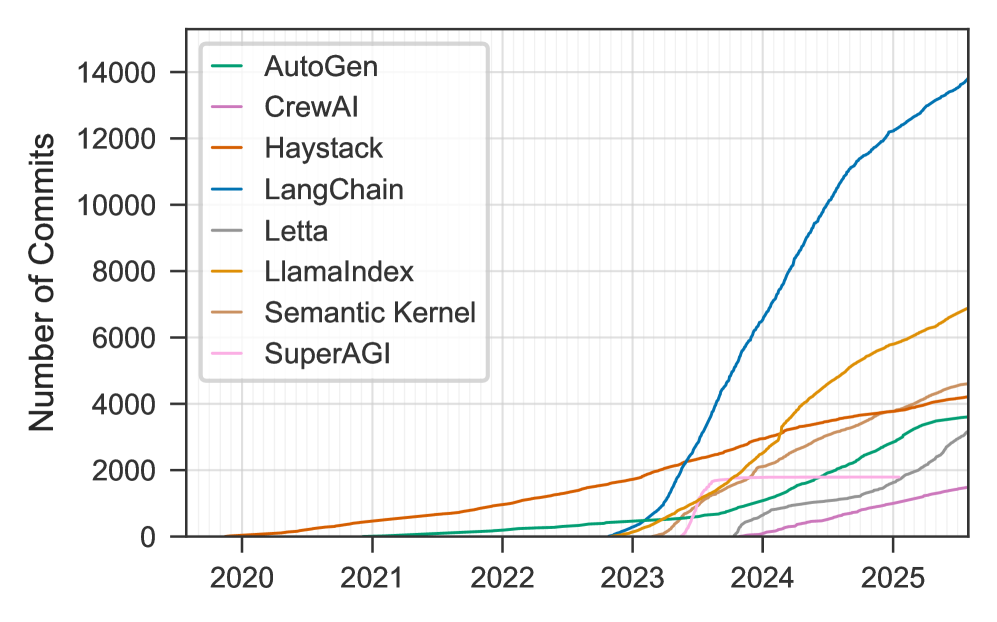

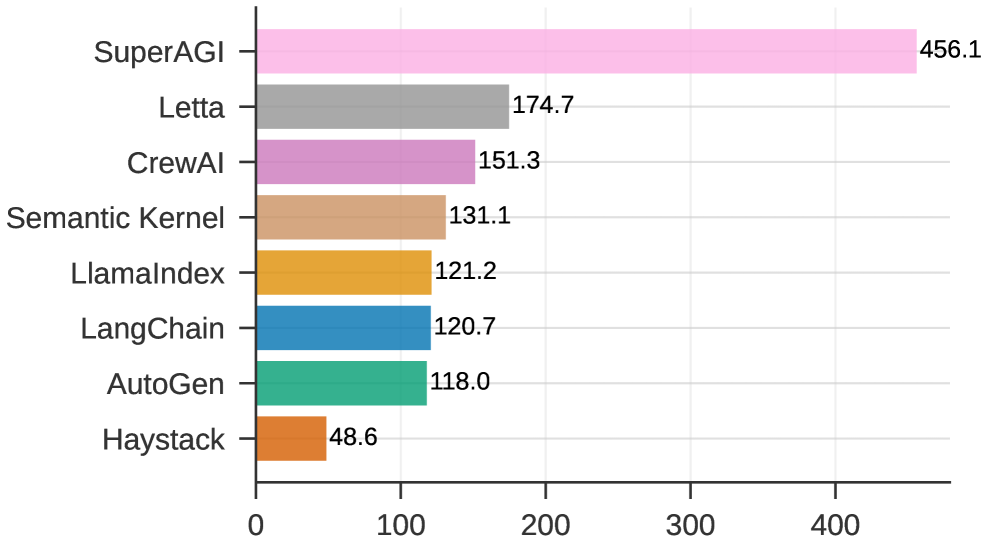

多智能体AI系统(MAS)如LangChain、CrewAI和AutoGen的快速发展,正在重塑大型语言模型(LLM)应用的开发和编排方式。然而,这些系统在实践中如何演进和维护却鲜为人知。本文对开源MAS进行了首次大规模实证研究,分析了八个领先系统的超过4.2万个提交和4.7千个已解决问题。分析确定了三种不同的开发模式:持续型、稳定型和爆发驱动型,反映了生态系统成熟度的显著差异。完善性提交占所有变更的40.8%,表明功能增强优先于纠错性维护(27.4%)和适应性更新(24.3%)。问题数据显示,最常见的问题涉及错误(22%)、基础设施(14%)和智能体协调挑战(10%)。自2023年以来,所有框架的问题报告也急剧增加。平均解决时间从不到一天到大约两周不等,分布偏向快速响应,但少数问题需要更长时间的关注。这些结果突出了当前生态系统的动力和脆弱性,强调需要改进测试基础设施、文档质量和维护实践,以确保长期可靠性和可持续性。

🔬 方法详解

问题定义:论文旨在解决多智能体AI系统(MAS)的开发和维护实践缺乏系统性研究的问题。现有方法难以理解这些系统的演进模式、常见问题以及维护挑战,导致开发效率低下和系统可靠性不足。

核心思路:论文的核心思路是通过大规模实证研究,分析开源MAS项目的提交记录和问题报告,从而揭示其开发模式、常见问题和维护实践。通过量化分析这些数据,可以识别关键的开发瓶颈和潜在的改进方向。

技术框架:论文采用了一种基于数据挖掘和统计分析的框架。首先,收集了八个流行的开源MAS项目的提交记录和问题报告。然后,对这些数据进行清洗和预处理,提取关键信息,如提交类型、问题类型、解决时间等。最后,使用统计方法分析这些数据,识别不同的开发模式、常见问题和维护效率。

关键创新:论文最重要的创新点在于其大规模实证研究的方法。通过分析超过4.2万个提交和4.7千个已解决问题,论文提供了对MAS开发和维护实践的全面而深入的理解。与现有的小规模案例研究相比,该研究的结果更具代表性和普适性。

关键设计:论文的关键设计包括:1) 选择具有代表性的开源MAS项目;2) 定义清晰的提交类型和问题类型分类标准;3) 使用统计方法分析数据,识别显著的模式和趋势;4) 对结果进行深入的解释和讨论,提出改进建议。

🖼️ 关键图片

📊 实验亮点

研究发现,完善性提交占所有变更的40.8%,表明功能增强是主要驱动力。问题分析显示,错误(22%)、基础设施(14%)和智能体协调(10%)是最常见的问题。问题解决时间差异显著,少数问题需要较长时间处理,突显了维护的复杂性。

🎯 应用场景

该研究成果可应用于指导多智能体AI系统的开发和维护。开发者可以根据研究揭示的开发模式和常见问题,优化开发流程、改进测试方法和提高文档质量。此外,该研究还可以为研究人员提供有价值的参考,促进多智能体AI领域的进一步发展。

📄 摘要(原文)

The rapid emergence of multi-agent AI systems (MAS), including LangChain, CrewAI, and AutoGen, has shaped how large language model (LLM) applications are developed and orchestrated. However, little is known about how these systems evolve and are maintained in practice. This paper presents the first large-scale empirical study of open-source MAS, analyzing over 42K unique commits and over 4.7K resolved issues across eight leading systems. Our analysis identifies three distinct development profiles: sustained, steady, and burst-driven. These profiles reflect substantial variation in ecosystem maturity. Perfective commits constitute 40.8% of all changes, suggesting that feature enhancement is prioritized over corrective maintenance (27.4%) and adaptive updates (24.3%). Data about issues shows that the most frequent concerns involve bugs (22%), infrastructure (14%), and agent coordination challenges (10%). Issue reporting also increased sharply across all frameworks starting in 2023. Median resolution times range from under one day to about two weeks, with distributions skewed toward fast responses but a minority of issues requiring extended attention. These results highlight both the momentum and the fragility of the current ecosystem, emphasizing the need for improved testing infrastructure, documentation quality, and maintenance practices to ensure long-term reliability and sustainability.