Placenta Accreta Spectrum Detection using Multimodal Deep Learning

作者: Sumaiya Ali, Areej Alhothali, Sameera Albasri, Ohoud Alzamzami, Ahmed Abduljabbar, Muhammad Alwazzan

分类: eess.IV, cs.AI, cs.CV, cs.LG

发布日期: 2025-12-31

💡 一句话要点

提出基于多模态深度学习的胎盘植入谱检测方法,提升诊断精度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 胎盘植入谱 多模态学习 深度学习 医学影像 特征融合 MRI 超声 产前诊断

📋 核心要点

- 胎盘植入谱(PAS)的早期诊断面临挑战,传统方法依赖单一成像模态,信息有限。

- 提出一种多模态深度学习框架,融合3D MRI和2D超声图像,提取互补特征。

- 实验结果表明,该方法显著提升了PAS检测的准确率和AUC,优于单模态方法。

📝 摘要(中文)

胎盘植入谱(PAS)是一种危及生命的产科并发症,涉及胎盘异常侵入子宫壁。早期准确的产前诊断对于降低母婴风险至关重要。本研究旨在开发和验证一种深度学习框架,通过整合多种成像方式来增强PAS检测。该框架采用中间特征级融合架构,结合3D磁共振成像(MRI)和2D超声(US)扫描。在系统比较分析后,选择单模态特征提取器,即用于MRI的3D DenseNet121-Vision Transformer和用于US的2D ResNet50。使用包含1293个MRI和1143个US扫描的精选数据集来训练单模态模型,并分离出患者匹配的MRI-US扫描配对样本,用于多模态模型开发和评估。在独立测试集上,多模态融合模型表现出卓越的性能,准确率达到92.5%,受试者工作特征曲线下面积(AUC)为0.927,优于仅使用MRI(82.5%,AUC 0.825)和仅使用US(87.5%,AUC 0.879)的模型。整合MRI和US特征提供了互补的诊断信息,展示了增强产前风险评估和改善患者预后的强大潜力。

🔬 方法详解

问题定义:论文旨在解决胎盘植入谱(PAS)的早期准确诊断问题。现有方法主要依赖单一的MRI或超声成像,信息不完整,诊断准确率有待提高。医生诊断经验依赖性强,主观性强,缺乏客观量化标准。

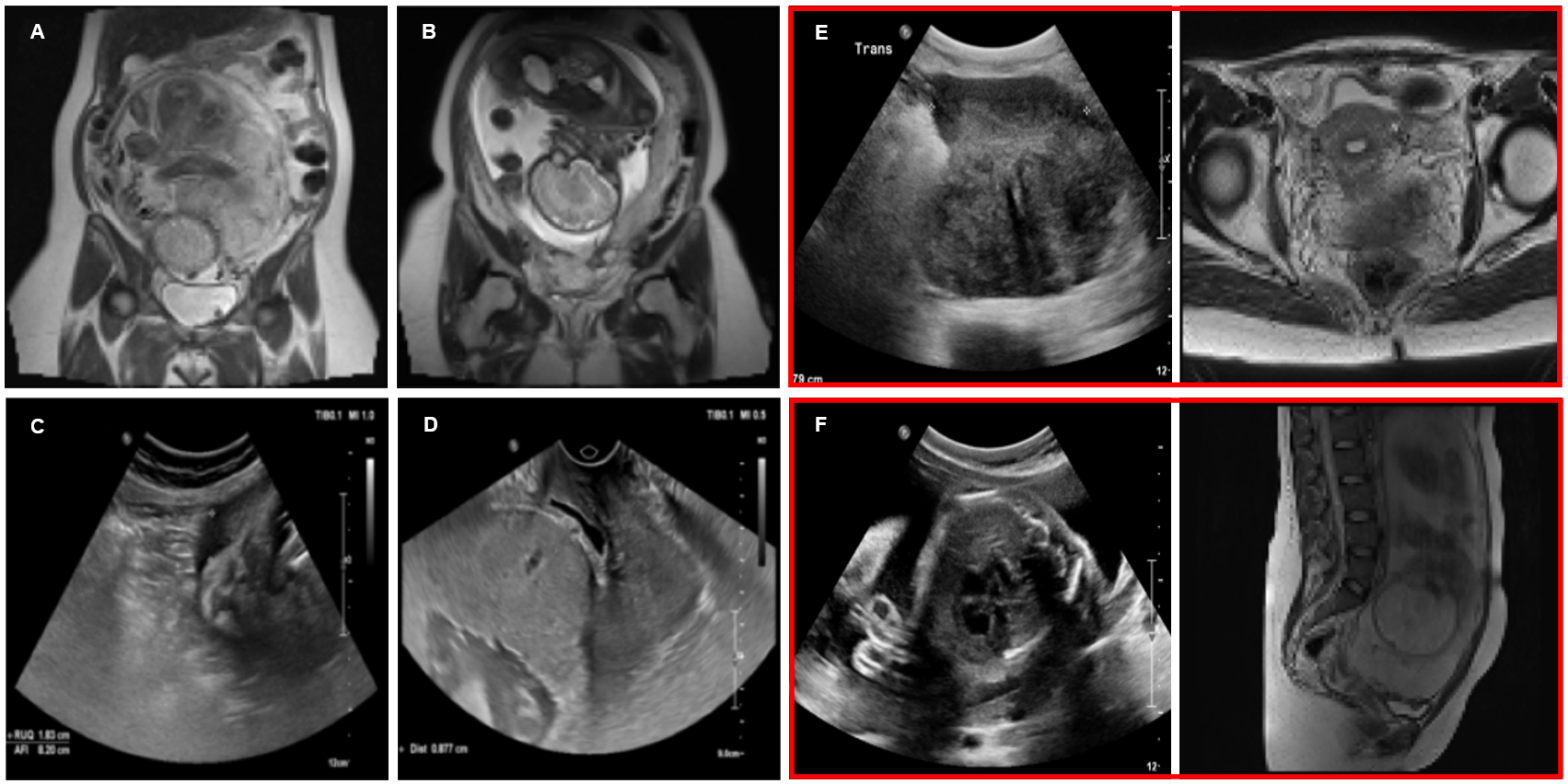

核心思路:论文的核心思路是利用多模态深度学习,融合MRI和超声图像的互补信息,提高PAS诊断的准确性和可靠性。MRI提供子宫壁和胎盘侵入的结构信息,超声提供实时动态信息,二者结合可以更全面地评估病情。

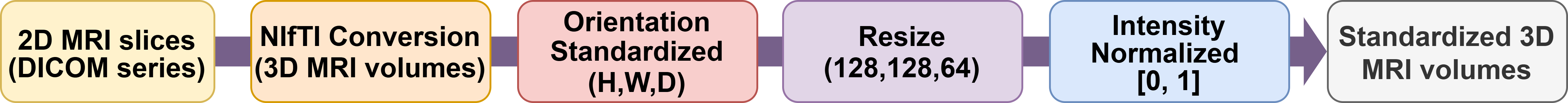

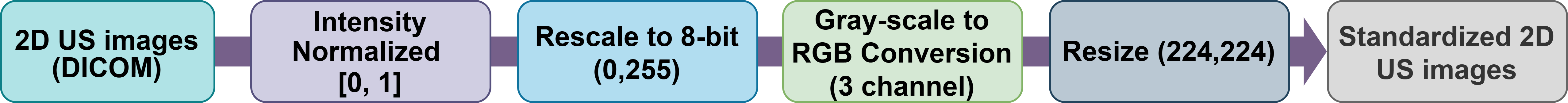

技术框架:整体框架包含三个主要阶段:1) 单模态特征提取:使用3D DenseNet121-Vision Transformer提取MRI图像特征,使用2D ResNet50提取超声图像特征。2) 特征融合:在中间特征层将两种模态的特征进行融合。3) 分类:使用融合后的特征进行PAS诊断分类。

关键创新:最重要的创新点在于多模态特征融合。通过结合MRI和超声的互补信息,模型能够学习到更鲁棒和全面的特征表示,从而提高诊断准确率。此外,针对MRI数据,采用了3D DenseNet121-Vision Transformer结构,更好地捕捉了三维空间信息。

关键设计:在特征融合阶段,采用了中间特征层融合策略,避免了过早或过晚融合可能导致的信息损失。针对MRI数据,3D DenseNet121-Vision Transformer的参数设置和训练策略对最终性能至关重要。损失函数选择方面,可能采用了交叉熵损失函数,并结合数据增强等技术来提高模型的泛化能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,多模态融合模型在独立测试集上取得了92.5%的准确率和0.927的AUC,显著优于仅使用MRI(82.5%,AUC 0.825)和仅使用US(87.5%,AUC 0.879)的模型。这证明了多模态融合策略的有效性,以及MRI和超声图像在PAS诊断中的互补作用。

🎯 应用场景

该研究成果可应用于产前诊断,辅助医生进行胎盘植入谱的早期风险评估,从而制定更合理的治疗方案,降低母婴风险。该技术还可推广到其他医学影像诊断领域,例如肿瘤检测、心血管疾病诊断等,具有广阔的应用前景。

📄 摘要(原文)

Placenta Accreta Spectrum (PAS) is a life-threatening obstetric complication involving abnormal placental invasion into the uterine wall. Early and accurate prenatal diagnosis is essential to reduce maternal and neonatal risks. This study aimed to develop and validate a deep learning framework that enhances PAS detection by integrating multiple imaging modalities. A multimodal deep learning model was designed using an intermediate feature-level fusion architecture combining 3D Magnetic Resonance Imaging (MRI) and 2D Ultrasound (US) scans. Unimodal feature extractors, a 3D DenseNet121-Vision Transformer for MRI and a 2D ResNet50 for US, were selected after systematic comparative analysis. Curated datasets comprising 1,293 MRI and 1,143 US scans were used to train the unimodal models and paired samples of patient-matched MRI-US scans was isolated for multimodal model development and evaluation. On an independent test set, the multimodal fusion model achieved superior performance, with an accuracy of 92.5% and an Area Under the Receiver Operating Characteristic Curve (AUC) of 0.927, outperforming the MRI-only (82.5%, AUC 0.825) and US-only (87.5%, AUC 0.879) models. Integrating MRI and US features provides complementary diagnostic information, demonstrating strong potential to enhance prenatal risk assessment and improve patient outcomes.