The Agentic Leash: Extracting Causal Feedback Fuzzy Cognitive Maps with LLMs

作者: Akash Kumar Panda, Olaoluwa Adigun, Bart Kosko

分类: cs.AI, cs.CL, cs.HC, cs.IR

发布日期: 2025-12-31 (更新: 2026-01-14)

备注: 15 figures

💡 一句话要点

提出Agentic Leash框架,利用LLM提取因果反馈模糊认知地图

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 模糊认知地图 大型语言模型 因果关系提取 智能体 动态系统

📋 核心要点

- 现有方法难以从非结构化文本中自动提取因果关系,构建模糊认知地图。

- 提出Agentic Leash框架,利用LLM的自主性和FCM的动态平衡,实现因果关系提取。

- 实验表明,该方法生成的FCM与人工生成的FCM具有相似的动态特性,能有效捕捉文本中的因果关系。

📝 摘要(中文)

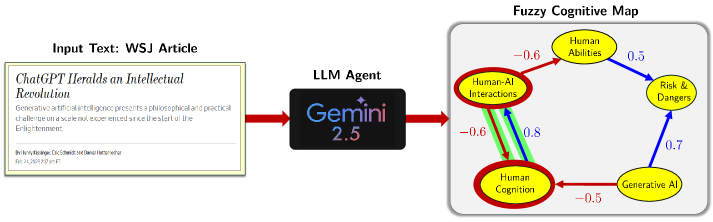

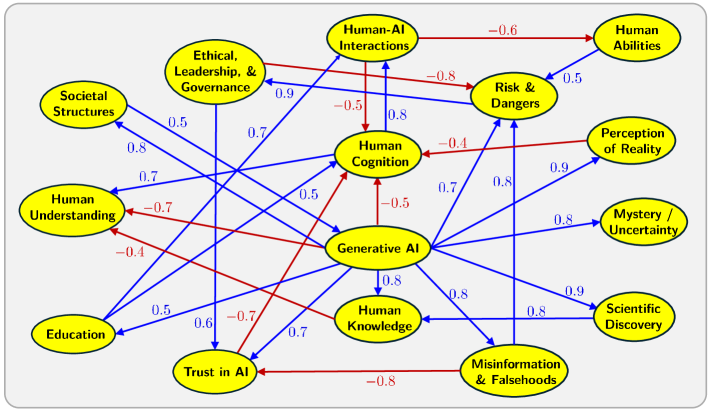

本文设计了一个大型语言模型(LLM)智能体,用于从原始文本中提取因果反馈模糊认知地图(FCM)。因果学习或提取过程是智能体的,这既是因为LLM的半自主性,也是因为最终FCM动力系统的平衡驱动LLM智能体获取和处理因果文本。获取的文本原则上可以修改自适应FCM的因果结构,从而修改其准自主性的来源——其平衡极限环和固定点吸引子。这种双向过程赋予了演化的FCM动力系统一定程度的自主性,同时仍保持在其智能体的控制之下。我们特别展示了一系列三个经过微调的系统指令如何引导LLM智能体系统地从文本中提取关键名词和名词短语,从这些名词和名词短语中提取FCM概念节点,然后提取或推断这些FCM节点之间的部分或模糊因果边。我们在已故外交家和政治理论家亨利·基辛格及其同事最近一篇关于人工智能前景的文章中测试了这种FCM生成。这个三步过程产生的FCM动力系统收敛到与人工生成的FCM相同的平衡极限环,即使人工生成的FCM在节点和边的数量上有所不同。最终的FCM混合了来自Gemini和ChatGPT LLM智能体的生成FCM。混合FCM吸收了其主要混合成分的平衡,但也创造了自己新的平衡,以更好地近似潜在的因果动力系统。

🔬 方法详解

问题定义:现有方法在从非结构化文本中提取因果关系并构建模糊认知地图(FCM)方面存在挑战。人工构建FCM耗时且主观,而传统算法难以处理自然语言的复杂性和模糊性。因此,需要一种能够自动、高效地从文本中提取因果关系并生成FCM的方法。

核心思路:本文的核心思路是利用大型语言模型(LLM)的强大自然语言理解和生成能力,构建一个智能体(Agent),该智能体能够从文本中提取关键概念和因果关系,并将其转化为FCM。同时,利用FCM的动态平衡特性,引导LLM智能体不断优化提取结果,形成一个闭环反馈系统。

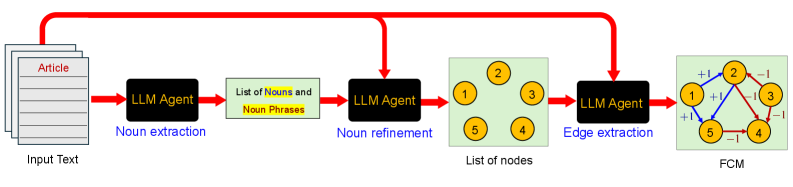

技术框架:该方法的技术框架主要包括三个阶段: 1. 概念提取:利用LLM从文本中提取关键名词和名词短语,作为FCM的候选节点。 2. 节点选择:从候选节点中选择最具代表性的概念,作为FCM的最终节点。 3. 因果关系提取:利用LLM推断节点之间的因果关系,并赋予相应的权重,构建FCM的边。

关键创新:该方法最重要的创新点在于引入了“Agentic Leash”的概念,即利用FCM的动态平衡特性来引导LLM智能体的行为。具体来说,FCM的平衡状态(例如,极限环和固定点吸引子)会影响LLM智能体提取和处理文本的方式,从而反过来影响FCM的结构。这种双向反馈机制使得FCM能够不断适应和优化,从而更好地捕捉文本中的因果关系。

关键设计:该方法的关键设计包括: 1. 系统指令:设计了一系列精细的系统指令,引导LLM智能体完成概念提取、节点选择和因果关系提取等任务。 2. FCM动态模拟:利用FCM的动态模拟,评估FCM的性能,并指导LLM智能体进行优化。 3. 混合FCM:将来自不同LLM智能体(例如,Gemini和ChatGPT)生成的FCM进行混合,以提高FCM的鲁棒性和准确性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法生成的FCM与人工生成的FCM具有相似的动态特性,能够收敛到相同的平衡极限环。即使人工生成的FCM在节点和边的数量上有所不同,该方法仍然能够有效地捕捉文本中的因果关系。混合来自不同LLM智能体的FCM能够进一步提高FCM的性能。

🎯 应用场景

该研究成果可应用于多个领域,例如政策分析、风险评估、舆情监控等。通过自动构建FCM,可以帮助决策者更好地理解复杂系统中的因果关系,预测系统行为,并制定更有效的策略。此外,该方法还可以用于教育领域,帮助学生理解复杂概念和系统。

📄 摘要(原文)

We design a large-language-model (LLM) agent that extracts causal feedback fuzzy cognitive maps (FCMs) from raw text. The causal learning or extraction process is agentic both because of the LLM's semi-autonomy and because ultimately the FCM dynamical system's equilibria drive the LLM agents to fetch and process causal text. The fetched text can in principle modify the adaptive FCM causal structure and so modify the source of its quasi-autonomy--its equilibrium limit cycles and fixed-point attractors. This bidirectional process endows the evolving FCM dynamical system with a degree of autonomy while still staying on its agentic leash. We show in particular that a sequence of three finely tuned system instructions guide an LLM agent as it systematically extracts key nouns and noun phrases from text, as it extracts FCM concept nodes from among those nouns and noun phrases, and then as it extracts or infers partial or fuzzy causal edges between those FCM nodes. We test this FCM generation on a recent essay about the promise of AI from the late diplomat and political theorist Henry Kissinger and his colleagues. This three-step process produced FCM dynamical systems that converged to the same equilibrium limit cycles as did the human-generated FCMs even though the human-generated FCM differed in the number of nodes and edges. A final FCM mixed generated FCMs from separate Gemini and ChatGPT LLM agents. The mixed FCM absorbed the equilibria of its dominant mixture component but also created new equilibria of its own to better approximate the underlying causal dynamical system.